Pytanie 1

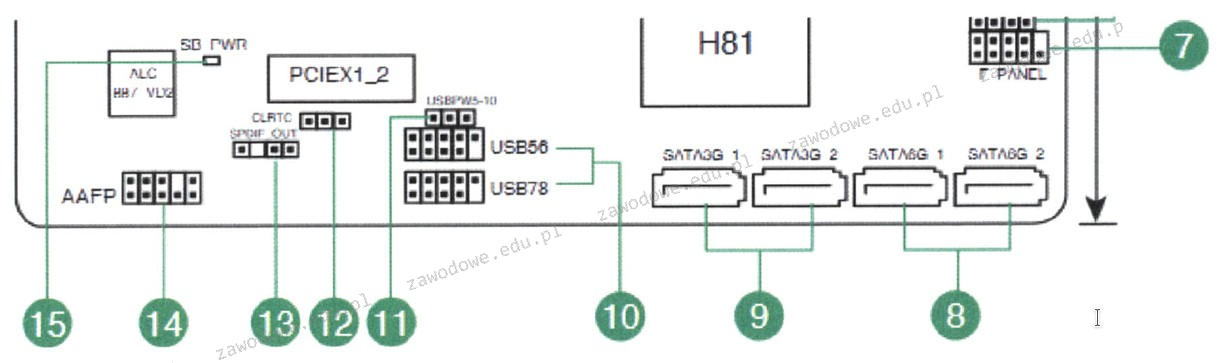

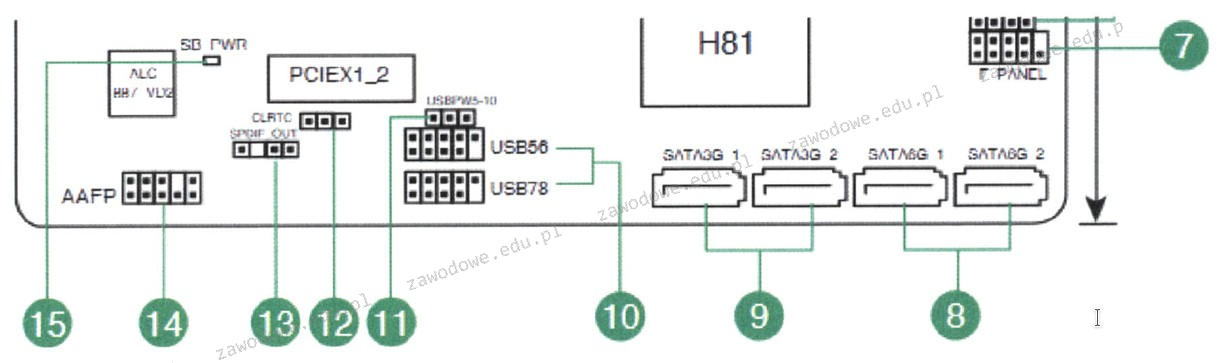

Na diagramie płyty głównej, który znajduje się w dokumentacji laptopa, złącza oznaczone numerami 8 i 9 to

Wynik: 29/40 punktów (72,5%)

Wymagane minimum: 20 punktów (50%)

Na diagramie płyty głównej, który znajduje się w dokumentacji laptopa, złącza oznaczone numerami 8 i 9 to

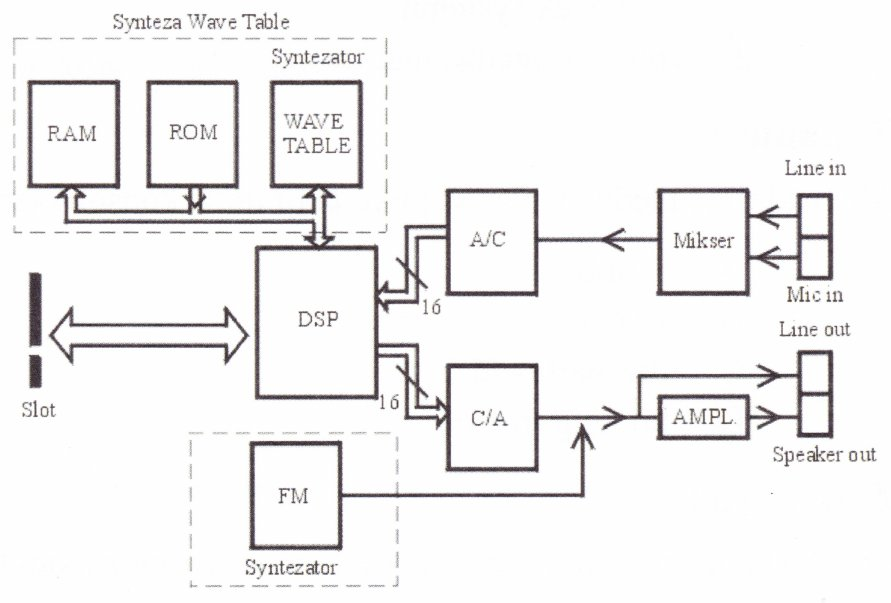

Na ilustracji przedstawiono diagram funkcjonowania

Jakie czynności należy wykonać, aby przygotować nowego laptopa do użytkowania?

Po zainstalowaniu Windows 10, aby skonfigurować połączenie internetowe z ograniczeniem danych, w ustawieniach sieci i Internetu należy ustawić typ połączenia

Do stworzenia projektu sieci komputerowej dla obiektu szkolnego najlepiej użyć edytora grafiki wektorowej, którym jest oprogramowanie

Urządzenie pokazane na ilustracji służy do zgrzewania wtyków

Ile sieci obejmują komputery z adresami IP przedstawionymi w tabeli oraz standardową maską sieci?

| Komputer 1 | 172.16.15.5 |

| Komputer 2 | 172.18.15.6 |

| Komputer 3 | 172.18.16.7 |

| Komputer 4 | 172.20.16.8 |

| Komputer 5 | 172.20.16.9 |

| Komputer 6 | 172.21.15.10 |

Jakiego rodzaju plik należy stworzyć w systemie operacyjnym, aby zautomatyzować rutynowe działania, takie jak kopiowanie lub tworzenie plików oraz folderów?

Po zainstalowaniu z domyślnymi uprawnieniami, system Windows XP nie obsługuje formatu systemu plików

Jakim parametrem definiuje się stopień zmniejszenia mocy sygnału w danej parze przewodów po przejściu przez cały tor kablowy?

Która z wymienionych czynności konserwacyjnych związana jest wyłącznie z drukarką laserową?

Bezpośrednio po usunięciu istotnych plików z dysku twardego, użytkownik powinien

Norma TIA/EIA-568-B.2 definiuje parametry specyfikacji transmisyjnej

Na urządzeniu znajduje się symbol, który stanowi certyfikat potwierdzający zgodność sprzętu w zakresie emisji promieniowania, ergonomii, efektywności energetycznej oraz ekologii, co przedstawiono na rysunku

echo off echo ola.txt >> ala.txt pauseJakie będą skutki wykonania podanego skryptu?

Jaką funkcję pełni zarządzalny przełącznik, aby łączyć wiele połączeń fizycznych w jedno logiczne, co pozwala na zwiększenie przepustowości łącza?

Przydzielaniem adresów IP w sieci zajmuje się serwer

Administrator dostrzegł, że w sieci LAN występuje wiele kolizji. Jakie urządzenie powinien zainstalować, aby podzielić sieć lokalną na mniejsze domeny kolizji?

Który z poniższych programów nie jest wykorzystywany do zdalnego administrowania komputerami w sieci?

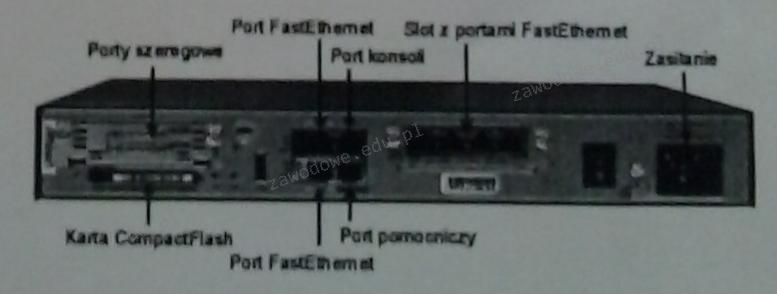

Poprzez użycie opisanego urządzenia możliwe jest wykonanie diagnostyki działania

Narzędzia do dostosowywania oraz Unity Tweak Tool to aplikacje w systemie Linux przeznaczone do

Na ilustracji przedstawiono urządzenie sieciowe, którym jest

Jakim adresem IPv6 charakteryzuje się autokonfiguracja łącza?

Adres fizyczny karty sieciowej AC-72-89-17-6E-B2 jest zapisany w formacie

Wartość liczby ABBA zapisana w systemie heksadecymalnym odpowiada w systemie binarnym liczbie

Użytkownik uszkodził płytę główną z gniazdem procesora AM2. Uszkodzoną płytę można zastąpić, bez konieczności wymiany procesora i pamięci, modelem z gniazdem

Parametr pamięci RAM określany czasem jako opóźnienie definiuje się jako

Ile wyniesie całkowity koszt wymiany karty sieciowej w komputerze, jeżeli cena karty to 40 zł, czas pracy serwisanta wyniesie 90 minut, a koszt każdej rozpoczętej roboczogodziny to 60 zł?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Czym jest mapowanie dysków?

Aby sygnały pochodzące z dwóch routerów w sieci WiFi pracującej w standardzie 802.11g nie wpływały na siebie nawzajem, należy skonfigurować kanały o numerach

Jaką liczbę komórek pamięci można bezpośrednio zaadresować w 64-bitowym procesorze z 32-bitową szyną adresową?

Protokół, który pozwala urządzeniom na uzyskanie od serwera informacji konfiguracyjnych, takich jak adres IP bramy sieciowej, to

Do interfejsów pracujących równolegle należy interfejs

Do efektywnego zrealizowania macierzy RAID 1 wymagane jest minimum

Aby serwerowa płyta główna mogła działać poprawnie, potrzebuje pamięci z rejestrem. Który z poniższych modułów pamięci będzie z nią zgodny?

Program testujący wydajność sprzętu komputerowego to

Do przeprowadzenia ręcznej konfiguracji interfejsu sieciowego w systemie Linux konieczne jest użycie polecenia

Jakie oprogramowanie należy zainstalować, aby serwer Windows mógł obsługiwać usługi katalogowe?

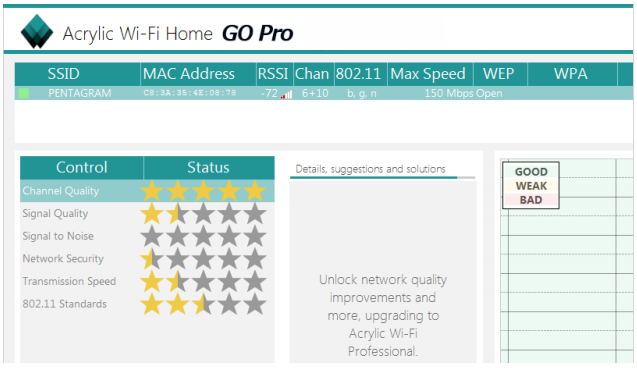

W programie Acrylic Wi-Fi Home przeprowadzono test, którego rezultaty ukazano na zrzucie ekranu. Na ich podstawie można stwierdzić, że sieć bezprzewodowa dostępna w danym momencie