Pytanie 1

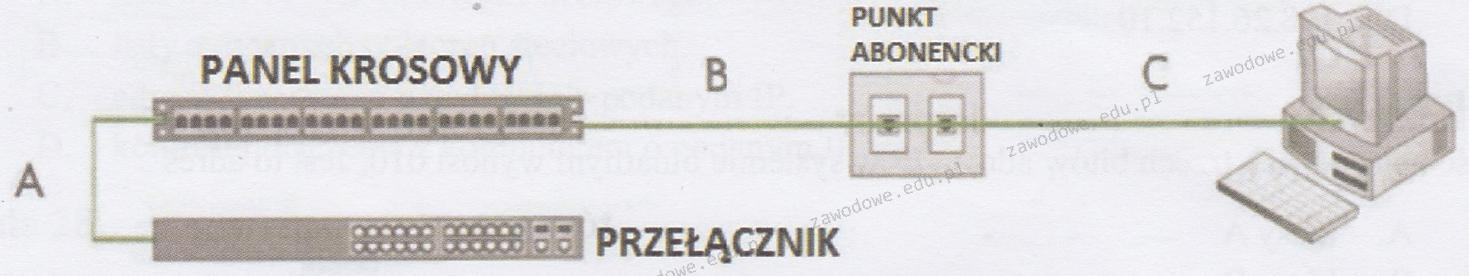

Według normy PN-EN 50174 maksymalna całkowita długość kabla połączeniowego między punktem abonenckim a komputerem oraz kabla krosowniczego A+C) wynosi

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Według normy PN-EN 50174 maksymalna całkowita długość kabla połączeniowego między punktem abonenckim a komputerem oraz kabla krosowniczego A+C) wynosi

W adresie IP z klasy A, wartość pierwszego bajtu mieści się w zakresie

Aby zapobiec uszkodzeniu układów scalonych, podczas konserwacji sprzętu komputerowego należy używać

Jakie narzędzie jest używane w systemie Windows do przywracania właściwych wersji plików systemowych?

Urządzenie warstwy dystrybucji, które umożliwia komunikację pomiędzy różnymi sieciami, to

Jak przywrócić stan rejestru systemowego w edytorze Regedit, wykorzystując wcześniej utworzoną kopię zapasową?

Wynikiem dodawania liczb \( 33_{(8)} \) oraz \( 71_{(8)} \) jest liczba

Aby zapewnić użytkownikom Active Directory możliwość logowania i korzystania z zasobów tej usługi w sytuacji awarii kontrolera domeny, trzeba

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Administrator powinien podzielić adres 10.0.0.0/16 na 4 jednorodne podsieci zawierające równą liczbę hostów. Jaką maskę będą miały te podsieci?

Jakie polecenie w systemie Windows należy użyć, aby ustalić liczbę ruterów pośrednich znajdujących się pomiędzy hostem źródłowym a celem?

Jaki port jest ustawiony jako domyślny dla serwera WWW?

W którym katalogu w systemie Linux można znaleźć pliki zawierające dane o urządzeniach zainstalowanych w komputerze, na przykład pamięci RAM?

Programem antywirusowym oferowanym bezpłatnie przez Microsoft dla posiadaczy legalnych wersji systemu Windows jest

Firma świadcząca usługi sprzątania potrzebuje drukować faktury tekstowe w czterech kopiach równocześnie, na papierze samokopiującym. Jaką drukarkę powinna wybrać?

Aby poprawić wydajność procesora serii Intel za pomocą 'podkręcania' (ang. overclocking), należy użyć procesora oznaczonego

Aby komputer osobisty współpracował z urządzeniami korzystającymi z przedstawionych na rysunku złącz, należy wyposażyć go w interfejs

Kable łączące poziome punkty dystrybucyjne z centralnym punktem dystrybucyjnym określa się jako

Jakie jest zadanie programu Wireshark?

Protokołem kontrolnym w obrębie rodziny TCP/IP, który ma na celu między innymi identyfikowanie usterek w urządzeniach sieciowych, jest

Jakie polecenie oprócz ls może być użyte przez użytkownika systemu Linux do wyświetlenia zawartości katalogu, w tym plików i podkatalogów?

Wykonanie polecenia ```NET USER GRACZ * /ADD``` w wierszu poleceń systemu Windows spowoduje

Aby zweryfikować połączenia kabla U/UTP Cat. 5e w systemie okablowania strukturalnego, jakiego urządzenia należy użyć?

Na ilustracji widoczny jest komunikat systemowy. Jaką czynność powinien wykonać użytkownik, aby naprawić występujący błąd?

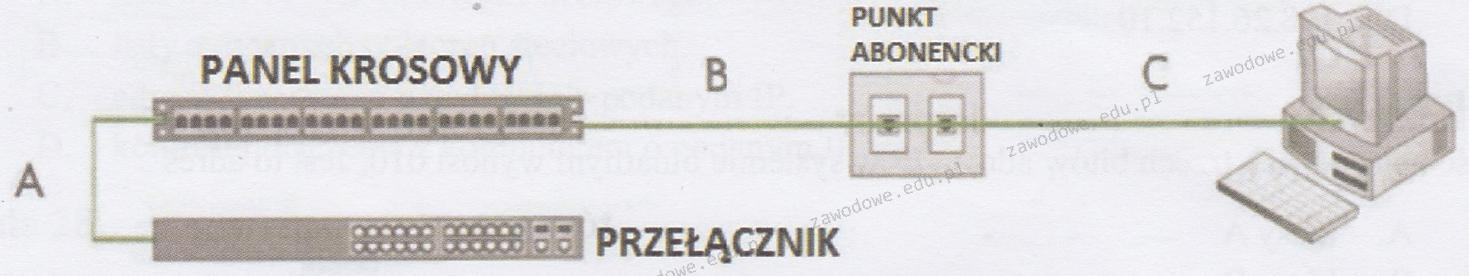

Zaprezentowane właściwości karty sieciowej sugerują, że karta

| Kod Producenta | WN-370USB |

| Interfejs | USB |

| Zgodność ze standardem | IEEE 802.11 b/g/n |

| Ilość wyjść | 1 szt. |

| Zabezpieczenia | WEP 64/128, WPA, WPA2 |

| Wymiary | 49(L) x 26(W) x 10(H) mm |

Minimalna odległość toru nieekranowanego kabla sieciowego od instalacji elektrycznej oświetlenia powinna wynosić

Jakie protokoły przesyłają cykliczne kopie tablic routingu do sąsiadującego rutera i NIE ZAWIERAJĄ pełnych informacji o dalekich ruterach?

Wtyczka zaprezentowana na fotografii stanowi element obwodu elektrycznego zasilającego

Klient przyniósł do serwisu uszkodzony sprzęt komputerowy. W trakcie procedury odbioru sprzętu, przed rozpoczęciem jego naprawy, serwisant powinien

W systemie Linux do monitorowania użycia procesora, pamięci, procesów i obciążenia systemu służy polecenie

Zgodnie z normą PN-EN 50174, maksymalna długość kabla poziomego kategorii 6 pomiędzy punktem abonenckim a punktem dystrybucji w panelu krosowym wynosi

Aby przywrócić dane, które zostały usunięte dzięki kombinacji klawiszy Shift+Delete, trzeba

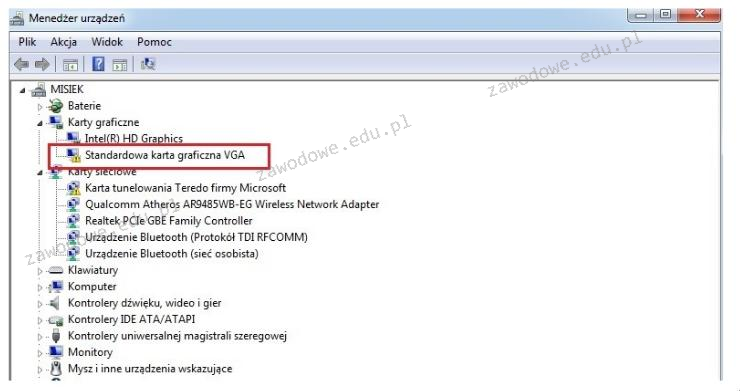

Wskaż model licencjonowania serwera zarządzającego (Management Serwer), oferowanego firmom przez Microsoft, którego schemat przedstawiono na ilustracji.

Wskaż znak umieszczany na urządzeniach elektrycznych przeznaczonych do obrotu i sprzedaży w Unii Europejskiej.

Podczas tworzenia sieci kablowej o maksymalnej prędkości przesyłu danych wynoszącej 1 Gb/s, w której maksymalna odległość między punktami sieci nie przekracza 100 m, należy zastosować jako medium transmisyjne

Które z poniższych stwierdzeń na temat protokołu DHCP jest poprawne?

Jakie narzędzie pozwala na zarządzanie menedżerem rozruchu w systemach Windows od wersji Vista?

Industry Standard Architecture to standard magistrali, który określa, że szerokość szyny danych wynosi:

W ramach zalecanych działań konserwacyjnych użytkownicy dysków SSD powinni unikać wykonywania

Jakie będą całkowite wydatki na materiały potrzebne do wyprodukowania 20 kabli połączeniowych typu patchcord o długości 1,5 m każdy, jeżeli koszt jednego metra kabla wynosi 1 zł, a wtyk to 50 gr?