Pytanie 1

Narzędzia do dostosowywania oraz Unity Tweak Tool to aplikacje w systemie Linux przeznaczone do

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Narzędzia do dostosowywania oraz Unity Tweak Tool to aplikacje w systemie Linux przeznaczone do

Dostarczanie błędnych napięć do płyty głównej może spowodować

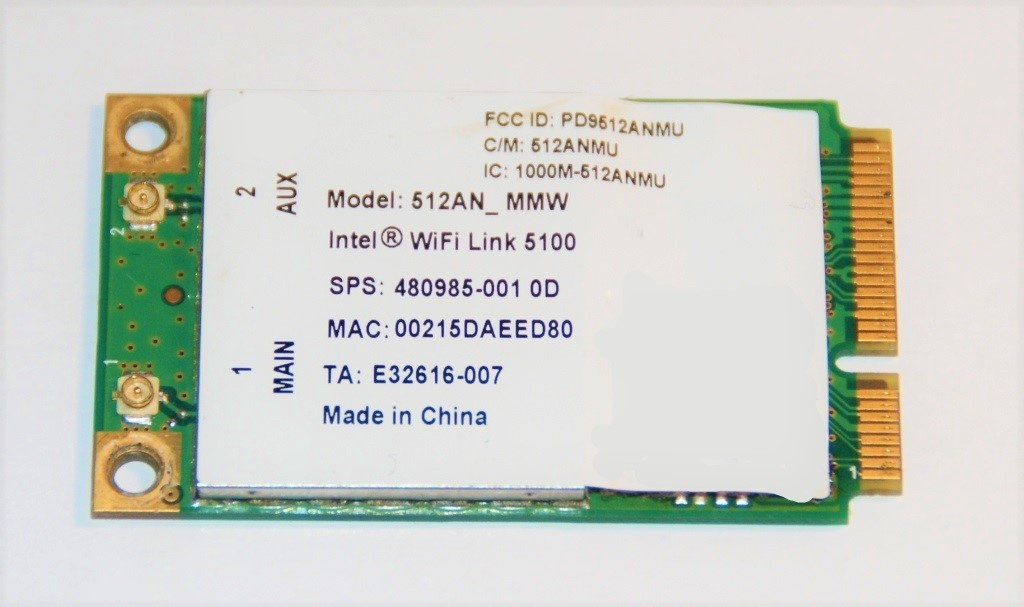

Do bezprzewodowej transmisji danych pomiędzy dwiema jednostkami, z wykorzystaniem fal radiowych w zakresie ISM 2,4 GHz, przeznaczony jest interfejs

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Fast Ethernet to norma sieci przewodowej, która pozwala na przesył danych z maksymalną szybkością

Udostępnienie drukarki sieciowej codziennie o tej samej porze należy ustawić we właściwościach drukarki, w zakładce

Jaką kwotę trzeba będzie przeznaczyć na zakup kabla UTP kat.5e do zbudowania sieci komputerowej składającej się z 6 stanowisk, gdzie średnia odległość każdego stanowiska od przełącznika wynosi 9 m? Należy uwzględnić 1 m zapasu dla każdej linii kablowej, a cena za 1 metr kabla to 1,50 zł?

Na ilustracji przedstawiono

Jaką usługą można pobierać i przesyłać pliki na serwer?

Przedmiot widoczny na ilustracji to

Wartość koloru RGB(255, 170, 129) odpowiada zapisie

Wskaż interfejsy płyty głównej widoczne na rysunku.

Które medium transmisyjne umożliwia izolację galwaniczną pomiędzy systemami przesyłu danych?

Jakiego typu dane są przesyłane przez interfejs komputera osobistego, jak pokazano na ilustracji?

| Bit startu | Bit danych | Bit danych | Bit stopu | Bit startu | Bit danych | Bit startu | Bit danych | Bit danych | Bit stopu | Bit startu | Bit danych | Bit stopu |

Pojemność pamięci 100 GiB odpowiada zapisowi

Który z wymienionych protokołów jest szyfrowanym protokołem do zdalnego dostępu?

Jaki poziom macierzy RAID umożliwia równoległe zapisywanie danych na wielu dyskach działających jako jedno urządzenie?

Najmniejszy czas dostępu charakteryzuje się

Na którym z domyślnych portów realizowana jest komunikacja protokołu ftp?

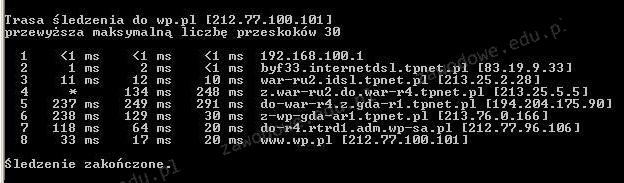

Jaki wynik działania którego z poleceń w systemie Windows jest zaprezentowany na rysunku?

Drukarka, która zapewnia zdjęcia o wysokiej jakości to drukarka

Aby dostęp do systemu Windows Serwer 2016 był możliwy dla 50 urządzeń, bez względu na liczbę użytkowników, należy w firmie zakupić licencję

Internet Relay Chat (IRC) to protokół wykorzystywany do

Symbol umieszczony na obudowie komputera stacjonarnego informuje o zagrożeniu przed

Jakim akronimem oznacza się przenikanie bliskie skrętki teleinformatycznej?

ARP (Adress Resolution Protocol) jest protokołem, który umożliwia przekształcenie adresu IP na

Jakie czynniki nie powodują utraty danych z dysku twardego HDD?

Który model pamięci RAM, można umieścić na płycie, której fragment specyfikacji przedstawiono na ilustracji?

| Pamięć | |

|---|---|

| Obsługiwana pamięć | DDR4 |

| Rodzaj obsługiwanej pamięci | DIMM (do PC) |

| Typ obsługiwanej pamięci | DDR4-2133 (PC4-17000) DDR4-2400 (PC4-19200) DDR4-2666 (PC4-21300) DDR4-2800 (PC4-22400) DDR4-3200 (PC4-25600) |

| Typ obsługiwanej pamięci OC | DDR4-3466 (PC4-27700) DDR4-3600 (PC4-28800) DDR4-3866 (PC4-30900) DDR4-4000 (PC4-32000) DDR4-4133 (PC4-33000) DDR4-4400 (PC4-35200) DDR4-4600 (PC4-36800) |

| Dwukanałowa obsługa pamięci | tak |

| Ilość gniazd pamięci | 4 szt. |

| Maks. pojemność pamięci | 128 GB |

Jaką cechę posiada przełącznik w sieci?

Jaką operację należy wykonać, aby chronić dane przesyłane w sieci przed działaniem sniffera?

Aby zweryfikować schemat połączeń kabla UTP Cat 5e w sieci lokalnej, należy zastosować

W celu zainstalowania systemu openSUSE oraz dostosowania jego ustawień, można skorzystać z narzędzia

Jakie protokoły są używane w komunikacji między hostem a serwerem WWW po wpisaniu URL w przeglądarkę internetową hosta?

Strategia zapisywania kopii zapasowych ukazana na diagramie określana jest mianem

| Day | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | 11 | 12 | 13 | 14 | 15 | 16 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Media Set | A | A | A | A | A | A | A | A | ||||||||

| B | B | B | B | |||||||||||||

| C | C | C | ||||||||||||||

| E |

Czym jest OTDR?

RAMDAC konwerter przekształca sygnał

Urządzeniem wykorzystywanym do formowania kształtów oraz grawerowania m.in. w materiałach drewnianych, szklanych i metalowych jest ploter

Jakie oprogramowanie chroni komputer przed niechcianym softwarem pochodzącym z sieci?

W dokumentacji powykonawczej dotyczącej fizycznej i logicznej struktury sieci lokalnej powinien znajdować się

W protokole IPv4 adres broadcastowy, zapisany w formacie binarnym, bez podziału na podsieci, w sekcji przeznaczonej dla hosta zawiera