Pytanie 1

W przypadku planowania wykorzystania przestrzeni dyskowej komputera do przechowywania oraz udostępniania danych, takich jak pliki oraz aplikacje dostępne w internecie, a także ich zarządzania, komputer powinien być skonfigurowany jako

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

W przypadku planowania wykorzystania przestrzeni dyskowej komputera do przechowywania oraz udostępniania danych, takich jak pliki oraz aplikacje dostępne w internecie, a także ich zarządzania, komputer powinien być skonfigurowany jako

W systemie Linux komenda ifconfig odnosi się do

AES (ang. Advanced Encryption Standard) to standard szyfrowania, który?

Komputer powinien działać jako serwer w sieci lokalnej, umożliwiając innym komputerom dostęp do Internetu poprzez podłączenie do gniazda sieci rozległej za pomocą kabla UTP Cat 5e. Na chwilę obecną komputer jest jedynie połączony ze switchem sieci lokalnej również kablem UTP Cat 5e oraz nie dysponuje innymi portami 8P8C. Jakiego komponentu musi on koniecznie nabrać?

Technik serwisowy, po przeprowadzeniu testu na serwerze NetWare, otrzymał informację, że obiekt dysponuje prawem

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Rodzajem złośliwego oprogramowania będącego programem rezydentnym, który działa, wykonując konkretną operację, nie powiela się przez sieć, a jedną z jego metod jest samoreplikacja aż do wyczerpania pamięci komputera, jest

Co oznacza oznaczenie kabla skrętkowego S/FTP?

Jakie polecenie należy wykorzystać w systemie Linux, aby zlokalizować wszystkie pliki z rozszerzeniem txt, które znajdują się w katalogu /home/user i mają w nazwie ciąg znaków abc?

Wskaż symbol umieszczany na urządzeniach elektrycznych przeznaczonych do sprzedaży i obrotu w Unii Europejskiej?

Do instalacji i usuwania oprogramowania w systemie Ubuntu wykorzystywany jest menedżer

Jakie urządzenie powinno być użyte do podłączenia żył kablowych skrętki do gniazda Ethernet?

Cechą charakterystyczną transmisji w interfejsie równoległym synchronicznym jest to, że

Martwy piksel, będący defektem monitorów LCD, to punkt, który trwa niezmiennie w kolorze

W systemie SI jednostką do mierzenia napięcia jest

Która z poniższych informacji odnosi się do profilu tymczasowego użytkownika?

Jakie informacje można uzyskać dzięki programowi Wireshark?

W serwisie komputerowym dokumentem zawierającym informacje o sprzęcie, opis usterki, datę zgłoszenia i dane klienta jest

Aby uzyskać listę procesów aktualnie działających w systemie Linux, należy użyć polecenia

Oprogramowanie OEM (Original Equipment Manufacturer) jest przypisane do

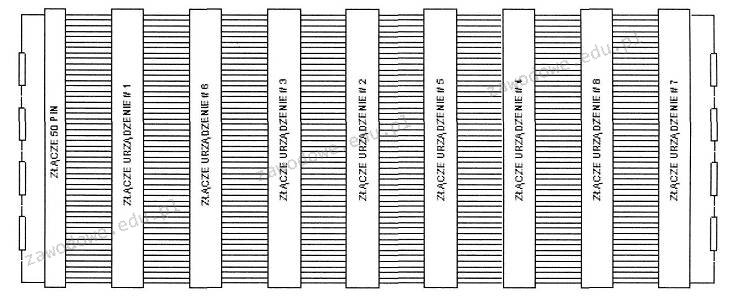

Na ilustracji ukazana jest karta

Do kategorii oprogramowania określanego mianem malware (ang. malicious software) nie zalicza się oprogramowania typu

Za pomocą taśmy 60-pinowej pokazanej na ilustracji łączy się z płytą główną komputera

W specyfikacji głośników komputerowych producent mógł podać informację, że maksymalne pasmo przenoszenia wynosi

Jaką kwotę trzeba będzie zapłacić za wymianę karty graficznej w komputerze, jeśli koszt karty wynosi 250 zł, czas wymiany to 80 minut, a cena za każdą rozpoczętą roboczogodzinę to 50 zł?

Wypukłe kondensatory elektrolityczne w module zasilania monitora LCD mogą doprowadzić do uszkodzenia

Jaki adres IP w systemie dziesiętnym odpowiada adresowi IP 10101010.00001111.10100000.11111100 zapisanemu w systemie binarnym?

Który procesor jest kompatybilny z płytą główną o przedstawionej specyfikacji?

ASUS micro-ATX, socket 1150, VT-d, DDR3 `1333, 1600 MHz), ATI Radeon X1250, 3 x PCI-Express x1, 3 x PCI-Express x16, 2 x Serial ATA III, USB 3.0, VGA, HDMI, DVI-D

Jaką maksymalną liczbę adresów można przypisać urządzeniom w sieci 10.0.0.0/22?

W tabeli przedstawiono pobór mocy poszczególnych podzespołów zestawu komputerowego. Zestaw składa się z:

- płyty głównej,

- procesora,

- 2 modułów pamięci DDR3,

- dysku twardego SSD,

- dysku twardego z prędkością obrotową 7200,

- karty graficznej,

- napędu optycznego,

- myszy i klawiatury,

- wentylatora.

Który zasilacz należy zastosować dla przedstawionego zestawu komputerowego, uwzględniając co najmniej 20% rezerwy poboru mocy?

| Podzespół | Pobór mocy [W] | Podzespół | Pobór mocy [W] |

|---|---|---|---|

| Procesor Intel i5 | 60 | Płyta główna | 35 |

| Moduł pamięci DDR3 | 6 | Karta graficzna | 310 |

| Moduł pamięci DDR2 | 3 | Dysk twardy SSD | 7 |

| Monitor LCD | 80 | Dysk twardy 7200 obr./min | 16 |

| Wentylator | 5 | Dysk twardy 5400 obr./min | 12 |

| Mysz i klawiatura | 2 | Napęd optyczny | 30 |

Jakie informacje można uzyskać za pomocą polecenia uname -s w systemie Linux?

Urządzenie elektryczne lub elektroniczne, które zostało zużyte i posiada znak widoczny na ilustracji, powinno być

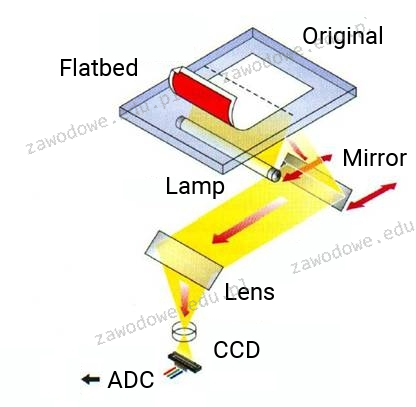

Jakie jest znaczenie jednostki dpi, która występuje w specyfikacjach skanerów i drukarek?

Zaprezentowany schemat ilustruje funkcjonowanie

Jaką jednostką określa się szybkość przesyłania danych w sieciach komputerowych?

W dokumentacji jednego z komponentów komputera zawarto informację, że urządzenie obsługuje OpenGL. Jakiego elementu dotyczy ta dokumentacja?

Który z poniższych protokołów służy do zarządzania urządzeniami w sieciach?

Jak określamy atak na sieć komputerową, który polega na łapaniu pakietów przesyłanych w sieci?

Który z interfejsów umożliwia transfer danych zarówno w formacie cyfrowym, jak i analogowym pomiędzy komputerem a wyświetlaczem?

Które wbudowane narzędzie systemu Windows pozwala rozwiązywać problemy z błędnymi sektorami i integralnością plików?