Pytanie 1

W warstwie łącza danych modelu odniesienia ISO/OSI możliwą przyczyną błędów działania lokalnej sieci komputerowej jest

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

W warstwie łącza danych modelu odniesienia ISO/OSI możliwą przyczyną błędów działania lokalnej sieci komputerowej jest

Kiedy w komórce arkusza MS Excel zamiast liczb wyświetlają się znaki ########, to przede wszystkim należy zweryfikować, czy

Narzędziem do monitorowania wydajności i niezawodności w systemach Windows 7, Windows Server 2008 R2 oraz Windows Vista jest

Do jednoczesnej zmiany tła pulpitu, kolorów okien, dźwięków oraz wygaszacza ekranu na komputerze z zainstalowanym systemem Windows należy wykorzystać

Analiza tłumienia w kablowym systemie przesyłowym umożliwia ustalenie

Który model pamięci RAM, można umieścić na płycie, której fragment specyfikacji przedstawiono na ilustracji?

| Pamięć | |

|---|---|

| Obsługiwana pamięć | DDR4 |

| Rodzaj obsługiwanej pamięci | DIMM (do PC) |

| Typ obsługiwanej pamięci | DDR4-2133 (PC4-17000) DDR4-2400 (PC4-19200) DDR4-2666 (PC4-21300) DDR4-2800 (PC4-22400) DDR4-3200 (PC4-25600) |

| Typ obsługiwanej pamięci OC | DDR4-3466 (PC4-27700) DDR4-3600 (PC4-28800) DDR4-3866 (PC4-30900) DDR4-4000 (PC4-32000) DDR4-4133 (PC4-33000) DDR4-4400 (PC4-35200) DDR4-4600 (PC4-36800) |

| Dwukanałowa obsługa pamięci | tak |

| Ilość gniazd pamięci | 4 szt. |

| Maks. pojemność pamięci | 128 GB |

Jakie narzędzie chroni komputer przed niechcianym oprogramowaniem pochodzącym z sieci?

Aby przeprowadzić aktualizację zainstalowanego systemu operacyjnego Linux Ubuntu, należy wykorzystać komendę

Który przyrząd należy wykorzystać do uzyskania wyników testu POST dla modułów płyty głównej?

W systemie Windows XP, aby zmienić typ systemu plików z FAT32 na NTFS, należy użyć programu

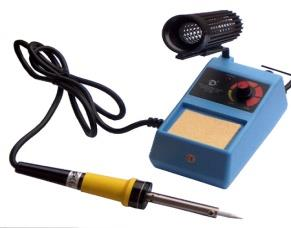

To narzędzie może być wykorzystane do

W dokumentacji systemu operacyjnego Windows XP opisano pliki o rozszerzeniu .dll. Czym jest ten plik?

Jakie polecenie systemu Windows przedstawione jest na ilustracji?

Adres fizyczny Nazwa transportu

===========================================================

00-23-AE-09-47-CF Nośnik rozłączony

00-23-4D-CB-B4-BB Brak

00-23-4D-CB-B4-BB Nośnik rozłączonyJakie urządzenie jest używane do pomiaru napięcia w zasilaczu?

Jaką technologię wykorzystuje się do uzyskania dostępu do Internetu oraz odbioru kanałów telewizyjnych w formie cyfrowej?

Jaki protokół posługuje się portami 20 oraz 21?

Jakie medium transmisyjne stosują myszki bluetooth do łączności z komputerem?

Jaką maksymalną liczbę kanałów z dostępnego pasma kanałów standardu 802.11b można stosować w Polsce?

Protokół ARP (Address Resolution Protocol) pozwala na przypisanie logicznych adresów warstwy sieciowej do rzeczywistych adresów warstwy

Pamięć oznaczona jako PC3200 nie jest kompatybilna z magistralą

Jak na diagramach sieciowych LAN oznaczane są punkty dystrybucyjne znajdujące się na różnych kondygnacjach budynku, zgodnie z normą PN-EN 50173?

Jaką maksymalną ilość GB pamięci RAM może obsłużyć 32-bitowa edycja systemu Windows?

Jak brzmi nazwa profilu użytkownika w systemie Windows, który jest zakładany podczas pierwszego logowania do komputera i zapisany na lokalnym dysku twardym, a wszelkie jego modyfikacje odnoszą się wyłącznie do maszyny, na której zostały przeprowadzone?

Jakie jednostki stosuje się do wyrażania przesłuchu zbliżonego NEXT?

Na ilustracji przedstawiono tylną stronę

Korzystając z polecenia taskmgr, użytkownik systemu Windows może

Który typ profilu użytkownika zmienia się i jest zapisywany na serwerze dla klienta działającego w sieci Windows?

Nieprawidłowa forma zapisu liczby 778 to

Co umożliwia zachowanie jednolitego rozkładu temperatury pomiędzy procesorem a radiatorem?

Kto jest odpowiedzialny za alokację czasu procesora dla konkretnych zadań?

Który program pozwoli na zarządzanie zasobami i czasem oraz stworzenie harmonogramu prac montażowych zgodnie z projektem sieci lokalnej w budynku?

Wskaż usługę, którą należy skonfigurować na serwerze aby blokować ruch sieciowy?

Który aplet w panelu sterowania systemu Windows 7 pozwala na ograniczenie czasu korzystania z komputera przez użytkownika?

Aplikacja komputerowa, która umożliwia zarządzanie plikami oraz folderami, to:

Jak wiele urządzeń może być podłączonych do interfejsu IEEE1394?

Jaką rolę odgrywa ISA Server w systemie operacyjnym Windows?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Aby poprawić niezawodność oraz efektywność przesyłania danych na serwerze, należy

Który z protokołów jest używany podczas rozpoczynania sesji VoIP?

Jaki typ routingu jest najbardziej odpowiedni w złożonych, szybko ewoluujących sieciach?