Pytanie 1

W dokumentacji skanera zapisano „rozdzielczość optyczna 600 x 600 [dpi]”. Skrót dpi określa liczbę punktów

Wynik: 39/40 punktów (97,5%)

Wymagane minimum: 20 punktów (50%)

W dokumentacji skanera zapisano „rozdzielczość optyczna 600 x 600 [dpi]”. Skrót dpi określa liczbę punktów

Prezentacja A, B, M jest charakterystyczna dla badania

W dokumencie urządzenia elektroniki medycznej podano następujące informacje:

Interfejs obrazu DICOM • Maksymalna szybkość przesyłania wg standardu Ethernet: 100 Mb/s. • Szybkość przesyłania obrazów: 2 MB/s. Interfejs RIS/CIS zgodny z DICOM • Maksymalna szybkość przesyłania wg standardu Ethernet: 100 Mb/s. |

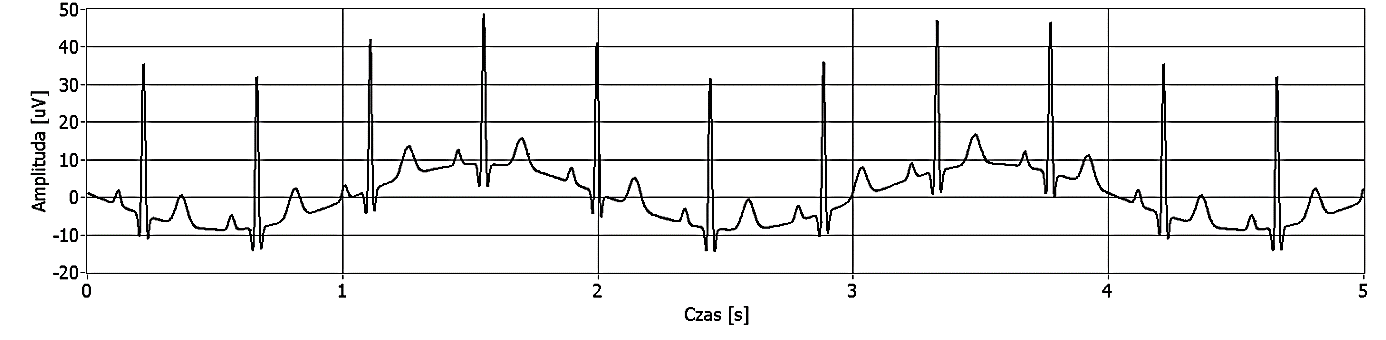

Z elektrokardiogramu wynika, że rytm serca rejestrowany i wskazywany przez elektrokardiograf wynosi

Którą metodę montażu należy zastosować w celu zakończenia przewodu zasilającego końcówkami przedstawionymi na fotografii?

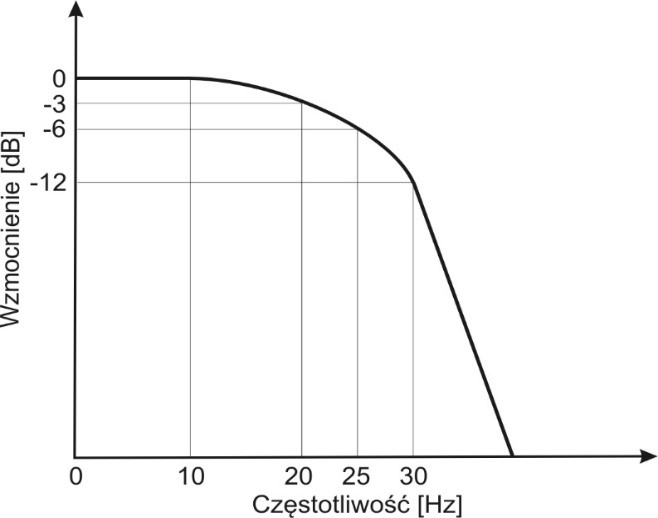

W urządzeniu medycznym wyznaczono charakterystykę filtru jak na rysunku. Jest to filtr

Który endoskop pozwala na badanie wnętrza tchawicy i oskrzeli?

Symbole: 1U, 2U, 3U stosowane do oznaczenia modułów w szafach typu rack określają

Które ustawienie należy wybrać na multimetrze w celu pomiaru napięcia 12 V w obwodzie prądu stałego?

Struktura anatomiczna człowieka, która jest nazywana krytyczną ze względu na szczególną wrażliwość na zewnętrzne promieniowanie jonizujące, to

Wysłanie obrazów z urządzenia diagnostycznego do serwera PACS odbywa się zgodnie ze standardem

Pod wpływem bodźca świetlnego, dźwiękowego lub czuciowego mózg generuje elektryczne potencjały wywołane rejestrowane przez

Do badania przewodnictwa powietrznego i kostnego służy

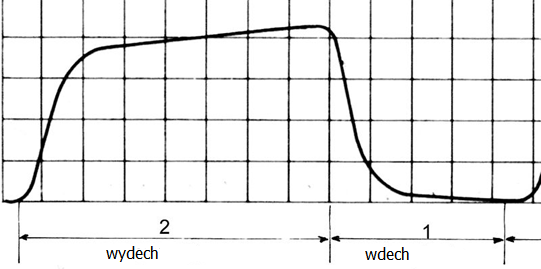

Stężenie którego gazu z wydychanego powietrza prezentuje kapnogram?

Aby system komputerowy współpracujący z ultrasonografem mógł nagrywać na jednej płycie DVD dane z kolejnych, wykonywanych na bieżąco badań, musi być wyposażony w nagrywanie

Materiałem eksploatacyjnym w drukarce laserowej jest

W dokumentacji elektrokardiografu znajduje się informacja o wyposażeniu aparatu w filtry cyfrowe 50 Hz, 35 Hz i filtr antydriftowy. Które zakłócenia eliminuje z sygnału EKG filtr 50 Hz?

Który rodzaj promieniowania jonizującego jest całkowicie pochłaniany przez naskórek, nie docierając do głębszych warstw tkanek?

Zabieg diametrii krótkofalowej powoduje

Zapis w dokumentacji technicznej elektrokardiografu określający V1, V2, …V6 dotyczy odprowadzeń

Jak nazywa się terapia stosowana w przypadku niewydolności nerek, polegająca na oczyszczaniu krwi ze zbędnych składników przemiany materii?

Który podzespół komputerowy posiada obudowę o zamieszczonej specyfikacji?

| Specyfikacja obudowy | |

|---|---|

| Obsługiwane gniazda | LGA775 |

| TCASE | 71,4°C |

| Wymiary obudowy | 37,5 mm x 37,5 mm |

| Rozmiar płytki półprzewodnikowej | 214 mm² |

| Liczba tranzystorów płytki półprzewodnikowej | 820 milion |

| Dostępne opcje obniżonej zawartości halogenków | Patrz MDDS |

Membrana półprzepuszczalna jest podstawowym elementem

Do pomiaru objętości i pojemności płuc w różnych fazach cyklu oddechowego służy

Technologia OLED znajduje zastosowanie w

Narzędzie przedstawione na rysunku służy do

Urządzenie, które w specyfikacji technicznej posiada zapis: „Urządzenie współpracuje z komputerem klasy PC poprzez złącze USB”, należy podłączyć do złącza oznaczonego piktogramem

W tabeli przedstawiono fragment dokumentacji testera

| Zakres | ±500 mm Hg 20 °C |

| Dokładność | ±1% odczytu + 0.5 mm Hg) |

| Zakres | 80, 94 bpm (synch. z EKG) |

| Dokładność sygnału | ±1% |

| Inwazyjne: | |

| Statyczne ciśnienie | -10, -5, 0, 20, 40, 50, 60, 80, 100, 150, 160, 200, 240, 250, 300, 320, 400 mm Hg |

| Dokładność | ±(1% zakresu ±1mm Hg) or ±(2% nastawy + 2mm Hg) |

| Impedancja | 300 Ohm (±10% dokładności) |

| Czułość | 5 do 40 μV/V/mm Hg |

Jaki wpływ na organizm ludzki ma promieniowanie podczerwone IR?

Fale mózgowe alfa, beta, gamma, delta i theta są rejestrowane w

Urządzenie przedstawione na rysunku jest przeznaczone do

Podstawowym elementem sztucznej nerki jest pompa do przetłaczania krwi, zwana

Zasilacz, który podczas normalnej pracy zasila urządzenie, jednocześnie ładując akumulator, a podczas awarii zasilania sieciowego zasila urządzenie z akumulatora, oznaczany jest skrótem

Przepływ przez organizm człowieka prądów o wysokiej częstotliwości, mających zastosowanie w elektrochirurgii, może powodować

Sterowniki klawiatury, magistral i przerwań są elementami

Urządzenie, którego dotyczy fragment podanej specyfikacji, jest przystosowane do

| ■ Architektura sieci LAN: | Wireless IEEE 802.11ac, Wireless IEEE 802.11a, Wireless IEEE 802.11b, Wireless IEEE 802.11g, Wireless IEEE 802.11n |

| ■ Dodatkowe informacje: | PoE, RJ-45 Serial |

| ■ Typ urządzenia: | Bezprzewodowy kontroler |

| ■ Typ złącza anteny zewnętrznej: | 3x3 MIMO |

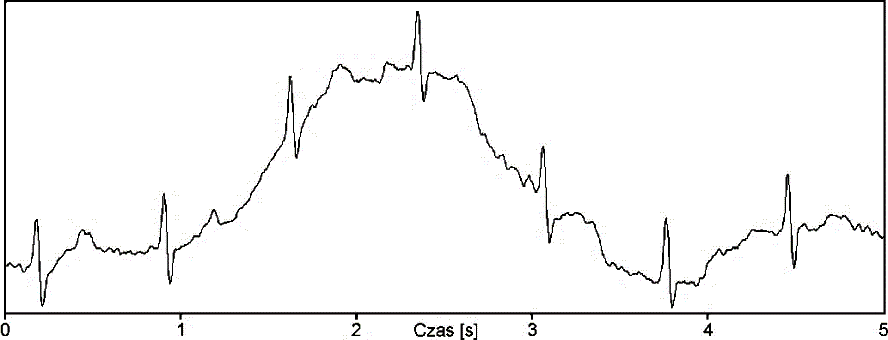

Podczas testowania elektrokardiografu otrzymano przedstawiony przebieg. Na jego podstawie stwierdzono, że nieprawidłowo działa filtr zakłóceń

Urządzenie do rejestracji bioelektrycznych potencjałów mięśniowych to

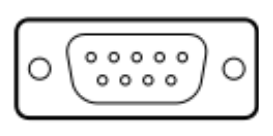

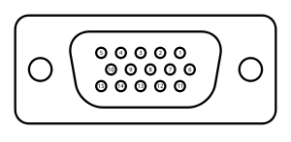

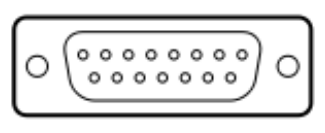

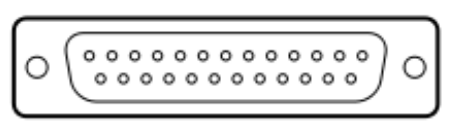

Zgodnie z przedstawionym opisem, gniazdo interfejsu służące do podłączenia audiometru ze stanowiskiem komputerowym przedstawione jest na rysunku

| Opis: |

| − 125 Hz ÷ 8.000 Hz − -10 dB do 120 dB HL na wyjściu − połączenie z komputerem PC – interfejs RS232 − połączenie z drukarką laserową − połączenie z drukarką atramentową |

Moduł EKG do badań wysiłkowych został wyposażony w interfejs Bluetooth w celu przesyłania wyników badań. Aby połączyć moduł z stanowiskiem komputerowym, należy wybrać interfejs oznaczony symbolem