Pytanie 1

Poleceniem systemu Linux służącym do wyświetlenia informacji, zawierających aktualną godzinę, czas działania systemu oraz liczbę zalogowanych użytkowników, jest

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Poleceniem systemu Linux służącym do wyświetlenia informacji, zawierających aktualną godzinę, czas działania systemu oraz liczbę zalogowanych użytkowników, jest

Gdy użytkownik zauważy, że ważne pliki zniknęły z dysku twardego, powinien

Zgodnie z normą PN-EN 50173, minimalna liczba punktów rozdzielczych, które należy zainstalować, wynosi

Jak nazywa się metoda dostępu do medium transmisyjnego z detekcją kolizji w sieciach LAN?

Jaka jest maksymalna liczba komputerów, które mogą być zaadresowane w podsieci z adresem 192.168.1.0/25?

Usługa, umożliwiająca zdalną pracę na komputerze z systemem Windows z innego komputera z systemem Windows, który jest połączony z tą samą siecią lub z Internetem, to

Symbol umieszczony na obudowie komputera stacjonarnego informuje o zagrożeniu przed

Jakiego typu rozbudowa serwera wymaga zainstalowania dodatkowych sterowników?

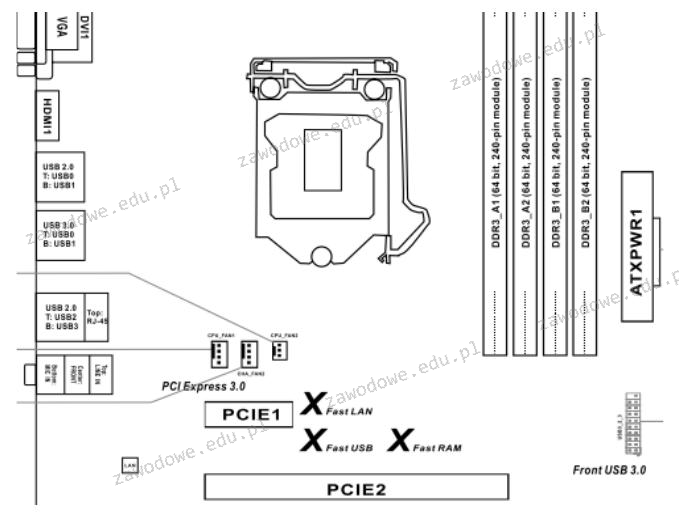

Na wskazanej płycie głównej możliwe jest zainstalowanie procesora w obudowie typu

Jak wygląda liczba 51210) w systemie binarnym?

Przy realizacji projektu dotyczącego sieci LAN wykorzystano medium transmisyjne standardu Ethernet 1000Base-T. Które z poniższych stwierdzeń jest prawdziwe?

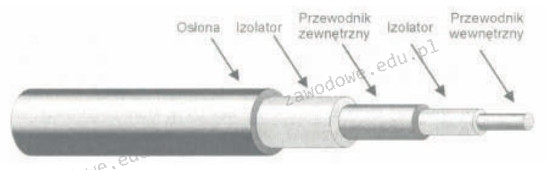

Na ilustracji przedstawiono przekrój kabla

Aby wymusić na użytkownikach lokalnych systemów z rodziny Windows Server regularną zmianę haseł oraz stosowanie haseł o odpowiedniej długości, które spełniają kryteria złożoności, należy ustawić

Jakie parametry mierzy watomierz?

Na diagramie przedstawione są symbole

Zidentyfikowanie głównego rekordu rozruchowego, który uruchamia system z aktywnej partycji, jest możliwe dzięki

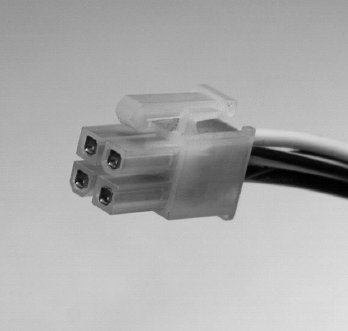

Wtyczka zaprezentowana na fotografie stanowi element obwodu elektrycznego zasilającego

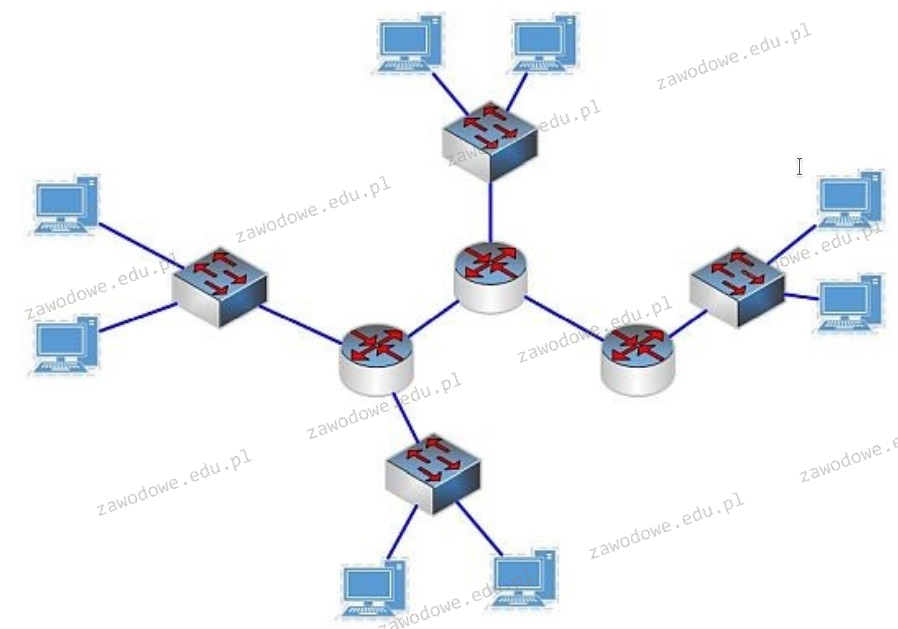

Jaki rodzaj fizycznej topologii w sieciach komputerowych jest pokazany na ilustracji?

Aby uniknąć różnic w kolorystyce pomiędzy zeskanowanymi zdjęciami na wyświetlaczu komputera a ich oryginałami, konieczne jest przeprowadzenie

Urządzenie z funkcją Plug and Play, które zostało ponownie podłączone do komputera, jest identyfikowane na podstawie

Trudności w systemie operacyjnym Windows wynikające z konfliktów dotyczących zasobów sprzętowych, takich jak przydział pamięci, przerwań IRQ oraz kanałów DMA, najłatwiej zidentyfikować za pomocą narzędzia

Jaką maksymalną ilość rzeczywistych danych można przesłać w ciągu 1 sekundy przez łącze synchroniczne o wydajności 512 kbps, bez użycia sprzętowej i programowej kompresji?

Obecnie pamięci podręczne drugiego poziomu procesora (ang. "L-2 cache") są zbudowane z układów pamięci

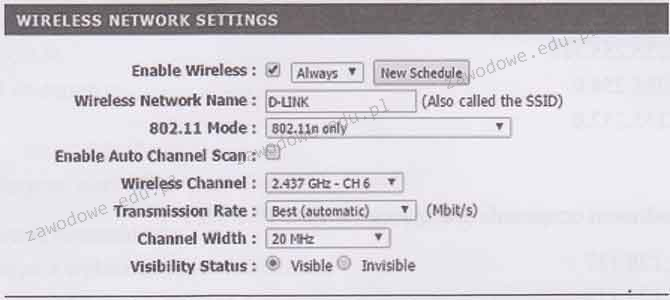

Który z parametrów w ustawieniach punktu dostępowego działa jako login używany podczas próby połączenia z punktem dostępowym w sieci bezprzewodowej?

Który z parametrów w poleceniu ipconfig w systemie Windows służy do odnawiania konfiguracji adresów IP?

Który z podanych adresów IP v.4 należy do klasy C?

Który z protokołów nie działa w warstwie aplikacji modelu ISO/OSI?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Aby przywrócić dane, które zostały usunięte dzięki kombinacji klawiszy Shift+Delete, trzeba

Która z poniższych form zapisu liczby 77(8) jest nieprawidłowa?

W systemie binarnym liczba 51(10) przyjmuje formę

Która z licencji pozwala każdemu użytkownikowi na wykorzystywanie programu bez ograniczeń związanych z prawami autorskimi?

SuperPi to aplikacja używana do testowania

Jaki typ zabezpieczeń w sieciach WiFi oferuje najwyższy poziom ochrony?

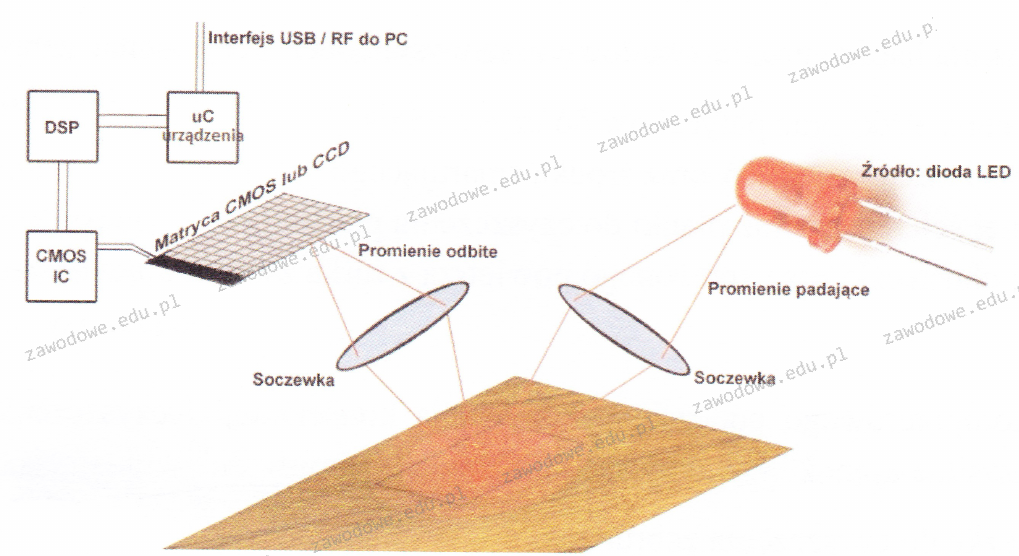

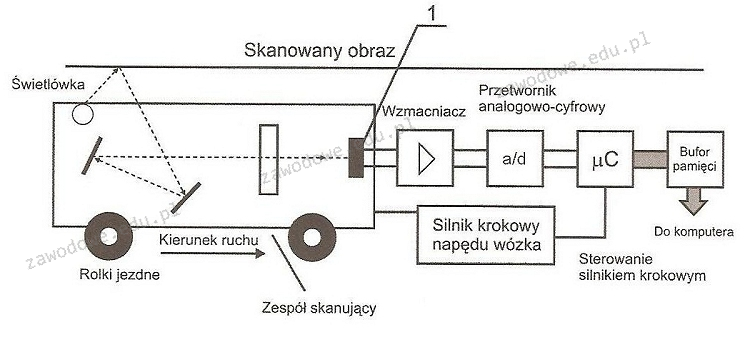

Zilustrowany schemat przedstawia zasadę funkcjonowania

Protokół SNMP (Simple Network Management Protocol) jest wykorzystywany do

W systemie Windows 7 program Cipher.exe w trybie poleceń jest używany do

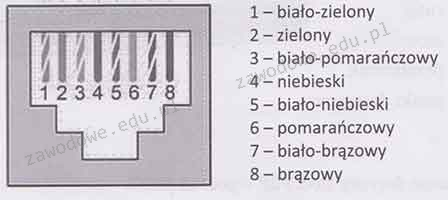

Który typ standardu zakończenia kabla w systemie okablowania strukturalnego ilustruje przedstawiony rysunek?

Na diagramie działania skanera, element oznaczony numerem 1 odpowiada za

Na wydruku z drukarki laserowej występują jasne i ciemne fragmenty. Jakie działania należy podjąć, by poprawić jakość druku oraz usunąć problemy z nieciągłością?