Pytanie 1

Jaką maskę podsieci powinien mieć serwer DHCP, aby mógł przydzielić adresy IP dla 510 urządzeń w sieci o adresie 192.168.0.0?

Wynik: 6/40 punktów (15,0%)

Wymagane minimum: 20 punktów (50%)

Jaką maskę podsieci powinien mieć serwer DHCP, aby mógł przydzielić adresy IP dla 510 urządzeń w sieci o adresie 192.168.0.0?

Sieci lokalne o architekturze klient-serwer cechują się tym, że

Aby uzyskać na ekranie monitora odświeżanie obrazu 85 razy w ciągu sekundy, trzeba częstotliwość jego odświeżania ustawić na

Jaki będzie rezultat odejmowania dwóch liczb zapisanych w systemie heksadecymalnym 60Ah - 3BFh?

Jakim parametrem definiuje się stopień zmniejszenia mocy sygnału w danej parze przewodów po przejściu przez cały tor kablowy?

Administrator pragnie udostępnić w sieci folder C:instrukcje trzem użytkownikom z grupy Serwisanci. Jakie rozwiązanie powinien wybrać?

Zarządzanie pasmem (ang. bandwidth control) w switchu to funkcjonalność

Który port stosowany jest przez protokół FTP (File Transfer Protocol) do przesyłania danych?

Jaki protokół służy komputerom do informowania rutera o przynależności do konkretnej grupy multicastowej?

Użytkownicy sieci Wi-Fi zauważyli zakłócenia oraz częste przerwy w połączeniu. Przyczyną tej sytuacji może być

Aby zrealizować usługę zdalnego uruchamiania systemów operacyjnych na komputerach stacjonarnych, należy w Windows Server zainstalować rolę

Switch sieciowy w standardzie Fast Ethernet pozwala na przesył danych z maksymalną prędkością

Programem wiersza poleceń w systemie Windows, który umożliwia kompresję oraz dekompresję plików i folderów, jest aplikacja

Brak odpowiedzi na to pytanie.

Jaka usługa, opracowana przez firmę Microsoft, pozwala na konwersję nazw komputerów na adresy URL?

Brak odpowiedzi na to pytanie.

Na ilustracji widać

Brak odpowiedzi na to pytanie.

Optyczna rozdzielczość to jeden z właściwych parametrów

Brak odpowiedzi na to pytanie.

Aby w systemie Windows XP stworzyć nowego użytkownika o nazwisku egzamin z hasłem qwerty, powinno się zastosować polecenie

Brak odpowiedzi na to pytanie.

Jaki adres IP został przypisany do hosta na interfejsie sieciowym eth0?

[root@ipv6 tspc]# ifconfig

eth0 Link encap:Ethernet HWaddr 00:A0:C9:89:02:F8

inet addr:128.171.104.26 Bcast:128.171.104.255 Mask:255.255.255.0

inet6 addr: fe80::2a0:c9ff:fe89:2f8/10 Scope:Link

UP BROADCAST RUNNING MULTICAST MTU:1500 Metric:1

RX packets:663940 errors:0 dropped:0 overruns:0 frame:0

TX packets:67717 errors:0 dropped:0 overruns:0 carrier:0

collisions:7797 txqueuelen:100

RX bytes:234400485 (223.5 Mb) TX bytes:17743338 (16.9 Mb)

Interrupt:10 Base address:0xef80

lo Link encap:Local Loopback

inet addr:127.0.0.1 Mask:255.0.0.0

inet6 addr: ::1/128 Scope:Host

UP LOOPBACK RUNNING MTU:16436 Metric:1

RX packets:3070 errors:0 dropped:0 overruns:0 frame:0

TX packets:3070 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:0

RX bytes:153813 (150.2 Kb) TX bytes:153813 (150.2 Kb)

sit1 Link encap:IPv6-in-IPv4

inet6 addr: 3ffe:b80:2:482::2/64 Scope:Global

inet6 addr: fe80::80ab:681a/10 Scope:Link

UP POINTOPOINT RUNNING NOARP MTU:1480 Metric:1

RX packets:82 errors:0 dropped:0 overruns:0 frame:0

TX packets:78 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:0

RX bytes:8921 (8.7 Kb) TX bytes:8607 (8.4 Kb)Brak odpowiedzi na to pytanie.

Jakie składniki systemu komputerowego wymagają utylizacji w wyspecjalizowanych zakładach przetwarzania z powodu obecności niebezpiecznych substancji lub pierwiastków chemicznych?

Brak odpowiedzi na to pytanie.

Jaka usługa musi być aktywna na serwerze, aby stacja robocza mogła automatycznie uzyskać adres IP?

Brak odpowiedzi na to pytanie.

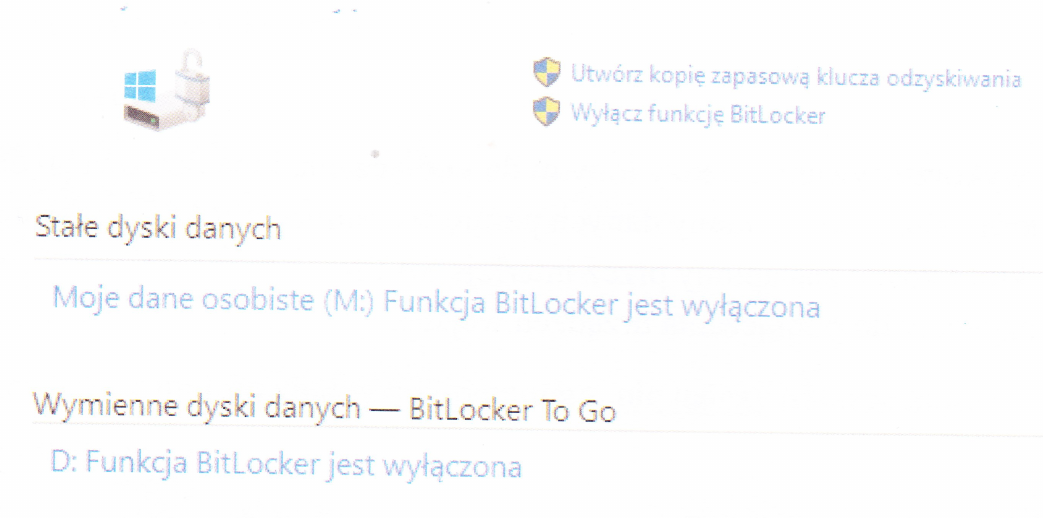

Wbudowane narzędzie dostępne w systemach Windows w edycji Enterprise lub Ultimate jest przeznaczone do

Brak odpowiedzi na to pytanie.

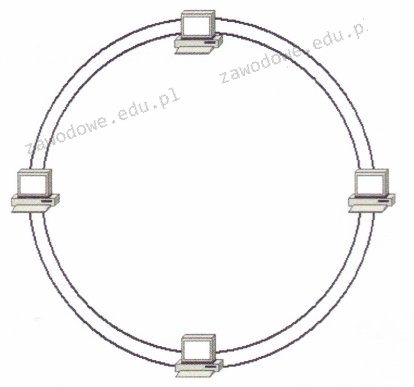

Jaką topologię fizyczną sieci komputerowej przedstawia rysunek?

Brak odpowiedzi na to pytanie.

Który element pasywny sieci powinien być użyty do połączenia okablowania ze wszystkich gniazd abonenckich z panelem krosowniczym umieszczonym w szafie rack?

Brak odpowiedzi na to pytanie.

NIEWŁAŚCIWE podłączenie taśmy sygnałowej do napędu dyskietek skutkuje

Brak odpowiedzi na to pytanie.

Który instrument służy do pomiaru długości oraz tłumienności przewodów miedzianych?

Brak odpowiedzi na to pytanie.

Aktywacja opcji OCR w procesie ustawiania skanera umożliwia

Brak odpowiedzi na to pytanie.

Osoba planuje unowocześnić swój komputer poprzez zwiększenie pamięci RAM. Zainstalowana płyta główna ma specyfikacje przedstawione w tabeli. Wybierając dodatkowe moduły pamięci, powinien pamiętać, aby

| Parametry płyty głównej | |

|---|---|

| Model | H97 Pro4 |

| Typ gniazda procesora | Socket LGA 1150 |

| Obsługiwane procesory | Intel Core i7, Intel Core i5, Intel Core i3, Intel Pentium, Intel Celeron |

| Chipset | Intel H97 |

| Pamięć | 4 x DDR3- 1600 / 1333/ 1066 MHz, max 32 GB, ECC, niebuforowana |

| Porty kart rozszerzeń | 1 x PCI Express 3.0 x16, 3 x PCI Express x1, 2 x PCI |

Brak odpowiedzi na to pytanie.

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Brak odpowiedzi na to pytanie.

Do czego służy narzędzie 'ping' w sieciach komputerowych?

Brak odpowiedzi na to pytanie.

Urządzeniem, które przekształca otrzymane ramki w sygnały przesyłane później w sieci komputerowej, jest

Brak odpowiedzi na to pytanie.

Jakie zabezpieczenie w dokumentacji technicznej określa mechanizm zasilacza komputerowego zapobiegający przegrzaniu urządzenia?

Brak odpowiedzi na to pytanie.

Podaj domyślny port używany do przesyłania poleceń w serwerze FTP

Brak odpowiedzi na to pytanie.

Instalacja systemów Linux oraz Windows 7 przebiegła bez żadnych problemów. Systemy zainstalowały się poprawnie z domyślnymi ustawieniami. Na tym samym komputerze, przy tej samej konfiguracji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

Brak odpowiedzi na to pytanie.

Jakie urządzenie sieciowe jest niezbędne do połączenia kilku segmentów sieci lokalnej w jedną całość?

Brak odpowiedzi na to pytanie.

Którym poleceniem można skonfigurować uprawnienia do zasobów sieciowych w systemie Windows?

Brak odpowiedzi na to pytanie.

Do obserwacji stanu urządzeń w sieci wykorzystywane jest oprogramowanie operujące na podstawie protokołu

Brak odpowiedzi na to pytanie.

Jaką liczbę punktów abonenckich (2 x RJ45) zgodnie z wytycznymi normy PN-EN 50167 powinno się zainstalować w biurze o powierzchni 49 m2?

Brak odpowiedzi na to pytanie.

Która usługa opracowana przez Microsoft, pozwala na konwersję nazw komputerów na adresy URL?

Brak odpowiedzi na to pytanie.

Jakie znaczenie ma skrót MBR w kontekście technologii komputerowej?

Brak odpowiedzi na to pytanie.

Po dokonaniu eksportu klucza HKCU stworzona zostanie kopia rejestru zawierająca dane o konfiguracji

Brak odpowiedzi na to pytanie.