Pytanie 1

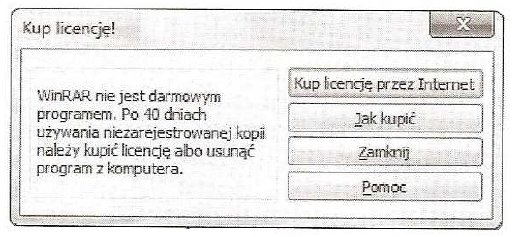

Program WinRaR pokazał okno informacyjne przedstawione na ilustracji. Jakiego rodzaju licencję na oprogramowanie użytkownik stosował do tej pory?

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Program WinRaR pokazał okno informacyjne przedstawione na ilustracji. Jakiego rodzaju licencję na oprogramowanie użytkownik stosował do tej pory?

Jakim protokołem łączności, który gwarantuje pewne dostarczenie informacji, jest protokół

Po podłączeniu działającej klawiatury do któregokolwiek z portów USB nie ma możliwości wyboru awaryjnego trybu uruchamiania systemu Windows. Jednakże, klawiatura funkcjonuje prawidłowo po uruchomieniu systemu w standardowym trybie. Co to sugeruje?

Tryb użytkownika w przełączniku CISCO (User EXEC Mode) umożliwia

Administrator systemu Linux wyświetlił zawartość katalogu /home/szkola w terminalu, uzyskując następujący rezultat: -rwx --x r-x 1 admin admin 25 04-09 15:17 szkola.txt. Następnie wydał polecenie

chmod ug=rw szkola.txt | lsJaki będzie rezultat tego działania, pokazany w oknie terminala?

Jaką topologię fizyczną sieci komputerowej przedstawia załączony rysunek?

Narzędzie System Image Recovery dostępne w zaawansowanych opcjach uruchamiania systemu Windows 7 pozwala na

Zarządzaniem drukarkami w sieci, obsługiwaniem zadań drukowania oraz przyznawaniem uprawnień do drukarek zajmuje się serwer

Jakie urządzenie w warstwie łącza danych modelu OSI analizuje adresy MAC zawarte w ramkach Ethernet i na tej podstawie decyduje o przesyłaniu sygnału pomiędzy segmentami sieci lub jego blokowaniu?

Po zainstalowaniu systemu Linux, użytkownik pragnie skonfigurować kartę sieciową poprzez wprowadzenie ustawień dotyczących sieci. Jakie działanie należy podjąć, aby to osiągnąć?

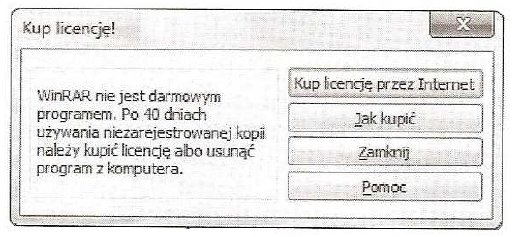

Na podstawie przedstawionej na ilustracji konfiguracji, w przypadku, gdy komputer żąda połączenia z inną siecią, w pierwszej kolejności dane zostaną wysłane do urządzenia o adresie

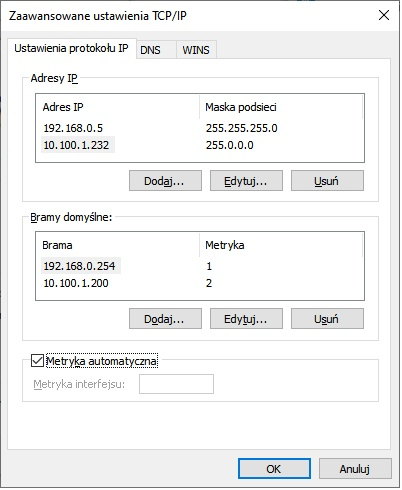

Jakie narzędzie wykorzystuje się do przytwierdzania kabla w module Keystone?

Protokół transportowy bez połączenia w modelu ISO/OSI to

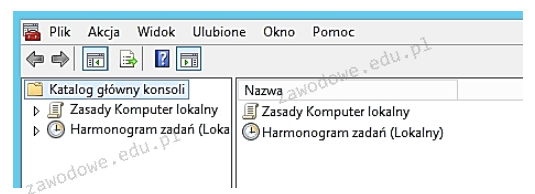

Aby otworzyć konsolę przedstawioną na ilustracji, należy wpisać w oknie poleceń

Funkcja diff w systemie Linux pozwala na

Programem służącym do archiwizacji danych w systemie Linux jest

Jaki typ rozbudowy serwera wymaga zainstalowania dodatkowych sterowników?

Ile bajtów odpowiada jednemu terabajtowi?

Jakie protokoły pełnią rolę w warstwie transportowej modelu ISO/OSI?

Program firewall nie zapewnia ochrony przed

Jakie urządzenie ma za zadanie utrwalenie tonera na papierze w trakcie drukowania z drukarki laserowej?

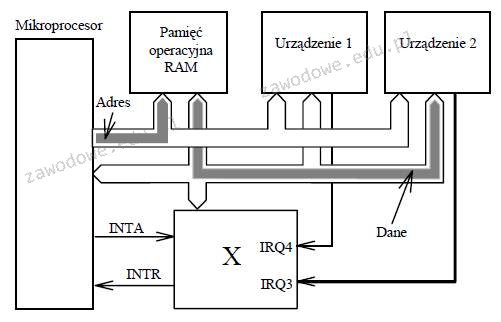

Na przedstawionym schemacie blokowym fragmentu systemu mikroprocesorowego, co oznacza symbol X?

Na przedstawionym panelu tylnym płyty głównej znajdują się między innymi następujące interfejsy:

Na ilustracji widać

W jakiej warstwie modelu ISO/OSI wykorzystywane są adresy logiczne?

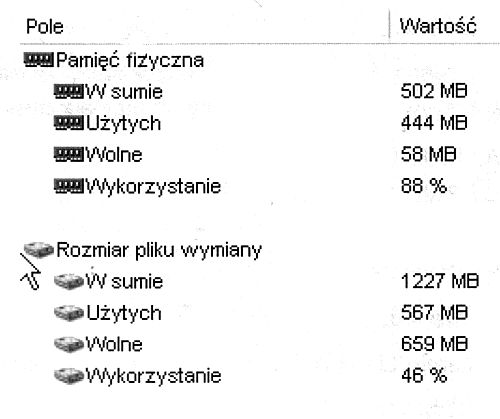

Zgodnie z zamieszczonym fragmentem testu w systemie komputerowym zainstalowane są

Symbol "LGA 775" obecny w dokumentacji technicznej płyty głównej wskazuje na typ gniazda dla procesorów:

Program "VirtualPC", dostępny do pobrania z witryny Microsoft, jest przeznaczony do korzystania:

Komunikat "BIOS checksum error" pojawiający się w trakcie startu komputera zazwyczaj wskazuje na

Programy antywirusowe mogą efektywnie zabezpieczać komputer. Istotne jest, aby wybrać możliwość uruchamiania aplikacji razem z komputerem oraz opcję

Jak nazywa się pamięć podręczną procesora?

Kabel pokazany na ilustracji może być zastosowany do realizacji okablowania sieci o standardzie

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Z jakiej puli adresowej usługa APIPA przypisuje adres IP dla komputera z systemem Windows, jeśli w sieci nie funkcjonuje serwer DHCP?

Liczba \( 10_{D} \) w systemie uzupełnień do dwóch jest równa

Ile par kabli jest używanych w standardzie 100Base-TX do obustronnej transmisji danych?

Jakie urządzenie w warstwie łącza danych modelu OSI analizuje adresy MAC zawarte w ramkach Ethernet i na tej podstawie decyduje o przesyłaniu sygnału między segmentami sieci lub jego blokowaniu?

W którym modelu płyty głównej można zamontować procesor o podanych parametrach?

| Intel Core i7-4790 3,6 GHz 8MB cache s. 1150 Box |

Które stwierdzenie odnoszące się do ruterów jest prawdziwe?

Czym jest kopia różnicowa?