Pytanie 1

System S.M.A.R.T jest stworzony do kontrolowania działania i identyfikacji usterek

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

System S.M.A.R.T jest stworzony do kontrolowania działania i identyfikacji usterek

Zgodnie z wytycznymi dotyczącymi karty graficznej, jej możliwości pracy z systemem AGP 2X/4X pozwalają na

Której aplikacji należy użyć, aby sprawdzić parametry S.M.A.R.T.?

Jakie polecenie w terminalu systemu operacyjnego Microsoft Windows umożliwi wyświetlenie szczegółów wszystkich zasobów udostępnionych na komputerze lokalnym?

Który z poniższych programów nie jest wykorzystywany do zdalnego administrowania komputerami w sieci?

Jakie urządzenie powinno zostać wykorzystane do podłączenia komputerów, aby mogły funkcjonować w odrębnych domenach rozgłoszeniowych?

Jakie polecenie służy do przeprowadzania aktualizacji systemu operacyjnego Linux korzystającego z baz RPM?

Jaką długość ma adres IP wersji 4?

Które z poniższych twierdzeń na temat protokołu DHCP jest poprawne?

Zjawisko, w którym pliki przechowywane na dysku twardym są zapisywane w klastrach, które nie sąsiadują ze sobą, określane jest mianem

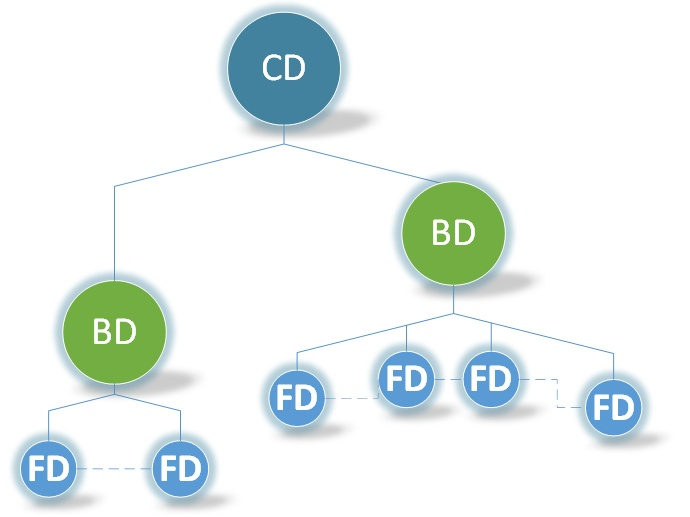

Przedstawiony schemat sieci kampusowej zawiera

Najmniejszymi kątami widzenia charakteryzują się matryce monitorów typu

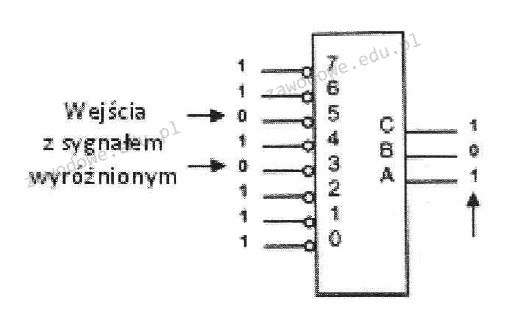

Na ilustracji przedstawiono symbol urządzenia cyfrowego

Jakim sposobem zapisuje się dane na nośnikach BD-R?

Jakie jest główne zadanie systemu DNS w sieci komputerowej?

Który rodzaj pracy Access Pointa jest używany, aby umożliwić urządzeniom bezprzewodowym dostęp do przewodowej sieci LAN?

W systemie Linux plik posiada uprawnienia ustawione na 541. Właściciel ma możliwość pliku

Jak nazywa się standard podstawki procesora bez nóżek?

Jaki jest główny cel stosowania maski podsieci?

W systemie Windows dany użytkownik oraz wszystkie grupy, do których on przynależy, posiadają uprawnienia "odczyt" do folderu XYZ. Czy ten użytkownik będzie mógł zrealizować operacje

Jak nazywa się protokół bazujący na architekturze klient-serwer oraz na modelu żądanie-odpowiedź, który jest używany do transferu plików?

Zapis liczby w systemie oznaczonym jako #108 to

W sieciach bezprzewodowych Ad-Hoc (Independent Basic Service Set) wykorzystywana jest fizyczna struktura

Określenie najlepszej trasy dla połączenia w sieci to

Która z poniższych topologii sieciowych charakteryzuje się centralnym węzłem, do którego podłączone są wszystkie inne urządzenia?

Materiałem eksploatacyjnym stosowanym w drukarkach tekstylnych jest

Jaki protokół jest używany przez komendę ping?

Aby poprawić bezpieczeństwo prywatnych danych sesji na stronie internetowej, zaleca się dezaktywację w ustawieniach przeglądarki

Aby zapobiegać i eliminować szkodliwe oprogramowanie, takie jak exploity, robaki oraz trojany, konieczne jest zainstalowanie oprogramowania

Który z standardów implementacji sieci Ethernet określa sieć opartą na kablu koncentrycznym, gdzie długość segmentu nie może przekraczać 185 m?

Aby osiągnąć wysoką jakość połączeń głosowych VoIP kosztem innych przesyłanych informacji, konieczne jest włączenie i skonfigurowanie na routerze usługi

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W trakcie użytkowania przewodowej myszy optycznej wskaźnik nie reaguje na ruch urządzenia po podkładce, a kursor zmienia swoje położenie dopiero po właściwym ustawieniu myszy. Te symptomy sugerują uszkodzenie

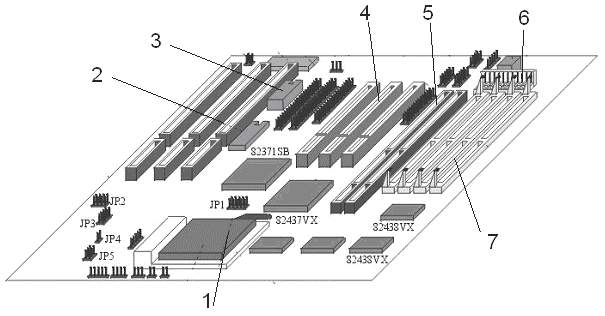

Na schemacie przedstawionej płyty głównej zasilanie powinno być podłączone do gniazda oznaczonego numerem

Który z poniższych zapisów stanowi właściwy adres w wersji IPv6?

Płyta główna z gniazdem G2 będzie kompatybilna z procesorem

W pierwszym oktecie adresów IPv4 klasy B znajdują się liczby mieszczące się w przedziale

Jakiego rodzaju plik należy stworzyć w systemie operacyjnym, aby zautomatyzować rutynowe działania, takie jak kopiowanie lub tworzenie plików oraz folderów?

Karta sieciowa przedstawiona na ilustracji jest w stanie przesyłać dane z maksymalną szybkością

Które z urządzeń może powodować wzrost liczby kolizji pakietów w sieci?