Pytanie 1

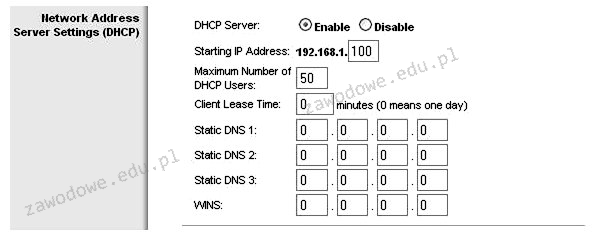

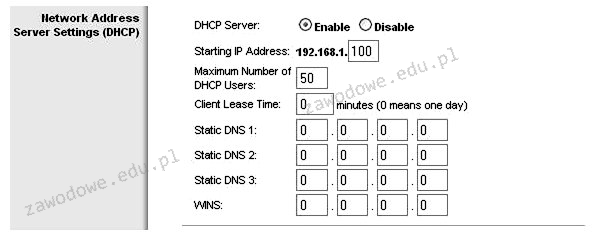

Ilustracja pokazuje panel ustawień bezprzewodowego urządzenia dostępowego, który umożliwia

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Ilustracja pokazuje panel ustawień bezprzewodowego urządzenia dostępowego, który umożliwia

W celu zainstalowania systemu openSUSE oraz dostosowania jego ustawień, można skorzystać z narzędzia

Jakie protokoły pełnią rolę w warstwie transportowej modelu ISO/OSI?

Watomierz jest stosowany do pomiaru

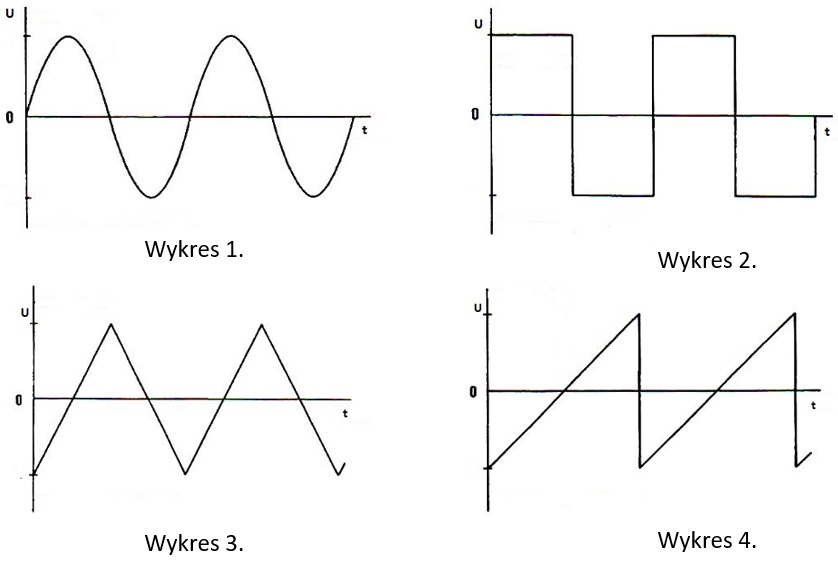

Na którym wykresie przedstawiono przebieg piłokształtny?

Czynnikiem zagrażającym bezpieczeństwu systemu operacyjnego, który zmusza go do automatycznej aktualizacji, są

Jakie rozwiązanie techniczne pozwala na transmisję danych z szybkością 1 Gb/s z zastosowaniem światłowodu?

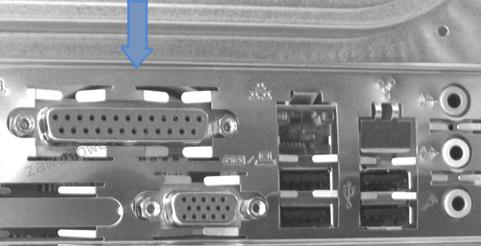

Na ilustracji, strzałka wskazuje na złącze interfejsu

Jakim symbolem powinien być oznaczony sprzęt komputerowy, aby spełniał wymogi prawne konieczne do sprzedaży w Unii Europejskiej?

Jaką funkcjonalność oferuje program tar?

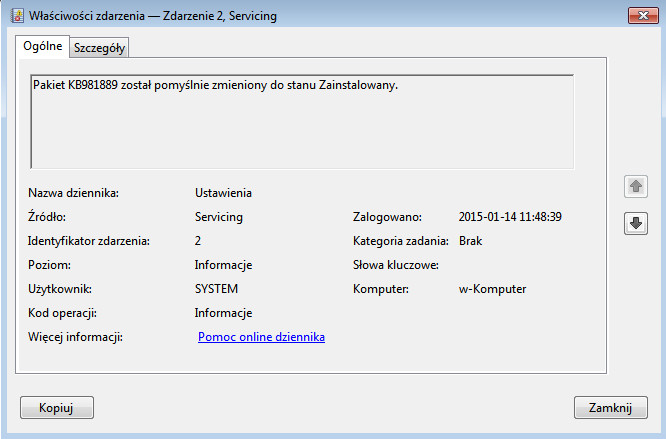

Wpis w dzienniku zdarzeń przedstawiony na ilustracji należy zakwalifikować do zdarzeń typu

Protokół stosowany w sieciach komputerowych do zarządzania zdalnym terminalem w modelu klient-serwer, który nie gwarantuje bezpieczeństwa przekazywanych danych i funkcjonuje tylko w formacie tekstowym, to

Które urządzenie może zostać wykorzystane do rutowania ruchu sieciowego między sieciami VLAN?

Jak nazywa się metoda dostępu do medium transmisyjnego z detekcją kolizji w sieciach LAN?

Protokół ARP (Address Resolution Protocol) pozwala na przypisanie logicznych adresów warstwy sieciowej do rzeczywistych adresów warstwy

Wskaż nazwę modelu przechowywania i przetwarzania danych opartego na użytkowaniu zasobów dyskowych, obliczeniowych i programowych, udostępnionych przez usługodawcę za pomocą sieci komputerowej.

Przedstawione narzędzie podczas naprawy zestawu komputerowego przeznaczone jest do

Jak należy rozmieszczać gniazda komputerowe RJ45 w odniesieniu do przestrzeni biurowej zgodnie z normą PN-EN 50174?

Który z poniższych systemów operacyjnych jest systemem typu open-source?

W systemach operacyjnych z rodziny Windows odpowiednikiem programu fsck z systemu Linux jest aplikacja

Jakie polecenie w systemie operacyjnym Windows służy do wyświetlenia konfiguracji interfejsów sieciowych?

Jakie polecenie należy zastosować, aby zamontować pierwszą partycję logiczną dysku primary slave w systemie Linux?

Komputer powinien działać jako serwer w sieci lokalnej, umożliwiając innym komputerom dostęp do Internetu poprzez podłączenie do gniazda sieci rozległej za pomocą kabla UTP Cat 5e. Na chwilę obecną komputer jest jedynie połączony ze switchem sieci lokalnej również kablem UTP Cat 5e oraz nie dysponuje innymi portami 8P8C. Jakiego komponentu musi on koniecznie nabrać?

Liczba szesnastkowa 1E2F₍₁₆₎ zapisana w systemie ósemkowym ma postać

Do zainstalowania serwera proxy w systemie Linux, konieczne jest zainstalowanie aplikacji

Jakie zakresy adresów IPv4 mogą być używane jako adresy prywatne w lokalnej sieci?

Urządzenie pokazane na ilustracji służy do zgrzewania wtyków

Urządzenie sieciowe funkcjonujące w trzeciej warstwie modelu ISO/OSI, posługujące się adresami IP, to

Długi oraz dwa krótkie dźwięki sygnałowe BIOS POST od AMI i AWARD sygnalizują problem

Jaki rodzaj routingu jest najbardziej odpowiedni w dużych, szybko zmieniających się sieciach?

Jaki będzie wynik operacji odejmowania dwóch liczb szesnastkowych: 60Aₕ – 3BFₕ?

Gdy chce się, aby jedynie wybrane urządzenia mogły uzyskiwać dostęp do sieci WiFi, należy w punkcie dostępowym

Jakie polecenie w systemie Linux jest potrzebne do stworzenia archiwum danych?

Jak nazywa się protokół, który pozwala na ściąganie wiadomości e-mail z serwera?

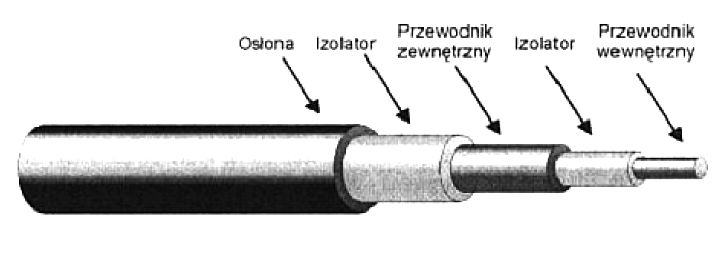

Na ilustracji pokazano przekrój kabla

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Aby uniknąć utraty danych w aplikacji do ewidencji uczniów, po zakończonej pracy każdego dnia należy wykonać

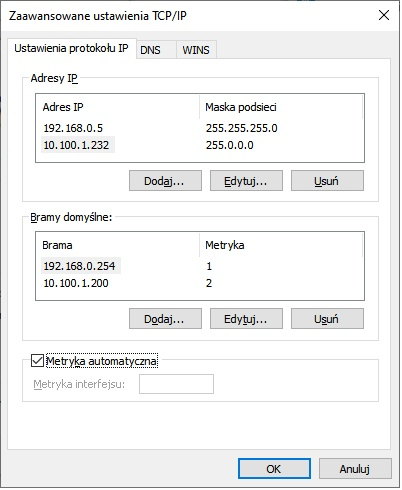

Na podstawie przedstawionej na ilustracji konfiguracji, w przypadku, gdy komputer żąda połączenia z inną siecią, w pierwszej kolejności dane zostaną wysłane do urządzenia o adresie

Jaką funkcję pełni protokół ARP (Address Resolution Protocol)?

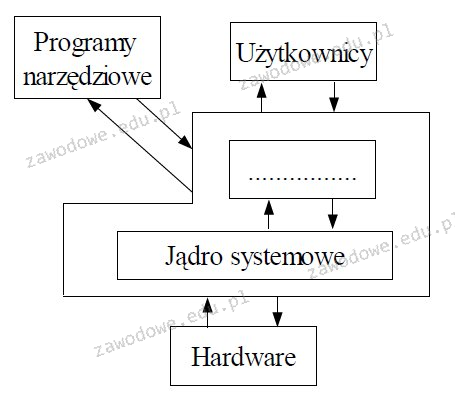

Jaki termin powinien zostać umieszczony w miejscu z kropkami na schemacie blokowym przedstawiającym strukturę systemu operacyjnego?