Pytanie 1

Jak określa się w systemie Windows profil użytkownika, który jest tworzony przy pierwszym logowaniu do komputera i zapisywany na lokalnym dysku twardym, a wszelkie jego modyfikacje dotyczą tylko tego konkretnego komputera?

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Jak określa się w systemie Windows profil użytkownika, który jest tworzony przy pierwszym logowaniu do komputera i zapisywany na lokalnym dysku twardym, a wszelkie jego modyfikacje dotyczą tylko tego konkretnego komputera?

Który protokół jest wykorzystywany do konwersji między adresami IP publicznymi a prywatnymi?

Aby uzyskać optymalną wydajność, karta sieciowa w komputerze stosuje transmisję szeregową.

Który z standardów implementacji sieci Ethernet określa sieć opartą na kablu koncentrycznym, gdzie długość segmentu nie może przekraczać 185 m?

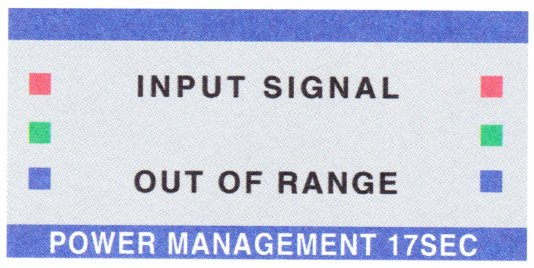

Gdy podłączono sprawny monitor do innego komputera, na ekranie pojawił się komunikat widoczny na rysunku. Co mogło spowodować ten komunikat?

Partycja, na której zainstalowany jest system operacyjny, określana jest jako partycja

AES (ang. Advanced Encryption Standard) to standard szyfrowania, który?

Aby zmierzyć tłumienie światłowodowego łącza w dwóch zakresach długości fal 1310 nm i 1550 nm, należy zastosować

Jaki jest poprawny adres podsieci po odjęciu 4 bitów od części hosta w adresie klasowym 192.168.1.0?

Podczas skanowania reprodukcji obrazu z czasopisma, na skanie obrazu pojawiły się regularne wzory, tak zwana mora. Z jakiej funkcji skanera należy skorzystać, aby usunąć morę?

W których nośnikach pamięci masowej jedną z najczęstszych przyczyn uszkodzeń jest uszkodzenie powierzchni?

Na ilustracji ukazany jest komunikat systemowy. Jakie kroki powinien podjąć użytkownik, aby naprawić błąd?

int a;

Podaną zmienną wyświetl na 2 sposoby.

Sieci lokalne o architekturze klient-serwer są definiowane przez to, że

Jakim modułem pamięci RAM, który jest zgodny z płytą główną GIGABYTE GA-X99-ULTRA GAMING/ X99/8xDDR4 2133, ECC, maksymalnie 128GB/ 4x PCI-E 16x/ RAID/ USB 3.1/ S-2011-V3/ATX, jest pamięć?

Okablowanie wertykalne w sieci strukturalnej łączy

Zabrudzony czytnik w napędzie optycznym powinno się czyścić

Który z trybów nie jest dostępny dla narzędzia powiększenia w systemie Windows?

Dane z twardego dysku HDD, którego sterownik silnika SM jest uszkodzony, można odzyskać

Jaki protokół służy do przesyłania plików bez konieczności tworzenia połączenia?

Zainstalowanie gniazda typu keystone w serwerowej szafie jest możliwe w

Jak wygląda liczba 356 w systemie binarnym?

Podaj poprawną sekwencję czynności, które należy wykonać, aby przygotować nowy laptop do użycia.

Jaką topologię fizyczną stosuje się w sieciach z topologią logiczną Token Ring?

Na ilustracji zaprezentowano graficzny symbol

Które narzędzie systemu Windows służy do zdefiniowania polityki haseł dostępowych do kont użytkowników?

Pierwszym krokiem koniecznym do ochrony rutera przed nieautoryzowanym dostępem do jego panelu konfiguracyjnego jest

Najwyższą prędkość transmisji danych w sieciach bezprzewodowych zapewnia standard

W systemie dziesiętnym liczba 110011(2) przedstawia się jako

Która usługa pozwala na zdalne logowanie do komputerów, wykonywanie poleceń systemowych oraz zarządzanie siecią?

Aby wymusić na użytkownikach lokalnych systemów z rodziny Windows Server regularną zmianę hasła oraz stosowanie haseł o odpowiedniej długości i spełniających wymagania dotyczące złożoności, należy ustawić

Aby w systemie Linux wykonać kopię zapasową określonych plików, należy wprowadzić w terminalu polecenie programu

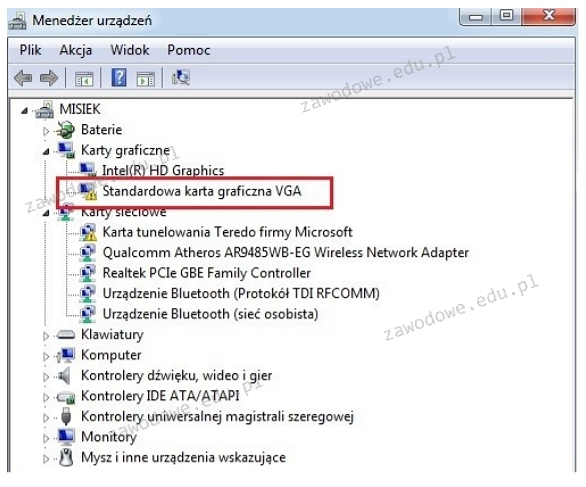

Oprogramowanie, które pozwala na interakcję pomiędzy kartą sieciową a systemem operacyjnym, to

Prawo majątkowe przysługujące twórcy programu komputerowego

Na skutek użycia polecenia ipconfig uzyskano konfigurację przedstawioną na ilustracji. Jaki jest adres IP stacji roboczej, która została poddana testom?

Sufiks DNS konkretnego połączenia :

Opis. . . . . . . . . . . . . . . : Realtek RTL8168C(P)/8111C(P)

PCI-E Gigabit Ethernet NIC

Adres fizyczny. . . . . . . . . . : 00-1F-D0-A5-0B-57

DHCP włączone . . . . . . . . . . : Tak

Autokonfiguracja włączona . . . . : Tak

Adres IP. . . . . . . . . . . . . : 192.168.0.11

Maska podsieci. . . . . . . . . . : 255.255.255.0

Brama domyślna. . . . . . . . . . : 192.168.0.1

Serwer DHCP . . . . . . . . . . . : 192.168.0.1

Serwery DNS . . . . . . . . . . . : 62.21.99.95Jakie protokoły są używane w komunikacji między hostem a serwerem WWW po wpisaniu URL w przeglądarkę internetową hosta?

Jakie narzędzie należy zastosować do podłączenia zaszycia kabla w module Keystone?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Kiedy podczas startu systemu z BIOSu firmy AWARD komputer wyemitował długi dźwięk oraz dwa krótkie, to oznacza, że wystąpił błąd?

Wyświetlony stan ekranu terminala został uzyskany podczas testu realizowanego w środowisku Windows. Techniczny pracownik zdobył w ten sposób informacje o: