Pytanie 1

Który z podanych adresów IPv4 stanowi adres publiczny?

Wynik: 40/40 punktów (100,0%)

Wymagane minimum: 20 punktów (50%)

Który z podanych adresów IPv4 stanowi adres publiczny?

Urządzenie używane do zestawienia 6 komputerów w sieci lokalnej to:

Do automatycznej synchronizacji dokumentów redagowanych przez kilka osób w tym samym czasie, należy użyć

Jakie urządzenie umożliwia zwiększenie zasięgu sieci bezprzewodowej?

Jakie rodzaje partycji mogą występować w systemie Windows?

Aby bezpośrednio połączyć dwa komputery w przewodowej sieci LAN, należy zastosować

Jakie będą wydatki na zakup kabla UTP kat.5e potrzebnego do stworzenia sieci komputerowej składającej się z 6 stanowisk, przy średniej odległości każdego stanowiska od przełącznika równiej 9m? Należy doliczyć m zapasu dla każdej linii kablowej, a cena za metr kabla wynosi 1,50 zł?

Oblicz koszt wykonania okablowania strukturalnego od 5 punktów abonenckich do panelu krosowego wraz z wykonaniem kabli połączeniowych dla stacji roboczych. W tym celu wykorzystano 50 m skrętki UTP. Punkt abonencki składa się z 2 gniazd typu RJ

| Materiał | Jednostka | Cena |

|---|---|---|

| Gniazdo podtynkowe 45x45, bez ramki, UTP 2xRJ45 kat.5e | szt. | 17 zł |

| UTP kabel kat.5e PVC 4PR 305m | karton | 305 zł |

| RJ wtyk UTP kat.5e beznarzędziowy | szt. | 6 zł |

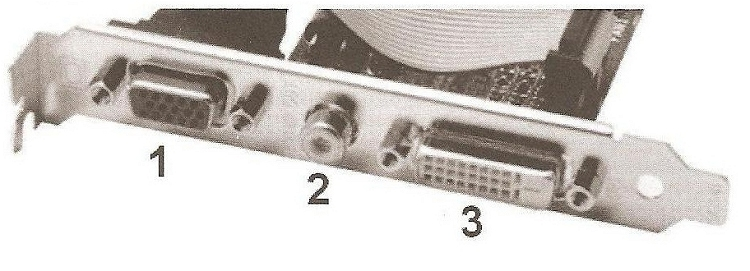

Na ilustracji pokazano porty karty graficznej. Które złącze jest cyfrowe?

W których nośnikach pamięci masowej jedną z najczęstszych przyczyn uszkodzeń jest uszkodzenie powierzchni?

Jaką topologię fizyczną sieci komputerowej przedstawia rysunek?

Który z protokołów służy do weryfikacji poprawności połączenia między dwoma hostami?

Jakie informacje o wykorzystywaniu pamięci wirtualnej można uzyskać, analizując zawartość pliku w systemie Linux?

Wskaż interfejsy płyty głównej widoczne na rysunku.

Jakie polecenie w systemie Linux umożliwia wyświetlenie zawartości katalogu?

Która z wymienionych technologii pamięci RAM wykorzystuje oba zbocza sygnału zegarowego do przesyłania danych?

Po wykonaniu podanego skryptu

| echo off |

| echo ola.txt >> ala.txt |

| pause |

Jaką rolę pełni usługa NAT działająca na ruterze?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

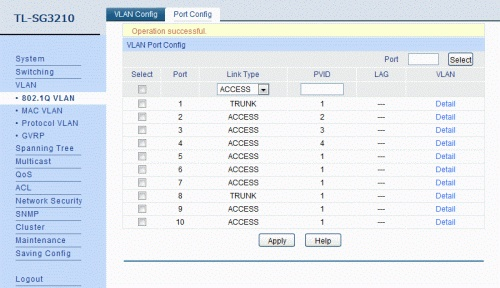

Na ilustracji przedstawiono konfigurację przełącznika z utworzonymi sieciami VLAN. Którymi portami można przesyłać oznaczone ramki z różnych sieci VLAN?

Aby zapobiec uszkodzeniu układów scalonych, podczas konserwacji sprzętu komputerowego należy używać

Aby poprawić bezpieczeństwo prywatnych danych sesji na stronie internetowej, zaleca się dezaktywację w ustawieniach przeglądarki

W nagłówku ramki standardu IEEE 802.3, który należy do warstwy łącza danych, znajduje się

Przerzutnik bistabilny pozwala na przechowywanie bitu danych w pamięci

Aby zrealizować usługę zdalnego uruchamiania systemów operacyjnych na komputerach stacjonarnych, należy w Windows Server zainstalować rolę

W formacie plików NTFS, do zmiany nazwy pliku potrzebne jest uprawnienie

Pozyskiwanie materiałów z odpadów w celu ich ponownego użycia to

Jakie są zakresy częstotliwości oraz maksymalne prędkości przesyłu danych w standardzie 802.11g WiFi?

Aby stworzyć kontroler domeny w środowisku systemów Windows Server na lokalnym serwerze, konieczne jest zainstalowanie roli

Który z podanych programów pozwoli na stworzenie technicznego rysunku ilustrującego plan instalacji logicznej sieci lokalnej w budynku?

Wysyłanie żetonu (ang. token) występuje w sieci o fizycznej strukturze

Kluczowym mechanizmem zabezpieczającym dane przechowywane na serwerze jest

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue, press Del to setup) naciśnięcie klawisza Del skutkuje

Jakie narzędzie w systemie Linux pozwala na wyświetlenie danych o sprzęcie zapisanych w BIOS?

Jakie jest nominalne wyjście mocy (ciągłe) zasilacza o parametrach przedstawionych w tabeli?

| Napięcie wyjściowe | +5 V | +3.3 V | +12 V1 | +12 V2 | -12 V | +5 VSB |

|---|---|---|---|---|---|---|

| Prąd wyjściowy | 18,0 A | 22,0 A | 18,0 A | 17,0 A | 0,3 A | 2,5 A |

| Moc wyjściowa | 120 W | 336 W | 3,6 W | 12,5 W |

Błędy systemu operacyjnego Windows spowodowane przez konflikty zasobów sprzętowych, takie jak przydział pamięci, przydział przerwań IRQ i kanałów DMA, najłatwiej jest wykryć za pomocą narzędzia

W podejściu archiwizacji danych określanym jako Dziadek – Ojciec – Syn na poziomie Dziadek wykonuje się kopię danych na koniec

Osoba korzystająca z systemu Windows zdecydowała się na przywrócenie systemu do określonego punktu. Które pliki utworzone po tym punkcie NIE zostaną zmienione w wyniku tej operacji?

Cena wydrukowania jednej strony tekstu to 95 gr, a koszt przygotowania jednej płyty CD wynosi 1,54 zł. Jakie wydatki poniesie firma, tworząca płytę z prezentacjami oraz 120-stronicowy poradnik?

Pracownik serwisu komputerowego podczas wykonywania konserwacji i czyszczenia drukarki laserowej, odłączonej od źródła zasilania, może wykorzystać jako środek ochrony indywidualnej