Pytanie 1

Aby podłączyć drukarkę z interfejsem równoległym do komputera, który ma jedynie porty USB, należy użyć adaptera

Wynik: 17/40 punktów (42,5%)

Wymagane minimum: 20 punktów (50%)

Aby podłączyć drukarkę z interfejsem równoległym do komputera, który ma jedynie porty USB, należy użyć adaptera

Awaria drukarki igłowej może być spowodowana uszkodzeniem

Aby skopiować folder c:\test wraz ze wszystkimi podfolderami na przenośny dysk f:\ w systemie Windows 7, jakie polecenie należy zastosować?

Jaką wartość ma największa liczba 16-bitowa?

Zastosowanie programu w różnych celach, badanie jego działania oraz wprowadzanie modyfikacji, a także możliwość publicznego udostępniania tych zmian, to charakterystyka licencji typu

Administrator pragnie udostępnić w sieci folder c:\instrukcje tylko trzem użytkownikom z grupy Serwisanci. Jakie działanie powinien podjąć?

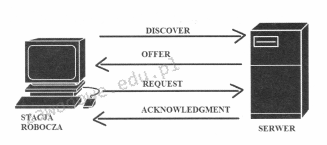

Którego protokołu działanie zostało zobrazowane na załączonym rysunku?

Na ilustracji zobrazowano

Jakie polecenie w systemie Linux pozwala na zarządzanie uprawnieniami do plików oraz katalogów?

Aby chronić systemy sieciowe przed atakami z zewnątrz, należy zastosować

Jaki rodzaj kabla powinien być użyty do połączenia komputera w obszarze podlegającym wpływom zakłóceń elektromagnetycznych?

Użytkownicy należący do grupy Pracownicy nie mają możliwości drukowania dokumentów za pomocą serwera wydruku w systemie operacyjnym Windows Server. Dysponują jedynie uprawnieniami do „Zarządzania dokumentami”. Co należy uczynić, aby wyeliminować opisany problem?

Switch sieciowy w standardzie Fast Ethernet pozwala na przesył danych z maksymalną prędkością

Czym jest skrót MAN w kontekście sieci?

Aby zmierzyć tłumienie światłowodowego łącza w dwóch zakresach długości fal 1310 nm i 1550 nm, należy zastosować

Jaką usługę powinno się aktywować na ruterze, aby każda stacja robocza mogła wymieniać pakiety z siecią Internet, gdy dostępnych jest 5 adresów publicznych oraz 18 stacji roboczych?

Wskaż właściwą formę maski podsieci?

Do czego służy program CHKDSK?

Jakie znaczenie mają zwory na dyskach z interfejsem IDE?

Minimalna ilość pamięci RAM wymagana dla systemu operacyjnego Windows Server 2008 wynosi przynajmniej

Jakie znaczenie ma termin "wykonanie kopii zapasowej systemu"?

Użytkownik systemu Linux, który pragnie usunąć konto innego użytkownika wraz z jego katalogiem domowym, powinien wykonać polecenie

Wyświetlony stan ekranu terminala został uzyskany podczas testu realizowanego w środowisku Windows. Techniczny pracownik zdobył w ten sposób informacje o:

Wyższą efektywność aplikacji multimedialnych w systemach z rodziny Windows zapewnia technologia

Dokumentacja końcowa dla planowanej sieci LAN powinna między innymi zawierać

Switch jako kluczowy komponent występuje w sieci o strukturze

Wtyk przedstawiony na ilustracji powinien być użyty do zakończenia kabli kategorii

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue press DEL to setup. Naciśnięcie klawisza DEL spowoduje

Serwer DNS pełni rolę

Kluczowe znaczenie przy tworzeniu stacji roboczej, na której ma funkcjonować wiele maszyn wirtualnych, ma:

W systemie Windows Server narzędzie, które pozwala na zarządzanie zasadami grupowymi, to

Wydanie w systemie Windows komendy ```ATTRIB -S +H TEST.TXT``` spowoduje

W systemie SI jednostką do mierzenia napięcia jest

Która edycja systemu operacyjnego Windows Server 2008 charakteryzuje się najuboższym interfejsem graficznym?

Aby zapobiec uszkodzeniu układów scalonych, podczas konserwacji sprzętu komputerowego należy używać

Aby umożliwić diagnozę systemu operacyjnego Windows oraz utworzyć plik zawierający listę wszystkich zaczytywanych sterowników, należy uruchomić system w trybie

Odnalezienie głównego rekordu rozruchowego, wczytującego system z aktywnej partycji umożliwia

Wymiana baterii należy do czynności związanych z eksploatacją

Wskaż adresy podsieci, które powstaną po podziale sieci o adresie 172.16.0.0/22 na 4 równe podsieci.

Cechą oprogramowania służącego do monitorowania zdarzeń metodą Out-Of-Band w urządzeniach sieciowych jest