Pytanie 1

Do określenia położenia lądów i mórz w przeszłości geologicznej stosuje się badania

Wynik: 11/40 punktów (27,5%)

Wymagane minimum: 20 punktów (50%)

Do określenia położenia lądów i mórz w przeszłości geologicznej stosuje się badania

Urwanie przewodu wiertniczego objawia się nagłym

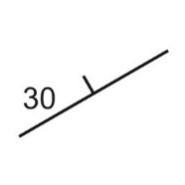

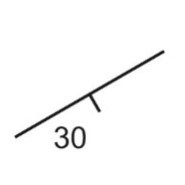

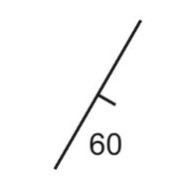

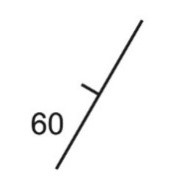

Zapis położenia warstw 30/60/N w postaci graficznej przedstawia rysunek

Metodą opróbowania otworu podczas wiercenia, stosowaną w celu zwiększenia efektywności poszukiwania złóż, jest

Teren na niewielkiej wysokości nad poziomem morza, który został zerodowany prawie całkowicie i stanowi końcową fazę erozji w klimacie wilgotnym, określany jest jako

Gazem cieplarnianym nie jest

Aby znaleźć skamieniałości dewońskie, należy zaplanować wycieczkę w rejon

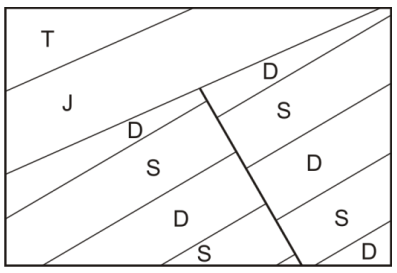

Na mapie widoczny jest uskok

Pasmo górskie Tatr zostało wypiętrzone podczas orogenezy

Do minerałów o takim samym wzorze chemicznym należą

Terra rossa powstaje w wyniku wietrzenia

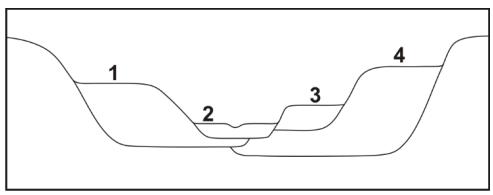

Ruch masowy przedstawiony na rysunku to

Do poszukiwania form krasowych występujących płytko pod powierzchnią ziemi należy stosować metody

Najmłodszy taras rzeczny oznaczony jest

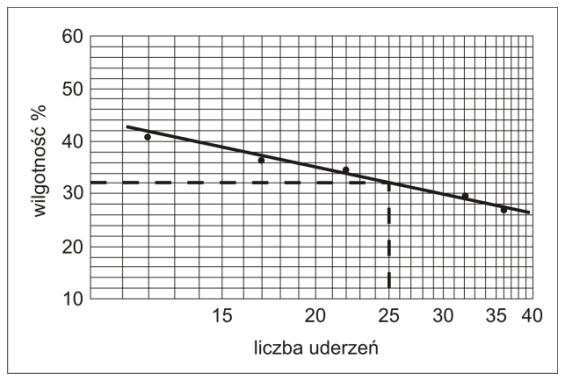

Ile wynosi wilgotność gruntu użytego do badania w aparacie Casagrande'a, którego wyniki przedstawione są na wykresie?

W terenie spadek mierzy się przy pomocy

Do której grupy skał należą granitoidy?

Statusu Geoparku Krajowego obecnie nie posiada

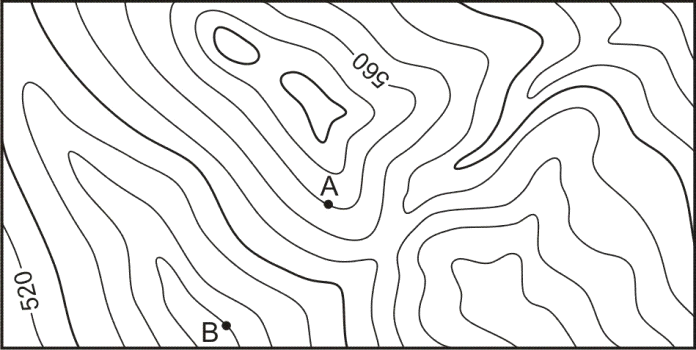

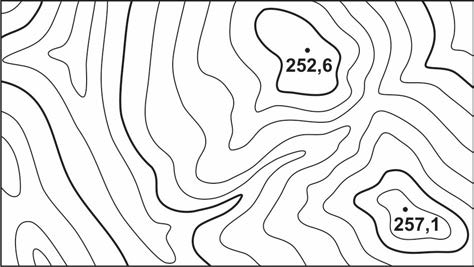

Geolog planujący marszrutę bezpośrednio z punktu A do B będzie przemieszczał się w kierunku

Które roztwory przenikają do skał i zawartych w nich szczątków organicznych w procesie sylifikacji?

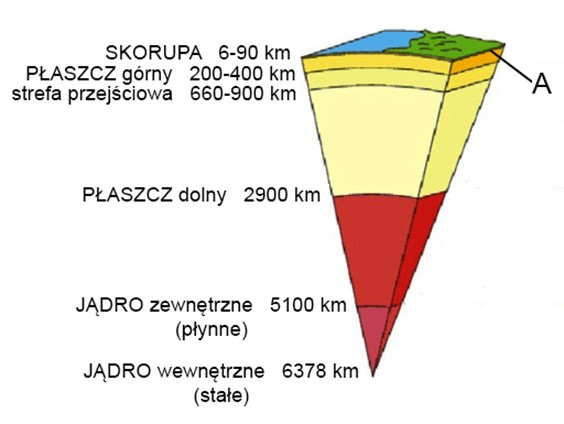

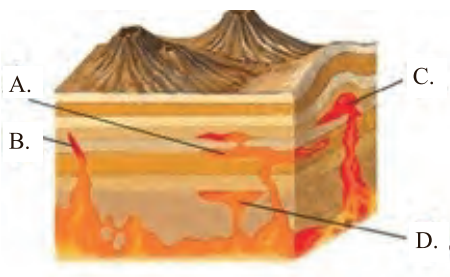

Powierzchnia oznaczona na rysunku literą A nazywana jest powierzchnią nieciągłości

Złoża, które powstały w wyniku osadzania materiału transportowanego przez rzekę, nazywa się

Woda wolna, występująca w porach skalnych, może się przemieszczać swobodnie tylko w porach

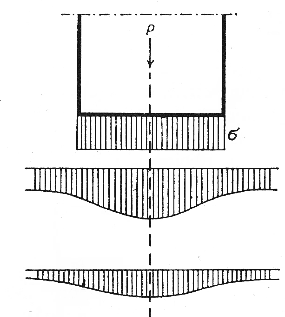

Stan naprężenia gruntu przedstawiony na rysunku należy do naprężeń

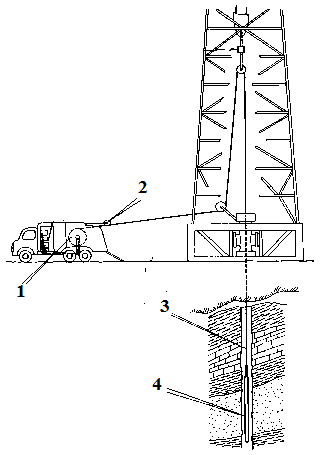

Którą cyfrą oznaczono miejsce pomiaru głębokości zapuszczania sondy pomiarowej do otworu wiertniczego?

Popioły wulkaniczne osadzone w środowisku wodnym nazywa się

Skamieniałe pozostałości działalności życiowej zwierząt, np. żerowanie, drążenie w osadzie, tropy, odchody, określane są jako skamieniałości

Jak nazywa się rodzaj erozji zachodzącej najczęściej w górnym odcinku rzeki, która doprowadza do cofania się źródła?

Pełne nasycenie wodą wolnych przestrzeni w warstwie skalnej zachodzi w strefie

Próbkę gruntu do badań laboratoryjnych suszy się w temperaturze

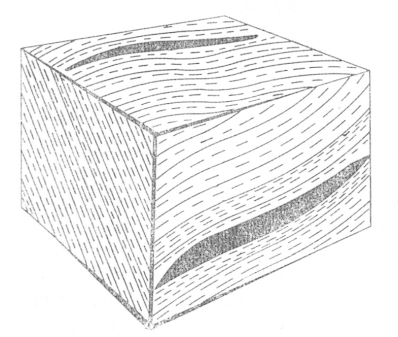

Przedstawiona na rysunku soczewka jest przykładem złoża występującego w formie

Na przekroju hydrogeologicznym zakreskowano

Cięcie poziomicowe na przedstawionym fragmencie mapy wynosi

Eratyki to inna nazwa

Którą literą oznaczono formę plutoniczną określaną jako sill?

Od czego w największym stopniu zależy przepuszczalność hydrauliczna skał magmowych?

Wyniki pomiarów i interpretacji pola siły ciężkości można odczytać z mapy

Przy wierceniach kierunkowych wykonywanych metodą stołową odchylanie osi otworu od pionu wykonuje się za pomocą

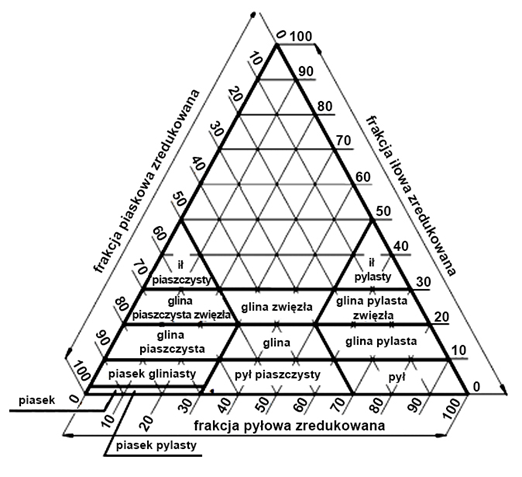

Przedstawiony wykres nazywany jest trójkątem

Akratopegi to wody podziemne, w których zawartość minerałów mieści się w przedziale