Pytanie 1

Jakiego protokołu sieciowego używa się do określenia mechanizmów zarządzania urządzeniami w sieci?

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

Jakiego protokołu sieciowego używa się do określenia mechanizmów zarządzania urządzeniami w sieci?

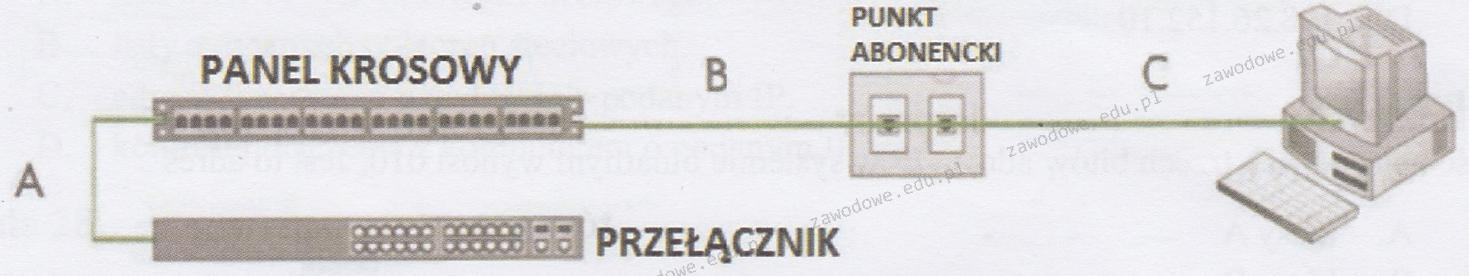

Na ilustracji zaprezentowano strukturę topologiczną

Papier termotransferowy to materiał eksploatacyjny stosowany w drukarkach

W normie PN-EN 50174 nie znajdują się wytyczne dotyczące

Jakie oznaczenie odnosi się do normy dotyczącej okablowania strukturalnego?

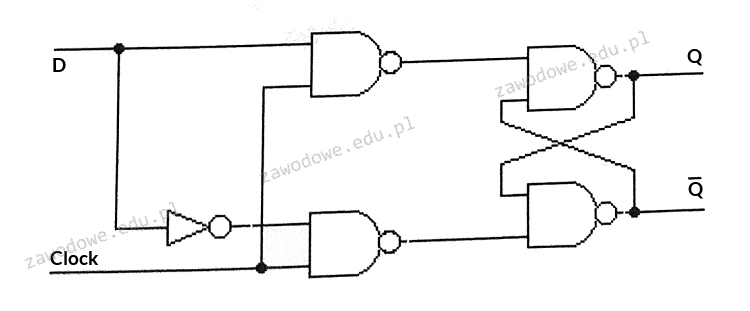

Jak wygląda schemat połączeń bramek logicznych?

Na diagramie zaprezentowano strukturę

Przesyłanie danych przez router, które wiąże się ze zmianą adresów IP źródłowych lub docelowych, określa się skrótem

Który z protokołów zapewnia bezpieczne połączenie między klientem a witryną internetową banku, zachowując prywatność użytkownika?

Program firewall nie zapewnia ochrony przed

W systemie Windows do instalacji aktualizacji oraz przywracania sterowników urządzeń należy użyć przystawki

Ilustracja pokazuje rezultat testu sieci komputerowej za pomocą komendy

W jakim oprogramowaniu trzeba zmienić konfigurację, aby użytkownik mógł wybrać z listy i uruchomić jeden z różnych systemów operacyjnych zainstalowanych na swoim komputerze?

Ile podsieci obejmują komputery z adresami: 192.168.5.12/25, 192.168.5.200/25 oraz 192.158.5.250/25?

Które systemy operacyjne są atakowane przez wirusa MS Blaster?

Jak należy ustawić w systemie Windows Server 2008 parametry protokołu TCP/IP karty sieciowej, aby komputer mógł jednocześnie łączyć się z dwiema różnymi sieciami lokalnymi posiadającymi odrębne adresy IP?

W systemie Linux komenda chown pozwala na

Adres fizyczny karty sieciowej AC-72-89-17-6E-B2 jest zapisany w formacie

Który standard sieci lokalnej określa dostęp do medium w oparciu o token (żeton)?

Aby wymusić na użytkownikach lokalnych systemów z rodziny Windows Server regularną zmianę hasła oraz stosowanie haseł o odpowiedniej długości i spełniających wymagania dotyczące złożoności, należy ustawić

Złącze IrDA służy do bezprzewodowej komunikacji i jest

Jakie będą wydatki na zakup kabla UTP kat.5e potrzebnego do stworzenia sieci komputerowej składającej się z 6 stanowisk, przy średniej odległości każdego stanowiska od przełącznika równiej 9m? Należy doliczyć m zapasu dla każdej linii kablowej, a cena za metr kabla wynosi 1,50 zł?

Drukarka do zdjęć ma mocno zabrudzoną obudowę oraz ekran. Aby oczyścić zanieczyszczenia bez ryzyka ich uszkodzenia, należy zastosować

Który kolor żyły nie występuje w kablu typu skrętka?

Prawo osobiste twórcy do oprogramowania komputerowego

Według normy PN-EN 50174 maksymalna całkowita długość kabla połączeniowego między punktem abonenckim a komputerem oraz kabla krosowniczego A+C) wynosi

Plik ma przypisane uprawnienia: rwxr-xr--. Jakie uprawnienia będzie miał plik po zastosowaniu polecenia chmod 745?

Aby zapobiegać i eliminować szkodliwe oprogramowanie, takie jak exploity, robaki oraz trojany, konieczne jest zainstalowanie oprogramowania

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Do ilu sieci należą komputery o podanych w tabeli adresach IP i standardowej masce sieci?

| Komputer | Adres IP |

|---|---|

| Komputer 1 | 172.16.15.5 |

| Komputer 2 | 172.18.15.6 |

| Komputer 3 | 172.18.16.7 |

| Komputer 4 | 172.20.16.8 |

| Komputer 5 | 172.20.16.9 |

| Komputer 6 | 172.21.15.10 |

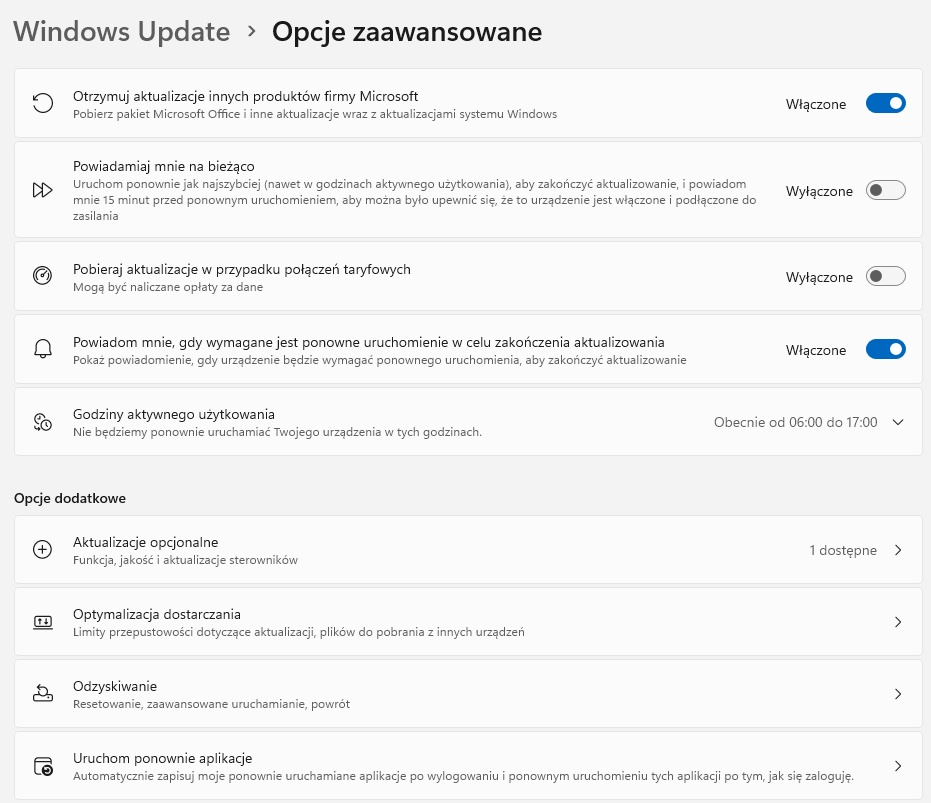

Biorąc pod uwagę konfigurację wykonywaną na ilustracji, administrator po zainstalowaniu systemu operacyjnego uznał za istotne, aby

GRUB, LILO, NTLDR to

Jakie polecenie służy do przeprowadzania aktualizacji systemu operacyjnego Linux korzystającego z baz RPM?

Redukcja liczby jedynek w masce pozwoli na zaadresowanie

W celu kontrolowania przepustowości sieci, administrator powinien zastosować aplikację typu

Aby zapewnić użytkownikom Active Directory możliwość logowania oraz dostęp do zasobów tej usługi w sytuacji awarii kontrolera domeny, co należy zrobić?

Oświetlenie oparte na diodach LED w trzech kolorach wykorzystuje skanery typu

Element elektroniczny przedstawiony na ilustracji to:

W przypadku planowania wykorzystania przestrzeni dyskowej komputera do przechowywania oraz udostępniania danych, takich jak pliki oraz aplikacje dostępne w internecie, a także ich zarządzania, komputer powinien być skonfigurowany jako

Do serwisu komputerowego przyniesiono laptopa, którego matryca wyświetla obraz w bardzo słabej jakości. Dodatkowo obraz jest znacząco ciemny i widoczny jedynie z niewielkiej odległości. Co może być przyczyną tej usterki?