Pytanie 1

Urządzenie, które pozwala komputerom na bezprzewodowe łączenie się z siecią komputerową przewodową, to

Wynik: 40/40 punktów (100,0%)

Wymagane minimum: 20 punktów (50%)

Urządzenie, które pozwala komputerom na bezprzewodowe łączenie się z siecią komputerową przewodową, to

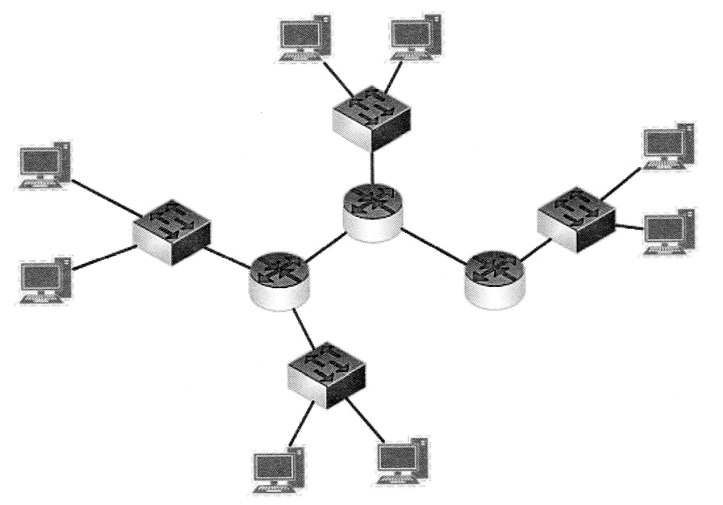

Ile symboli routerów i przełączników występuje na diagramie?

Aby dezaktywować transmitowanie nazwy sieci Wi-Fi, należy w punkcie dostępowym wyłączyć opcję

Na ilustracji przedstawiono tylną stronę

Zjawisko przekazywania tokena (ang. token) występuje w sieci o fizycznej strukturze

Jak nazywa się magistrala, która w komputerze łączy procesor z kontrolerem pamięci i składa się z szyny adresowej, szyny danych oraz linii sterujących?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jaką funkcję pełni serwer ISA w systemie Windows?

Osoba planuje unowocześnić swój komputer poprzez zwiększenie pamięci RAM. Zainstalowana płyta główna ma specyfikacje przedstawione w tabeli. Wybierając dodatkowe moduły pamięci, powinien pamiętać, aby

| Parametry płyty głównej | |

|---|---|

| Model | H97 Pro4 |

| Typ gniazda procesora | Socket LGA 1150 |

| Obsługiwane procesory | Intel Core i7, Intel Core i5, Intel Core i3, Intel Pentium, Intel Celeron |

| Chipset | Intel H97 |

| Pamięć | 4 x DDR3- 1600 / 1333/ 1066 MHz, max 32 GB, ECC, niebuforowana |

| Porty kart rozszerzeń | 1 x PCI Express 3.0 x16, 3 x PCI Express x1, 2 x PCI |

Na schemacie przedstawiono sieć o strukturze

Jak nazywa się protokół bazujący na architekturze klient-serwer oraz na modelu żądanie-odpowiedź, który jest używany do transferu plików?

Który z systemów operacyjnych przeznaczonych do sieci jest dostępny na zasadach licencji GNU?

Aby móc zakładać konta użytkowników, komputerów oraz innych obiektów i centralnie gromadzić o nich informacje, należy zainstalować rolę na serwerze Windows

Jakie polecenie systemu Windows przedstawione jest na ilustracji?

Adres fizyczny Nazwa transportu

===========================================================

00-23-AE-09-47-CF Nośnik rozłączony

00-23-4D-CB-B4-BB Brak

00-23-4D-CB-B4-BB Nośnik rozłączonyLiczbie 16 bitowej 0011110010101110 wyrażonej w systemie binarnym odpowiada w systemie szesnastkowym liczba

Poleceniem systemu Linux służącym do wyświetlenia informacji, zawierających aktualną godzinę, czas działania systemu oraz liczbę zalogowanych użytkowników, jest

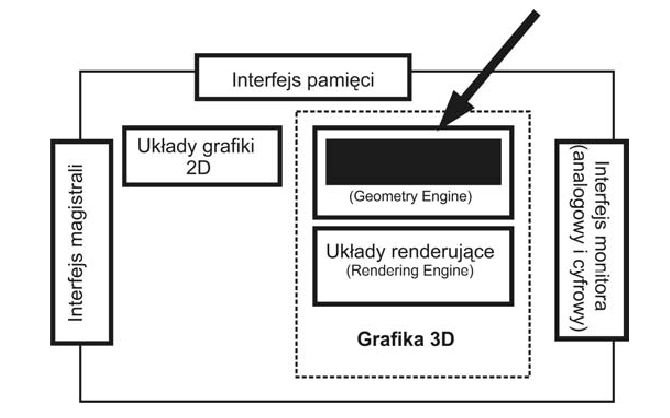

Jakie zadanie realizuje układ oznaczony strzałką na diagramie karty graficznej?

W celu konserwacji elementów z łożyskami oraz ślizgami w urządzeniach peryferyjnych wykorzystuje się

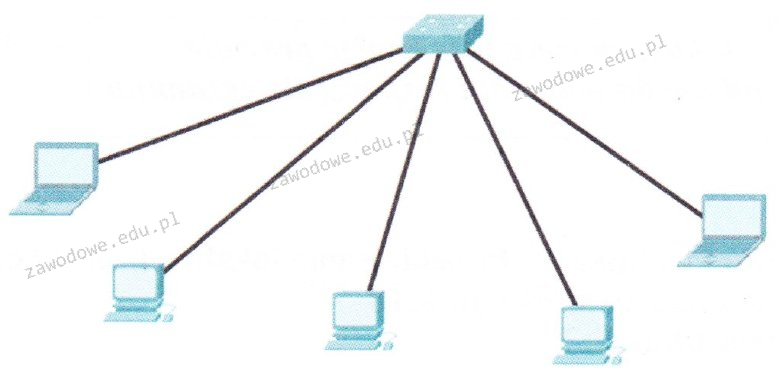

Jaką topologię fizyczną sieci ilustruje zamieszczony rysunek?

Który standard Ethernet określa Gigabit Ethernet dla okablowania UTP?

Aby uzyskać na ekranie monitora odświeżanie obrazu 85 razy w ciągu sekundy, trzeba częstotliwość jego odświeżania ustawić na

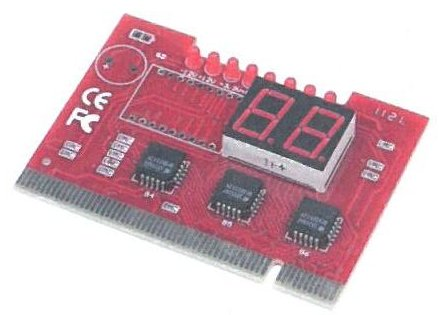

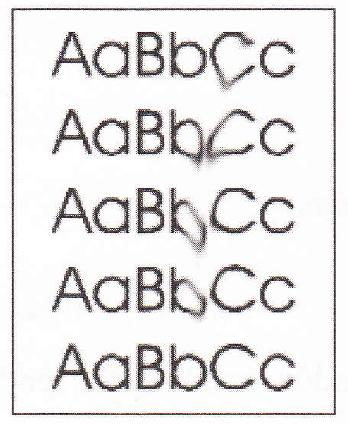

Na ilustracji zaprezentowano

Adres IP jest przypisywany przełącznikowi warstwy drugiej w celu

Jakiego rodzaju adresację stosuje protokół IPv6?

Jakiej klasy należy adres IP 130.140.0.0?

Najczęstszą przyczyną niskiej jakości wydruku z drukarki laserowej, która objawia się widocznym rozmazywaniem tonera, jest

W celu zapewnienia jakości usługi QoS, w przełącznikach warstwy dostępu stosuje się mechanizm

Która z opcji konfiguracji ustawień konta użytkownika o ograniczonych uprawnieniach w systemie Windows jest dostępna dzięki narzędziu secpol?

Jak nazywa się licencja oprogramowania pozwalająca na bezpłatne dystrybucję aplikacji?

Jakie są nazwy licencji, które umożliwiają korzystanie z programu w pełnym zakresie, ale ograniczają liczbę uruchomień do określonej, niewielkiej ilości od momentu instalacji?

W technologii Ethernet 100Base-TX do przesyłania danych używane są żyły kabla UTP podłączone do pinów:

Aby w edytorze Regedit przywrócić stan rejestru systemowego za pomocą wcześniej utworzonej kopii zapasowej, należy użyć funkcji

Który z poniższych programów nie służy do diagnozowania sieci komputerowej w celu wykrywania problemów?

Co oznacza skrót 'RAID' w kontekście systemów komputerowych?

Które z podanych poleceń w systemie Windows XP umożliwia sprawdzenie aktualnej konfiguracji adresu IP systemu Windows?

Jakie środowisko powinien wybrać administrator sieci, aby zainstalować serwer dla stron WWW w systemie Linux?

Jakie protokoły są klasyfikowane jako protokoły transportowe w modelu ISO/OSI?

Aby po załadowaniu systemu Windows program Kalkulator uruchamiał się automatycznie, konieczne jest dokonanie ustawień

Po stwierdzeniu przypadkowego usunięcia ważnych danych na dysku twardym, aby odzyskać usunięte pliki, najlepiej

W dwóch sąsiadujących pomieszczeniach w pewnej firmie występują bardzo silne zakłócenia elektromagnetyczne. Aby osiągnąć jak największą przepustowość podczas działania istniejącej sieci LAN, jakie medium transmisyjne powinno zostać użyte?