Pytanie 1

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jaki protokół aplikacyjny w modelu TCP/IP pozwala klientowi na nawiązanie bezpiecznego połączenia z firmowym serwerem przez Internet, aby zyskać dostęp do zasobów przedsiębiorstwa?

Aby uzyskać dostęp do adresu serwera DNS w ustawieniach karty sieciowej w systemie z rodziny Windows, należy wprowadzić polecenie

Aby chronić konto użytkownika przed nieautoryzowanymi zmianami w systemie Windows 7, 8 lub 10, które wymagają uprawnień administratora, należy ustawić

Martwy piksel, będący defektem monitorów LCD, to punkt, który trwa niezmiennie w kolorze

W systemie Windows 7, aby skopiować katalog c:\est wraz ze wszystkimi podkatalogami na zewnętrzny dysk, należy zastosować polecenie

Bezprzewodową komunikację komputerów w sieci lokalnej zapewnia

Jakie wbudowane narzędzie w systemie Windows służy do identyfikowania problemów związanych z animacjami w grach oraz odtwarzaniem filmów?

Który z standardów implementacji sieci Ethernet określa sieć opartą na kablu koncentrycznym, gdzie długość segmentu nie może przekraczać 185 m?

Adresy IPv6 są reprezentowane jako liczby

Kto jest odpowiedzialny za alokację czasu procesora dla konkretnych zadań?

Metoda przesyłania danych między urządzeniem CD/DVD a pamięcią komputera w trybie bezpośredniego dostępu do pamięci to

Nazwa licencji oprogramowania komputerowego, które jest dystrybuowane bezpłatnie, lecz z ograniczoną przez twórcę funkcjonalnością w porównaniu do pełnej, płatnej wersji, gdzie po upływie 30 dni zaczynają się wyświetlać reklamy oraz przypomnienia o konieczności rejestracji, to

Jakie korzyści płyną z zastosowania systemu plików NTFS?

System operacyjny został poddany atakowi przez oprogramowanie szpiegujące. Po usunięciu problemów, aby zapobiec przyszłym atakom, należy

Który procesor jest kompatybilny z płytą główną o przedstawionej specyfikacji?

ASUS micro-ATX, socket 1150, VT-d, DDR3 `1333, 1600 MHz), ATI Radeon X1250, 3 x PCI-Express x1, 3 x PCI-Express x16, 2 x Serial ATA III, USB 3.0, VGA, HDMI, DVI-D

Który z komponentów nie jest zgodny z płytą główną MSI A320M Pro-VD-S socket AM4, 1 x PCI-Ex16, 2 x PCI-Ex1, 4 x SATA III, 2 x DDR4- maks. 32 GB, 1 x D-SUB, 1x DVI-D, ATX?

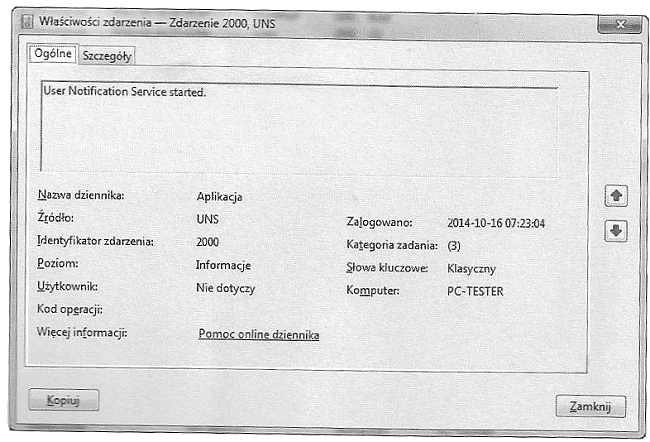

Wpis przedstawiony na ilustracji w dzienniku zdarzeń klasyfikowany jest jako zdarzenie typu

Norma PN-EN 50173 rekomenduje montaż przynajmniej

Który typ drukarki powinien być wykorzystany w dziale sprzedaży hurtowni materiałów budowlanych do tworzenia faktur na papierze samokopiującym, aby uzyskać kopie wydruku?

Który program umożliwia sprawdzanie stanów portów i wykonuje próby połączeń z nimi?

Menedżer urządzeń w systemie Windows pozwala na wykrycie

Podczas uruchamiania (krótko po zakończeniu testu POST) komputer się zawiesza. Jakie mogą być możliwe przyczyny tej awarii?

Procesem nieodwracalnym, całkowicie uniemożliwiającym odzyskanie danych z dysku twardego, jest

W systemie Linux uruchomiono skrypt z czterema argumentami. Jak można uzyskać dostęp do listy wszystkich wartości w skrypcie?

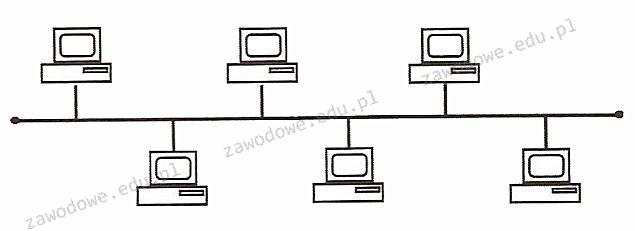

Na ilustracji ukazano sieć o układzie

Aby zwiększyć bezpieczeństwo prywatnych danych podczas przeglądania stron WWW, zaleca się dezaktywację w ustawieniach przeglądarki

Jakie procesory można wykorzystać w zestawie komputerowym z płytą główną wyposażoną w gniazdo procesora typu Socket AM3?

Podczas realizacji projektu sieci LAN zastosowano medium transmisyjne zgodne ze standardem Ethernet 1000Base-T. Które z poniższych stwierdzeń jest prawdziwe?

Narzędzie chroniące przed nieautoryzowanym dostępem do lokalnej sieci, to

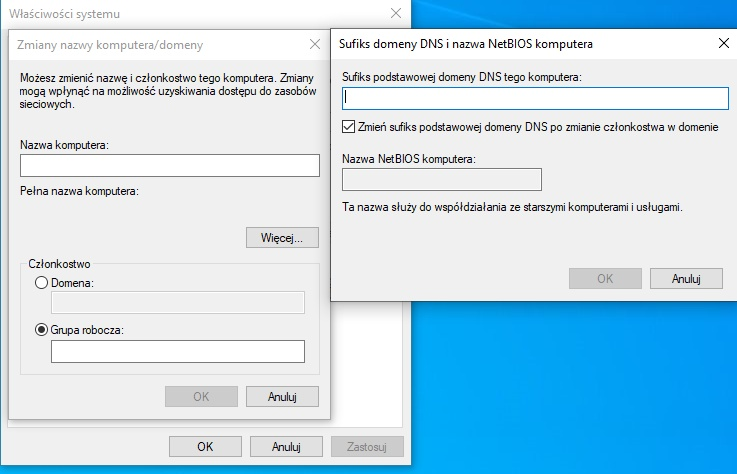

Aby podłączyć stację roboczą z zainstalowanym systemem Windows do domeny zst.local należy

W celu zainstalowania systemu openSUSE oraz dostosowania jego ustawień, można skorzystać z narzędzia

Administrator sieci komputerowej z adresem 192.168.1.0/24 podzielił ją na 8 równych podsieci. Ile adresów hostów będzie dostępnych w każdej z nich?

Kabel pokazany na ilustracji może być zastosowany do realizacji okablowania sieci o standardzie

Aktywacja opcji OCR podczas ustawiania skanera umożliwia

Po wykonaniu eksportu klucza HKCU zostanie zapisana kopia rejestru zawierająca informacje, dotyczące konfiguracji

Jakie materiały eksploatacyjne wykorzystuje się w drukarce laserowej?

Program fsck jest stosowany w systemie Linux do

Ile urządzeń jest w stanie współpracować z portem IEEE1394?

Zapisany symbol dotyczy urządzeń