Pytanie 1

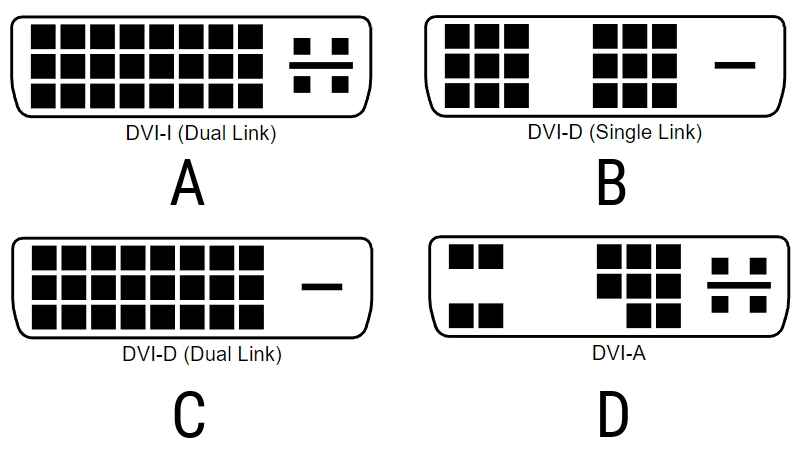

Który standard złącza DVI pozwala na przesyłanie jedynie sygnału analogowego?

Wynik: 17/40 punktów (42,5%)

Wymagane minimum: 20 punktów (50%)

Który standard złącza DVI pozwala na przesyłanie jedynie sygnału analogowego?

Jakie zagrożenie nie jest eliminowane przez program firewall?

Wskaż sygnał informujący o błędzie karty graficznej w komputerze z BIOS POST od firmy AWARD?

Którą maskę należy zastosować, aby podzielić sieć o adresie 172.16.0.0/16 na podsieci o maksymalnej liczbie 62 hostów?

Jaki port jest ustawiony jako domyślny dla serwera WWW?

W systemie Windows Server narzędzie, które pozwala na zarządzanie zasadami grupowymi, to

W którym programie należy zmodyfikować ustawienia, aby użytkownik komputera mógł wybrać z menu i uruchomić jeden z kilku systemów operacyjnych zainstalowanych na jego komputerze?

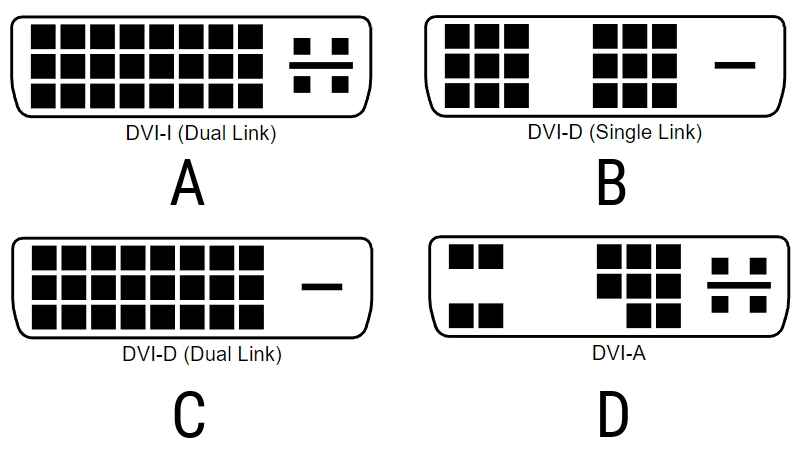

Użytkownik o nazwie Gość jest częścią grupy Goście, która z kolei należy do grupy Wszyscy. Jakie uprawnienia do folderu test1 ma użytkownik Gość?

Licencja Office 365 PL Personal (jedno stanowisko, subskrypcja na rok) ESD jest przypisana do

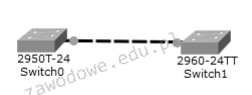

Na ilustracji zaprezentowano sieć komputerową w układzie

Aby wymienić uszkodzony moduł pamięci RAM, najpierw trzeba

Jaka usługa, opracowana przez firmę Microsoft, pozwala na konwersję nazw komputerów na adresy URL?

Jaką funkcję pełni serwer ISA w systemie Windows?

Administrator dostrzegł, że w sieci LAN występuje wiele kolizji. Jakie urządzenie powinien zainstalować, aby podzielić sieć lokalną na mniejsze domeny kolizji?

Rozmiar pliku wynosi 2 KiB. Co to oznacza?

Użytkownik systemu Linux, który pragnie usunąć konto innego użytkownika wraz z jego katalogiem domowym, powinien wykonać polecenie

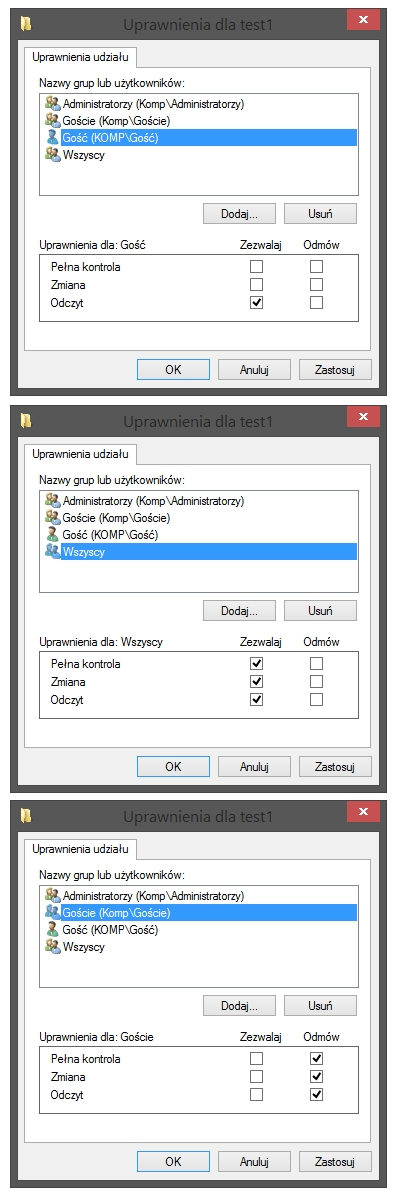

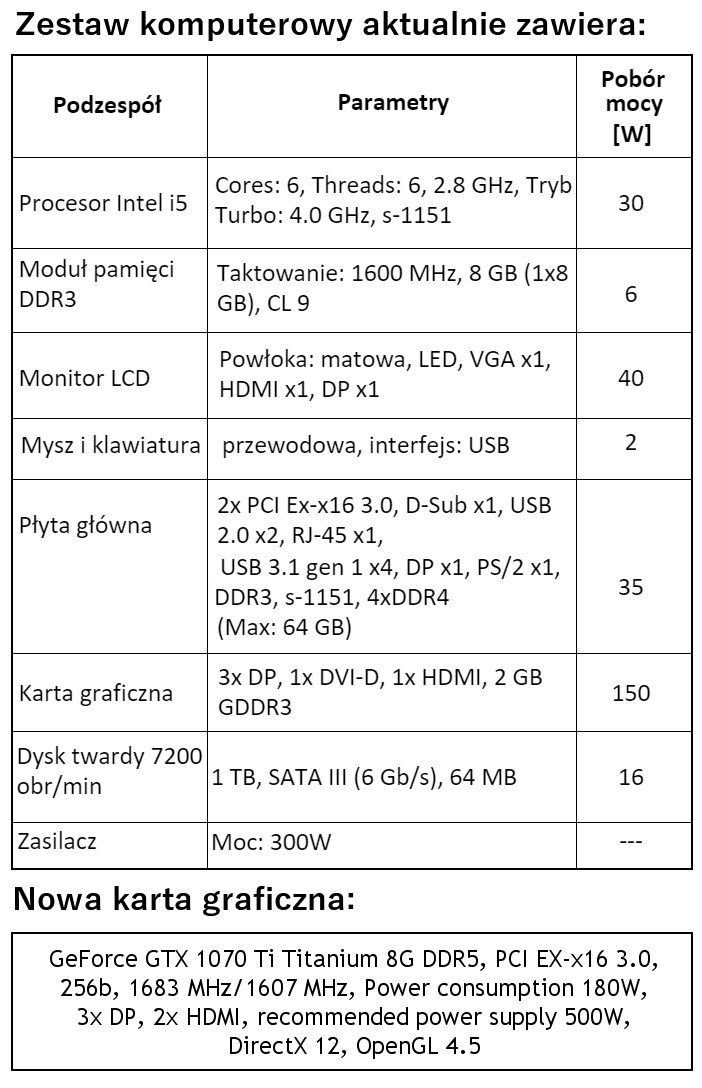

W zestawie komputerowym o parametrach wymienionych w tabeli konieczne jest zastąpienie karty graficznej nową, wskazaną w ramce. W związku z tym modernizacja tego komputera wymaga także wymiany

Jaki protokół stworzony przez IBM służy do udostępniania plików w architekturze klient-serwer oraz do współdzielenia zasobów z sieciami Microsoft w systemach operacyjnych LINUX i UNIX?

Aby skopiować folder c:\test wraz ze wszystkimi podfolderami na przenośny dysk f:\ w systemie Windows 7, jakie polecenie należy zastosować?

Jak nazywa się protokół używany do przesyłania wiadomości e-mail?

Aby zweryfikować mapę połączeń kabla UTP Cat 5e w sieci lokalnej, konieczne jest wykorzystanie

Urządzenie pokazane na ilustracji jest przeznaczone do

Symbol okablowania przedstawiony na diagramie odnosi się do kabla

Aby zwiększyć bezpieczeństwo osobistych danych podczas przeglądania stron internetowych, warto dezaktywować w ustawieniach przeglądarki

Jaka usługa sieciowa domyślnie wykorzystuje port 53?

Która z wymienionych technologii pamięci RAM wykorzystuje oba zbocza sygnału zegarowego do przesyłania danych?

Jaką partycją w systemie Linux jest magazyn tymczasowych danych, gdy pamięć RAM jest niedostępna?

Na podstawie jakiego adresu przełącznik podejmuje decyzję o przesyłaniu ramek?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Liczba 205(10) w zapisie szesnastkowym wynosi

Jakie będą wydatki na zakup kabla UTP kat.5e potrzebnego do stworzenia sieci komputerowej składającej się z 6 stanowisk, przy średniej odległości każdego stanowiska od przełącznika równiej 9m? Należy doliczyć m zapasu dla każdej linii kablowej, a cena za metr kabla wynosi 1,50 zł?

Aby poprawić bezpieczeństwo zasobów sieciowych, administrator sieci komputerowej w firmie otrzymał zadanie podziału aktualnej lokalnej sieci komputerowej na 16 podsieci. Obecna sieć posiada adres IP 192.168.20.0 i maskę 255.255.255.0. Jaką maskę sieci powinien zastosować administrator?

Jak nazywa się topologia fizyczna sieci, która wykorzystuje fale radiowe jako medium transmisyjne?

DB-25 służy jako złącze

Który z poniższych protokołów jest wykorzystywany do uzyskiwania dynamicznych adresów IP?

Organizacja zajmująca się międzynarodową normalizacją, która stworzyła 7-warstwowy Model Referencyjny Połączonych Systemów Otwartych, to

Jakie napięcie jest obniżane z 230 V w zasilaczu komputerowym w standardzie ATX dla różnych podzespołów komputera?

Jaką maksymalną prędkość przesyłania danych osiągają urządzenia zgodne ze standardem 802.11g?

W systemie Linux użycie polecenia passwd Ala spowoduje

Aby uruchomić monitor wydajności oraz niezawodności w systemie Windows, należy skorzystać z przystawki