Pytanie 1

Operacje stałoprzecinkowe w procesorze wykonuje jednostka oznaczona jako

Wynik: 40/40 punktów (100,0%)

Wymagane minimum: 20 punktów (50%)

Operacje stałoprzecinkowe w procesorze wykonuje jednostka oznaczona jako

Symbole: 1U, 2U, 3U stosowane do oznaczenia modułów w szafach typu rack określają

Z przedstawionej dokumentacji pamięci wynika że jest ona przeznaczona do

rodzaj pamięci : SO-DIMM standard : DDR3-1333 (PC3-10600) pojemność pojedynczego modułu : 4 GB |

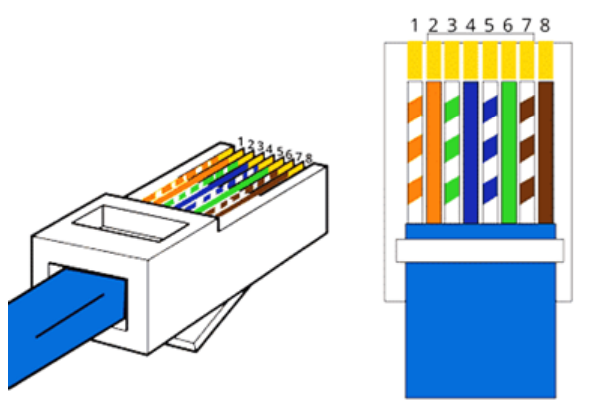

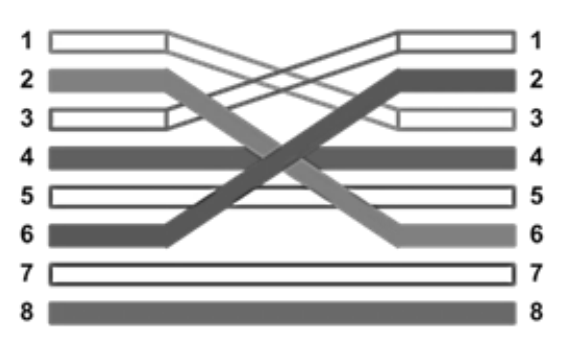

W którym standardzie jest wykonane zakończenie przewodu sieciowego przedstawione na rysunku?

| 1. White Orange | 5. White Blue |

| 2. Orange | 6. Green |

| 3. White Green | 7. White Brown |

| 4. Blue | 8. Brown |

Dokręcenie śrub mocujących z wartością momentu 6 Nm, zgodnie z instrukcją montażową, należy wykonać kluczem

W celu podłączenia monitora do systemu wizualizacji obrazów wymagany jest interfejs Display Port. Ile takich interfejsów posiada karta graficzna przedstawiona na rysunku?

Wybierz narzędzie służące do zamocowania przedstawionej na rysunku końcówki kompresyjnej F na kablu koncentrycznym.

W dokumentacji sieci centralnego monitoringu zapisano, że sieć jest wykonana w standardzie 802.11 Do montażu takiej sieci są wymagane urządzenia wykorzystujące

Podczas wymiany podzespołów elektronicznych czułych na wyładowania elektrostatyczne należy zastosować

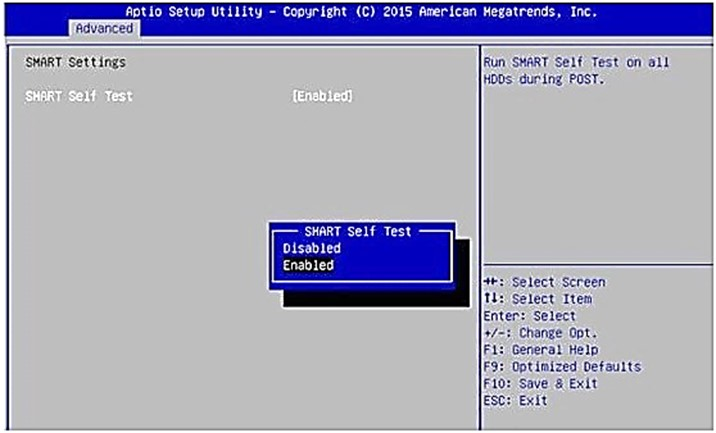

Jaką funkcję pełni przedstawiona na rysunku procedura BIOS?

Który rozdzielacz sygnału należy zastosować w celu wykorzystania jednego przewodu U/UTP5e do podłączenia dwóch urządzeń do sieci LAN?

Za pomocą oscyloskopu nie można zmierzyć bezpośrednio

Usterka programowa uniemożliwia uruchomienie systemu Windows. W celu diagnozy i usunięcia usterki wskazane jest

Podczas pracy z układami elektronicznymi CMOS na stanowisku montażowym należy stosować

Który interfejs nie umożliwia podłączenia urządzeń peryferyjnych w standardzie „plug and play”?

Materiałem eksploatacyjnym w drukarce laserowej jest

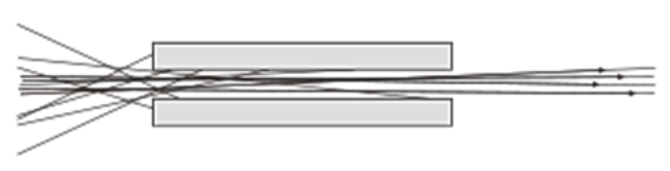

Przedstawiony na rysunku kolimator stanowi część

Przedstawiony na rysunku kabel krosowany jest wykorzystany do połączenia

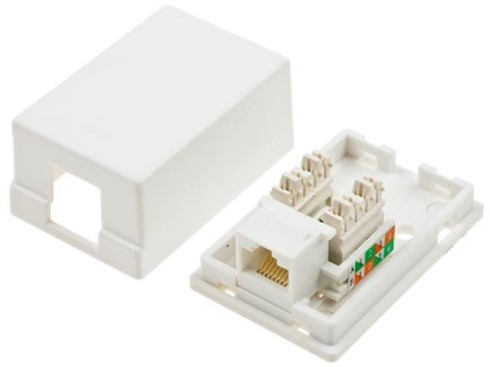

Montaż przewodów w sieciowym gniazdku natynkowym, przedstawionym na rysunku, wykonuje się

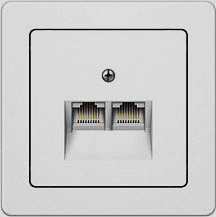

W sieci centralnego monitoringu zamontowane są gniazda przedstawione na rysunku. Jakiego typu wtykami muszą być zakończone kable?

Jakiego typu papier należy zastosować w aparacie elektrokardiograficznym?

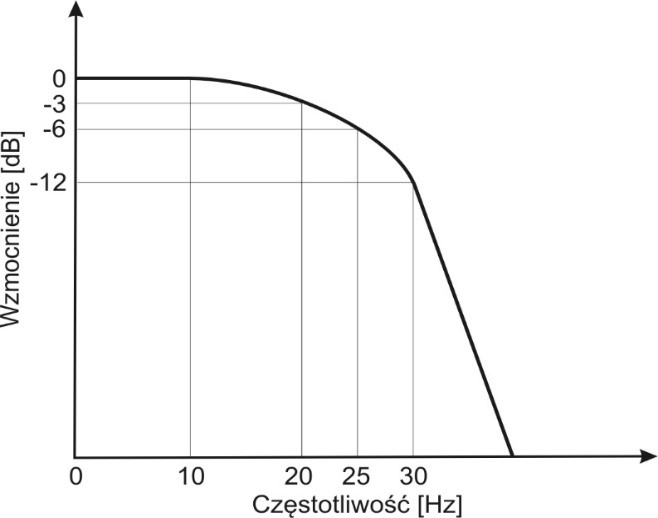

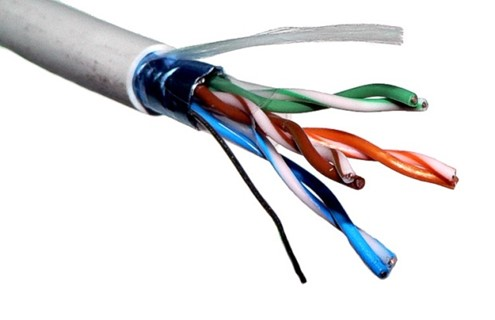

Który typ przewodu przedstawiono na rysunku?

Urządzenie, które w specyfikacji technicznej posiada zapis: „Urządzenie współpracuje z komputerem klasy PC poprzez złącze USB”, należy podłączyć do złącza oznaczonego piktogramem

Technologia OLED znajduje zastosowanie w

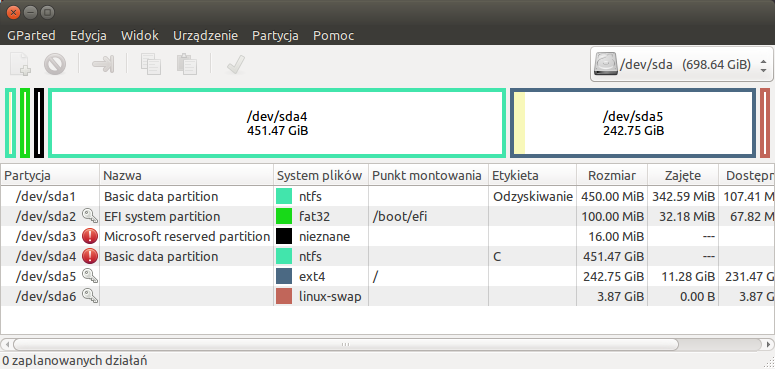

Ile dysków i z jakim interfejsem zostało wykazanych na zrzucie programu GParted?

Sterowniki klawiatury, magistral i przerwań są elementami

W systemie komputerowym przeznaczonym do pracy z dużymi plikami graficznymi należy zwiększyć ilość

Który podzespół komputerowy posiada obudowę o zamieszczonej specyfikacji?

| Specyfikacja obudowy | |

|---|---|

| Obsługiwane gniazda | LGA775 |

| TCASE | 71,4°C |

| Wymiary obudowy | 37,5 mm x 37,5 mm |

| Rozmiar płytki półprzewodnikowej | 214 mm² |

| Liczba tranzystorów płytki półprzewodnikowej | 820 milion |

| Dostępne opcje obniżonej zawartości halogenków | Patrz MDDS |

Który zasilacz pozwala na tymczasowe utrzymanie zasilania akumulatorowego w razie braku zasilania sieciowego?

Który sterownik odpowiada za bezpośredni dostęp do pamięci?

Membrana półprzepuszczalna jest podstawowym elementem

Najważniejszą cechą pamięci operacyjnych serwerowych jest ich niezawodność, dlatego powinny być wyposażone w mechanizm kontroli błędów określany skrótem

Jeżeli procesor graficzny wykonuje także operacje arytmetyczne, oznacza to, że pracuje w architekturze

Wymianą informacji pomiędzy układami znajdującymi się na płycie głównej komputera steruje

Przedstawione na rysunku i opisane w ramce narzędzie służy do ściągania izolacji

| Stripper posiada trzy otwory. Pierwszy pozwala na ściągnięcie płaszcza 250 μm do 125 μm. Drugi otwór przeznaczony jest do ściągania powłoki 900 μm do płaszcza o średnicy 250 μm. Trzeci służy do ściągania powłoki z kabli o średnicy 2 mm ÷ 3 mm do ścisłej tuby o średnicy 900 μm. |

Która magistrala służy do szeregowej transmisji danych?

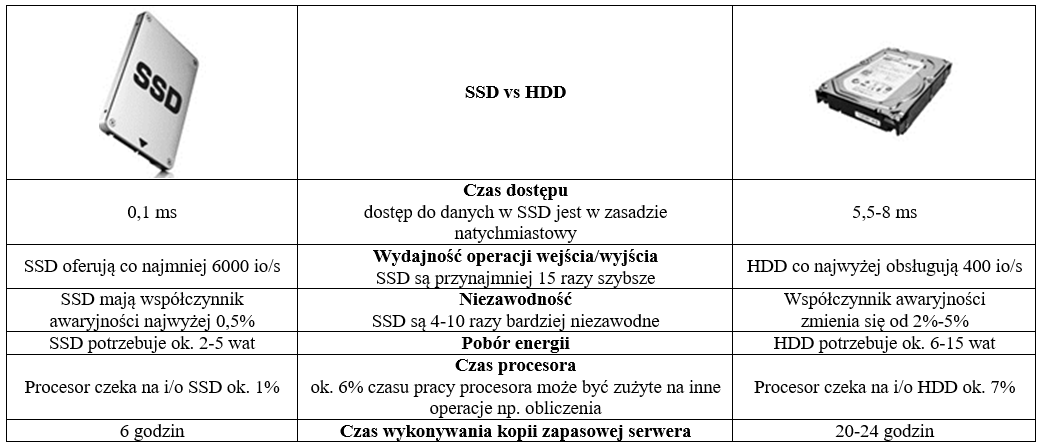

W tabeli zestawiono parametry pamięci półprzewodnikowej i pamięci magnetycznej. Zastosowanie którego rodzaju pamięci umożliwi szybszą pracę komputera?

Którą metodę montażu należy zastosować w celu zakończenia przewodu zasilającego końcówkami przedstawionymi na fotografii?

Na rysunku przedstawiono kartę rozszerzeń umożliwiającą

Który system montażu urządzeń przedstawiono na rysunku?