Pytanie 1

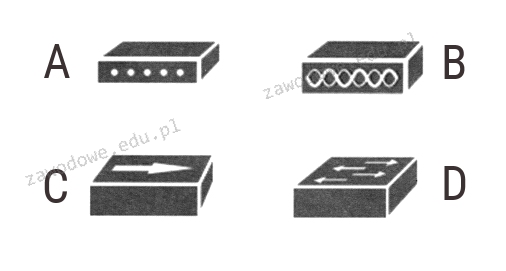

Który symbol reprezentuje przełącznik?

Wynik: 16/40 punktów (40,0%)

Wymagane minimum: 20 punktów (50%)

Który symbol reprezentuje przełącznik?

Rozkaz procesora, przetwarzający informację i zamieniający ją na wynik, należy do grupy rozkazów

W komputerowych stacjach roboczych zainstalowane są karty sieciowe Ethernet 10/100/1000 z interfejsem RJ45. Jakie medium transmisyjne powinno być zastosowane do budowy sieci komputerowej, aby osiągnąć maksymalną przepustowość?

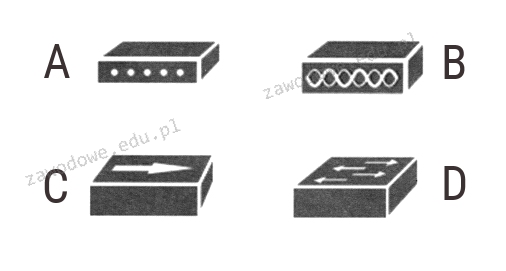

Jakie urządzenie jest używane do mocowania pojedynczych żył kabla miedzianego w złączach?

Określ najprawdopodobniejszą przyczynę pojawienia się komunikatu: CMOS checksum error press F1 to continue press DEL to setup podczas uruchamiania systemu

Wyższą efektywność aplikacji multimedialnych w systemach z rodziny Windows zapewnia technologia

Jaką postać ma liczba dziesiętna 512 w systemie binarnym?

W nagłówku ramki standardu IEEE 802.3, który należy do warstwy łącza danych, znajduje się

Która z konfiguracji RAID opiera się na replikacji danych pomiędzy dwoma lub większą liczbą dysków fizycznych?

Zarządzaniem czasem procesora dla różnych zadań zajmuje się

Który z parametrów twardego dysku NIE ma wpływu na jego wydajność?

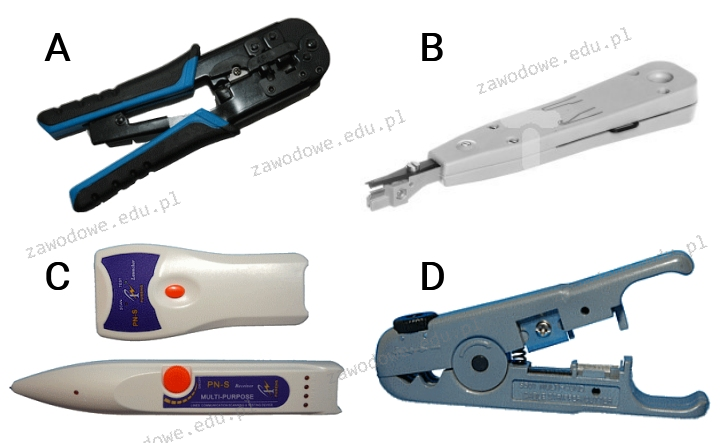

W którym systemie liczbowym zapisano zakresy We/Wy przedstawione na ilustracji?

Wymiana baterii należy do czynności związanych z eksploatacją

W cenniku usług komputerowych znajdują się przedstawione niżej zapisy. Ile będzie wynosił koszt dojazdu serwisanta do klienta mieszkającego poza miastem, w odległości 15 km od siedziby firmy?

Dojazd do klienta na terenie miasta - 25 zł netto

Dojazd do klienta poza miastem - 2 zł netto za każdy km odległości od siedziby firmy liczony w obie strony.

Jaką funkcję pełni mechanizm umożliwiający przechowywanie fragmentów dużych plików programów i danych, które nie mogą być w pełni załadowane do pamięci?

Po podłączeniu działającej klawiatury do któregokolwiek z portów USB nie ma możliwości wyboru awaryjnego trybu uruchamiania systemu Windows. Jednakże, klawiatura funkcjonuje prawidłowo po uruchomieniu systemu w standardowym trybie. Co to sugeruje?

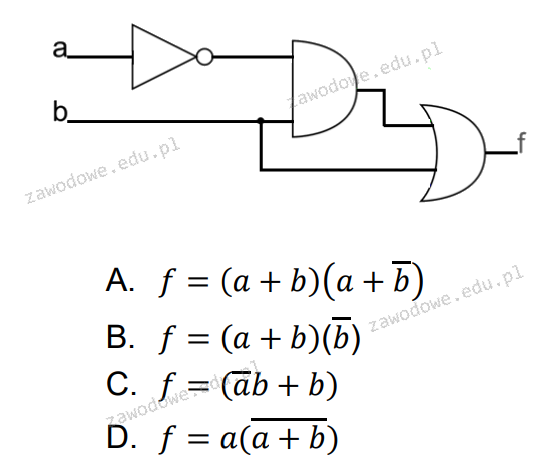

Jaką funkcję wykonuje zaprezentowany układ?

Brak zabezpieczeń przed utratą danych w wyniku fizycznej awarii jednego z dysków to właściwość

Administrator powinien podzielić adres 10.0.0.0/16 na 4 jednorodne podsieci zawierające równą liczbę hostów. Jaką maskę będą miały te podsieci?

Jakie urządzenie należy wykorzystać do zestawienia komputerów w sieci przewodowej o strukturze gwiazdy?

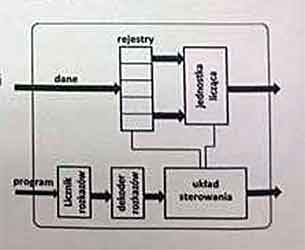

Rejestry widoczne na diagramie procesora mają rolę

Wymianę uszkodzonych kondensatorów karty graficznej umożliwi

SuperPi to aplikacja używana do testowania

Firma świadcząca usługi sprzątania potrzebuje drukować faktury tekstowe w czterech kopiach równocześnie, na papierze samokopiującym. Jaką drukarkę powinna wybrać?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Do usunięcia kurzu z wnętrza obudowy drukarki fotograficznej zaleca się zastosowanie

Podstawowy rekord uruchamiający na dysku twardym to

Jak nazywa się złącze wykorzystywane w sieciach komputerowych, pokazane na zamieszczonym obrazie?

Jakie są zakresy częstotliwości oraz maksymalne prędkości przesyłu danych w standardzie 802.11g WiFi?

Podaj standard interfejsu wykorzystywanego do przewodowego łączenia dwóch urządzeń.

Na płycie głównej uszkodzona została zintegrowana karta sieciowa. Komputer nie ma zainstalowanego dysku twardego ani żadnych innych napędów, takich jak stacja dysków czy CD-ROM. Klient informuje, że w firmowej sieci komputery nie mają napędów, a wszystko "czyta" się z serwera. W celu przywrócenia utraconej funkcji należy zainstalować

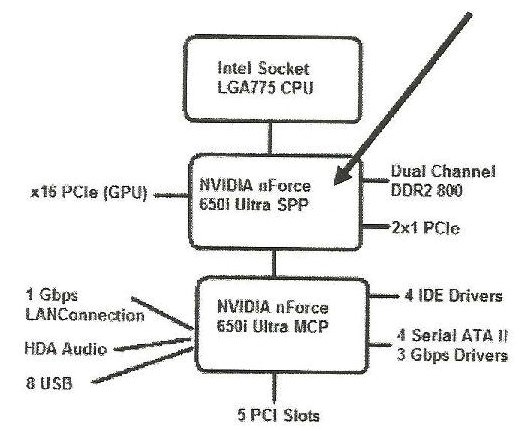

Jaką rolę pełni komponent wskazany strzałką na schemacie chipsetu płyty głównej?

Aby osiągnąć prędkość przesyłania danych 100 Mbps w sieci lokalnej, wykorzystano karty sieciowe działające w standardzie Fast Ethernet, kabel typu UTP o odpowiedniej kategorii oraz przełącznik (switch) zgodny z tym standardem. Taka sieć jest skonstruowana w topologii

Który adres IP posiada maskę w postaci pełnej, zgodną z klasą adresu?

Drukarka do zdjęć ma mocno zabrudzoną obudowę oraz ekran. Aby oczyścić zanieczyszczenia bez ryzyka ich uszkodzenia, należy zastosować

Cienki klient (thin client) to?

Thunderbolt stanowi interfejs

Procesem nieodwracalnym, całkowicie uniemożliwiającym odzyskanie danych z dysku twardego, jest

Aby zwiększyć wydajność komputera, można zainstalować procesor obsługujący technologię Hyper-Threading, która pozwala na

Rodzina adapterów stworzonych w technologii Powerline, pozwalająca na wykorzystanie przewodów elektrycznych w obrębie jednego domu lub mieszkania do przesyłania sygnałów sieciowych, nosi nazwę: