Pytanie 1

W trakcie użytkowania przewodowej myszy optycznej wskaźnik nie reaguje na ruch urządzenia po podkładce, a kursor zmienia swoje położenie dopiero po właściwym ustawieniu myszy. Te symptomy sugerują uszkodzenie

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

W trakcie użytkowania przewodowej myszy optycznej wskaźnik nie reaguje na ruch urządzenia po podkładce, a kursor zmienia swoje położenie dopiero po właściwym ustawieniu myszy. Te symptomy sugerują uszkodzenie

Do zarządzania przydziałami przestrzeni dyskowej w systemach Windows 7 oraz Windows 8 wykorzystywane jest narzędzie

W systemie Windows XP, aby zmienić typ systemu plików z FAT32 na NTFS, należy użyć programu

DB-25 służy jako złącze

Zgodnie z aktualnymi przepisami BHP, odległość oczu od ekranu monitora powinna wynosić

W którym typie macierzy, wszystkie fizyczne dyski są postrzegane jako jeden dysk logiczny?

Adres IP (ang. Internet Protocol Address) to

Zestaw narzędzi do instalacji okablowania miedzianego typu "skrętka" w sieci komputerowej powinien obejmować:

Jakie polecenie trzeba wydać w systemie Windows, aby zweryfikować tabelę mapowania adresów IP na adresy MAC wykorzystywane przez protokół ARP?

Określenie najlepszej trasy dla połączenia w sieci to

W topologii gwiazdy każde urządzenie działające w sieci jest

W jakiej topologii fizycznej sieci każde urządzenie w sieci posiada dokładnie dwa połączenia, jedno z każdym z sąsiadów, a dane są przesyłane z jednego komputera do drugiego w formie pętli?

Który z protokołów powinien być zastosowany do pobierania wiadomości e-mail z własnego serwera?

Który z poniższych adresów IP należy do grupy C?

Sieci lokalne o architekturze klient-serwer cechują się tym, że

Na urządzeniu zasilanym prądem stałym znajduje się wskazane oznaczenie. Co można z niego wywnioskować o pobieranej mocy urządzenia, która wynosi około

Jak skonfigurować dziennik w systemie Windows Server, aby rejestrować zarówno udane, jak i nieudane próby logowania użytkowników oraz działania na zasobach dyskowych?

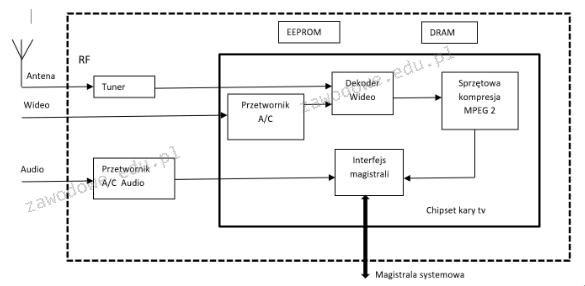

Na ilustracji przedstawiono diagram blokowy karty

Aby zasilić najbardziej wydajne karty graficzne, konieczne jest dodatkowe 6-pinowe gniazdo zasilacza PCI-E, które dostarcza napięcia

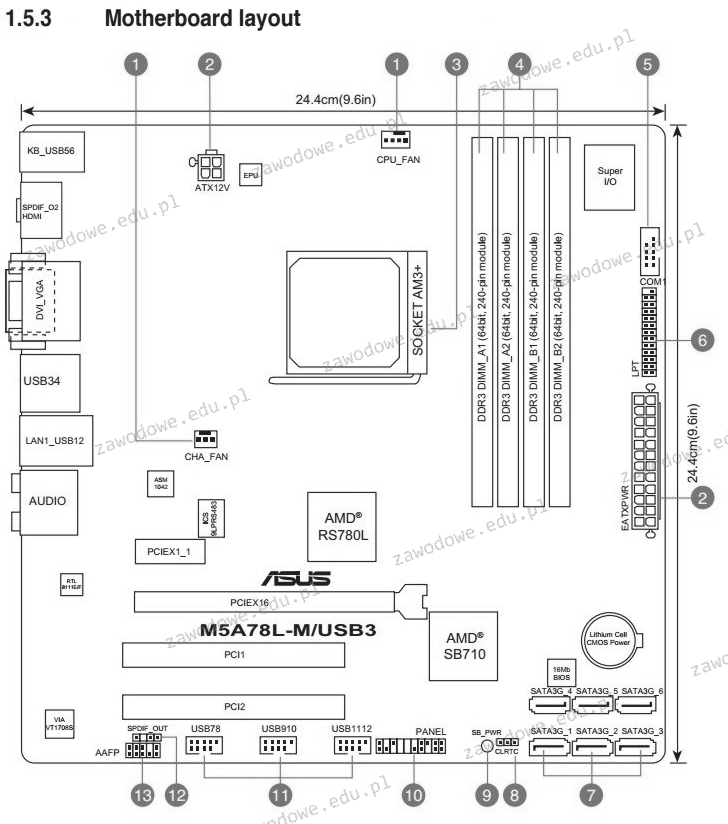

Ile portów USB może być dostępnych w komputerze wyposażonym w tę płytę główną, jeśli nie używa się huba USB ani dodatkowych kart?

Jakie urządzenie służy do pomiaru wartości mocy zużywanej przez komputerowy zestaw?

Najskuteczniejszym sposobem na wykonanie codziennego archiwizowania pojedynczego pliku o wielkości 4,8 GB, na jednym komputerze bez dostępu do Internetu jest

Jakie narzędzie służy do delikatnego wyginania blachy obudowy komputera oraz przykręcania śruby montażowej w miejscach trudno dostępnych?

Włączenie systemu Windows w trybie debugowania umożliwia

Aby zablokować oraz usunąć złośliwe oprogramowanie, takie jak exploity, robaki i trojany, konieczne jest zainstalowanie oprogramowania

Jakie urządzenie umożliwia zwiększenie zasięgu sieci bezprzewodowej?

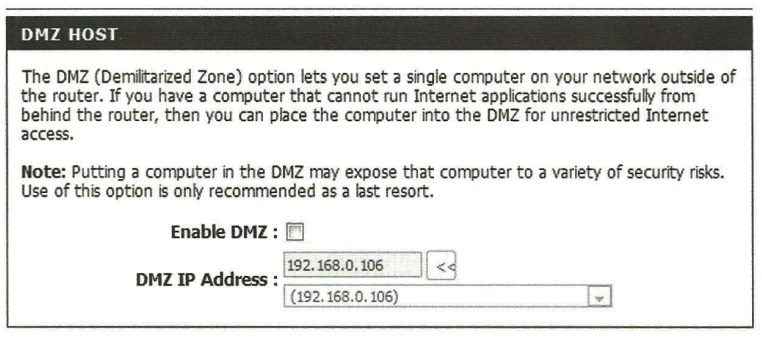

Na ilustracji zaprezentowano zrzut ekranu z ustawień DMZ na routerze. Aktywacja opcji "Enable DMZ" spowoduje, że komputer o adresie IP 192.168.0.106

Urządzenie używane do zestawienia 6 komputerów w sieci lokalnej to:

Oblicz całkowity koszt kabla UTP Cat 6, który będzie użyty do połączenia 5 punktów abonenckich z punktem dystrybucji, mając na uwadze, że średnia odległość pomiędzy każdym punktem abonenckim a punktem dystrybucji wynosi 8 m oraz że cena za 1 m kabla wynosi 1 zł. W obliczeniach uwzględnij zapas 2 m kabla na każdy punkt abonencki.

Gdy użytkownik wpisuje w przeglądarkę internetową adres www.egzamin.pl, nie ma możliwości otwarcia strony WWW, natomiast wprowadzenie adresu 211.0.12.41 umożliwia dostęp do niej. Problem ten spowodowany jest brakiem skonfigurowanego serwera

CommView oraz WireShark to aplikacje wykorzystywane do

Na którym z zewnętrznych nośników danych nie dojdzie do przeniknięcia wirusa podczas przeglądania jego zawartości?

Wskaż symbol, który znajduje się na urządzeniach elektrycznych przeznaczonych do handlu w Unii Europejskiej?

W przypadku awarii którego urządzenia w sieci lokalnej, cała sieć przestaje działać w topologii magistrali?

Technologia procesorów serii Intel Core stosowana w modelach i5, i7 oraz i9, pozwalająca na zwiększenie taktowania w przypadku gdy komputer potrzebuje wyższej mocy obliczeniowej, to

Jakiego narzędzia wraz z parametrami, należy użyć w systemie Windows, aby wyświetlić przedstawione informacje o dysku twardym?

| ST950420AS | |||||||||||||||||||||||||||||||||||||||||||||||

| Identyfikator dysku | : A67B7C06 | ||||||||||||||||||||||||||||||||||||||||||||||

| Typ | : ATA | ||||||||||||||||||||||||||||||||||||||||||||||

| Stan | : Online | ||||||||||||||||||||||||||||||||||||||||||||||

| Ścieżka | : 0 | ||||||||||||||||||||||||||||||||||||||||||||||

| Element docelowy | : 0 | ||||||||||||||||||||||||||||||||||||||||||||||

| Identyfikator jednostki LUN | : 0 | ||||||||||||||||||||||||||||||||||||||||||||||

| Ścieżka lokalizacji | : PCIROOT(0)#ATA(C00T00L00) | ||||||||||||||||||||||||||||||||||||||||||||||

| Bieżący stan tylko do odczytu | : Nie | ||||||||||||||||||||||||||||||||||||||||||||||

| Tylko do odczytu | : Nie | ||||||||||||||||||||||||||||||||||||||||||||||

| Rozruchowy | : Tak | ||||||||||||||||||||||||||||||||||||||||||||||

| Dysk plików stronicowania | : Tak | ||||||||||||||||||||||||||||||||||||||||||||||

| Dysk plików hibernacji | : Nie | ||||||||||||||||||||||||||||||||||||||||||||||

| Dysk zrzutów awaryjnych | : Tak | ||||||||||||||||||||||||||||||||||||||||||||||

| Dysk klastrowany | : Nie | ||||||||||||||||||||||||||||||||||||||||||||||

| |||||||||||||||||||||||||||||||||||||||||||||||

Użytkownik chce zabezpieczyć mechanicznie dane na karcie pamięci przed przypadkowym skasowaniem. Takie zabezpieczenie umożliwia karta

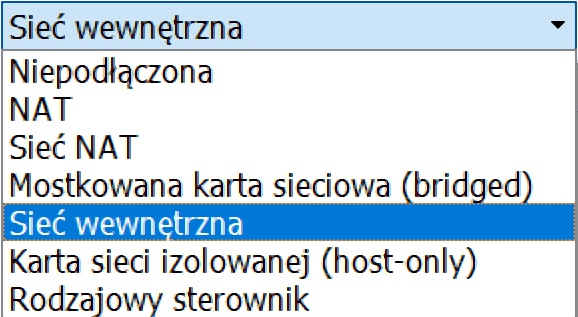

Na ilustracji przedstawiono opcje karty sieciowej w oprogramowaniu VirtualBox. Ustawienie na wartość sieć wewnętrzna, spowoduje, że

Które dwa urządzenia sieciowe CISCO wyposażone w moduły z portami smart serial można połączyć przy użyciu kabla szeregowego?

Usługa RRAS serwera Windows 2019 jest przeznaczona do