Pytanie 1

Ile bitów minimum będzie wymaganych w systemie binarnym do zapisania liczby szesnastkowej 110ₕ?

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Ile bitów minimum będzie wymaganych w systemie binarnym do zapisania liczby szesnastkowej 110ₕ?

Głównym celem realizowanej przez program antywirusowy funkcji ochrony przed ransomware jest zapewnienie zabezpieczenia systemu przed zagrożeniami

Jakie oprogramowanie jest używane do archiwizacji danych w systemie Linux?

Aby możliwe było skierowanie wydruku na twardy dysk, konieczne jest w ustawieniach drukarki wybranie opcji drukowania do portu

Zasilacz UPS o mocy rzeczywistej 480 W nie jest przeznaczony do podłączenia

Wskaż urządzenie wyjścia.

Podczas próby zapisania danych na karcie SD wyświetla się komunikat „usuń ochronę przed zapisem lub skorzystaj z innego nośnika”. Najczęstszą przyczyną takiego komunikatu jest

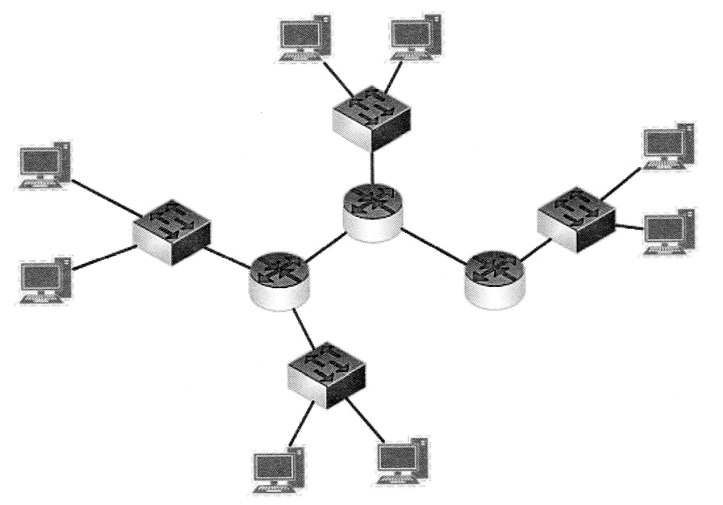

Ile symboli routerów i przełączników występuje na diagramie?

W jakim typie skanera stosuje się fotopowielacze?

Jaką standardową wartość maksymalnej odległości można zastosować pomiędzy urządzeniami sieciowymi, które są ze sobą połączone przewodem UTP kat.5e?

W systemie Windows konto użytkownika można założyć za pomocą polecenia

Na ilustracji przedstawiony jest tylny panel jednostki komputerowej. Jakie jest nazewnictwo dla złącza oznaczonego strzałką?

Jakie polecenie w środowisku Linux pozwala na modyfikację uprawnień dostępu do pliku lub katalogu?

Osoba korzystająca z lokalnej sieci musi mieć możliwość dostępu do dokumentów umieszczonych na serwerze. W tym celu powinna

Jakie urządzenie sieciowe funkcjonuje w warstwie fizycznej modelu ISO/OSI, transmitując sygnał z jednego portu do wszystkich pozostałych portów?

Jaką częstotliwość odświeżania należy ustawić, aby obraz na monitorze był odświeżany 85 razy na sekundę?

Funkcja failover usługi DHCP umożliwia

FDDI (ang. Fiber Distributed Data Interface) jest standardem przesyłania danych opartym na technologii światłowodowej. Jaką topologię wykorzystuje się w sieciach zbudowanych według tej technologii?

AES (ang. Advanced Encryption Standard) to standard szyfrowania, który?

Który podzespół nie jest kompatybilny z płytą główną MSI A320M Pro-VD-S socket AM4, 1 x PCI-Ex16, 2 x PCI-Ex1, 4 x SATA III, 2 x DDR4- max 32 GB, 1 x D-SUB, 1x DVI-D, ATX?

Topologia fizyczna sieci komputerowej przedstawiona na ilustracji to topologia

Jaka jest prędkość przesyłania danych w standardzie 1000Base-T?

Jakie są korzyści płynące z użycia systemu plików NTFS?

Podczas testowania połączeń sieciowych za pomocą polecenia ping użytkownik otrzymał wyniki przedstawione na rysunku. Jakie może być źródło braku odpowiedzi serwera przy pierwszym teście, zakładając, że domena wp.pl ma adres 212.77.100.101?

C:\Users\uczen>ping wp.pl

Żądanie polecenia ping nie może znaleźć hosta wp.pl. Sprawdź nazwę i ponów próbe.

C:\Users\uczen>ping 212.77.100.101

Badanie 212.77.100.101 z 32 bajtami danych:

Odpowiedź z 212.77.100.101: bajtów=32 czas=19ms TTL=127

Odpowiedź z 212.77.100.101: bajtów=32 czas=35ms TTL=127

Odpowiedź z 212.77.100.101: bajtów=32 czas=40ms TTL=127

Odpowiedź z 212.77.100.101: bajtów=32 czas=20ms TTL=127

Statystyka badania ping dla 212.77.100.101:

Pakiety: Wysłane = 4, Odebrane = 4, Utracone = 0

(0% straty),

Szacunkowy czas błądzenia pakietów w millisekundach:

Minimum = 19 ms, Maksimum = 40 ms, Czas średni = 28 msPodaj właściwy sposób zapisu liczby -1210 w metodzie znak-moduł na ośmiobitowej liczbie binarnej.

Gdy system operacyjny laptopa działa normalnie, na ekranie wyświetla się komunikat o konieczności sformatowania wewnętrznego dysku twardego. Może to sugerować

Jakie urządzenie stosuje się do pomiaru rezystancji?

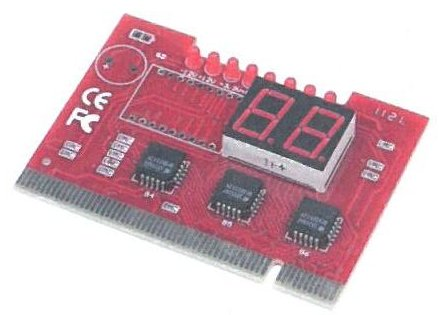

Na ilustracji zaprezentowano

Który z protokołów funkcjonuje w warstwie aplikacji modelu ISO/OSI, umożliwiając wymianę informacji kontrolnych między urządzeniami sieciowymi?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Który system plików powinien być wybrany podczas instalacji Linuxa, aby umożliwić ustalanie uprawnień dla plików i katalogów?

Metoda przesyłania danych między urządzeniem CD/DVD a pamięcią komputera w trybie bezpośredniego dostępu do pamięci to

Złącze SC powinno być zainstalowane na przewodzie

Podczas pracy dysk twardy wydaje stukanie, a uruchamianie systemu oraz odczyt danych są znacznie spowolnione. W celu naprawienia tej awarii, po wykonaniu kopii zapasowej danych na zewnętrznym nośniku należy

Taśma drukarska stanowi kluczowy materiał eksploatacyjny w przypadku drukarki

Aby sygnały pochodzące z dwóch routerów w sieci WiFi pracującej w standardzie 802.11g nie wpływały na siebie nawzajem, należy skonfigurować kanały o numerach

Jakie zagrożenia eliminują programy antyspyware?

Jak na diagramach sieciowych LAN oznaczane są punkty dystrybucyjne znajdujące się na różnych kondygnacjach budynku, zgodnie z normą PN-EN 50173?

Którego wbudowanego narzędzia w systemie Windows 8 Pro można użyć do szyfrowania danych?

Za co odpowiada protokół DNS?