Pytanie 1

W którym z rejestrów wewnętrznych procesora są przechowywane dodatkowe informacje o wyniku realizowanej operacji?

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

W którym z rejestrów wewnętrznych procesora są przechowywane dodatkowe informacje o wyniku realizowanej operacji?

ACPI to interfejs, który umożliwia

Jaki port na tylnym panelu płyty głównej jest w dokumentacji określany jako port zgodny z normą RS232C?

Program, który nie jest przeznaczony do analizy stanu komputera to

Jakiego typu rozbudowa serwera wymaga zainstalowania dodatkowych sterowników?

W systemie Linux polecenie chmod 321 start spowoduje przyznanie poniższych uprawnień plikowi start:

Aby skopiować folder c:\test wraz ze wszystkimi podfolderami na przenośny dysk f:\ w systemie Windows 7, jakie polecenie należy zastosować?

Urządzeniem peryferyjnym pokazanym na ilustracji jest skaner biometryczny, który wykorzystuje do identyfikacji

Aby system operacyjny był skutecznie chroniony przed atakami złośliwego oprogramowania, po zainstalowaniu programu antywirusowego należy

Na przedstawionym panelu tylnym płyty głównej znajdują się między innymi następujące interfejsy:

Aby zapewnić, że komputer uzyska od serwera DHCP określony adres IP, należy na serwerze zdefiniować

Dysk twardy podczas pracy stuka i można zaobserwować bardzo powolne uruchamianie systemu oraz odczytywanie danych. Aby naprawić tę usterkę, po zabezpieczeniu danych na nośniku zewnętrznym należy

Jakie urządzenie umożliwia zwiększenie zasięgu sieci bezprzewodowej?

Zgodnie z zamieszczonym cennikiem, średni koszt wyposażenia stanowiska komputerowego wynosi:

| Nazwa sprzętu | Cena minimalna | Cena maksymalna |

|---|---|---|

| Jednostka centralna | 1300,00 zł | 4550,00 zł |

| Monitor | 650,00 zł | 2000,00 zł |

| Klawiatura | 28,00 zł | 100,00 zł |

| Myszka | 22,00 zł | 50,00 zł |

Można przywrócić pliki z kosza, korzystając z polecenia

ARP (Address Resolution Protocol) to protokół, który pozwala na konwersję

Jakiego rodzaju złącze powinna mieć płyta główna, aby użytkownik był w stanie zainstalować kartę graficzną przedstawioną na rysunku?

Jaki rodzaj dysków jest podłączany do złącza IDE na płycie głównej komputera?

Użytkownicy sieci Wi-Fi zauważyli zakłócenia oraz częste przerwy w połączeniu. Przyczyną tej sytuacji może być

Internet Relay Chat (IRC) to protokół wykorzystywany do

Którego z poniższych zadań nie wykonują serwery plików?

Wartości 1001 i 100 w pliku /etc/passwd wskazują na

| student:x:1001:100:Jan Kowalski:/home/student:/bin/bash |

Najwyższy stopień zabezpieczenia sieci bezprzewodowej zapewnia szyfrowanie

Nazwa protokołu, który pozwala na konwersję 32-bitowych adresów IP na 48-bitowe fizyczne adresy MAC w sieciach Ethernet, to:

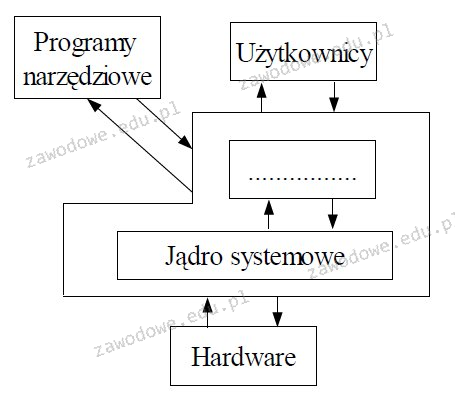

Jaki termin powinien zostać umieszczony w miejscu z kropkami na schemacie blokowym przedstawiającym strukturę systemu operacyjnego?

Jakie polecenie w systemie Linux służy do przypisania adresu IP oraz maski podsieci dla interfejsu eth0?

Jakie narzędzie jest najbardziej odpowiednie do delikatnego zgięcia blachy obudowy komputera oraz przykręcenia śruby montażowej w trudno dostępnej lokalizacji?

Interfejs SATA 2 (3Gb/s) oferuje prędkość transferu

Jaka jest maksymalna liczba hostów, które można przypisać w sieci o adresie IP klasy B?

Jaki protokół umożliwia nawiązywanie szyfrowanych połączeń terminalowych z zdalnym komputerem?

Który z rekordów DNS w systemach Windows Server służy do definiowania aliasu (alternatywnej nazwy) dla rekordu A, powiązanego z kanoniczną nazwą hosta?

Jaką minimalną ilość pamięci RAM powinien posiadać komputer, aby możliwe było zainstalowanie 32-bitowego systemu operacyjnego Windows 7 i praca w trybie graficznym?

Aby uruchomić edytor rejestru w systemie Windows, należy skorzystać z narzędzia

Jaki protokół stosują komputery, aby informować router o zamiarze dołączenia lub opuszczenia konkretnej grupy rozgłoszeniowej?

Jaką funkcję serwera z grupy Windows Server trzeba dodać, aby serwer mógł realizować usługi rutingu?

Która z anten charakteryzuje się najwyższym zyskiem energetycznym oraz pozwala na nawiązywanie połączeń na dużą odległość?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Który z protokołów nie działa w warstwie aplikacji modelu ISO/OSI?

W komputerach stacjonarnych zamontowane są karty sieciowe Ethernet 10/100/1000 z gniazdem RJ45. Jakie medium transmisyjne powinno się zastosować w celu zbudowania sieci komputerowej zapewniającej najwyższą przepustowość?

Atak DDoS (z ang. Distributed Denial of Service) na serwer może spowodować