Pytanie 1

Aby uzyskać na ekranie monitora odświeżanie obrazu 85 razy w ciągu sekundy, trzeba częstotliwość jego odświeżania ustawić na

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Aby uzyskać na ekranie monitora odświeżanie obrazu 85 razy w ciągu sekundy, trzeba częstotliwość jego odświeżania ustawić na

Jak nazywa się proces dodawania do danych z warstwy aplikacji informacji powiązanych z protokołami funkcjonującymi na różnych poziomach modelu sieciowego?

W nowoczesnych panelach dotykowych prawidłowe działanie wyświetlacza zapewnia mechanizm rozpoznający zmianę

W ustawieniach haseł w systemie Windows Server została dezaktywowana możliwość wymogu dotyczącego złożoności hasła. Z jakiej minimalnej liczby znaków powinno składać się hasło użytkownika?

Awaria drukarki igłowej może być spowodowana uszkodzeniem

Który protokół należy do bezpołączeniowych protokołów warstwy transportowej?

Które z metod szyfrowania wykorzystywanych w sieciach bezprzewodowych jest najsłabiej zabezpieczone przed łamaniem haseł?

Jaką klasę adresów IP reprezentuje publiczny adres 130.140.0.0?

Jaką rolę pełni serwer FTP?

Jakim poleceniem w systemie Linux można utworzyć nowych użytkowników?

Który z podanych adresów protokołu IPv4 jest adresem klasy D?

Wskaż zdanie, które jest nieprawdziwe:

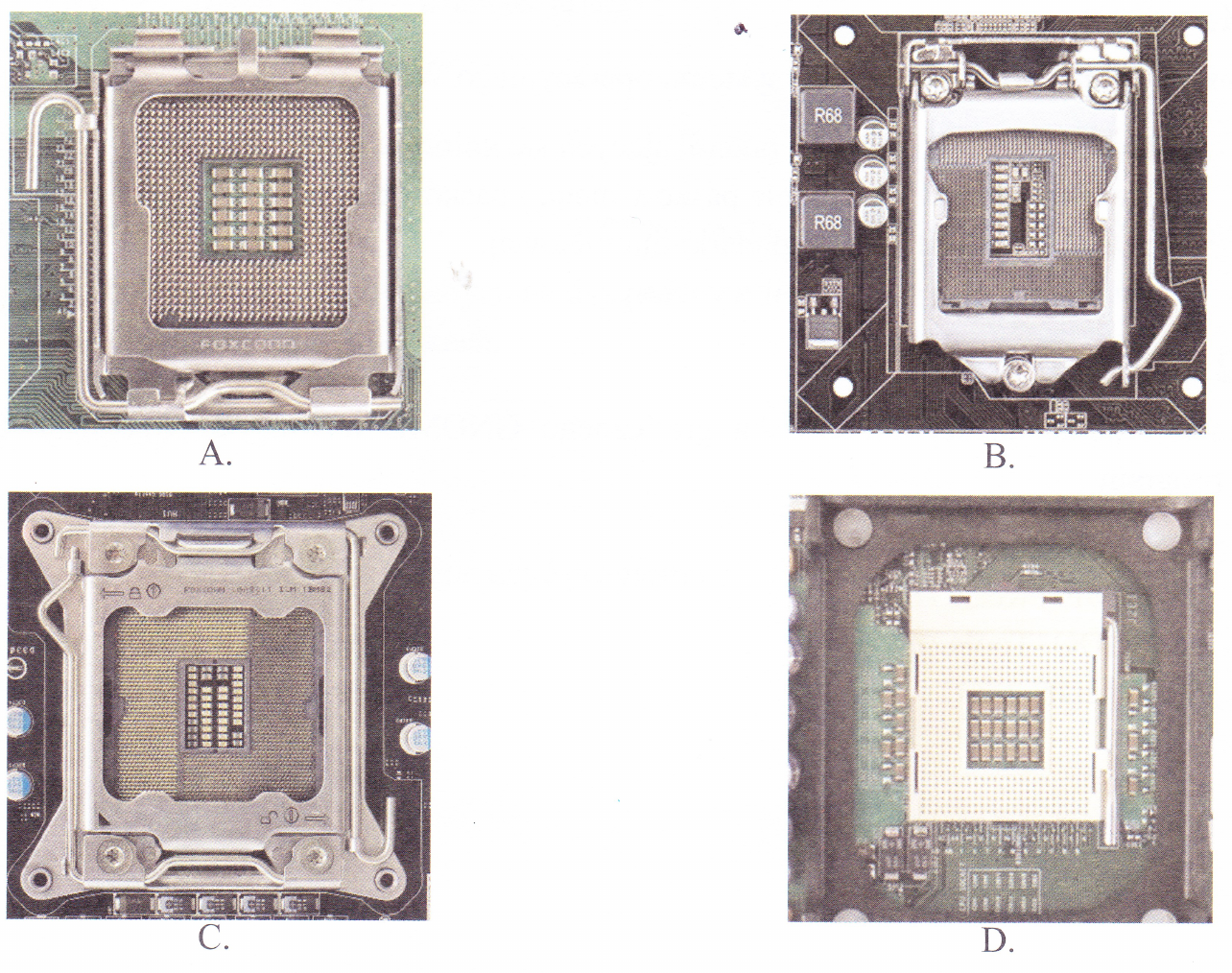

W jakim gnieździe należy umieścić procesor INTEL CORE i3-4350- 3.60 GHz, x2/4, 4MB, 54W, HD 4600, BOX, s-1150?

Aby zmierzyć tłumienie światłowodowego łącza w dwóch zakresach długości fal 1310 nm i 1550 nm, należy zastosować

Wykonanie komendy dxdiag w systemie Windows pozwala na

Jakie narzędzie chroni komputer przed niechcianym oprogramowaniem pochodzącym z sieci?

Które wbudowane narzędzie systemu Windows pozwala rozwiązywać problemy z błędnymi sektorami i integralnością plików?

Jaką topologię fizyczną sieci komputerowej przedstawia rysunek?

W systemie Linux komenda chown pozwala na

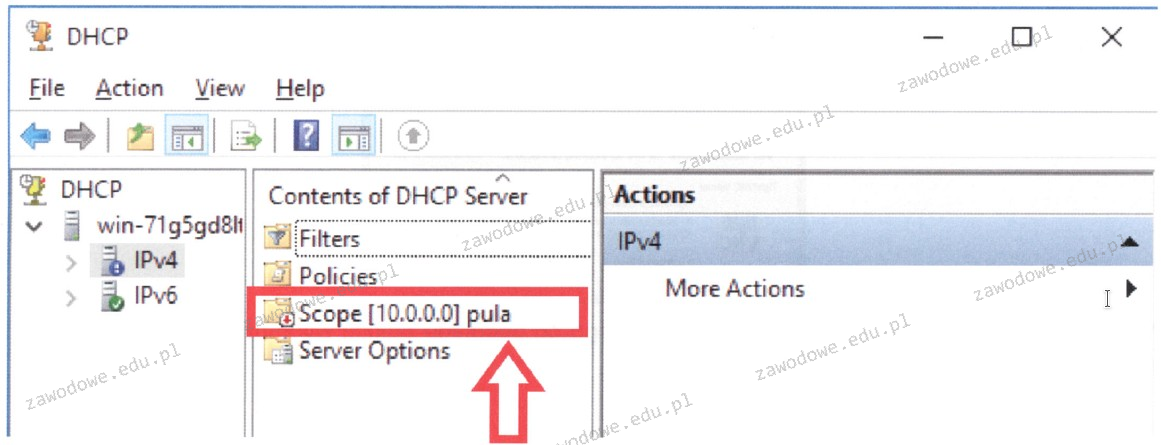

W systemie serwerowym Windows widoczny jest zakres adresów IPv4. Ikona umieszczona obok jego nazwy sugeruje, że

Zestaw komputerowy, który został przedstawiony, jest niepełny. Który z elementów nie został wymieniony w tabeli, a jest kluczowy dla prawidłowego funkcjonowania zestawu?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Zalman Obudowa R1 Midi Tower bez PSU, USB 3.0 |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, BOX |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Jakie napięcie jest dostarczane przez płytę główną do pamięci typu SDRAM DDR3?

Gdzie w dokumencie tekstowym Word umieszczony jest nagłówek oraz stopka?

Które polecenie pozwala na mapowanie zasobów sieciowych w systemie Windows Serwer?

Do wykonania końcówek kabla UTP wykorzystuje się wtyczkę

Wskaż adresy podsieci, które powstaną po podziale sieci o adresie 172.16.0.0/22 na 4 równe podsieci.

Thunderbolt to interfejs

Które z kont nie jest standardowym w Windows XP?

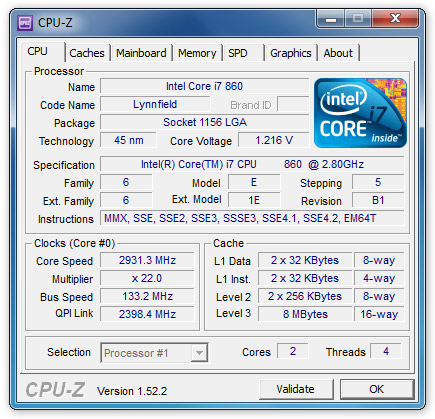

W dokumentacji technicznej procesora producent umieścił wyniki testu, który został wykonany przy użyciu programu CPU-Z. Z tych danych wynika, że procesor dysponuje

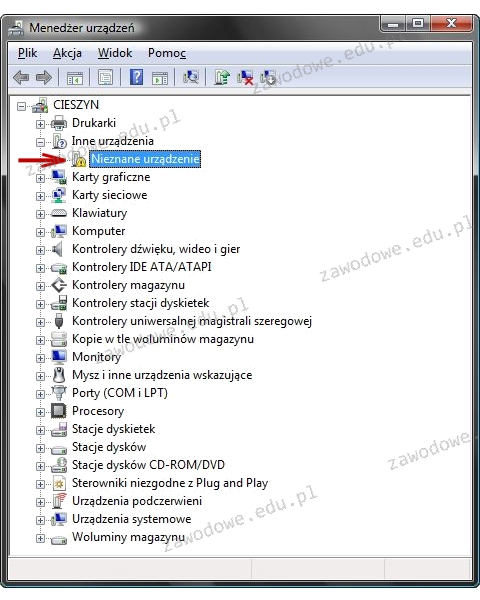

Ikona z wykrzyknikiem, pokazana na ilustracji, która pojawia się obok nazwy sprzętu w Menedżerze urządzeń, wskazuje, że to urządzenie

Który z profili w systemie Windows umożliwia migrację ustawień konta pomiędzy stacjami roboczymi?

Czym jest skrót MAN w kontekście sieci?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Dysk znajdujący się w komputerze ma zostać podzielony na partycje. Jaką maksymalną liczbę partycji rozszerzonych można utworzyć na jednym dysku?

W dokumentacji powykonawczej dotyczącej fizycznej oraz logicznej struktury sieci lokalnej powinny być zawarte

Cookie to plik

Rodzajem złośliwego oprogramowania będącego programem rezydentnym, który działa, wykonując konkretną operację, nie powiela się przez sieć, a jedną z jego metod jest samoreplikacja aż do wyczerpania pamięci komputera, jest

Liczba szesnastkowa 1E2F₍₁₆₎ zapisana w systemie ósemkowym ma postać

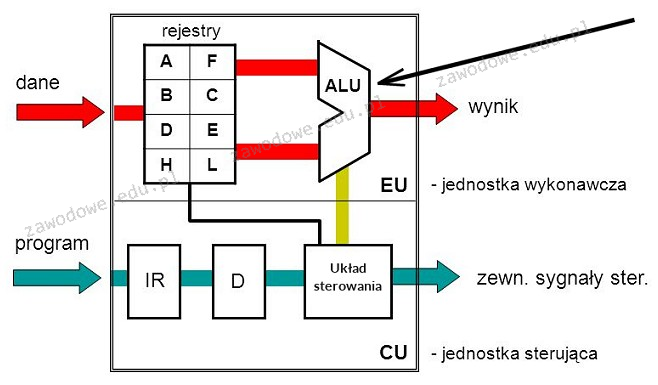

Na diagramie mikroprocesora blok wskazany strzałką pełni rolę

Jaki pakiet powinien zostać zainstalowany na serwerze Linux, aby umożliwić stacjom roboczym z systemem Windows dostęp do plików i drukarek udostępnianych przez ten serwer?