Pytanie 1

Jaką liczbę punktów abonenckich (2 x RJ45) zgodnie z wytycznymi normy PN-EN 50167 powinno się zainstalować w biurze o powierzchni 49 m2?

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Jaką liczbę punktów abonenckich (2 x RJ45) zgodnie z wytycznymi normy PN-EN 50167 powinno się zainstalować w biurze o powierzchni 49 m2?

Jakiego rodzaju rekord jest automatycznie generowany w chwili zakupu strefy wyszukiwania do przodu w ustawieniach serwera DNS w systemach Windows Server?

Transmisję danych bezprzewodowo realizuje interfejs

Która topologia fizyczna umożliwia nadmiarowe połączenia pomiędzy urządzeniami w sieci?

Jakie narzędzie chroni komputer przed niechcianym oprogramowaniem pochodzącym z sieci?

Do jakiego pomiaru wykorzystywany jest watomierz?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

W topologii fizycznej w kształcie gwiazdy, wszystkie urządzenia działające w sieci są

Zintegrowana karta sieciowa na płycie głównej uległa awarii. Komputer nie może załadować systemu operacyjnego, ponieważ brakuje zarówno dysku twardego, jak i napędów optycznych, a system operacyjny jest uruchamiany z lokalnej sieci. W celu przywrócenia utraconej funkcjonalności, należy zainstalować w komputerze

Jaki akronim oznacza program do tworzenia graficznych wykresów ruchu, który odbywa się na interfejsach urządzeń sieciowych?

Aby uruchomić edytor rejestru w systemie Windows, należy skorzystać z narzędzia

Aby zapobiec uszkodzeniu układów scalonych, podczas konserwacji sprzętu komputerowego należy używać

Jaką funkcjonalność oferuje program tar?

Jak nazywa się urządzenie wskazujące, które współpracuje z monitorami CRT i ma końcówkę z elementem światłoczułym, a jego dotknięcie ekranu monitora skutkuje przesłaniem sygnału do komputera, co umożliwia lokalizację kursora?

Która z licencji pozwala na darmowe korzystanie z programu, pod warunkiem, że użytkownik zadba o ekologię?

Ustanowienie połączenia pomiędzy dwoma oddalonymi hostami za pomocą publicznej sieci, takiej jak Internet, w sposób, że węzły tej sieci nie wpływają na przesyłane pakiety, to

Urządzeniem, które przekształca otrzymane ramki w sygnały przesyłane później w sieci komputerowej, jest

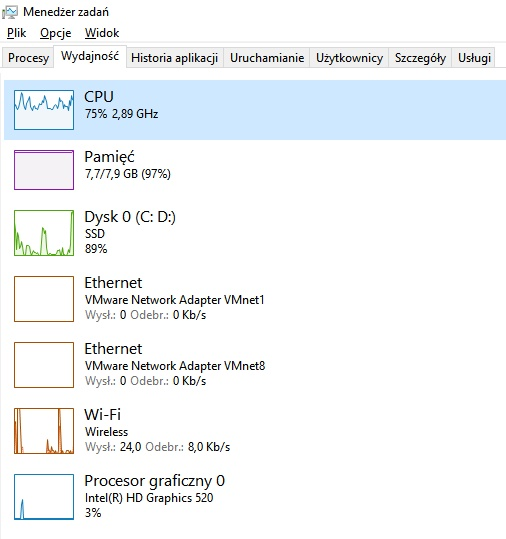

Grafik komputerowy sygnalizuje bardzo wolną pracę komputera. Z ilustracji przedstawiającej okno wydajności komputera wynika, że przyczyną tego może być

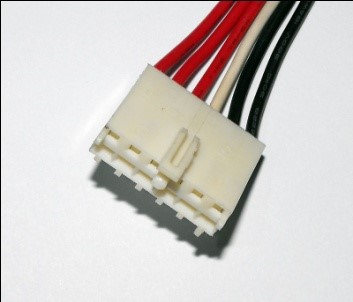

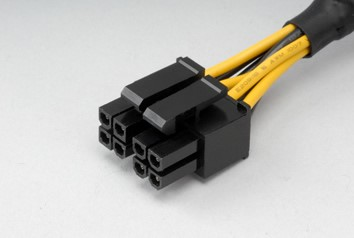

Wskaż wtyk zasilający, który podczas montażu zestawu komputerowego należy podłączyć do napędu optycznego.

Aby chronić systemy sieciowe przed zewnętrznymi atakami, należy zastosować

Pamięć podręczna Intel Smart Cache, która znajduje się w procesorach wielordzeniowych, takich jak Intel Core Duo, to pamięć

Czym jest kopia różnicowa?

Jakim adresem IPv6 charakteryzuje się autokonfiguracja łącza?

Zidentyfikowanie głównego rekordu rozruchowego, który uruchamia system z aktywnej partycji, jest możliwe dzięki

Rodzajem pamięci RAM, charakteryzującym się minimalnym zużyciem energii, jest

Jakie narzędzie w systemie Windows umożliwia kontrolę prób logowania do systemu?

Ustawienia przedstawione na diagramie dotyczą

W którym trybie działania procesora Intel x86 uruchamiane były aplikacje 16-bitowe?

Funkcja narzędzia tracert w systemach Windows polega na

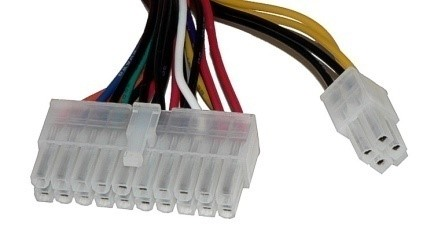

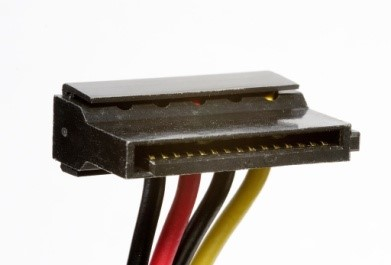

Dysk twardy IDE wewnętrzny jest zasilany przez połączenie typu

W biurze należy zamontować 5 podwójnych gniazd abonenckich. Średnia odległość od lokalnego punktu dystrybucyjnego do gniazda abonenckiego wynosi 10m. Jaki będzie przybliżony koszt zakupu kabla UTP kategorii 5e do utworzenia sieci lokalnej, jeśli cena brutto za 1m kabla UTP kategorii 5e wynosi 1,60 zł?

Jakie polecenie powinien wydać root w systemie Ubuntu Linux, aby przeprowadzić aktualizację wszystkich pakietów (całego systemu) do najnowszej wersji z zainstalowaniem nowego jądra?

Który z poniższych protokołów reprezentuje protokół warstwy aplikacji w modelu ISO/OSI?

Które polecenie systemu Linux wyświetla czas pracy systemu oraz jego średnie obciążenie?

W systemie Windows, po dezaktywacji domyślnego konta administratora i ponownym uruchomieniu komputera

Jakie urządzenie sieciowe powinno zastąpić koncentrator, aby podzielić sieć LAN na cztery odrębne domeny kolizji?

Liczba 45(H) przedstawiona w systemie ósemkowym jest równa

Funkcja diff w systemie Linux pozwala na

Który z poniższych adresów stanowi adres rozgłoszeniowy dla sieci 172.16.64.0/26?

W tablecie graficznym bez wyświetlacza pióro nie ustala położenia kursora ekranowego, można jedynie korzystać z jego końcówki do przesuwania kursora ekranowego oraz klikania. Wskaż możliwą przyczynę nieprawidłowej pracy urządzenia.