Pytanie 1

Co nie ma wpływu na utratę danych z dysku HDD?

Wynik: 38/40 punktów (95,0%)

Wymagane minimum: 20 punktów (50%)

Co nie ma wpływu na utratę danych z dysku HDD?

Zestaw komputerowy, który został przedstawiony, jest niepełny. Który z elementów nie został wymieniony w tabeli, a jest kluczowy dla prawidłowego funkcjonowania zestawu?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Zalman Obudowa R1 Midi Tower bez PSU, USB 3.0 |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, BOX |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Która norma odnosi się do okablowania strukturalnego?

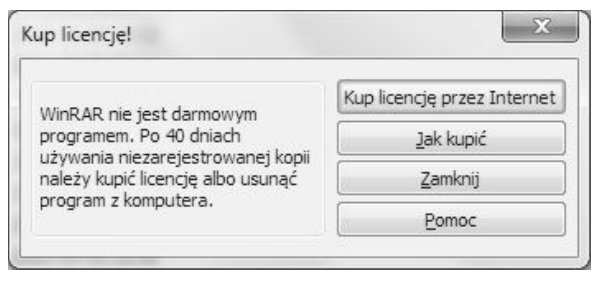

Program WinRAR pokazał okno informacyjne widoczne na ilustracji. Jakiego rodzaju licencją posługiwał się do tej pory użytkownik?

W których nośnikach pamięci masowej jedną z najczęstszych przyczyn uszkodzeń jest uszkodzenie powierzchni?

Komunikat biosu POST od firmy Award o treści "Display switch is set incorrectly" sugeruje

Plik ma wielkość 2 KiB. Co to oznacza?

Rejestr procesora, znany jako licznik rozkazów, przechowuje

Po zainstalowaniu systemu Linux, użytkownik pragnie skonfigurować kartę sieciową poprzez wprowadzenie ustawień dotyczących sieci. Jakie działanie należy podjąć, aby to osiągnąć?

Tusz żelowy wykorzystywany jest w drukarkach

Jaką postać ma liczba dziesiętna 512 w systemie binarnym?

Jaką konfigurację sieciową powinien mieć komputer, który jest częścią tej samej sieci LAN co komputer z adresem 10.8.1.10/24?

Do automatycznej synchronizacji dokumentów redagowanych przez kilka osób w tym samym czasie, należy użyć

Norma EN 50167 odnosi się do rodzaju okablowania

Aby użytkownik systemu Linux mógł sprawdzić zawartość katalogu, wyświetlając pliki i katalogi, oprócz polecenia ls może skorzystać z polecenia

Programy antywirusowe mogą efektywnie zabezpieczać komputer. Istotne jest, aby wybrać możliwość uruchamiania aplikacji razem z komputerem oraz opcję

Aktywacja opcji Udostępnienie połączenia internetowego w systemie Windows powoduje automatyczne przydzielanie adresów IP dla komputerów (hostów) z niej korzystających. W tym celu używana jest usługa

W systemie Linux istnieją takie prawa dostępu do konkretnego pliku rwxr--r--. Jakie polecenie użyjemy, aby zmienić je na rwxrwx---?

Zasada dostępu do medium CSMA/CA jest wykorzystywana w sieci o specyfikacji

Interfejs SLI (ang. Scalable Link Interface) jest używany do łączenia

Jakie medium transmisyjne w sieciach LAN rekomenduje się do użycia w historycznych obiektach?

Transmisja danych typu półduplex to transmisja

Użytkownik uszkodził płytę główną z gniazdem procesora AM2. Uszkodzoną płytę można zastąpić, bez konieczności wymiany procesora i pamięci, modelem z gniazdem

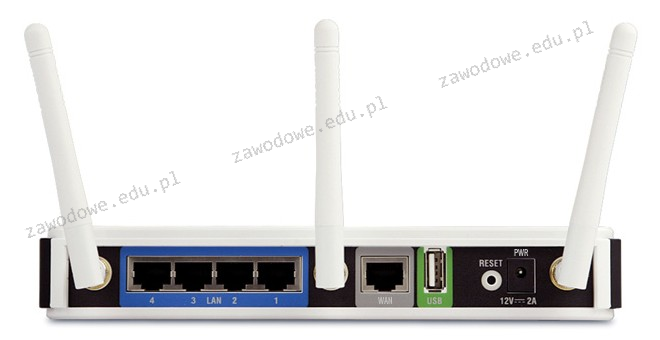

Do jakiego portu należy podłączyć kabel sieciowy zewnętrzny, aby uzyskać pośredni dostęp do sieci Internet?

Wskaż nazwę programu stosowanego w systemie Linux do przekrojowego monitorowania parametrów, między innymi takich jak obciążenie sieci, zajętość systemu plików, statystyki partycji, obciążenie CPU czy statystyki IO.

Sprzęt, który umożliwia konfigurację sieci VLAN, to

Jakiego rodzaju plik należy stworzyć w systemie operacyjnym, aby zautomatyzować rutynowe działania, takie jak kopiowanie lub tworzenie plików oraz folderów?

Która z usług serwerowych oferuje automatyczne ustawienie parametrów sieciowych dla stacji roboczych?

Do kategorii oprogramowania określanego jako malware (z ang. malicious software) nie zalicza się oprogramowanie typu:

W celu zrealizowania instalacji sieciowej na stacjach roboczych z systemem operacyjnym Windows, należy na serwerze zainstalować usługi

W architekturze sieci lokalnych opartej na modelu klient - serwer

Jednym z zaleceń w zakresie ochrony przed wirusami jest przeprowadzanie skanowania całego systemu. W związku z tym należy skanować komputer

Równoległy interfejs, w którym magistrala składa się z 8 linii danych, 4 linii sterujących oraz 5 linii statusowych, nie zawiera linii zasilających i umożliwia transmisję na odległość do 5 metrów, pod warunkiem, że przewody sygnałowe są skręcane z przewodami masy; w przeciwnym razie limit wynosi 2 metry, nazywa się

Którego wbudowanego narzędzia w systemie Windows 8 Pro można użyć do szyfrowania danych?

Jak nazywa się interfejs wewnętrzny w komputerze?

Jaką rolę pełni serwer FTP?

Do ilu sieci należą komputery o podanych w tabeli adresach IP i standardowej masce sieci?

| Komputer | Adres IP |

|---|---|

| Komputer 1 | 172.16.15.5 |

| Komputer 2 | 172.18.15.6 |

| Komputer 3 | 172.18.16.7 |

| Komputer 4 | 172.20.16.8 |

| Komputer 5 | 172.20.16.9 |

| Komputer 6 | 172.21.15.10 |

Aby naprawić wskazaną awarię, należy

|

Do wykonania kopii danych na dysk USB w systemie Linux stosuje się polecenie

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z