Pytanie 1

Jakie urządzenie należy wykorzystać w sieci Ethernet, aby zredukować liczbę kolizji pakietów?

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Jakie urządzenie należy wykorzystać w sieci Ethernet, aby zredukować liczbę kolizji pakietów?

Którą czynność należy wykonać podczas konfiguracji rutera, aby ukryta sieć bezprzewodowa była widoczna dla wszystkich użytkowników znajdujących się w jej zasięgu?

Cechą charakterystyczną transmisji w interfejsie równoległym synchronicznym jest to, że

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W zestawieniu przedstawiono istotne parametry techniczne dwóch typów interfejsów. Z powyższego wynika, że SATA w porównaniu do ATA charakteryzuje się

| Table Comparison of parallel ATA and SATA | ||

|---|---|---|

| Parallel ATA | SATA 1.5 Gb/s | |

| Bandwidth | 133 MB/s | 150 MB/s |

| Volts | 5V | 250 mV |

| Number of pins | 40 | 7 |

| Cable length | 18 in. (45.7 cm) | 39 in. (1 m) |

Oznaczenie CE świadczy o tym, że

Jaką rolę pełni serwer plików w sieciach komputerowych LAN?

Po uruchomieniu komputera, procedura POST wskazuje 512 MB RAM. Natomiast w ogólnych właściwościach systemu operacyjnego Windows wyświetla się wartość 480 MB RAM. Jakie są powody tej różnicy?

Na stronie wydrukowanej na drukarce laserowej pojawiają się jaśniejsze i ciemniejsze obszary. Aby rozwiązać problemy z nieciągłością i jakością wydruku, należy

Które z poniższych stwierdzeń odnosi się do sieci P2P – peer to peer?

W celu zbudowania sieci komputerowej w danym pomieszczeniu wykorzystano 25 metrów kabli UTP, 5 gniazd RJ45 oraz odpowiednią liczbę wtyków RJ45 potrzebnych do stworzenia 5 kabli połączeniowych typu patchcord. Jaki jest całkowity koszt zastosowanych materiałów do budowy sieci? Ceny jednostkowe materiałów są przedstawione w tabeli.

| Material | Jednostka miary | Cena |

|---|---|---|

| Skrętka UTP | m | 1 zł |

| Gniazdo RJ45 | szt. | 10 zł |

| Wtyk RJ45 | szt. | 50 gr |

Jakie rodzaje partycji mogą występować w systemie Windows?

Jaką usługę trzeba zainstalować na serwerze, aby umożliwić korzystanie z nazw domen?

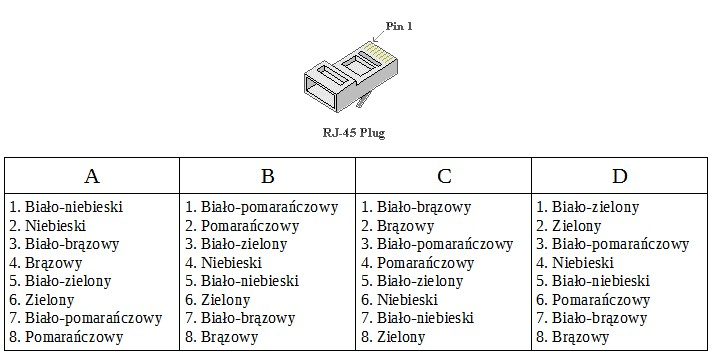

Jakie jest usytuowanie przewodów w złączu RJ45 według schematu T568A?

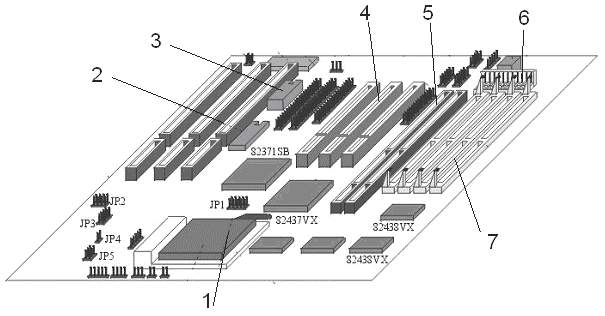

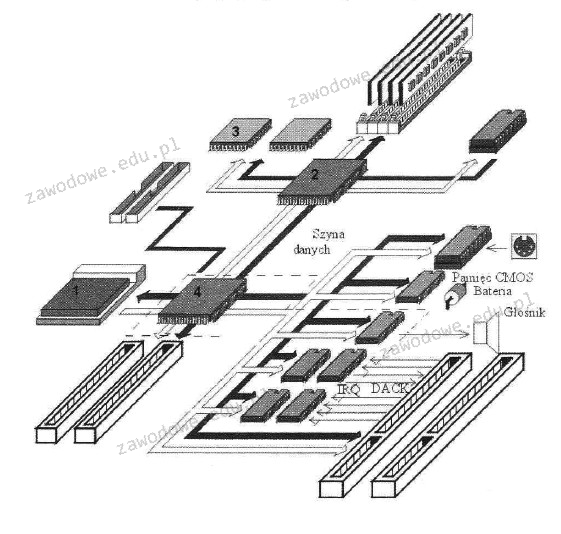

Na schemacie przedstawionej płyty głównej zasilanie powinno być podłączone do gniazda oznaczonego numerem

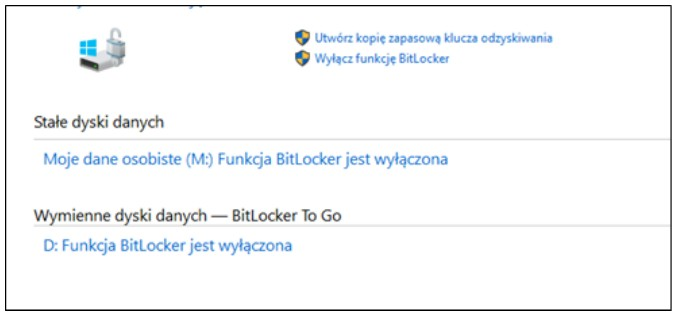

Narzędzie wbudowane w systemy Windows w edycji Enterprise lub Ultimate ma na celu

W systemie Linux komenda ps wyświetli

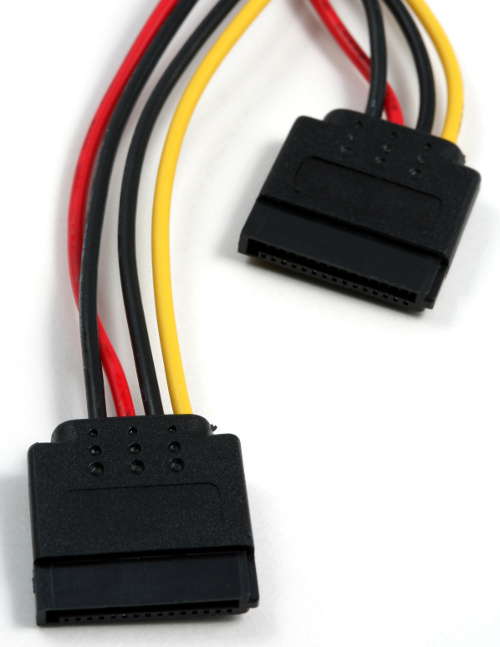

Na przedstawionym zdjęciu złącza pozwalają na

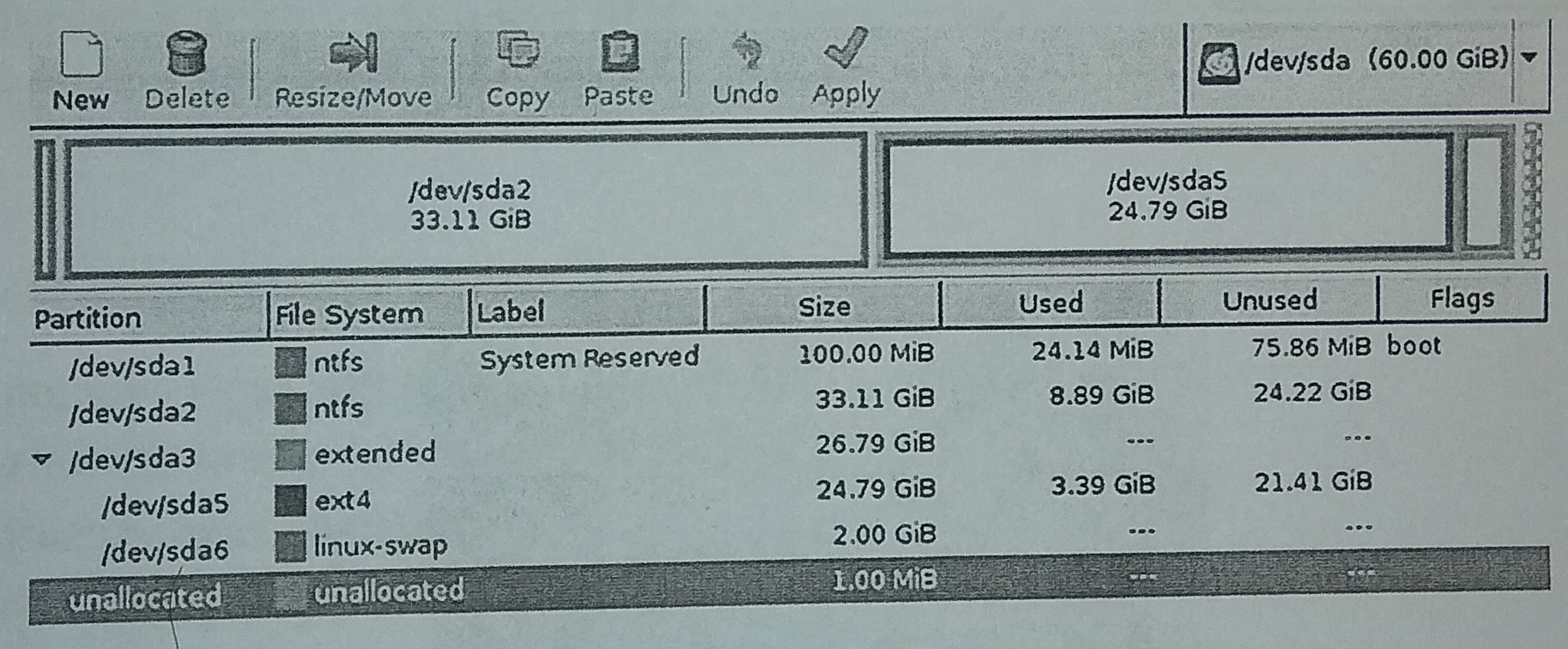

Analiza danych wyświetlonych przez program umożliwia stwierdzenie, że

Złącze SC powinno być zainstalowane na przewodzie

Aby w systemie Windows ustawić właściwości wszystkich zainstalowanych urządzeń lub wyświetlić ich listę, należy użyć narzędzia

Pamięć RAM pokazana na ilustracji jest instalowana na płycie głównej posiadającej gniazdo

Aby zapobiec uszkodzeniu sprzętu w trakcie modernizacji laptopa polegającej na wymianie modułów pamięci RAM, należy

Jakie będą wydatki na zakup kabla UTP kat.5e potrzebnego do stworzenia sieci komputerowej składającej się z 6 stanowisk, przy średniej odległości każdego stanowiska od przełącznika równiej 9m? Należy doliczyć m zapasu dla każdej linii kablowej, a cena za metr kabla wynosi 1,50 zł?

Jaką liczbą oznaczono procesor na diagramie płyty głównej komputera?

Jakie oznaczenie wskazuje adres witryny internetowej oraz przypisany do niej port?

Protokół Transport Layer Security (TLS) jest rozszerzeniem którego z poniższych protokołów?

Który protokół służy do wymiany danych o trasach oraz dostępności sieci pomiędzy routerami w ramach tego samego systemu autonomicznego?

Zastosowanie której zasady zwiększy bezpieczeństwo podczas korzystania z portali społecznościowych?

Po włączeniu komputera wyświetlił się komunikat: Non-system disk or disk error. Replace and strike any key when ready. Co może być tego przyczyną?

Który z poniższych protokołów jest używany do bezpiecznego przesyłania danych w sieci?

Zarządzaniem czasem procesora dla różnych zadań zajmuje się

W systemach Linux, aby wprowadzić nowe repozytorium, należy wykorzystać komendy

Który standard złącza DVI pozwala na przesyłanie wyłącznie sygnałów analogowych?

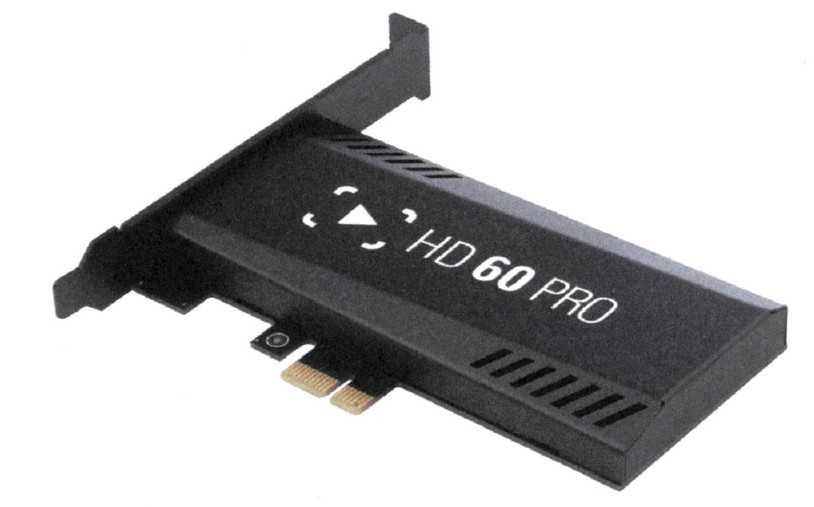

Karta do przechwytywania wideo, która została przedstawiona, będzie kompatybilna z płytą główną posiadającą port

Jaka jest maksymalna prędkość transferu danych w sieci lokalnej, w której zastosowano przewód UTP kat.5e do budowy okablowania strukturalnego?

Kiedy adres IP komputera ma formę 176.16.50.10/26, to jakie będą adres rozgłoszeniowy oraz maksymalna liczba hostów w danej sieci?

W systemie Windows ochrona polegająca na ostrzeganiu przed uruchomieniem nierozpoznanych aplikacji i plików pobranych z Internetu jest realizowana przez

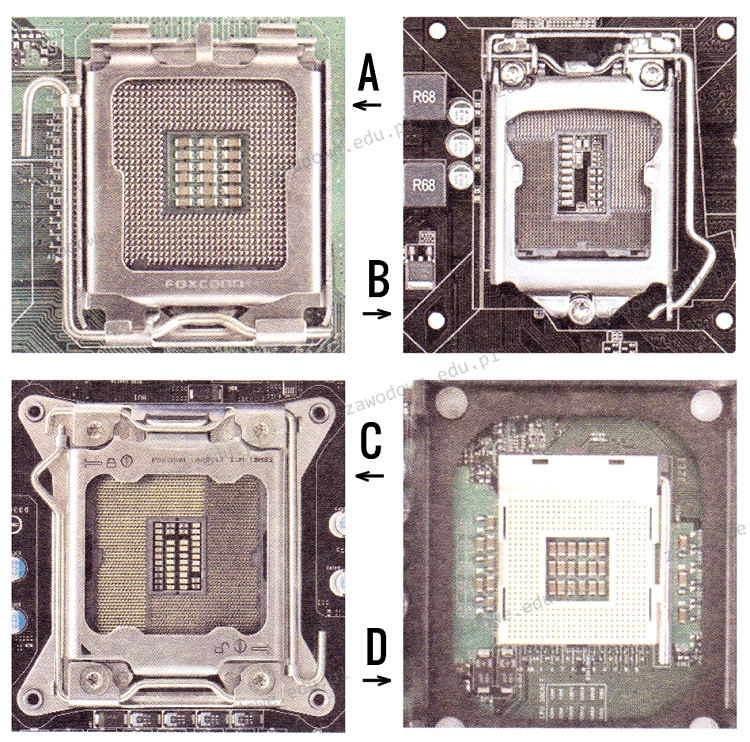

W jakim gnieździe powinien być umieszczony procesor INTEL CORE i3-4350- 3.60 GHz, x2/4, 4MB, 54W, HD 4600, BOX, s-1150?

Aby chronić systemy sieciowe przed atakami z zewnątrz, należy zastosować