Pytanie 1

Jakie wymagania techniczne muszą spełniać aparaty terapeutyczne stosowane w zakładach brachyterapii, służące bezpośrednio do napromieniania pacjenta metodą zdalnego wprowadzania źródeł promieniotwórczych?

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Jakie wymagania techniczne muszą spełniać aparaty terapeutyczne stosowane w zakładach brachyterapii, służące bezpośrednio do napromieniania pacjenta metodą zdalnego wprowadzania źródeł promieniotwórczych?

Warstwa półchłonna (WP) służy do obliczania

SPECT to

W celu wyeliminowania zakłóceń obrazu MR przez sygnały pochodzące z tkanki tłuszczowej, stosuje się

Który materiał światłoczuły należy zastosować w rentgenodiagnostyce analogowej, by zminimalizować dawkę promieniowania jonizującego otrzymaną przez pacjenta?

Brachyterapia polegająca na wielokrotnym wsuwaniu i wysuwaniu źródła promieniowania do tego samego aplikatora nosi nazwę

Z kratką przeciwrozproszeniową należy wykonać zdjęcie

Który detektor w radiografii wymaga laserowego czytnika obrazu?

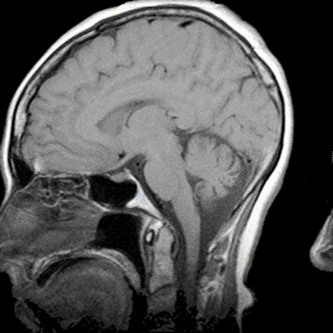

Który artefakt uwidoczniono na skanie RM głowy?

Wysoką rozdzielczość przestrzenną obrazowania MR uzyskuje się przez

Promieniowanie rentgenowskie jest

Obszary napromieniania w technice IMRT w trakcie wykonywania zabiegu radioterapeutycznego wyznacza

Folia wzmacniająca umieszczona w kasecie rentgenowskiej emituje pod wpływem promieniowania X światło

Emisja fali elektromagnetycznej występuje w procesie rozpadu promieniotwórczego

Zastosowana w badaniu radiologicznym kratka przeciwrozproszeniowa powoduje

Które środki kontrastujące wykorzystywane są w diagnostyce rezonansem magnetycznym?

W radioterapii konwencjonalnej pacjent jest leczony promieniowaniem pochodzącym

Jaka jest odległość pomiędzy źródłem promieniowania a powierzchnią ciała pacjenta w technice izocentrycznej radioterapii?

Do pomiaru dawek indywidualnych u osób narażonych zawodowo na promieniowanie rentgenowskie są stosowane

Proces chemicznego wywoływania radiogramów polega na

W lampie rentgenowskiej promieniowanie X powstaje w wyniku hamowania

Hiperfrakcjonowanie dawki w radioterapii oznacza napromieniowywanie pacjenta

W badaniu MR czas repetycji TR jest parametrem określającym odstęp czasu między

Fala głosowa rozchodzi się

Do czego służy do symulator rentgenowski wykorzystywany w procesie radioterapii?

W technice napromieniania SSD mierzona jest odległość źródła promieniowania

W scyntygrafii wykorzystywane są głównie radioizotopy emitujące promieniowanie

Czas połowicznego zaniku jest wykorzystywany

Kolimator wielolistkowy w akceleratorze liniowym jest stosowany do

Podczas badania gammakamerą źródłem promieniowania jest

Promieniowanie rentgenowskie powstaje w wyniku hamowania

Diagnozowanie metodą PET oparte jest na zjawisku

Dawka graniczna wyrażona jako dawka skuteczna (efektywna), dla osób zawodowo narażonych na działanie promieniowania jonizującego wynosi w ciągu roku kalendarzowego

Obrazowanie portalowe w radioterapii służy do

W trakcie obrazowania metodą rezonansu magnetycznego wykorzystywane jest zjawisko wysyłania sygnału emitowanego przez

W badaniu MR czas repetycji TR jest parametrem określającym odstęp czasu między

Która sekwencja obrazowania MR wykorzystuje impulsy RF o częstotliwości rezonansowej tłuszczu do tłumienia sygnału pochodzącego z tkanki tłuszczowej?

Jaki jest cel stosowania bolusa w radioterapii?

Brachyterapia polega na napromieniowaniu pacjenta promieniowaniem

Które urządzenie zostało przedstawione na fotografii i w jakiej pracowni znajduje zastosowanie?