Pytanie 1

Który system plików jest dedykowany systemowi Linux oraz nie jest używany w systemie Windows?

Wynik: 40/40 punktów (100,0%)

Wymagane minimum: 20 punktów (50%)

Który system plików jest dedykowany systemowi Linux oraz nie jest używany w systemie Windows?

Procesor GPU jest odpowiedzialny za wykonywanie operacji obliczeniowych w karcie

Technologia OLED znajduje zastosowanie w

Wysłanie obrazów z urządzenia diagnostycznego do serwera PACS odbywa się zgodnie ze standardem

Dla sieci o adresie 192.150.160.0/26 pula adresów IP dla urządzeń w tej sieci zawiera się w zakresie

W systemie komputerowym przeznaczonym do pracy z dużymi plikami graficznymi należy zwiększyć ilość

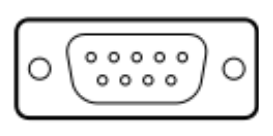

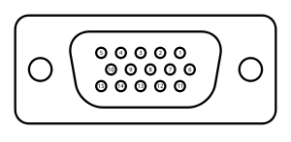

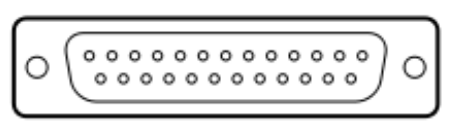

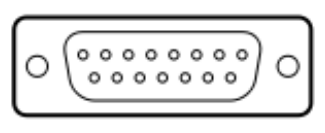

Zgodnie z przedstawionym opisem, gniazdo interfejsu służące do podłączenia audiometru ze stanowiskiem komputerowym przedstawione jest na rysunku

| Opis: |

| − 125 Hz ÷ 8.000 Hz − -10 dB do 120 dB HL na wyjściu − połączenie z komputerem PC – interfejs RS232 − połączenie z drukarką laserową − połączenie z drukarką atramentową |

Urządzenie do rejestracji bioelektrycznych potencjałów mięśniowych to

Zapis w dokumentacji kardiotokografu „prezentacja sygnału FHR” dotyczy

Na rysunku przedstawiono badanie za pomocą

Który aparat, za pomocą poleceń głosowych i wizualnych, prowadzi ratownika przez procedurę bezpiecznej defibrylacji w zatrzymaniu krążenia?

Zestaw przedstawiony na rysunku przeznaczony jest do przeprowadzania testu aparatu

Funkcja f(n) = nf(n-1) dla n>1 w przeciwnym wypadku f(n) = 1 jest przykładem

Aby system komputerowy współpracujący z ultrasonografem mógł nagrywać na jednej płycie DVD dane z kolejnych, wykonywanych na bieżąco badań, musi być wyposażony w nagrywanie

Aby zapobiec utracie danych w programie obsługi przychodni, należy codziennie wykonywać

W jakim celu stosuje się Standard HL7 (Health Level Seven)?

Ile elektrod wykorzystuje się podczas wykonywania standardowego badania EKG przy pomocy 12 odprowadzeń?

Sterowniki klawiatury, magistral i przerwań są elementami

Aby zainstalować brakujące oprogramowanie w systemie z rodziny Linux należy wykorzystać polecenie

Dokręcenie śrub mocujących z wartością momentu 6 Nm, zgodnie z instrukcją montażową, należy wykonać kluczem

Znak ~ na początku ciągu znaków w systemach uniksowych oznacza

Jaki wpływ na organizm ludzki ma promieniowanie podczerwone IR?

W instrukcji systemu do skanowania dokumentacji medycznej zapisano, że umożliwia wykorzystanie systemu OCR, który służy do

W zabiegu jonoforezy leki są transportowane przez skórę do głębiej położonych warstw poprzez zastosowanie

Rysunek przedstawia wynik działania polecenia ipconfig urządzenia w sieci LAN. Który adres rutera umożliwia dostęp tego urządzenia do sieci WAN?

Najważniejszą cechą pamięci operacyjnych serwerowych jest ich niezawodność, dlatego powinny być wyposażone w mechanizm kontroli błędów określany skrótem

Programowanie obiektowe wykorzystuje dziedziczenie, które polega na

W celu zmiany hasła użytkownika w systemie Linux należy użyć polecenia

Dla której wartości z wymienionych rezystancji, zastosowanie układu poprawnie mierzonego prądu zapewnia najmniejszy błąd pomiaru?

W systemie bazodanowym wymagane jest dodatkowe sprzętowe zabezpieczenie danych przed ich utratą. Która macierz dyskowa pozwala uodpornić się na utratę danych w przypadku awarii wszystkich dysków poza jednym?

Na rysunku przedstawiono kartę rozszerzeń umożliwiającą

Metoda diagnostyczna, w której rejestruje się rozpad radioizotopu wprowadzonego do organizmu, to

Jaki wpływ na organizm ludzki ma krioterapia?

Aby dodać nowe konto „rejestracja” w systemie Windows, należy wykorzystać polecenie

Który zabieg wymusza naprzemienną pracę mięśni zginaczy i prostowników poprzez stymulację mięśni impulsem prądowym?

W urządzeniu medycznym wyznaczono charakterystykę filtru jak na rysunku. Jest to filtr

W tabeli przedstawiono fragment dokumentacji testera

| Zakres | ±500 mm Hg 20 °C |

| Dokładność | ±1% odczytu + 0.5 mm Hg) |

| Zakres | 80, 94 bpm (synch. z EKG) |

| Dokładność sygnału | ±1% |

| Inwazyjne: | |

| Statyczne ciśnienie | -10, -5, 0, 20, 40, 50, 60, 80, 100, 150, 160, 200, 240, 250, 300, 320, 400 mm Hg |

| Dokładność | ±(1% zakresu ±1mm Hg) or ±(2% nastawy + 2mm Hg) |

| Impedancja | 300 Ohm (±10% dokładności) |

| Czułość | 5 do 40 μV/V/mm Hg |

Pamięć statyczna RAM ma zastosowanie jako pamięć

Które badanie endoskopowe należy wykorzystać do wizualizacji jamy stawu?

Który zasilacz pozwala na tymczasowe utrzymanie zasilania akumulatorowego w razie braku zasilania sieciowego?