Pytanie 1

Który z protokołów będzie wykorzystany przez administratora do przesyłania plików na serwer?

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

Który z protokołów będzie wykorzystany przez administratora do przesyłania plików na serwer?

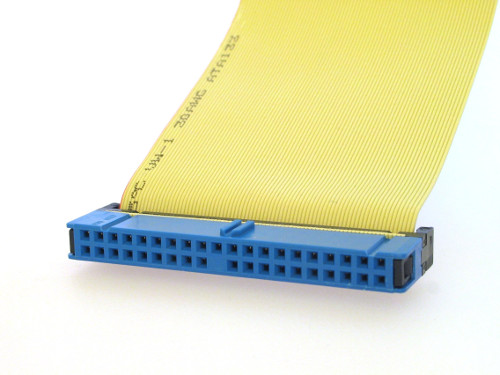

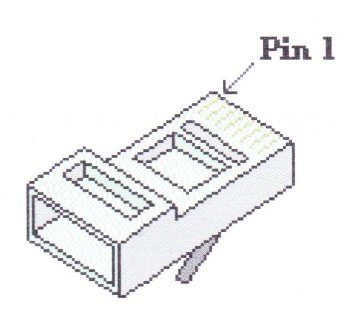

Na ilustracji pokazano wtyczkę taśmy kabel)

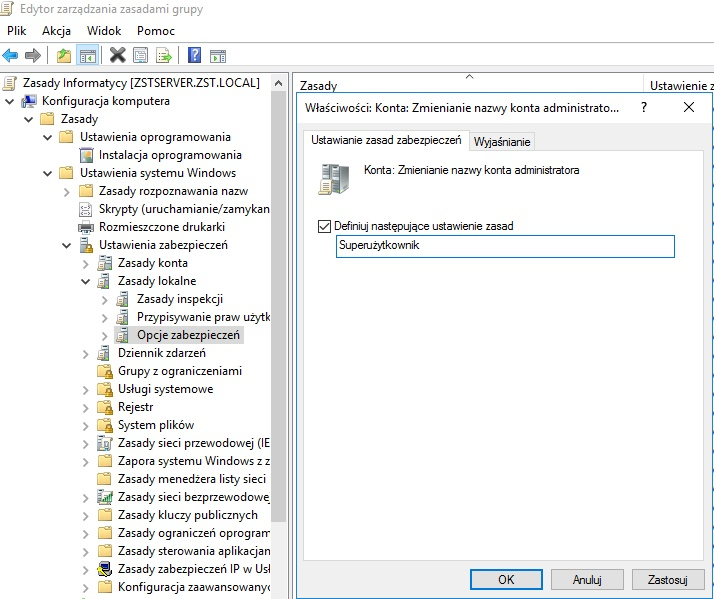

Rezultatem działania przedstawionego na ilustracji okna jest

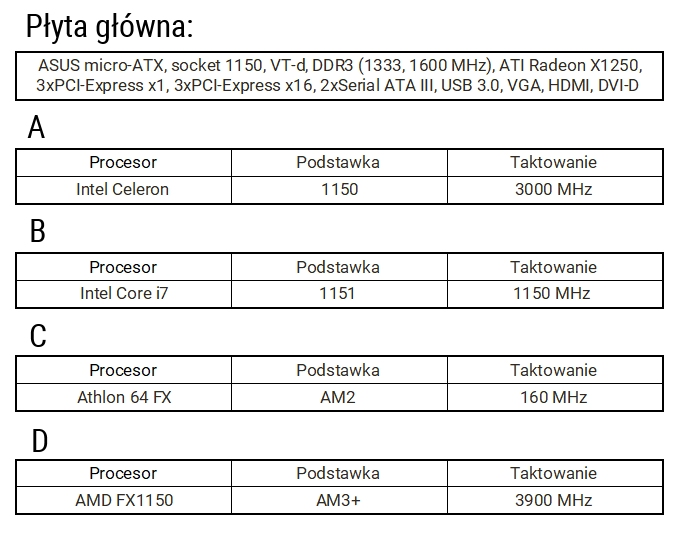

Jaki procesor pasuje do płyty głównej o podanej specyfikacji?

Na podstawie oznaczenia pamięci DDR3 PC3-16000 można stwierdzić, że pamięć ta

W komputerach stacjonarnych zamontowane są karty sieciowe Ethernet 10/100/1000 z gniazdem RJ45. Jakie medium transmisyjne powinno się zastosować w celu zbudowania sieci komputerowej zapewniającej najwyższą przepustowość?

Jakie polecenie należy użyć w wierszu poleceń systemu Windows, aby utworzyć nowy katalog?

Na którym standardowym porcie funkcjonuje serwer WWW wykorzystujący domyślny protokół HTTPS w typowym ustawieniu?

Jakie polecenie należy wykorzystać w systemie Linux, aby zlokalizować wszystkie pliki z rozszerzeniem txt, które znajdują się w katalogu /home/user i mają w nazwie ciąg znaków abc?

Wypukłe kondensatory elektrolityczne w module zasilania monitora LCD mogą doprowadzić do uszkodzenia

Aby zabezpieczyć system przed oprogramowaniem o zdolności do samoreplikacji, należy zainstalować

Dysk twardy IDE wewnętrzny jest zasilany przez połączenie typu

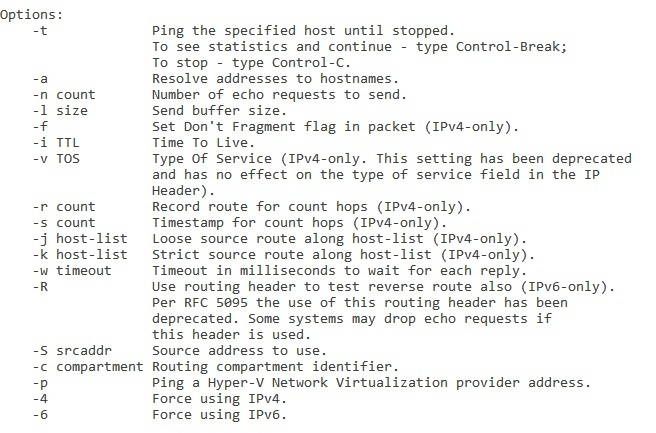

Aby wyświetlić przedstawione opcje polecenia ping, należy w wierszu polecenia systemu Windows zapisać

Materiałem eksploatacyjnym stosowanym w drukarkach tekstylnych jest

Jak wygląda układ przewodów w złączu RJ45 zgodnie z kolejnością połączeń T568A?

Na podstawie zaprezentowanego cennika oblicz, jaki będzie całkowity koszt jednego dwumodułowego podwójnego gniazda abonenckiego montowanego na powierzchni.

| Lp. | Nazwa | j.m. | Cena jednostkowa brutto |

|---|---|---|---|

| 1. | Puszka natynkowa 45x45 mm dwumodułowa | szt. | 4,00 zł |

| 2. | Ramka + suport 45x45 mm dwumodułowa | szt. | 4,00 zł |

| 3. | Adapter 22,5x45 mm do modułu keystone | szt. | 3,00 zł |

| 4. | Moduł keystone RJ45 kategorii 5e | szt. | 7,00 zł |

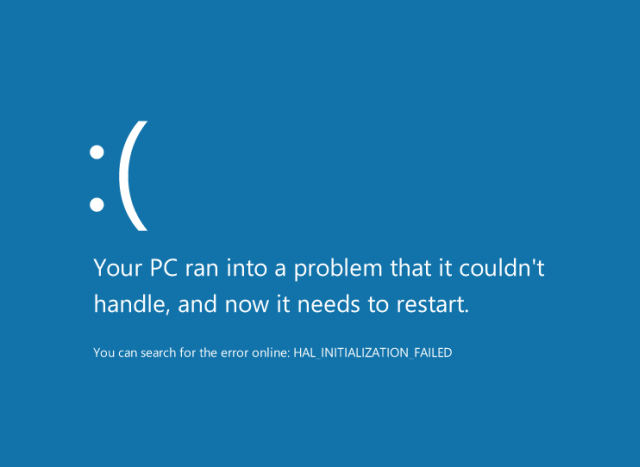

Zamieszczony komunikat tekstowy wyświetlony na ekranie komputera z zainstalowanym systemem Windows wskazuje na

Która usługa pozwala na zdalne logowanie do komputerów, wykonywanie poleceń systemowych oraz zarządzanie siecią?

Narzędziem wykorzystywanym do diagnozowania połączeń między komputerami w systemie Windows jest

Do realizacji alternatywy logicznej z negacją należy użyć funktora

Zjawisko przekazywania tokena (ang. token) występuje w sieci o fizycznej strukturze

Jakie napięcie zasilające mogą mieć urządzenia wykorzystujące port USB 2.0?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jednym z narzędzi zabezpieczających system przed oprogramowaniem, które bez wiedzy użytkownika pozyskuje i wysyła jego autorowi dane osobowe, numery kart płatniczych, informacje o adresach stron WWW odwiedzanych przez użytkownika, hasła i używane adresy mailowe, jest program

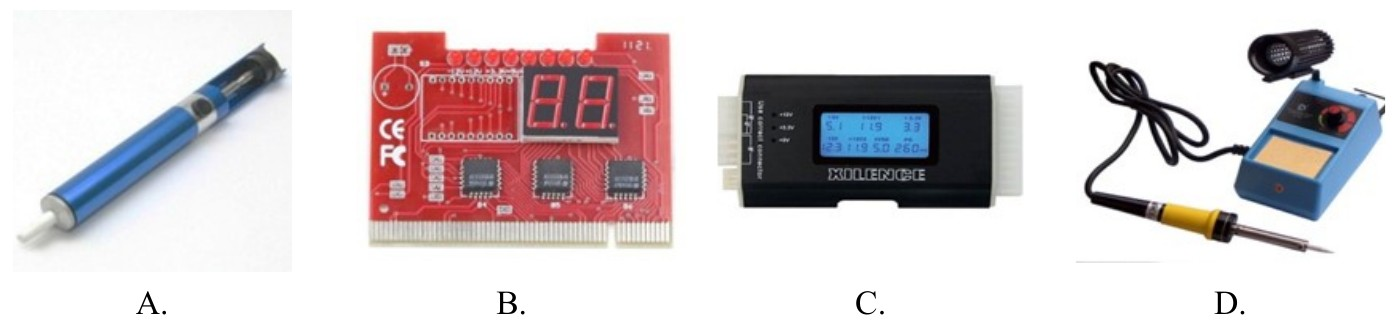

Na ilustracji ukazano kartę

Jaka jest maska dla adresu IP 192.168.1.10/8?

Do zrealizowania macierzy RAID 1 wymagane jest co najmniej

Jakie narzędzie powinno być użyte do zbadania wyników testu POST dla modułów na płycie głównej?

W systemie Windows, zainstalowanym w wersji obsługującej przydziały dyskowe, użytkownik o nazwie Gość

Który protokół odpowiada za bezpieczne przesyłanie danych w sieciach komputerowych?

Jeden długi oraz dwa krótkie sygnały dźwiękowe BIOS POST od firm AMI i AWARD wskazują na wystąpienie błędu

Jakiego typu dane są przesyłane przez interfejs komputera osobistego, jak pokazano na ilustracji?

| Bit startu | Bit danych | Bit danych | Bit stopu | Bit startu | Bit danych | Bit startu | Bit danych | Bit danych | Bit stopu | Bit startu | Bit danych | Bit stopu |

Atak DDoS (z ang. Distributed Denial of Service) na serwer może spowodować

Podczas uruchamiania komputera wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

Użytkownik systemu Windows napotyka komunikaty o niewystarczającej pamięci wirtualnej. Jak można rozwiązać ten problem?

Zasadniczym sposobem zabezpieczenia danych przechowywanych na serwerze jest

Drukarką przeznaczoną do druku etykiet i kodów kreskowych, która drukuje poprzez roztapianie pokrycia specjalnej taśmy, w wyniku czego barwnik z niej zostaje przyklejony do materiału, na którym następuje drukowanie jest drukarka

Na zdjęciu widnieje

Aby zainstalować openSUSE oraz dostosować jego ustawienia, można skorzystać z narzędzia

Jak wiele urządzeń może być podłączonych do interfejsu IEEE1394?