Pytanie 1

Użytkownik drukarki samodzielnie i prawidłowo napełnił pojemnik z tonerem. Po jego zamontowaniu drukarka nie podejmuje próby drukowania. Przyczyną tej usterki może być

Wynik: 30/40 punktów (75,0%)

Wymagane minimum: 20 punktów (50%)

Użytkownik drukarki samodzielnie i prawidłowo napełnił pojemnik z tonerem. Po jego zamontowaniu drukarka nie podejmuje próby drukowania. Przyczyną tej usterki może być

Jakie oprogramowanie dostarcza najwięcej informacji diagnostycznych na temat procesora CPU?

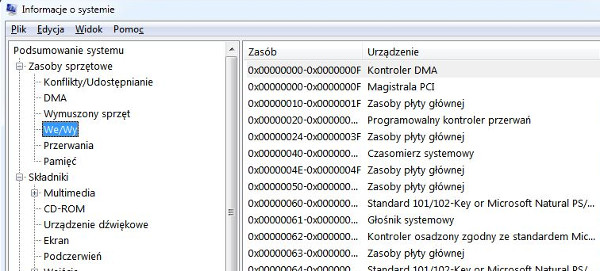

W jakim systemie numerycznym przedstawione są zakresy We/Wy na ilustracji?

W systemie Linux komenda chmod pozwala na

Jakie zadanie pełni router?

Jakie elementy wspierają okablowanie pionowe w sieci LAN?

Który z systemów operacyjnych przeznaczonych do pracy w sieci jest dostępny na podstawie licencji GNU?

W systemie Linux narzędzie fsck służy do

W systemie Linux do monitorowania użycia procesora, pamięci, procesów i obciążenia systemu służy polecenie

Zaprezentowany komputer jest niepełny. Który z komponentów nie został wymieniony w tabeli, a jest kluczowy dla poprawnego funkcjonowania zestawu i powinien być dodany?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Cooler Master obudowa komputerowa CM Force 500W czarna |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, TRAY/OEM |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3,5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Natychmiast po dostrzeżeniu utraty istotnych plików na dysku twardym, użytkownik powinien

Aby bezpiecznie połączyć się z firmowym serwerem przez Internet i mieć dostęp do zasobów firmy, należy wykorzystać odpowiednie oprogramowanie klienckie

Jak określa się technologię stworzoną przez firmę NVIDIA, która pozwala na łączenie kart graficznych?

Zgłoszona awaria ekranu laptopa może być wynikiem

Materiałem eksploatacyjnym, stosowanym w rzutniku multimedialnym, jest

Zestaw dodatkowy, który zawiera strzykawkę z cieczą, igłę oraz rękawice ochronne, jest przeznaczony do napełniania pojemników z medium drukującym w drukarkach

Który protokół zajmuje się konwersją adresów IP na adresy MAC (kontroli dostępu do nośnika)?

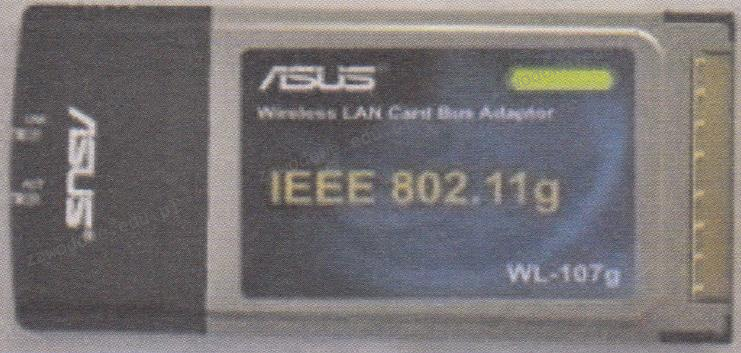

Karta sieciowa przedstawiona na ilustracji ma zdolność przesyłania danych z maksymalną prędkością

Jakie rozwiązanie techniczne pozwala na transmisję danych z szybkością 1 Gb/s z zastosowaniem światłowodu?

W którym trybie działania procesora Intel x86 uruchamiane były aplikacje 16-bitowe?

Na ilustracji zaprezentowano układ

Aby uzyskać wyświetlenie podanych informacji o systemie Linux w terminalu, należy skorzystać z komendy

Co oznacza oznaczenie kabla skrętkowego S/FTP?

ACPI jest skrótem oznaczającym

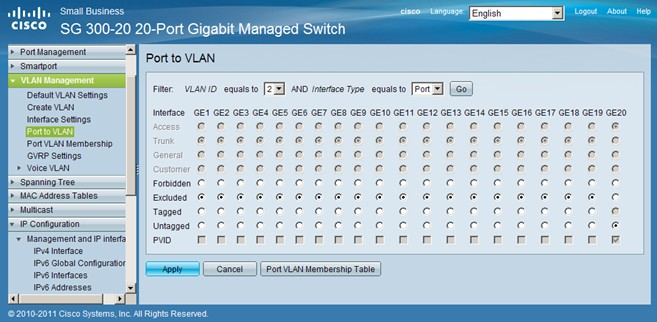

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Umowa, na mocy której użytkownik ma między innymi wgląd do kodu źródłowego oprogramowania w celu jego analizy oraz udoskonalania, to licencja

Która z licencji umożliwia korzystanie przez każdego użytkownika z programu bez ograniczeń wynikających z autorskich praw majątkowych?

Narzędzie chroniące przed nieautoryzowanym dostępem do lokalnej sieci, to

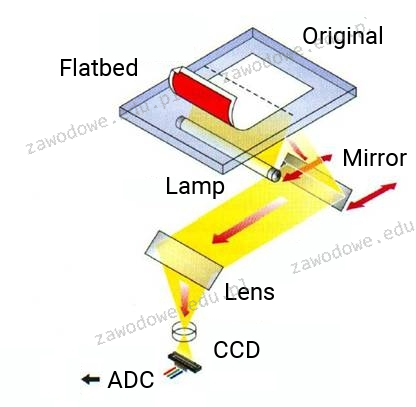

Zaprezentowany schemat ilustruje funkcjonowanie

Aby załadować projekt wydruku bezpośrednio z komputera do drukarki 3D, której parametry przedstawiono w tabeli, można użyć złącza

| Technologia pracy | FDM (Fused Deposition Modeling) |

| Głowica drukująca | Podwójny ekstruder z unikalnym systemem unoszenia dyszy i wymiennymi modułami drukującymi (PrintCore) |

| Średnica filamentu | 2,85 mm |

| Platforma drukowania | Szklana, podgrzewana |

| Temperatura platformy | 20°C – 100°C |

| Temperatura dyszy | 180°C – 280°C |

| Łączność | WiFi, Ethernet, USB |

| Rozpoznawanie materiału | Skaner NFC |

Skaner antywirusowy zidentyfikował niechciane oprogramowanie. Z opisu wynika, że jest to dialer, który pozostawiony w systemie

Za pomocą narzędzia diagnostycznego Tracert można ustalić trasę do punktu docelowego. Przez ile routerów przeszedł pakiet wysłany dl hosta 172.16.0.99?

C:\>tracert 172.16.0.99 Trasa śledzenia do 172.16.0.99 z maksymalną liczbą przeskoków 30 | ||||

| 1 | 2 ms | 3 ms | 2 ms | 10.0.0.1 |

| 2 | 12 ms | 8 ms | 8 ms | 192.168.0.1 |

| 3 | 10 ms | 15 ms | 10 ms | 172.17.0.2 |

| 4 | 11 ms | 11 ms | 20 ms | 172.17.48.14 |

| 5 | 21 ms | 16 ms | 24 ms | 172.16.0.99 |

Śledzenie zakończone. | ||||

Użytkownicy sieci Wi-Fi zauważyli zakłócenia oraz częste przerwy w połączeniu. Przyczyną tej sytuacji może być

Które złącze powinna posiadać karta graficzna, aby można było bezpośrednio ją połączyć z telewizorem LCD wyposażonym wyłącznie w analogowe złącze do podłączenia komputera?

W norma PN-EN 50174 brak jest wskazówek odnoszących się do

Jest to najnowsza edycja klienta wieloplatformowego, docenianego przez użytkowników na całym świecie, serwera wirtualnej sieci prywatnej, umożliwiającego nawiązanie połączenia między hostem a komputerem lokalnym, obsługującego uwierzytelnianie z wykorzystaniem kluczy, certyfikatów, nazwy użytkownika oraz hasła, a także, w wersji dla Windows, dodatkowych zakładek. Który z programów został wcześniej opisany?

Bezpośrednio po usunięciu istotnych plików z dysku twardego, użytkownik powinien

W wyniku wykonania przedstawionych poleceń systemu Linux interfejs sieciowy eth0 otrzyma:

ifconfig eth0 10.0.0.100 netmask 255.255.255.0 broadcast 10.0.0.255 up route add default gw 10.0.0.10

Jeśli jednostka alokacji ma 1024 bajty, to pliki podane w tabeli zajmują na dysku:

Nazwa Wielkość

Ala.exe 50B

Dom.bat 1024B

Wirus.exe 2kB

Domes.exr 350B

Atak na system komputerowy przeprowadzany jednocześnie z wielu maszyn w sieci, który polega na zablokowaniu działania tego systemu przez zajęcie wszystkich dostępnych zasobów, określany jest mianem