Pytanie 1

Które z poniższych stwierdzeń odnosi się do sieci P2P – peer to peer?

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Które z poniższych stwierdzeń odnosi się do sieci P2P – peer to peer?

Jakie jest odpowiednik maski 255.255.252.0 w postaci prefiksu?

Jaki rezultat uzyskamy po wykonaniu odejmowania dwóch liczb heksadecymalnych 60A (h) - 3BF (h)?

Jaką maksymalną prędkość transferu danych pozwala osiągnąć interfejs USB 3.0?

Jaką usługę powinno się aktywować na ruterze, aby każda stacja robocza mogła wymieniać pakiety z siecią Internet, gdy dostępnych jest 5 adresów publicznych oraz 18 stacji roboczych?

Jaką liczbę komórek pamięci można bezpośrednio zaadresować w 64-bitowym procesorze z 32-bitową szyną adresową?

Najszybszym sposobem na dodanie skrótu do konkretnego programu na pulpitach wszystkich użytkowników w domenie jest

Użytkownik pragnie ochronić dane na karcie pamięci przed przypadkowym usunięciem. Taką zabezpieczającą cechę oferuje karta

Element płyty głównej odpowiedzialny za wymianę danych między mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej jest na rysunku oznaczony numerem

"Gorące podłączenie" ("Hot plug") oznacza, że urządzenie, które jest podłączane, ma

Jakie protokoły są używane w komunikacji między hostem a serwerem WWW po wpisaniu URL w przeglądarkę internetową hosta?

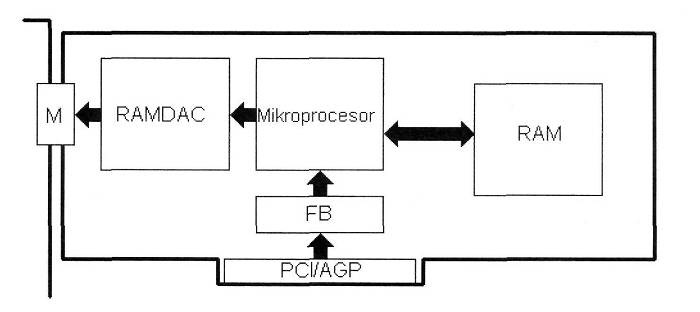

Na schemacie blokowym funkcjonalny blok RAMDAC ilustruje

Pierwszym krokiem koniecznym do ochrony rutera przed nieautoryzowanym dostępem do jego panelu konfiguracyjnego jest

Na podstawie tabeli wskaż, który model przełącznika Cisco Catalyst, zawiera 48 portów i możliwość doposażenia o wkładki światłowodowe.

| Configurations of Cisco Catalyst 2960 Series Switches with LAN Base Software | ||

|---|---|---|

| Cisco Catalyst 2960 Switch Model | Description | Uplinks |

| 1 Gigabit Uplinks with 10/100 Ethernet Connectivity | ||

| Cisco Catalyst 2960-48PST-L | 48 Ethernet 10/100 PoE ports | 2 One Gigabit Ethernet SFP ports and 2 fixed Ethernet 10/100/1000 ports |

| Cisco Catalyst 2960-24PC-L | 24 Ethernet 10/100 PoE ports | 2 dual-purpose ports (10/100/1000 or SFP) |

| Cisco Catalyst 2960-24LT-L | 24 Ethernet 10/100 ports | 2 Ethernet 10/100/1000 ports |

| Cisco Catalyst 2960-24TC-L | 24 Ethernet 10/100 ports | 2 dual-purpose ports |

| Cisco Catalyst 2960-48TC-L | 48 Ethernet 10/100 ports | 2 dual-purpose ports (10/100/1000 or SFP) |

| Cisco Catalyst 2960-24TT-L | 24 Ethernet 10/100 ports | 2 Ethernet 10/100/1000 ports |

| Cisco Catalyst 2960-48TT-L | 48 Ethernet 10/100 ports | 2 Ethernet 10/100/1000 ports |

Który z poniższych protokołów funkcjonuje w warstwie aplikacji?

Która z ról w systemie Windows Server umożliwia m.in. zdalną, bezpieczną i uproszczoną instalację systemów operacyjnych Windows na komputerach w sieci?

Jakie oznaczenie nosi wtyk powszechnie znany jako RJ45?

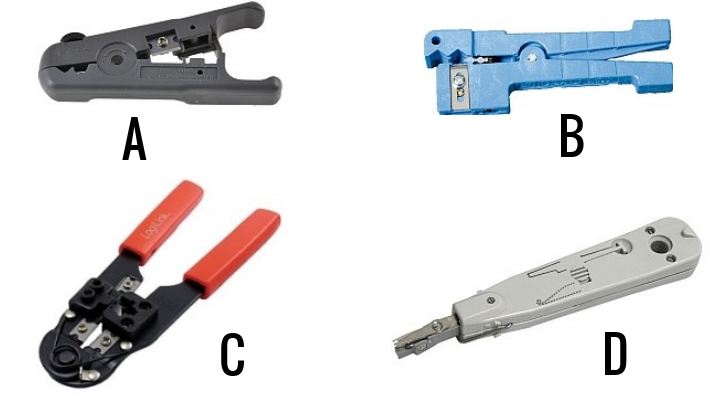

Do czego służy nóż uderzeniowy?

W systemie Linux do bieżącego monitorowania aktywnych procesów wykorzystuje się polecenie

Jakie polecenie w systemie Linux służy do przypisania adresu IP oraz maski podsieci dla interfejsu eth0?

Po dokonaniu eksportu klucza HKCU powstanie kopia rejestru zawierająca dane dotyczące ustawień

Aby móc zakładać konta użytkowników, komputerów oraz innych obiektów i centralnie gromadzić o nich informacje, należy zainstalować rolę na serwerze Windows

Aby system operacyjny mógł szybciej uzyskiwać dostęp do plików zapisanych na dysku twardym, konieczne jest wykonanie

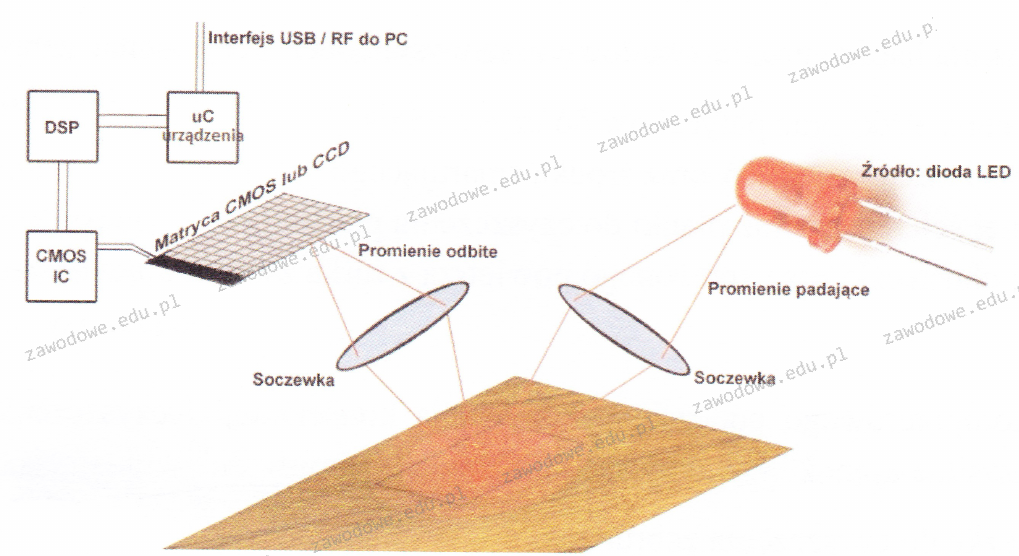

Zilustrowany schemat przedstawia zasadę funkcjonowania

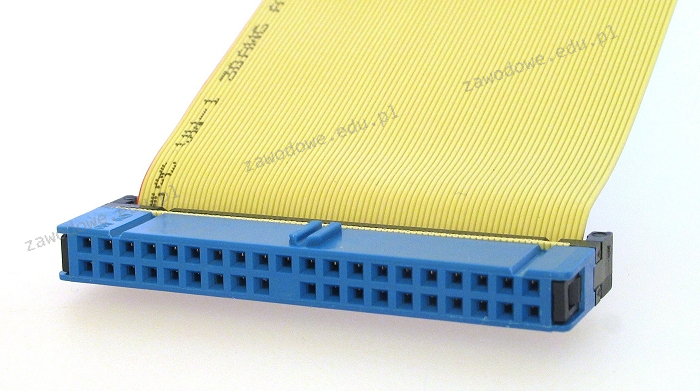

Na ilustracji zaprezentowano końcówkę kabla

Jakie urządzenia wykorzystuje się do porównywania liczb w systemie binarnym?

Protokołem umożliwiającym bezpołączeniowe przesyłanie datagramów jest

Narzędziem wbudowanym w systemie Windows, wykorzystywanym do diagnozowania problemów związanych z działaniem animacji w grach lub odtwarzaniem filmów, jest

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie urządzenie w warstwie łącza danych modelu OSI analizuje adresy MAC zawarte w ramkach Ethernet i na tej podstawie decyduje o przesyłaniu sygnału pomiędzy segmentami sieci lub jego blokowaniu?

Odmianą pamięci, która zapewnia tylko odczyt i może być usunięta przy użyciu światła ultrafioletowego, jest pamięć

Który z komponentów komputera można wymienić bez konieczności wyłączania zasilania?

W systemie Linux do obserwacji działania sieci, urządzeń sieciowych oraz serwerów można zastosować aplikację

Na ilustracji przedstawiono taśmę (kabel) złącza

Zaprezentowany tylny panel płyty głównej zawiera następujące interfejsy:

Możliwość weryfikacji poprawności działania pamięci RAM można uzyskać za pomocą programu diagnostycznego

Jakie polecenie w systemie Windows powinno być użyte do sprawdzania aktywnych połączeń karty sieciowej w komputerze?

Jakie narzędzie wykorzystuje się do przytwierdzania kabla w module Keystone?

Jakie urządzenie ma za zadanie utrwalenie tonera na papierze w trakcie drukowania z drukarki laserowej?

Zgodnie z normą PN-EN 50174, maksymalna długość kabla poziomego kategorii 6 pomiędzy punktem abonenckim a punktem dystrybucji w panelu krosowym wynosi