Pytanie 1

W architekturze sieci lokalnych opartej na modelu klient-serwer

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

W architekturze sieci lokalnych opartej na modelu klient-serwer

Jak nazywa się seria procesorów produkowanych przez firmę Intel, charakteryzująca się małymi wymiarami oraz niskim zużyciem energii, zaprojektowana z myślą o urządzeniach mobilnych?

Jakie cechy posiadają procesory CISC?

Ile sieci obejmują komputery z adresami IP i maskami sieci podanymi w tabeli?

| Adres IPv4 | Maska |

|---|---|

| 10.120.16.10 | 255.255.0.0 |

| 10.120.18.16 | 255.255.0.0 |

| 10.110.16.18 | 255.255.255.0 |

| 10.110.16.14 | 255.255.255.0 |

| 10.130.16.12 | 255.255.255.0 |

Na wyświetlaczu drukarki pojawił się komunikat „PAPER JAM”. Aby usunąć usterkę, należy w pierwszej kolejności

Aby uzyskać na ekranie monitora odświeżanie obrazu 85 razy w ciągu sekundy, trzeba częstotliwość jego odświeżania ustawić na

Jaki jest główny cel stosowania maski podsieci?

Aby określić długość prefiksu w adresie IPv4, należy ustalić

Interfejs równoległy, który ma magistralę złożoną z 8 linii danych, 4 linii sterujących oraz 5 linii statusowych, nie zawiera linii zasilających i umożliwia transmisję na dystans do 5 metrów, gdy kable sygnałowe są skręcone z przewodami masy, a w przeciwnym razie na dystans do 2 metrów, jest określany mianem

Diody LED RGB funkcjonują jako źródło światła w różnych modelach skanerów

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jaką wartość liczbową reprezentuje zapis binarny 01010101?

Tryb pracy portu równoległego, bazujący na magistrali ISA, umożliwiający transfer danych do 2,4 MB/s, dedykowany dla skanerów i urządzeń wielofunkcyjnych, to

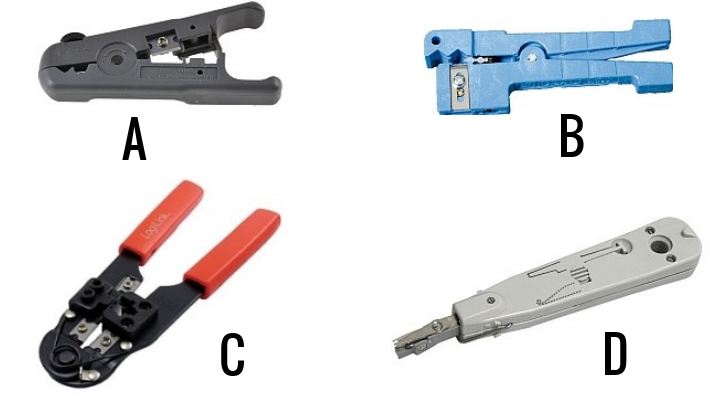

Jakie narzędzie wykorzystuje się do przytwierdzania kabla w module Keystone?

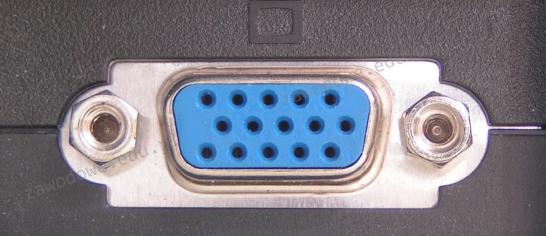

Złącze widoczne na ilustracji służy do podłączenia

Oprogramowanie OEM (Original Equipment Manufacturer) jest przypisane do

Podczas normalnego działania systemu operacyjnego w laptopie pojawił się komunikat o konieczności formatowania wewnętrznego dysku twardego. Wskazuje on na

Poprawność działania lokalnej sieci komputerowej po modernizacji powinna być potwierdzona

Jakie urządzenie w warstwie łącza danych modelu OSI analizuje adresy MAC zawarte w ramkach Ethernet i na tej podstawie decyduje o przesyłaniu sygnału pomiędzy segmentami sieci lub jego blokowaniu?

Administrator systemu Linux wydał polecenie mount /dev/sda2 /mnt/flash . Spowoduje ono

Tester strukturalnego okablowania umożliwia weryfikację

Na którym standardowym porcie funkcjonuje serwer WWW wykorzystujący domyślny protokół HTTPS w typowym ustawieniu?

Zewnętrzny dysk 3,5 cala o pojemności 5 TB, przeznaczony do archiwizacji lub tworzenia kopii zapasowych, dysponuje obudową z czterema różnymi interfejsami komunikacyjnymi. Który z tych interfejsów powinno się użyć do podłączenia do komputera, aby uzyskać najwyższą prędkość transferu?

W terminalu systemu Windows, do zarządzania parametrami konta użytkownika komputera, takimi jak okres ważności hasła, minimalna długość hasła, czas blokady konta i inne, wykorzystywane jest polecenie

Jakie miejsce nie powinno być wykorzystywane do przechowywania kopii zapasowych danych z dysku twardego komputera?

Drukarka została zainstalowana w systemie Windows. Aby ustawić między innymi domyślną orientację wydruku, liczbę stron na arkusz oraz kolorystykę, podczas jej konfiguracji należy skorzystać z opcji

Jak nazywa się licencja oprogramowania, która pozwala na bezpłatne rozpowszechnianie aplikacji?

W systemie Linux narzędzie fsck służy do

Aby w systemie Linux wykonać kopię zapasową określonych plików, należy wprowadzić w terminalu polecenie programu

Płyta główna z gniazdem G2 będzie kompatybilna z procesorem

Licencja na Office 365 PL Personal (na 1 stanowisko, subskrypcja na 1 rok) ESD jest przypisana do

Protokół Transport Layer Security (TLS) jest rozwinięciem standardu

Czym wyróżniają się procesory CISC?

Jaką długość w bitach ma adres logiczny IPv6?

Narzędzia do dostosowywania oraz Unity Tweak Tool to aplikacje w systemie Linux przeznaczone do

Jaki adres IPv6 jest stosowany jako adres link-local w procesie autokonfiguracji urządzeń?

Złącze SC stanowi standard w cablach

Urządzenie pokazane na ilustracji służy do zgrzewania wtyków

Aby zwiększyć lub zmniejszyć rozmiar ikony na pulpicie, należy obracać kółkiem myszy, trzymając jednocześnie wciśnięty klawisz

Która edycja systemu operacyjnego Windows Server 2008 charakteryzuje się najmniej rozbudowanym interfejsem graficznym?