Pytanie 1

Jaką funkcję pełni serwer FTP?

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Jaką funkcję pełni serwer FTP?

Przesyłanie danych przez router, które wiąże się ze zmianą adresów IP źródłowych lub docelowych, określa się skrótem

Aby zapewnić łączność urządzenia mobilnego z komputerem za pośrednictwem interfejsu Bluetooth, konieczne jest

W wyniku polecenia net accounts /MINPWLEN:11 w systemie Windows, wartość 11 będzie przypisana do

W sekcji zasilania monitora LCD, powiększone kondensatory elektrolityczne mogą prowadzić do uszkodzenia

Jaką prędkość przesyłu danych określa standard sieci Ethernet IEEE 802.3z?

Komputer jest połączony z siecią Internetową i nie posiada zainstalowanego oprogramowania antywirusowego. Jak można sprawdzić, czy ten komputer jest zainfekowany wirusem, nie wchodząc w ustawienia systemowe?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Aby naprawić zasilacz laptopa poprzez wymianę kondensatorów, jakie narzędzie powinno się wykorzystać?

Który z standardów korzysta z częstotliwości 5 GHz?

Administrator systemu Linux wydał polecenie mount /dev/sda2 /mnt/flash . Spowoduje ono

Na urządzeniu znajduje się symbol, który stanowi certyfikat potwierdzający zgodność sprzętu w zakresie emisji promieniowania, ergonomii, efektywności energetycznej oraz ekologii, co przedstawiono na rysunku

Aby uniknąć utraty danych w systemie do ewidencji uczniów, po zakończeniu codziennej pracy należy wykonać

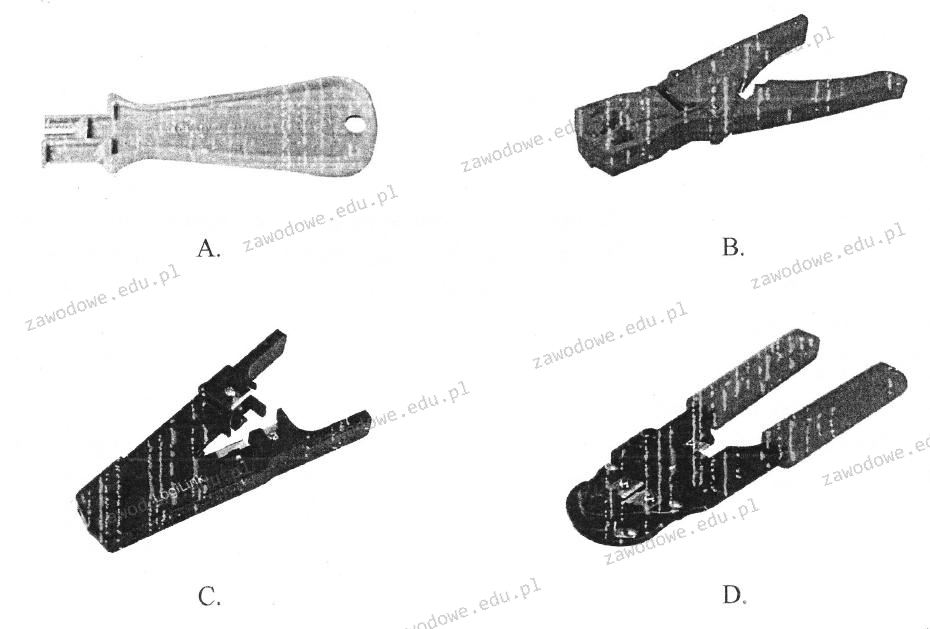

Jaki instrument jest używany do usuwania izolacji?

Do jakiego celu służy program fsck w systemie Linux?

Zanim przystąpisz do modernizacji komputerów osobistych oraz serwerów, polegającej na dodaniu nowych modułów pamięci RAM, powinieneś zweryfikować

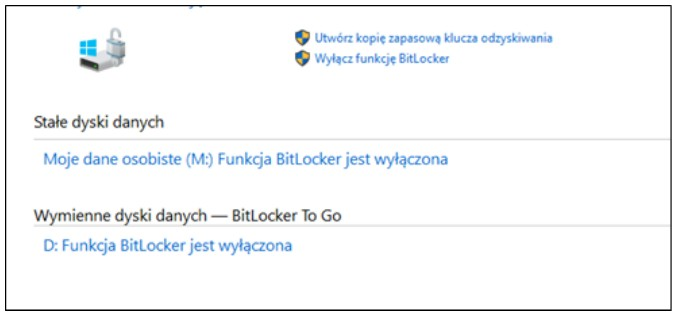

Narzędzie wbudowane w systemy Windows w edycji Enterprise lub Ultimate ma na celu

Jeżeli w konfiguracji karty graficznej zostanie wybrane odświeżanie obrazu większe od zalecanego, monitor CRT spełniający normy TCO 99

Który sterownik drukarki jest niezależny od urządzenia i systemu operacyjnego oraz jest standardem w urządzeniach poligraficznych?

Usługa umożliwiająca przechowywanie danych na zewnętrznym serwerze, do którego dostęp możliwy jest przez Internet to

Symbol zaprezentowany powyżej, używany w dokumentacji technicznej, wskazuje na

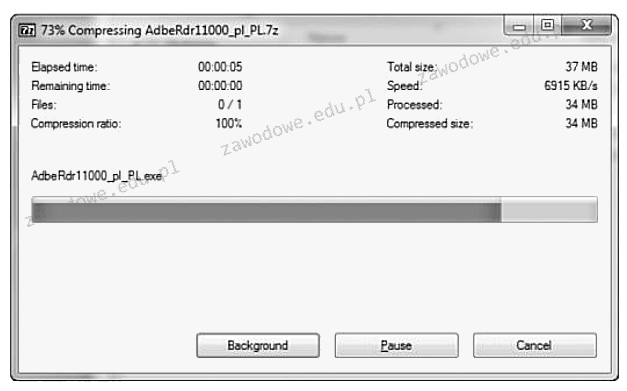

Na dołączonym obrazku pokazano działanie

Gdzie w systemie Linux umieszczane są pliki specjalne urządzeń, które są tworzone podczas instalacji sterowników?

Przedstawiony moduł pamięci należy zamontować na płycie głównej w gnieździe

Na wyświetlaczu drukarki widnieje komunikat "PAPER JAM". Aby zlikwidować problem, należy w pierwszej kolejności

Liczby zapisane w systemie binarnym jako 10101010 oraz w systemie heksadecymalnym jako 2D odpowiadają następującym wartościom:

Polecenie chmod +x test

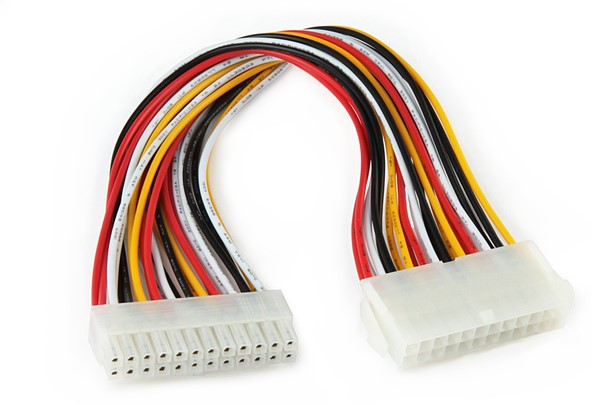

Na ilustracji zaprezentowano kabel

Okablowanie pionowe w sieci strukturalnej łączy jakie elementy?

Jakie oprogramowanie pełni rolę serwera DNS w systemie Linux?

Funkcja systemu Windows Server, umożliwiająca zdalną instalację systemów operacyjnych na komputerach kontrolowanych przez serwer, to

Klient dostarczył niesprawny sprzęt komputerowy do serwisu. Serwisant w trakcie procedury przyjęcia sprzętu, lecz przed przystąpieniem do jego naprawy, powinien

W jakiej topologii fizycznej sieci każde urządzenie w sieci posiada dokładnie dwa połączenia, jedno z każdym z sąsiadów, a dane są przesyłane z jednego komputera do drugiego w formie pętli?

Jakie jest właściwe IP dla maski 255.255.255.0?

Zarządzaniem czasem procesora dla różnych zadań zajmuje się

Jakie oznaczenie odnosi się do normy dotyczącej okablowania strukturalnego?

Jakie polecenie w systemie Linux służy do przypisania adresu IP oraz maski podsieci dla interfejsu eth0?

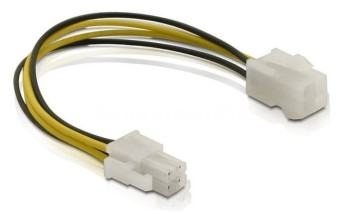

Wskaż złącze, które należy wykorzystać do podłączenia wentylatora, którego parametry przedstawiono w tabeli.

| Wymiar radiatora | 123 x 133 x 163 mm |

| Wentylator | 120 mm + 135 mm |

| Złącze | 4-pin PWM |

| Napięcie zasilające | 12V |

| Żywotność | 300 000h |

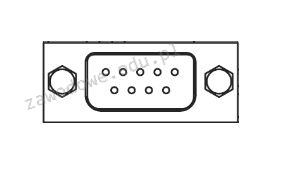

Obrazek ilustruje rodzaj złącza

Aby podnieść wydajność komputera w grach, karta graficzna Sapphire Radeon R9 FURY OC, 4GB HBM (4096 Bit), HDMI, DVI, 3xDP została wzbogacona o technologię