Pytanie 1

Aby zdalnie i jednocześnie bezpiecznie zarządzać systemem Linux, należy zastosować protokół

Wynik: 36/40 punktów (90,0%)

Wymagane minimum: 20 punktów (50%)

Aby zdalnie i jednocześnie bezpiecznie zarządzać systemem Linux, należy zastosować protokół

Jaką inną formą można zapisać 2^32 bajtów?

Ile wynosi pojemność jednowarstwowej płyty Blu-ray?

Urządzenie komputerowe, które powinno być koniecznie podłączone do zasilania za pomocą UPS, to

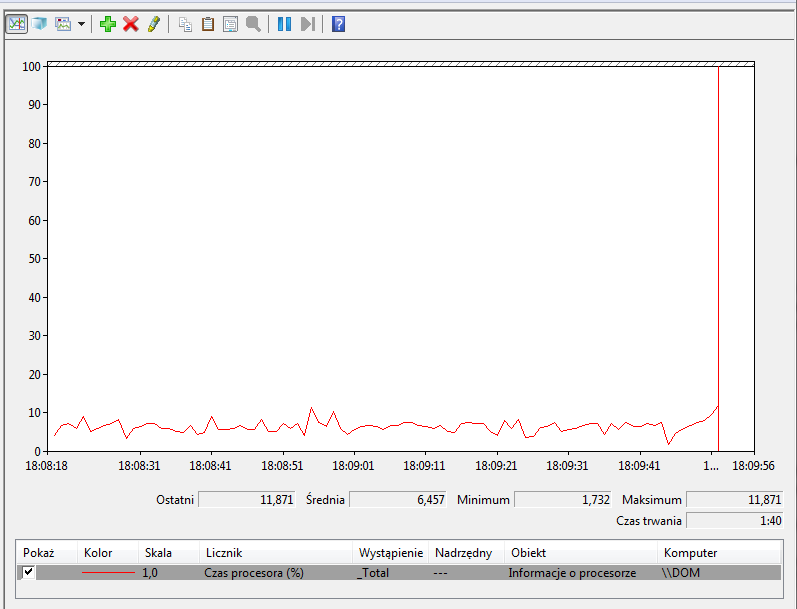

By uruchomić w systemie Windows oprogramowanie narzędziowe monitorujące wydajność komputera przedstawione na rysunku, należy uruchomić

Kluczowy sposób zabezpieczenia danych w sieci komputerowej przed nieautoryzowanym dostępem to

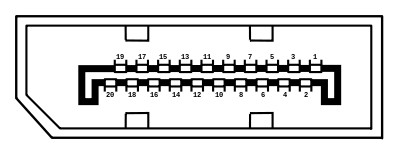

Na ilustracji ukazano port

Który adres IP jest powiązany z nazwą mnemoniczna localhost?

Który z protokołów powinien być zastosowany do pobierania wiadomości e-mail z własnego serwera?

W systemie Windows przypadkowo usunięto konto użytkownika, ale katalog domowy pozostał. Czy możliwe jest odzyskanie niezaszyfrowanych danych z katalogu domowego tego użytkownika?

Pamięć podręczna Intel Smart Cache, która znajduje się w procesorach wielordzeniowych, takich jak Intel Core Duo, to pamięć

Jak ustawić w systemie Windows Server 2008 parametry protokołu TCP/IP karty sieciowej, aby komputer mógł jednocześnie funkcjonować w dwóch sieciach lokalnych o różnych adresach IP?

W systemie Linux narzędzie do śledzenia zużycia CPU, pamięci, procesów oraz obciążenia systemu z poziomu terminala to

Jakie rodzaje partycji mogą występować w systemie Windows?

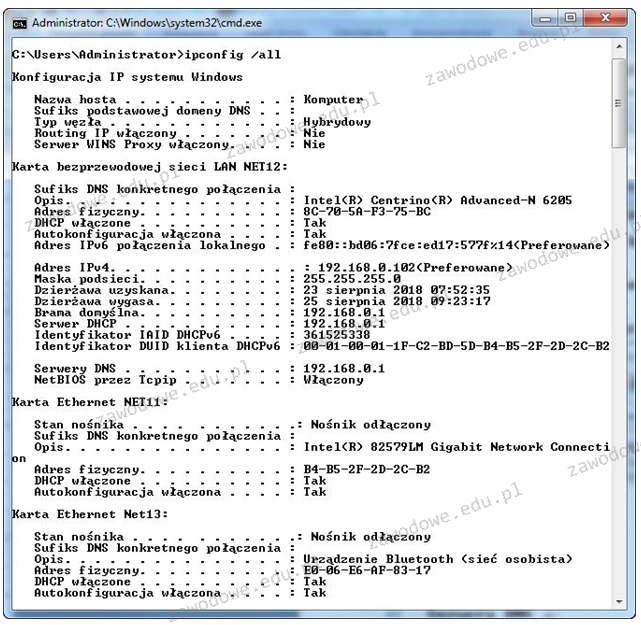

Analizując przedstawione wyniki konfiguracji zainstalowanych kart sieciowych na komputerze, można zauważyć, że

Złącze umieszczone na płycie głównej, które umożliwia podłączanie kart rozszerzeń o różnych ilościach pinów, w zależności od wersji, nazywane jest

Która edycja systemu operacyjnego Windows Server 2008 charakteryzuje się najmniej rozbudowanym interfejsem graficznym?

Aby zwiększyć wydajność komputera, można zainstalować procesor obsługujący technologię Hyper-Threading, która pozwala na

Jeden długi oraz dwa krótkie sygnały dźwiękowe BIOS POST od firm AMI i AWARD wskazują na wystąpienie błędu

Jaki protokół stworzony przez IBM służy do udostępniania plików w architekturze klient-serwer oraz do współdzielenia zasobów z sieciami Microsoft w systemach operacyjnych LINUX i UNIX?

ACPI jest skrótem oznaczającym

Jakie urządzenie wykorzystuje się do pomiaru napięcia w zasilaczu?

Częścią eksploatacyjną drukarki laserowej nie jest

Podstawowym celem użycia przełącznika /renew w poleceniu ipconfig w systemie Windows jest

Jakie złącze jest potrzebne do podłączenia zasilania do CD-ROM?

Jaką pojemność ma dwuwarstwowa płyta Blu-ray?

Ile sieci obejmują adresy IPv4 pokazane w tabeli?

| Adres IPv4 | Maska sieci |

|---|---|

| 10.10.10.10 | 255.255.0.0 |

| 10.10.20.10 | 255.255.0.0 |

| 10.10.20.20 | 255.255.0.0 |

| 10.10.30.30 | 255.255.0.0 |

| 10.20.10.10 | 255.255.0.0 |

| 10.20.20.10 | 255.255.0.0 |

| 10.20.20.30 | 255.255.0.0 |

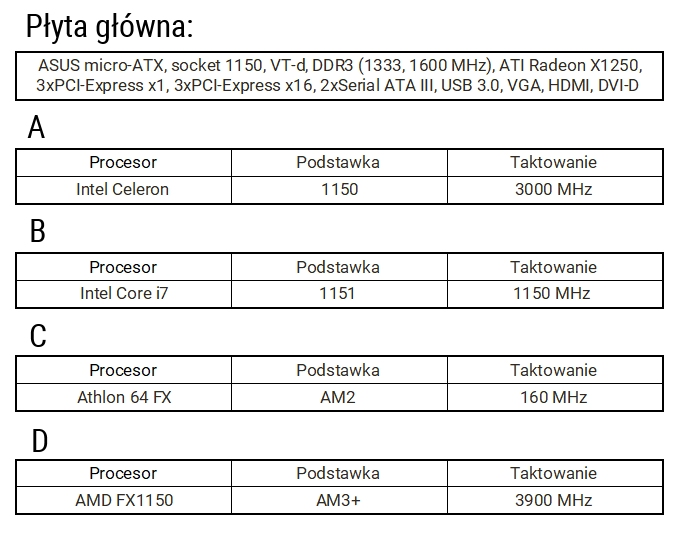

Jaki procesor pasuje do płyty głównej o podanej specyfikacji?

Jaką wartość przepustowości definiuje standard 1000Base-T?

Program, który ocenia wydajność zestawu komputerowego, to

Przy użyciu urządzenia zobrazowanego na rysunku możliwe jest sprawdzenie działania

W ramach zalecanych działań konserwacyjnych użytkownicy dysków SSD powinni unikać wykonywania

Jakie jest wynikiem dodawania liczb binarnych 1001101 oraz 11001 w systemie dwójkowym?

Jakie zastosowanie ma narzędzie tracert w systemach operacyjnych rodziny Windows?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jaki protokół do obsługi poczty elektronicznej pozwala na przykład na przechowywanie odebranych e-maili na serwerze, zarządzanie różnymi folderami, usuwanie wiadomości oraz przenoszenie ich pomiędzy folderami?

W systemie Windows, gdzie należy ustalić wymagania dotyczące złożoności hasła?

Aby zabezpieczyć system przed atakami z sieci nazywanymi phishingiem, nie powinno się

Który z parametrów okablowania strukturalnego definiuje stosunek mocy sygnału tekstowego w jednej parze do mocy sygnału wyindukowanego w sąsiedniej parze na tym samym końcu kabla?

Jaką usługą można pobierać i przesyłać pliki na serwer?