Pytanie 1

Jakiego typu papier należy zastosować w aparacie elektrokardiograficznym?

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Jakiego typu papier należy zastosować w aparacie elektrokardiograficznym?

Które polecenie SQL nie modyfikuje tabeli bazy danych?

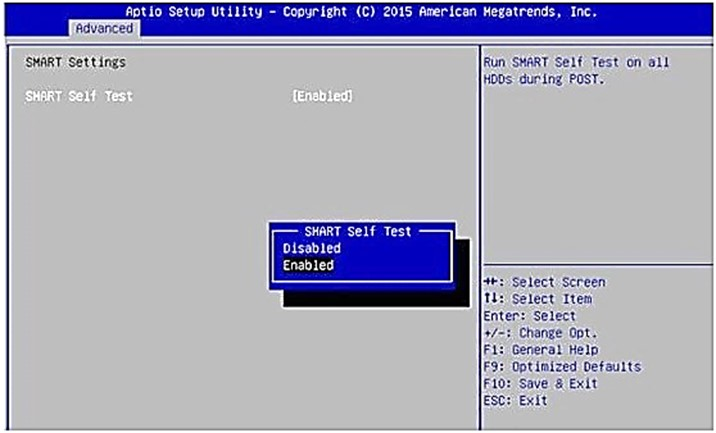

Z przedstawionego zrzutu wynika, że na dyskach zastosowano partycjonowanie

Funkcja f(n) = nf(n-1) dla n>1 w przeciwnym wypadku f(n) = 1 jest przykładem

Który system montażu urządzeń przedstawiono na rysunku?

Parametr CL (czas opóźnienia, jaki upływa między wysłaniem przez kontroler RAM żądania dostępu do kolumny pamięci a otrzymaniem danych z tej kolumny) jest wyrażany w

Do badań ultrasonograficznych struktur płytko położonych (np. tarczycy) stosuje się głowicę

Dla sieci o adresie 192.150.160.0/26 pula adresów IP dla urządzeń w tej sieci zawiera się w zakresie

Jaki format danych należy zastosować do archiwizacji, kompresji i szyfrowania danych?

Aby uruchomić w systemie linux program nazwa.py, należy wpisać

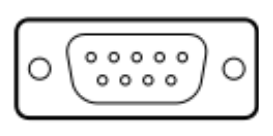

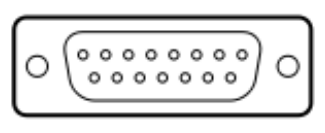

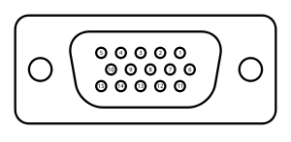

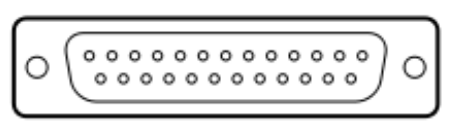

Zgodnie z przedstawionym opisem, gniazdo interfejsu służące do podłączenia audiometru ze stanowiskiem komputerowym przedstawione jest na rysunku

| Opis: |

| − 125 Hz ÷ 8.000 Hz − -10 dB do 120 dB HL na wyjściu − połączenie z komputerem PC – interfejs RS232 − połączenie z drukarką laserową − połączenie z drukarką atramentową |

Jakie jest przeznaczenie drukarki, której dotyczy zamieszczony fragment specyfikacji?

| Głowica drukująca | 24-igłowa |

| Średnica przewodu | 0,2 mm |

| Kierunek druku | Dwukierunkowe/bezkierunkowe drukowanie |

| Rozdzielczość grafiki | Maks. 360 (wys.) x 360 (szer.) dpi |

| Szybkość drukowania | High Speed Draft: 607 znaków/s, tryb Utility: 485 znaków/s, tryb Near Letter Quality: 245 znaków/s, Letter Quality: 165 znaków/s |

| Gęstość przesunięć wierszy | 4,23 mm (1/6"), 3,18 mm (1/8"), n x 0,42 mm (m/60") (m=0-127), n x 0,14 mm (n/180") (n=0-255), n x 0,12 mm (n/216") (n=0-255), n x 0,07 mm (n/360") (n=0-255) |

| Szybkość podajnika | 10 cali na sekundę |

| Pobieranie papieru | Ręczne (góra), traktor pchający (góra), traktor pchający (tył), traktor pchający (dół), podajnik pojedynczych arkuszy (tył) |

| Gęstość znaków | High Speed Draft: 10,0 zn./cal 18,0 zn./cal Jakość użytkowa: 10,0 zn./cal 12,0 zn./cal 15,0 zn./cal 17,1 zn./cal 20 zn./cal Tryb Near Letter Quality: 10,0 zn./cal 12,0 zn./cal 15,0 zn./cal 17,1 zn./cal 20,0 zn./cal Tryb Letter Quality: 10 zn./cal 12 zn./cal 15 zn./cal 17,1 zn./cal 20 zn./cal, proporcjonalnie |

| Szerokość druku | 136 zn./linia przy ANK 10 zn./cal |

Które badanie endoskopowe należy wykorzystać do wizualizacji jamy stawu?

Wymieniając bezpiecznik w medycznym module zasilającym, wymagającym zastosowania wkładki topikowej zwłocznej, należy użyć elementu oznaczonego symbolem literowym

Czujnik tensometryczny i sonda ultradźwiękowa są elementami aparatu

Do pomiaru objętości i pojemności płuc w różnych fazach cyklu oddechowego służy

Procesor GPU jest odpowiedzialny za wykonywanie operacji obliczeniowych w karcie

Urządzenie przedstawione na rysunku jest przeznaczone do

Jaką funkcję pełni przedstawiona na rysunku procedura BIOS?

Struktura anatomiczna człowieka, która jest nazywana krytyczną ze względu na szczególną wrażliwość na zewnętrzne promieniowanie jonizujące, to

Który rodzaj promieniowania jonizującego jest całkowicie pochłaniany przez naskórek, nie docierając do głębszych warstw tkanek?

Zapis w dokumentacji technicznej elektrokardiografu określający V1, V2, …V6 dotyczy odprowadzeń

W programowaniu, aby przerwać wykonywanie pętli i wyjść z niej, należy użyć polecenia

W celu archiwizacji danych w systemie Windows, jest wymagane kopiowanie z katalogu źródłowego (kat_zrodlowy) do katalogu docelowego (kat_docelowy). Do kopiowania danych należy użyć polecenia

Pamięć statyczna RAM ma zastosowanie jako pamięć

W celu rejestracji promieniowania radioizotopu nagromadzonego w narządach stosowana jest

Które oznaczenie określa zapis elektryczny aktywności mózgu?

Dokręcenie śrub mocujących z wartością momentu 6 Nm, zgodnie z instrukcją montażową, należy wykonać kluczem

Promieniowanie IR jest wykorzystywane w

Podczas tworzenia bazy danych pacjentów polem unikatowym pełniącym rolę klucza podstawowego jest pole zawierające informacje o

Który system informatyki medycznej umożliwia archiwizację obrazów?

Które polecenie umożliwia śledzenie drogi pakietów w sieci?

Wymianą informacji pomiędzy układami znajdującymi się na płycie głównej komputera steruje

Konserwacja oprogramowania nie obejmuje

Pod wpływem przegrzania organizmu dochodzi do

Wybierz narzędzie służące do zamocowania przedstawionej na rysunku końcówki kompresyjnej F na kablu koncentrycznym.

Urządzenie do rejestracji bioelektrycznych potencjałów mięśniowych to

W dokumentacji testera aparatury medycznej podano następujące informacje:

|

Badanie obrazujące fizyczny rozwój płodu wykonywane jest przy użyciu

Który system bazodanowy uniemożliwia bezpłatne zastosowanie komercyjne?