Pytanie 1

Po zainstalowaniu aplikacji VNC, używanej do obserwacji pulpitu konkretnego komputera, oprócz numeru portu należy wskazać jego

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Po zainstalowaniu aplikacji VNC, używanej do obserwacji pulpitu konkretnego komputera, oprócz numeru portu należy wskazać jego

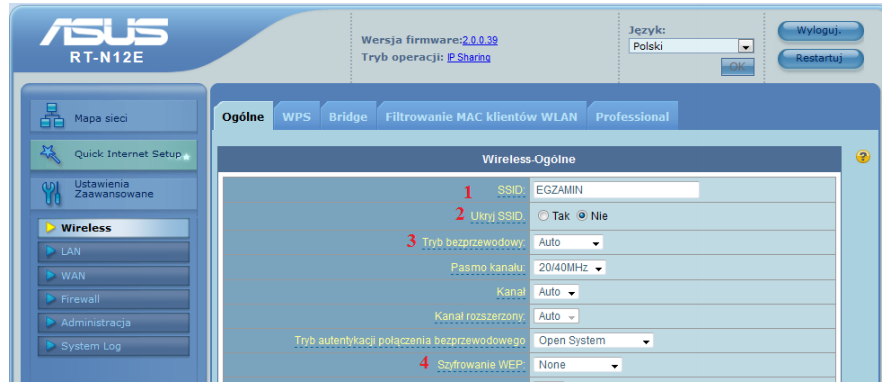

Aby zablokować widoczność identyfikatora sieci Wi-Fi, konieczne jest dokonanie zmian w ustawieniach rutera w sekcji oznaczonej numerem

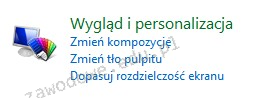

Na ilustracji ukazano narzędzie systemu Windows 7 służące do

Wskaż technologię stosowaną do dostarczania Internetu, która jest połączona z usługą telewizji kablowej, w której światłowód oraz kabel koncentryczny pełnią rolę medium transmisyjnego.

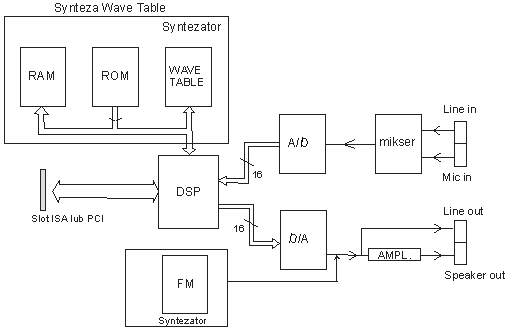

Który z elementów przedstawionych na diagramie karty dźwiękowej na rysunku jest odpowiedzialny za cyfrowe przetwarzanie sygnałów?

Na płycie głównej uszkodzona została zintegrowana karta sieciowa. Komputer nie ma zainstalowanego dysku twardego ani żadnych innych napędów, takich jak stacja dysków czy CD-ROM. Klient informuje, że w firmowej sieci komputery nie mają napędów, a wszystko "czyta" się z serwera. W celu przywrócenia utraconej funkcji należy zainstalować

Gniazdo w sieciach komputerowych, które jednoznacznie identyfikuje dany proces na urządzeniu, stanowi kombinację

Zamiana taśmy barwiącej wiąże się z eksploatacją drukarki

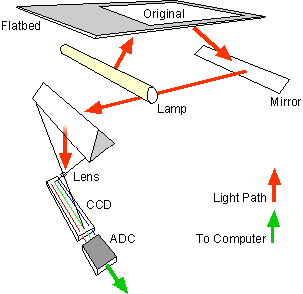

Optyczna rozdzielczość to jeden z właściwych parametrów

Przedstawiony schemat przedstawia zasadę działania

Przedstawione na ilustracji narzędzie jest przeznaczone do

Które bity w 48-bitowym adresie MAC identyfikują producenta?

Z jaką informacją wiąże się parametr TTL po wykonaniu polecenia ping?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jaki protokół powinien być ustawiony w switchu sieciowym, aby uniknąć występowania zjawiska broadcast storm?

Aby połączyć dwa przełączniki oddalone o 200 m i zapewnić minimalną przepustowość 200 Mbit/s, powinno się użyć

Który z protokołów służy do weryfikacji poprawności połączenia między dwoma hostami?

Jak przywrócić stan rejestru systemowego w edytorze Regedit, wykorzystując wcześniej utworzoną kopię zapasową?

Aby osiągnąć optymalną prędkość przesyłu danych, gdy domowy ruter działa w paśmie 5 GHz, do laptopa należy zainstalować kartę sieciową bezprzewodową obsługującą standard

Aby móc korzystać z telefonu PSTN do nawiązywania połączeń za pośrednictwem sieci komputerowej, należy go podłączyć do

Jaką usługę powinno się aktywować na ruterze, aby każda stacja robocza mogła wymieniać pakiety z siecią Internet, gdy dostępnych jest 5 adresów publicznych oraz 18 stacji roboczych?

Narzędzie System Image Recovery dostępne w zaawansowanych opcjach uruchamiania systemu Windows 7 pozwala na

Analiza danych wyświetlonych przez program umożliwia stwierdzenie, że

Który z podanych adresów IP należy do klasy A?

Złącze widoczne na obrazku pozwala na podłączenie

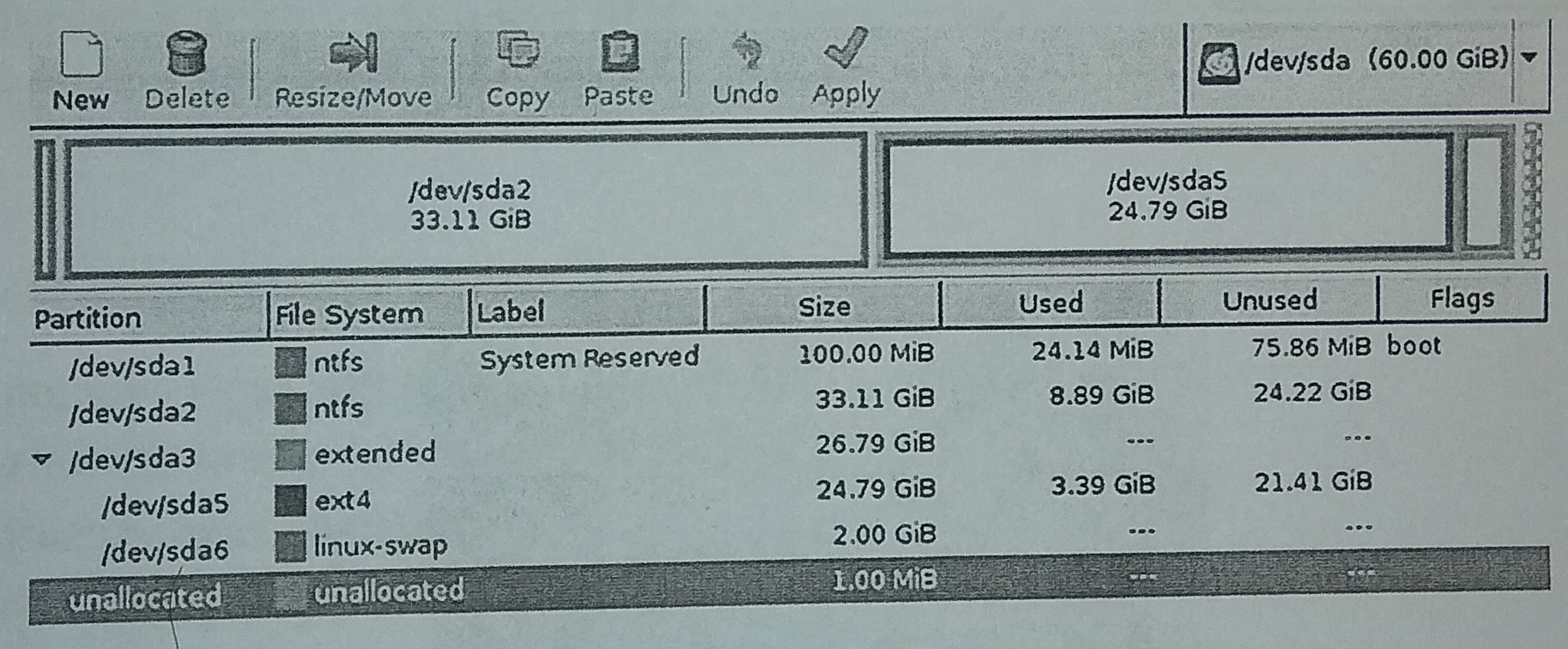

Narzędziem służącym do tworzenia logicznych podziałów na dysku twardym w systemie GNU/Linux jest

W trakcie instalacji systemu Windows Serwer 2022 istnieje możliwość instalacji w trybie Core. Oznacza to, że system zostanie zainstalowany

Router Wi-Fi działający w technologii 802.11n umożliwia osiągnięcie maksymalnej prędkości przesyłu danych

Które z poniższych stwierdzeń NIE odnosi się do pamięci cache L1?

Użycie polecenia net accounts w Wierszu poleceń systemu Windows, które ustawia maksymalny czas ważności hasła, wymaga zastosowania opcji

Komenda dsadd pozwala na

Jakiego typu wkrętak należy użyć do wypięcia dysku twardego mocowanego w laptopie za pomocą podanych śrub?

Jakie urządzenie powinno zostać użyte do segmentacji domeny rozgłoszeniowej?

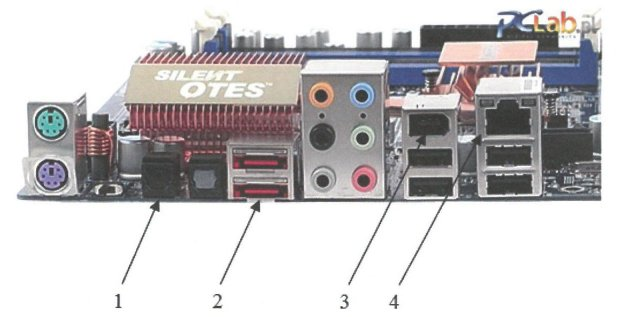

Który z portów na pokazanej płycie głównej pozwala na podłączenie zewnętrznego dysku za pośrednictwem interfejsu e-SATA?

Jakie urządzenie stosuje się do pomiaru rezystancji?

Na płycie głównej doszło do awarii zintegrowanej karty sieciowej. Komputer nie ma dysku twardego ani innych napędów, takich jak stacja dysków czy CD-ROM. Klient informuje, że w sieci firmowej komputery nie mają napędów, a wszystko "czyta" się z serwera. Aby przywrócić utraconą funkcjonalność, należy zainstalować

W systemie Windows 7 program Cipher.exe w trybie poleceń jest używany do

Jakie polecenie diagnostyczne powinno się użyć, aby uzyskać informacje na temat tego, czy miejsce docelowe odpowiada oraz po jakim czasie nastąpiła odpowiedź?

Która z usług serwerowych oferuje automatyczne ustawienie parametrów sieciowych dla stacji roboczych?

Jaką partycją w systemie Linux jest magazyn tymczasowych danych, gdy pamięć RAM jest niedostępna?