Pytanie 1

Funkcja "Mostek sieciowy" w Windows XP Professional umożliwia łączenie różnych

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Funkcja "Mostek sieciowy" w Windows XP Professional umożliwia łączenie różnych

Jaką licencję musi mieć oprogramowanie, aby użytkownik mógł wprowadzać w nim zmiany?

W celu konserwacji elementów z łożyskami oraz ślizgami w urządzeniach peryferyjnych wykorzystuje się

Zamianę uszkodzonych kondensatorów w karcie graficznej umożliwi

Menadżer rozruchu, który umożliwia wybór systemu operacyjnego Linux do załadowania, to

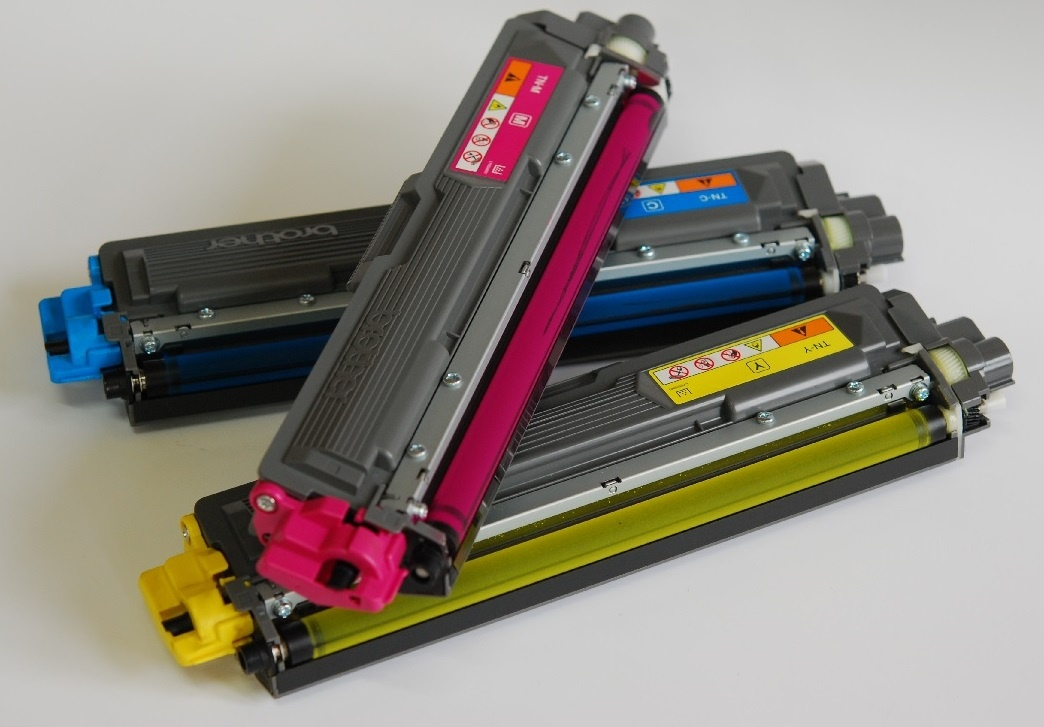

Na ilustracji przedstawiono

Wskaż interfejsy płyty głównej widoczne na rysunku.

Dobrze zaprojektowana sieć komputerowa powinna zapewniać możliwość rozbudowy, czyli charakteryzować się

Aby skopiować katalog c: est z podkatalogami na dysk przenośny f: w systemie Windows 7, jakie polecenie należy zastosować?

Który protokół jest odpowiedzialny za przekształcanie adresów IP na adresy MAC w kontroli dostępu do nośnika?

Aby system operacyjny mógł szybciej uzyskiwać dostęp do plików zapisanych na dysku twardym, konieczne jest wykonanie

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Jak nazywa się identyfikator, który musi być jednakowy, aby urządzenia sieciowe mogły współpracować w danej sieci bezprzewodowej?

Wykonanie polecenia fsck w systemie Linux spowoduje

W którym z rejestrów wewnętrznych procesora są przechowywane dodatkowe informacje o wyniku realizowanej operacji?

Do przechowywania fragmentów dużych plików programów i danych, które nie mieszczą się w pamięci, wykorzystuje się

Jakie polecenie w systemie Linux przyzna możliwość zapisu dla wszystkich obiektów w /usr/share dla wszystkich użytkowników, nie modyfikując innych uprawnień?

Na jakich portach brama sieciowa powinna umożliwiać ruch, aby klienci w sieci lokalnej mieli możliwość ściągania plików z serwera FTP?

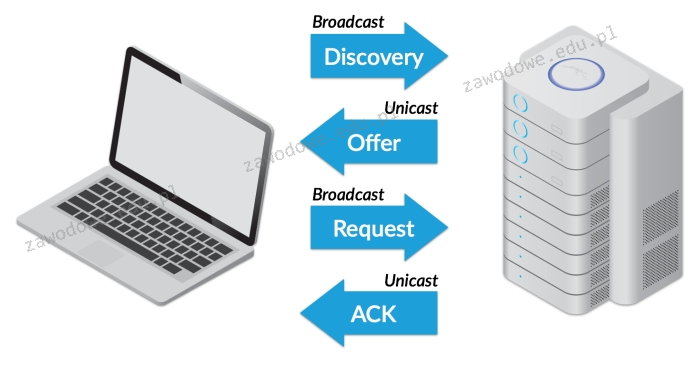

Którego protokołu działanie zostało zaprezentowane na diagramie?

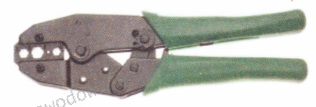

Do jakiego typu wtyków przeznaczona jest zaciskarka pokazana na ilustracji?

Złącze SC powinno być zainstalowane na przewodzie

Czym jest licencja OEM?

Wirusy polimorficzne mają jedną charakterystyczną cechę, którą jest

Według normy PN-EN 50174 maksymalny rozplot kabla UTP powinien wynosić nie więcej niż

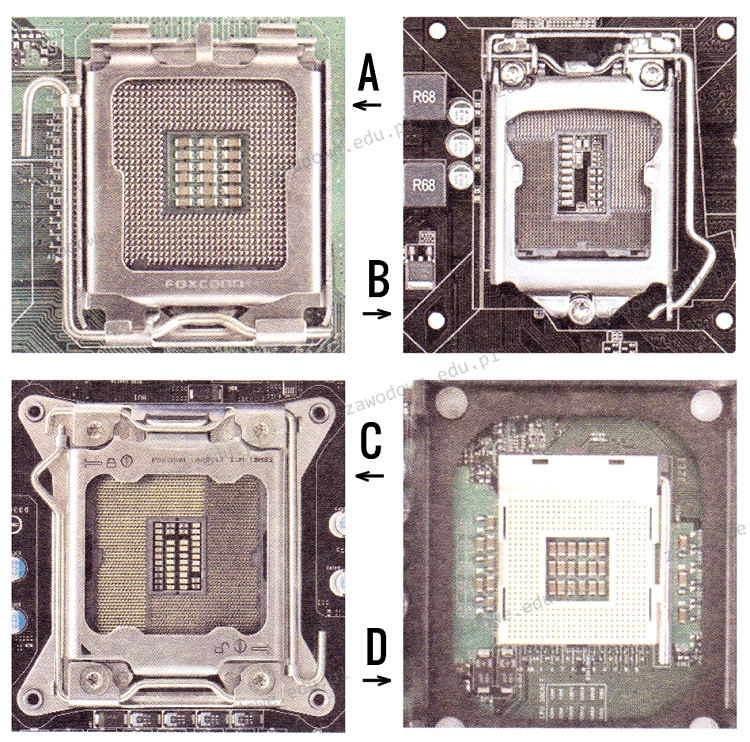

W jakim gnieździe powinien być umieszczony procesor INTEL CORE i3-4350- 3.60 GHz, x2/4, 4MB, 54W, HD 4600, BOX, s-1150?

W które złącze, umożliwiające podłączenie monitora, wyposażona jest karta graficzna przedstawiona na ilustracji?

Jakie narzędzie w systemie Windows umożliwia kontrolę prób logowania do systemu?

W systemie Linux komenda chmod pozwala na

Podczas monitorowania aktywności sieciowej zauważono, że na adres serwera przesyłano tysiące zapytań DNS w każdej sekundzie z różnych adresów IP, co doprowadziło do zawieszenia systemu operacyjnego. Przyczyną tego był atak typu

Jak nazywa się atak na sieć komputerową, który polega na przechwytywaniu przesyłanych w niej pakietów?

Jaki akronim oznacza wydajność sieci oraz usługi, które mają na celu między innymi priorytetyzację przesyłanych pakietów?

Jaką kwotę będzie trzeba zapłacić za wymianę karty graficznej w komputerze, jeżeli jej koszt wynosi 250zł, czas wymiany to 80 minut, a każda rozpoczęta roboczogodzina to 50zł?

Które z poniższych twierdzeń na temat protokołu DHCP jest poprawne?

Jakie polecenie w systemie operacyjnym Linux służy do monitorowania komunikacji protokołów TCP/IP lub innych przesyłanych lub odbieranych w sieci komputerowej, do której jest podłączony komputer użytkownika?

W tabeli zaprezentowano parametry trzech dysków twardych w standardzie Ultra320 SCSI. Te dyski są w stanie osiągnąć maksymalny transfer wewnętrzny

| Rotational Speed | 10,025 rpm | ||

| Capacity (Formatted) | 73.5GB | 147GB | 300GB |

| Number of Heads | 2 | 5 | 8 |

| Number of Disks | 1 | 3 | 4 |

| Internal Transfer Rate | Up to 132 MB/s | ||

| Interface Transfer Rate | NP/NC = 320MB/s, FC = 200MB/s | ||

| Buffer Size | |||

| Average Seek (Read/Write) | 4.5/5.0 ms | ||

| Track-to-Track Seek/Read/Write | 0.2ms/0.4ms | ||

| Maximum Seek (Read/Write) | 10/11 ms | ||

| Average Latency | 2.99 ms | ||

| Power Consumption (Idle) | NP/NC = 9.5W, FC = 10.5W | ||

| Acoustic Noise | 3.4 bels | ||

| Shock - Operating/Non-Operating | 65G/225G 2ms | ||

Martwy piksel, będący defektem monitorów LCD, to punkt, który trwa niezmiennie w kolorze

W przypadku, gdy w tej samej przestrzeni będą funkcjonować jednocześnie dwie sieci WLAN zgodne ze standardem 802.11g, w celu zminimalizowania ryzyka wzajemnych zakłóceń, powinny one otrzymać kanały o numerach różniących się o

Sprzętem, który umożliwia wycinanie wzorów oraz grawerowanie w różnych materiałach, takich jak drewno, szkło i metal, jest ploter

Liczba 54321₍₈₎ zapisana w systemie szesnastkowym ma postać

W terminalu systemu operacyjnego wykonano polecenie nslookup. Jaką informację uzyskano?