Pytanie 1

Czym jest klaster komputerowy?

Wynik: 30/40 punktów (75,0%)

Wymagane minimum: 20 punktów (50%)

Czym jest klaster komputerowy?

Jakim materiałem eksploatacyjnym jest ploter solwentowy?

Co umożliwia połączenie trunk dwóch przełączników?

Do jakiego pomiaru wykorzystywany jest watomierz?

W formacie plików NTFS, do zmiany nazwy pliku potrzebne jest uprawnienie

Z jaką informacją wiąże się parametr TTL po wykonaniu polecenia ping?

Komputer, którego naprawa ma zostać przeprowadzona u klienta, nie reaguje na wciśnięcie przycisku POWER. Pierwszą czynnością harmonogramu prac związanych z lokalizacją i usunięciem tej usterki powinno być

Jakie polecenie pozwala na uzyskanie informacji o bieżących połączeniach TCP oraz o portach źródłowych i docelowych?

Oblicz całkowity koszt za realizację poniższych czynności serwisowych, przy założeniu, że stawka za jedną roboczogodzinę wynosi 120,00 zł netto, a podatek VAT wynosi 23%.

| LP | Zrealizowane czynności serwisowe | Ilość roboczogodzin |

|---|---|---|

| 1. | Diagnozowanie usterki | 0,2 |

| 2. | Wymiana zasilacza | 0,5 |

| 3. | Przygotowanie drukarki do eksploatacji | 0,6 |

| 4. | Konserwacja urządzenia drukującego | 1,0 |

| 5. | Sprawdzanie po zakończeniu naprawy | 0,2 |

Jaką kwotę będzie trzeba zapłacić za wymianę karty graficznej w komputerze, jeżeli jej koszt wynosi 250zł, czas wymiany to 80 minut, a każda rozpoczęta roboczogodzina to 50zł?

Umowa, na podstawie której użytkownik ma między innymi dostęp do kodu źródłowego oprogramowania w celu jego analizy i ulepszania, to licencja

Który protokół zamienia adresy IP na adresy MAC, używane w sieciach Ethernet?

Ile adresów urządzeń w sieci jest dostępnych dzięki zastosowaniu klasy adresowej C w systemach opartych na protokołach TCP/IP?

Jakim symbolem powinien być oznaczony sprzęt komputerowy, aby spełniał wymogi prawne konieczne do sprzedaży w Unii Europejskiej?

Aby utworzyć kontroler domeny w systemach z rodziny Windows Server na serwerze lokalnym, konieczne jest zainstalowanie roli

Jakie urządzenia dotyczą terminy SLI?

Za przydzielanie czasu procesora do konkretnych zadań odpowiada

Ile urządzeń jest w stanie współpracować z portem IEEE1394?

Pamięć RAM pokazana na ilustracji jest instalowana na płycie głównej posiadającej gniazdo

Jak brzmi pełna wersja adresu IPv6 2001:0:db8::1410:80ab?

Jakim systemem operacyjnym jest system czasu rzeczywistego?

Urządzenie z funkcją Plug and Play, które zostało ponownie podłączone do komputera, jest identyfikowane na podstawie

Które polecenie systemu Linux wyświetla czas pracy systemu oraz jego średnie obciążenie?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie oprogramowanie opisuje najnowsza wersja wieloplatformowego klienta, który cieszy się popularnością wśród użytkowników na całym świecie, oferującego wirtualną sieć prywatną do nawiązywania połączenia pomiędzy hostem a lokalnym komputerem, obsługującego uwierzytelnianie z wykorzystaniem kluczy, certyfikatów, nazwy użytkownika i hasła, a także dodatkowych kart w wersji dla Windows?

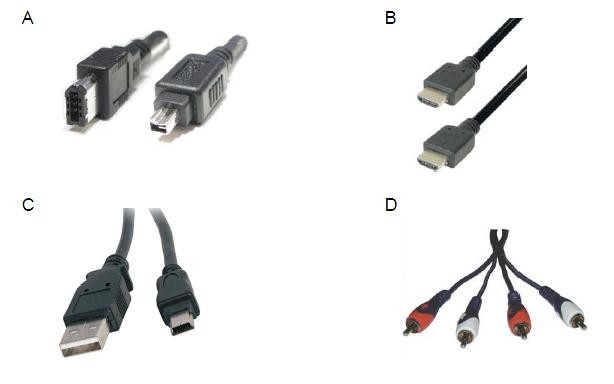

Aby połączyć cyfrową kamerę z interfejsem IEEE 1394 (FireWire) z komputerem, wykorzystuje się kabel z wtykiem zaprezentowanym na fotografii

Jaki port na tylnym panelu płyty głównej jest w dokumentacji określany jako port zgodny z normą RS232C?

Nie jest możliwe wykonywanie okresowych kopii zapasowych dysków serwera na nośnikach wymiennych typu

Parametr pamięci RAM określany czasem jako opóźnienie definiuje się jako

Pliki specjalne urządzeń, tworzone podczas instalacji sterowników w systemie Linux, są zapisywane w katalogu

Jaką liczbę adresów IP należy wykorzystać, aby 4 komputery podłączone do switcha mogły się swobodnie komunikować?

Aby uzyskać więcej wolnego miejsca na dysku bez tracenia danych, co należy zrobić?

Na ilustracji ukazano złącze zasilające

Protokół stosowany w sieciach komputerowych do zarządzania zdalnym terminalem w modelu klient-serwer, który nie gwarantuje bezpieczeństwa przekazywanych danych i funkcjonuje tylko w formacie tekstowym, to

Jakie polecenie diagnostyczne powinno się użyć, aby uzyskać informacje na temat tego, czy miejsce docelowe odpowiada oraz po jakim czasie nastąpiła odpowiedź?

Aby możliwe było zorganizowanie pracy w wydzielonych logicznie mniejszych podsieciach w sieci komputerowej, należy ustawić w przełączniku

Która lokalizacja umożliwia utworzenie kopii zapasowej dysku systemowego Windows 11?

Czym jest mapowanie dysków?

Która norma określa parametry transmisji dla komponentów kategorii 5e?

Aby zmierzyć tłumienie łącza światłowodowego w dwóch zakresach transmisyjnych 1310nm oraz 1550nm, powinno się zastosować