Pytanie 1

Wirusy polimorficzne mają jedną charakterystyczną cechę, którą jest

Wynik: 32/40 punktów (80,0%)

Wymagane minimum: 20 punktów (50%)

Wirusy polimorficzne mają jedną charakterystyczną cechę, którą jest

Użytkownik napotyka trudności przy uruchamianiu systemu Windows. W celu rozwiązania tego problemu, skorzystał z narzędzia System Image Recovery, które

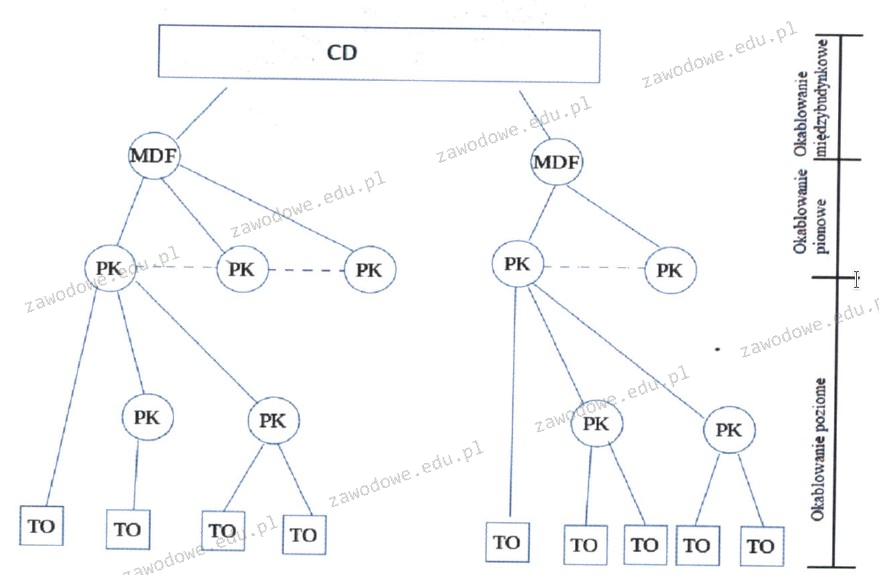

Na zaprezentowanym schemacie logicznym sieci przedstawiono

Aby zmienić port drukarki zainstalowanej w systemie Windows, która funkcja powinna zostać użyta?

Aby podczas prac montażowych zabezpieczyć szczególnie wrażliwe podzespoły elektroniczne komputera przed wyładowaniem elektrostatycznym, należy stosować

Aby uniknąć utraty danych w systemie do ewidencji uczniów, po zakończeniu codziennej pracy należy wykonać

Zgodnie z normą PN-EN 50174, okablowanie poziome w systemie okablowania strukturalnego to segment okablowania pomiędzy

W procedurze Power-On Self-Test w pierwszej kolejności wykonywane jest sprawdzanie

Jak można przywrócić domyślne ustawienia płyty głównej, gdy nie ma możliwości uruchomienia BIOS Setup?

Na przedstawionym panelu tylnym płyty głównej znajdują się między innymi następujące interfejsy:

Przedstawiony symbol znajdujący się na obudowie komputera stacjonarnego oznacza ostrzeżenie przed

W normie PN-EN 50174 nie znajdują się wytyczne dotyczące

W metodzie dostępu do medium CSMA/CD (Carrier Sense Multiple Access with Collision Detection) stacja, która planuje rozpocząć transmisję, nasłuchuje, czy w sieci występuje aktywność, a następnie

Jaki adres IP należy do urządzenia funkcjonującego w sieci 10.0.0.0/17?

W systemie dziesiętnym liczba 110011(2) przedstawia się jako

Ile adresów urządzeń w sieci jest dostępnych dzięki zastosowaniu klasy adresowej C w systemach opartych na protokołach TCP/IP?

Transmisja w standardzie 100Base-T korzysta z kabli skrętkowych, które mają

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Program iftop działający w systemie Linux ma na celu

Jakim sposobem zapisuje się dane na nośnikach BD-R?

Wyświetlony stan ekranu terminala został uzyskany podczas testu realizowanego w środowisku Windows. Techniczny pracownik zdobył w ten sposób informacje o:

Aby uzyskać listę procesów aktualnie działających w systemie Linux, należy użyć polecenia

Jaki adres IPv6 jest poprawny?

Usługi na serwerze są konfigurowane za pomocą

Aby odzyskać dane z dysku, który został sformatowany, warto użyć programu typu

Jakie urządzenie stosuje technikę polegającą na wykrywaniu zmian w pojemności elektrycznej podczas manipulacji kursorem na monitorze?

Aby zatrzymać wykonywanie programu zapisanego w pliku wsadowym Windows do momentu naciśnięcia dowolnego klawisza, należy zastosować komendę

Które z poniższych twierdzeń nie odnosi się do pamięci cache L1?

Jakie urządzenie wskazujące działa na podstawie zmian pojemności elektrycznej?

Podstawowym zadaniem mechanizmu Plug and Play jest

Urządzeniem w zestawie komputerowym, które obsługuje zarówno dane wejściowe, jak i wyjściowe, jest

Na zdjęciu widnieje

Jaką wartość ma liczba 5638 zapisana w systemie szesnastkowym?

Jaką maksymalną liczbę podstawowych partycji na dysku twardym z tablicą MBR można utworzyć za pomocą narzędzia Zarządzanie dyskami dostępnego w systemie Windows?

Jakie zagrożenie nie jest eliminowane przez program firewall?

W lokalnej sieci protokołem odpowiedzialnym za dynamiczną konfigurację adresów IP jest

Którą czynność należy wykonać podczas konfiguracji rutera, aby ukryta sieć bezprzewodowa była widoczna dla wszystkich użytkowników znajdujących się w jej zasięgu?

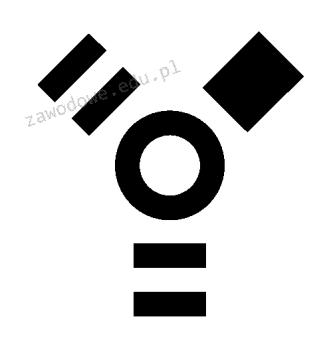

Symbol graficzny przedstawiony na ilustracji oznacza złącze

Pamięć podręczna Intel Smart Cache, która znajduje się w procesorach wielordzeniowych, takich jak Intel Core Duo, to pamięć

Aby ustalić fizyczny adres karty sieciowej, w terminalu systemu Microsoft Windows należy wpisać komendę