Pytanie 1

Najskuteczniejszym sposobem na codzienną archiwizację pojedynczego pliku o objętości 4,8 GB, na jednym komputerze bez dostępu do sieci, jest

Wynik: 25/40 punktów (62,5%)

Wymagane minimum: 20 punktów (50%)

Najskuteczniejszym sposobem na codzienną archiwizację pojedynczego pliku o objętości 4,8 GB, na jednym komputerze bez dostępu do sieci, jest

W topologii elementem centralnym jest switch

Zgodnie z normą Fast Ethernet 100Base-TX, maksymalna długość kabla miedzianego UTP kategorii 5e, który łączy bezpośrednio dwa urządzenia sieciowe, wynosi

Zaprezentowany komunikat jest rezultatem wykonania następującego polecenia

C:\Windows NT_SERVICE\TrustedInstaller:(F)

NT_SERVICE\TrustedInstaller:(CI)(IO)(F)

ZARZĄDZANIE NT\SYSTEM:(M)

ZARZĄDZANIE NT\SYSTEM:(OI)(CI)(IO)(F)

BUILTIN\Administratorzy:(M)

BUILTIN\Administratorzy:(OI)(CI)(IO)(F)

BUILTIN\Użytkownicy:(RX)

BUILTIN\Użytkownicy:(OI)(CI)(IO)(GR,GE)

TWÓRCA-WŁAŚCICIEL:(OI)(CI)(IO)(F)

Podaj polecenie w systemie Windows Server, które umożliwia usunięcie jednostki organizacyjnej z katalogu.

Program testujący wydajność sprzętu komputerowego to

Jakie urządzenie powinno się zastosować do pomiaru topologii okablowania strukturalnego w sieci lokalnej?

W systemie Linux polecenie chmod 321 start spowoduje przyznanie poniższych uprawnień plikowi start:

Jak określana jest transmisja w obie strony w sieci Ethernet?

Aby uruchomić monitor wydajności oraz niezawodności w systemie Windows, należy skorzystać z przystawki

Jakie urządzenie jest używane do łączenia lokalnej sieci bezprzewodowej z siecią kablową?

W systemie Windows informacje o aktualnym użytkowniku komputera są przechowywane w gałęzi rejestru o skróconej nazwie:

Aby komputer osobisty współpracował z urządzeniami korzystającymi z przedstawionych na rysunku złącz, należy wyposażyć go w interfejs

Czym wyróżniają się procesory CISC?

Równoważnym zapisem 232 bajtów jest zapis

Na zdjęciu widać

Interfejs SLI (ang. Scalable Link Interface) jest wykorzystywany do łączenia

Kabel pokazany na ilustracji może być zastosowany do realizacji okablowania sieci o standardzie

W drukarce laserowej do utrwalenia wydruku na papierze stosuje się

Na którym z zewnętrznych nośników danych nie dojdzie do przeniknięcia wirusa podczas przeglądania jego zawartości?

Jakie polecenie w systemie Windows należy użyć, aby ustalić liczbę ruterów pośrednich znajdujących się pomiędzy hostem źródłowym a celem?

Kabel sieciowy z końcówkami RJ45 był testowany za pomocą diodowego urządzenia do sprawdzania okablowania. Na tym urządzeniu diody LED włączały się po kolei, z wyjątkiem diod oznaczonych numerami 2 i 3, które świeciły jednocześnie na jednostce głównej testera, natomiast nie świeciły na jednostce zdalnej. Jaka była tego przyczyna?

Router Wi-Fi działający w technologii 802.11n umożliwia osiągnięcie maksymalnej prędkości przesyłu danych

Aby aktywować tryb awaryjny w systemach z rodziny Windows, w trakcie uruchamiania komputera trzeba nacisnąć klawisz

Funkcja System Image Recovery dostępna w zaawansowanych opcjach uruchamiania systemu Windows 7 pozwala na

Za co odpowiada protokół DNS?

Jakie stwierdzenie dotyczące konta użytkownika Active Directory w systemie Windows jest właściwe?

Co oznacza dziedziczenie uprawnień?

W technologii Ethernet protokół dostępu do medium CSMA/CD jest metodą z

Płyta główna z gniazdem G2 będzie kompatybilna z procesorem

Uszkodzenie mechaniczne dysku twardego w komputerze stacjonarnym może być spowodowane

Jakie medium transmisyjne powinno być użyte do połączenia dwóch punktów dystrybucyjnych oddalonych o 600m?

Który program pozwoli na zarządzanie zasobami i czasem oraz stworzenie harmonogramu prac montażowych zgodnie z projektem sieci lokalnej w budynku?

Wartość koloru RGB(255, 170, 129) odpowiada zapisie

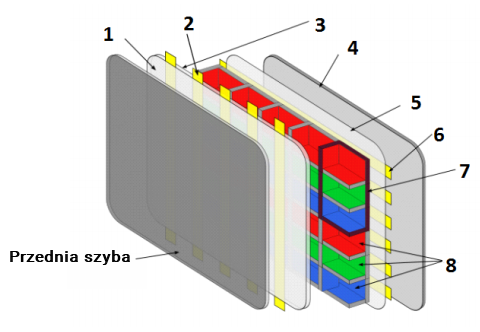

Na diagramie przedstawiającym zasadę funkcjonowania monitora plazmowego, oznaczenie numer 6 dotyczy

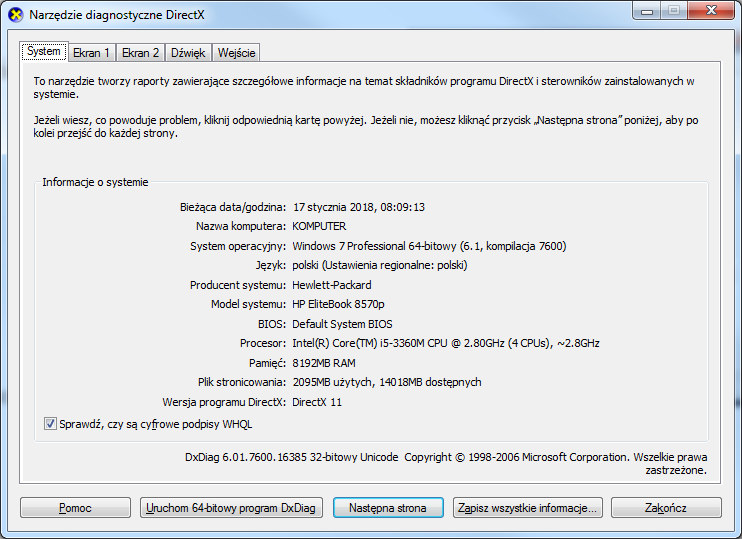

Aby uruchomić przedstawione narzędzie systemu Windows, należy użyć polecenia

Do weryfikacji funkcjonowania serwera DNS na systemach Windows Server można zastosować narzędzie nslookup. Jeżeli w poleceniu jako argument zostanie podana nazwa komputera, np. nslookup host.domena.com, to system sprawdzi

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Sekwencja 172.16.0.1, która reprezentuje adres IP komputera, jest zapisana w systemie

Jak określa się technologię stworzoną przez firmę NVIDIA, która pozwala na łączenie kart graficznych?