Pytanie 1

Proces zapisu na nośnikach BD-R realizowany jest przy użyciu

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Proces zapisu na nośnikach BD-R realizowany jest przy użyciu

Użytkownik zamierza zmodernizować swój komputer zwiększając ilość pamięci RAM. Zainstalowana płyta główna ma parametry przedstawione w tabeli. Wybierając dodatkowe moduły pamięci, powinien pamiętać, aby

| Parametry płyty głównej | |

|---|---|

| Model | H97 Pro4 |

| Typ gniazda procesora | Socket LGA 1150 |

| Obsługiwane procesory | Intel Core i7, Intel Core i5, Intel Core i3, Intel Pentium, Intel Celeron |

| Chipset | Intel H97 |

| Pamięć | 4 x DDR3- 1600 / 1333/ 1066 MHz, max 32 GB, ECC, niebuforowana |

| Porty kart rozszerzeń | 1 x PCI Express 3.0 x16, 3 x PCI Express x1, 2 x PCI |

Trudności w systemie operacyjnym Windows wynikające z konfliktów dotyczących zasobów sprzętowych, takich jak przydział pamięci, przerwań IRQ oraz kanałów DMA, najłatwiej zidentyfikować za pomocą narzędzia

Gdy komputer się uruchamia, na ekranie wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

Równoległy interfejs, w którym magistrala składa się z 8 linii danych, 4 linii sterujących oraz 5 linii statusowych, nie zawiera linii zasilających i umożliwia transmisję na odległość do 5 metrów, pod warunkiem, że przewody sygnałowe są skręcane z przewodami masy; w przeciwnym razie limit wynosi 2 metry, nazywa się

Jakie oprogramowanie można wykorzystać do wykrywania problemów w pamięciach RAM?

Planując prace modernizacyjne komputera przenośnego, związane z wymianą procesora, należy w pierwszej kolejności

W oznaczeniu procesora INTEL CORE i7-4790 cyfra 4 oznacza

Jakie będą łączne wydatki na wymianę karty graficznej w komputerze, jeżeli nowa karta kosztuje 250 zł, czas wymiany wynosi 80 minut, a każda rozpoczęta robocza godzina to koszt 50 zł?

Co oznacza oznaczenie kabla skrętkowego U/FTP?

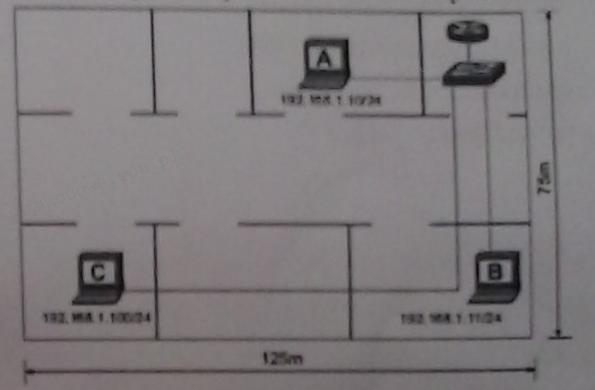

Na ilustracji przedstawiono sieć lokalną zbudowaną na kablach kat. 6. Stacja robocza "C" nie ma możliwości komunikacji z siecią. Jaki problem w warstwie fizycznej może powodować brak połączenia?

Podczas uruchamiania komputera wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

Na ilustracji widoczna jest pamięć operacyjna

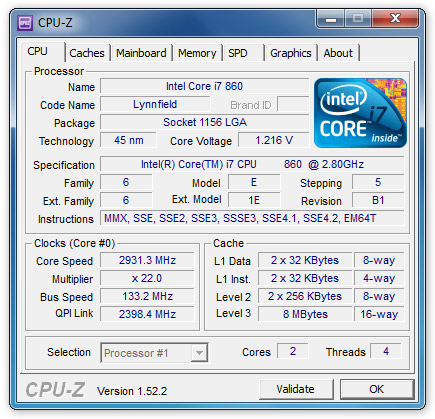

Symbolika tego procesora wskazuje na

Jaką wartość ma moc wyjściowa (ciągła) zasilacza według parametrów przedstawionych w tabeli?

| Napięcie wyjściowe | +5 V | +3.3 V | +12 V1 | +12 V2 | -12 V | +5 VSB |

| Prąd wyjściowy | 18,0 A | 22,0 A | 18,0 A | 17,0 A | 0,3 A | 2,5 A |

| Moc wyjściowa | 120 W | 336W | 3,6 W | 12,5 W |

Jak nazywa się złącze wykorzystywane w sieciach komputerowych, pokazane na zamieszczonym obrazie?

Aby oddzielić komputery pracujące w sieci z tym samym adresem IPv4, które są podłączone do przełącznika zarządzalnego, należy przypisać

Aby zapobiec uszkodzeniu układów scalonych, podczas konserwacji sprzętu komputerowego należy używać

Co oznacza kod BREAK odczytany przez układ elektroniczny klawiatury?

Granice domeny kolizyjnej nie są określane przez porty takich urządzeń jak

Jakie znaczenie ma zaprezentowany symbol graficzny?

Które złącze powinna posiadać karta graficzna, aby można było bezpośrednio ją połączyć z telewizorem LCD wyposażonym wyłącznie w analogowe złącze do podłączenia komputera?

Metoda przesyłania danych między urządzeniem CD/DVD a pamięcią komputera w trybie bezpośredniego dostępu do pamięci to

Jakie urządzenie powinno być użyte do łączenia komputerów w strukturze gwiazdy?

W dokumentacji technicznej procesora producent umieścił wyniki testu, który został wykonany przy użyciu programu CPU-Z. Z tych danych wynika, że procesor dysponuje

W hierarchicznym modelu sieci komputery użytkowników stanowią część warstwy

Użytkownik chce zabezpieczyć mechanicznie dane na karcie pamięci przed przypadkowym skasowaniem. Takie zabezpieczenie umożliwia karta

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Administrator dostrzegł, że w sieci LAN występuje wiele kolizji. Jakie urządzenie powinien zainstalować, aby podzielić sieć lokalną na mniejsze domeny kolizji?

Na płycie głównej doszło do awarii zintegrowanej karty sieciowej. Komputer nie ma dysku twardego ani innych napędów, takich jak stacja dysków czy CD-ROM. Klient informuje, że w sieci firmowej komputery nie mają napędów, a wszystko "czyta" się z serwera. Aby przywrócić utraconą funkcjonalność, należy zainstalować

Jakie urządzenie sieciowe widnieje na ilustracji?

Aby umożliwić wymianę informacji pomiędzy sieciami VLAN, wykorzystuje się

Magistrala PCI-Express do przesyłania danych stosuje metodę komunikacyjną

Co oznacza standard ACPI w BIOSie komputera?

W specyfikacji głośników komputerowych producent mógł podać informację, że maksymalne pasmo przenoszenia wynosi

Układ cyfrowy wykonujący operację logiczną koniunkcji opiera się na bramce logicznej

Jakie miejsce nie powinno być wykorzystywane do przechowywania kopii zapasowych danych z dysku twardego komputera?

Brak zabezpieczeń przed utratą danych w wyniku fizycznej awarii jednego z dysków to właściwość

Urządzenie peryferyjne pokazane na ilustracji to skaner biometryczny, który do autoryzacji wykorzystuje

Przedstawione na ilustracji narzędzie służy do