Pytanie 1

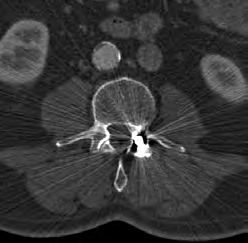

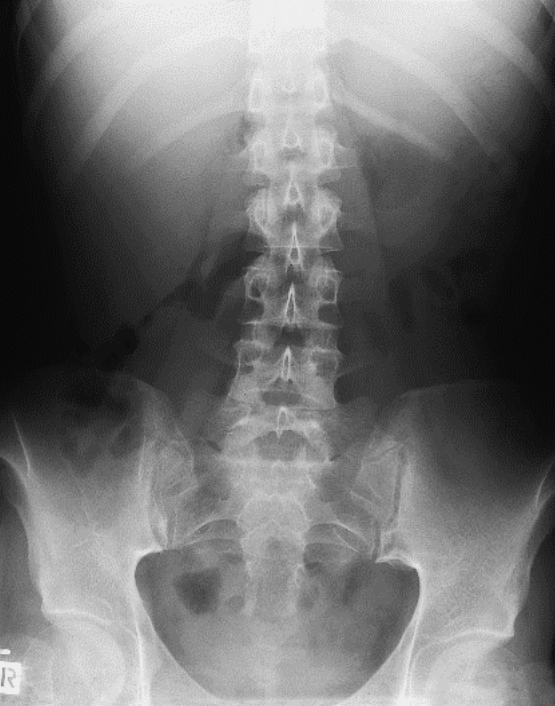

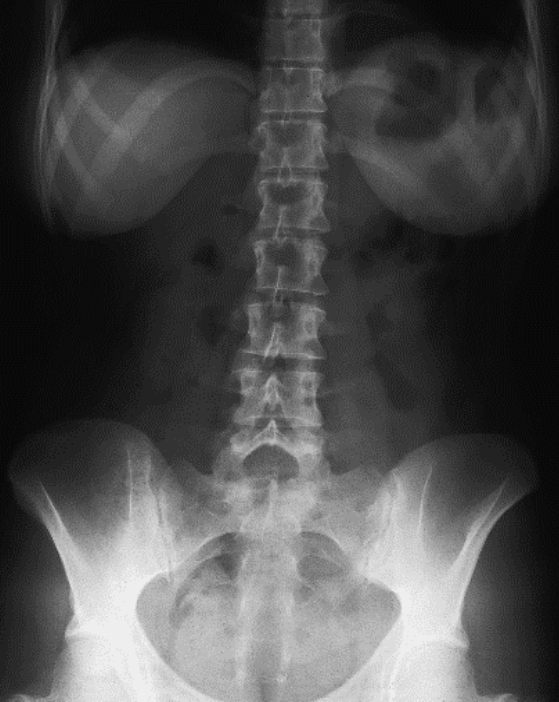

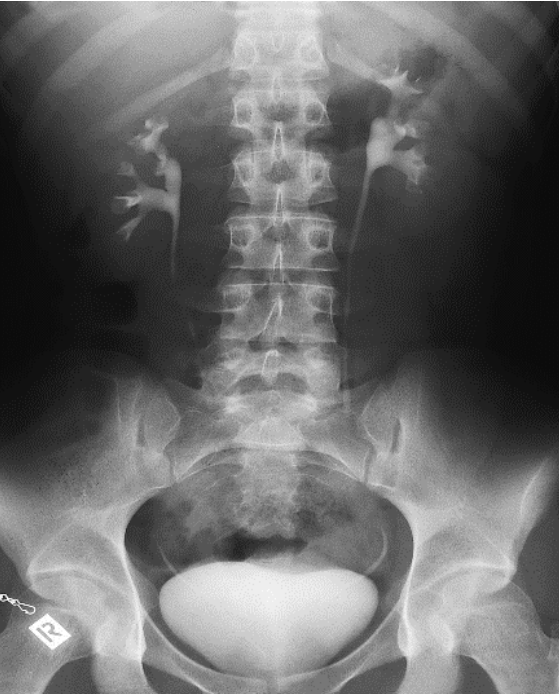

Na obrazie uwidoczniono złamanie kompresyjne kręgu

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Na obrazie uwidoczniono złamanie kompresyjne kręgu

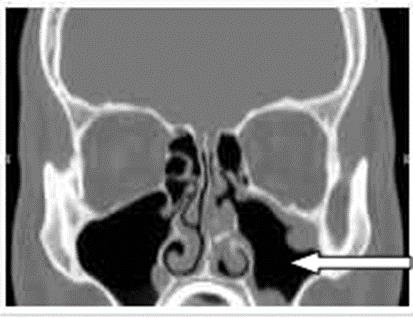

Który artefakt jest widoczny na skanie tomografii komputerowej?

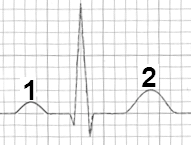

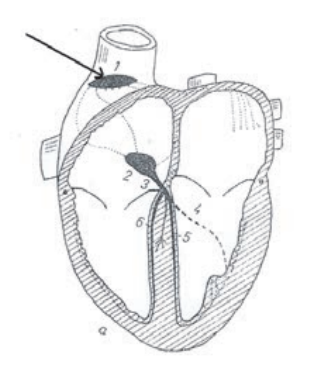

Na schemacie oznaczono

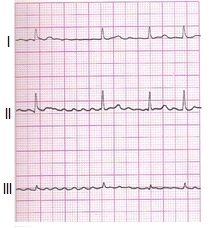

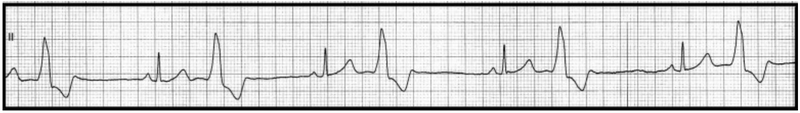

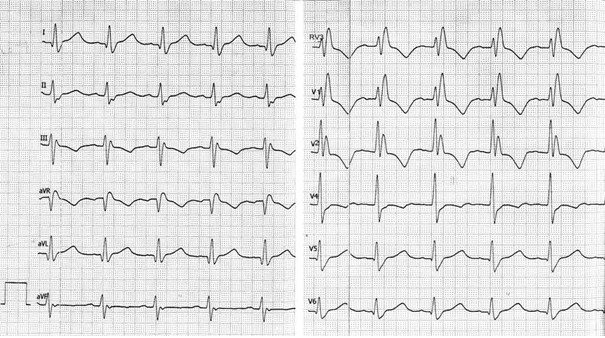

Zamieszczone badanie elektrokardiograficzne wykazało u pacjenta

Strzykawka automatyczna do podawania kontrastu jest stosowana przy wykonywaniu

Wskaż osłonę radiologiczną, która jest stosowana w pracowniach radiodiagnostyki stomatologicznej.

Pielografia to badanie układu

Największa wartość energii promieniowania stosowanego w radioterapii jest generowana przy użyciu

W pozytonowej emisyjnej tomografii komputerowej PET radioznacznik podawany jest pacjentowi najczęściej

W systemie międzynarodowym ząb pierwszy przedtrzonowy po stronie lewej oznacza się symbolem

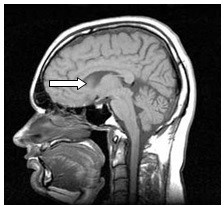

Zaznaczona strzałką struktura anatomiczna na obrazie rezonansu magnetycznego to

Który stan patologiczny został zarejestrowany podczas wykonywania badania EKG?

Na jakim etapie procesu karcynogenezy dochodzi do inwazji miejscowej nowotworu i tworzenia przerzutów odległych?

Parametrem krwi, który powinien zostać oznaczony u pacjenta przed wykonaniem badania MR z kontrastem jest

Który parametr ekspozycji ma decydujący wpływ na kontrast obrazu rentgenowskiego?

W leczeniu izotopowym tarczycy podaje się

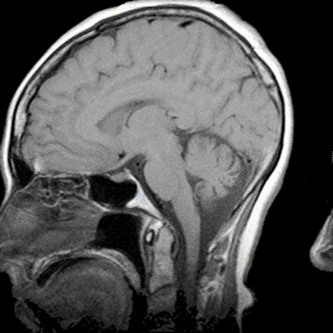

Która przyczyna spowodowała powstanie artefaktu widocznego na zamieszczonym obrazie MR?

Na radiogramie uwidoczniono

W sekwencji echa spinowego obraz T2-zależny uzyskuje się przy czasie repetycji TR

Pozytywny środek cieniujący najczęściej stosowany w rentgenodiagnostyce powinien charakteryzować się

Na którym radiogramie uwidoczniona jest kamica nerkowa?

Który system informatyczny służy do archiwizacji i transmisji obrazów radiologicznych?

W celu oceny wieku kostnego u dziecka praworęcznego, wykonuje się pojedyncze zdjęcie w projekcji

Zgodnie z procedurą wzorcową w badaniu MR należy ułożyć pacjenta na brzuchu do diagnostyki

Podczas wykonywania zdjęć wewnątrzustnych zębów górnych linia Campera powinna przebiegać w stosunku do płaszczyzny podłogi

Na zamieszczonym obrazie TK strzałką zaznaczono zatokę

Po podaniu kontrastu obraz zmian nowotworowych w badaniu MR najlepiej uwidacznia się w sekwencji

Rytm alfa i beta rejestruje się podczas badania

Koronarografia jest radiologicznym zabiegiem diagnostycznym pozwalającym ocenić drożność

Strzałką na schemacie oznaczono

Przedstawiony zapis elektrokardiograficzny może wskazywać na

W standardowym badaniu elektrokardiologicznym elektrodę C4 należy umocować

W radiografii mianem SID określa się

Jakie wymagania techniczne muszą spełniać aparaty terapeutyczne stosowane w zakładach brachyterapii, służące bezpośrednio do napromieniania pacjenta metodą zdalnego wprowadzania źródeł promieniotwórczych?

Kasety do pośredniej radiografii cyfrowej CR są wyposażone

Zwiększenie napięcia na lampie rentgenowskiej powoduje

Parametr spirometryczny czynnościowa pojemność zalegająca oznaczany jest skrótem

Który artefakt uwidoczniono na skanie RM głowy?

Na obrazie cyfrowej angiografii subtrakcyjnej strzałką zaznaczono

Radioizotopowa terapia medycyny nuklearnej polega na wprowadzeniu do tkanek lub narządów radiofarmaceutyku