Pytanie 1

W której fizycznej topologii awaria jednego komputera powoduje przerwanie pracy całej sieci?

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

W której fizycznej topologii awaria jednego komputera powoduje przerwanie pracy całej sieci?

Funkcja systemu Windows Server, umożliwiająca zdalną instalację systemów operacyjnych na komputerach kontrolowanych przez serwer, to

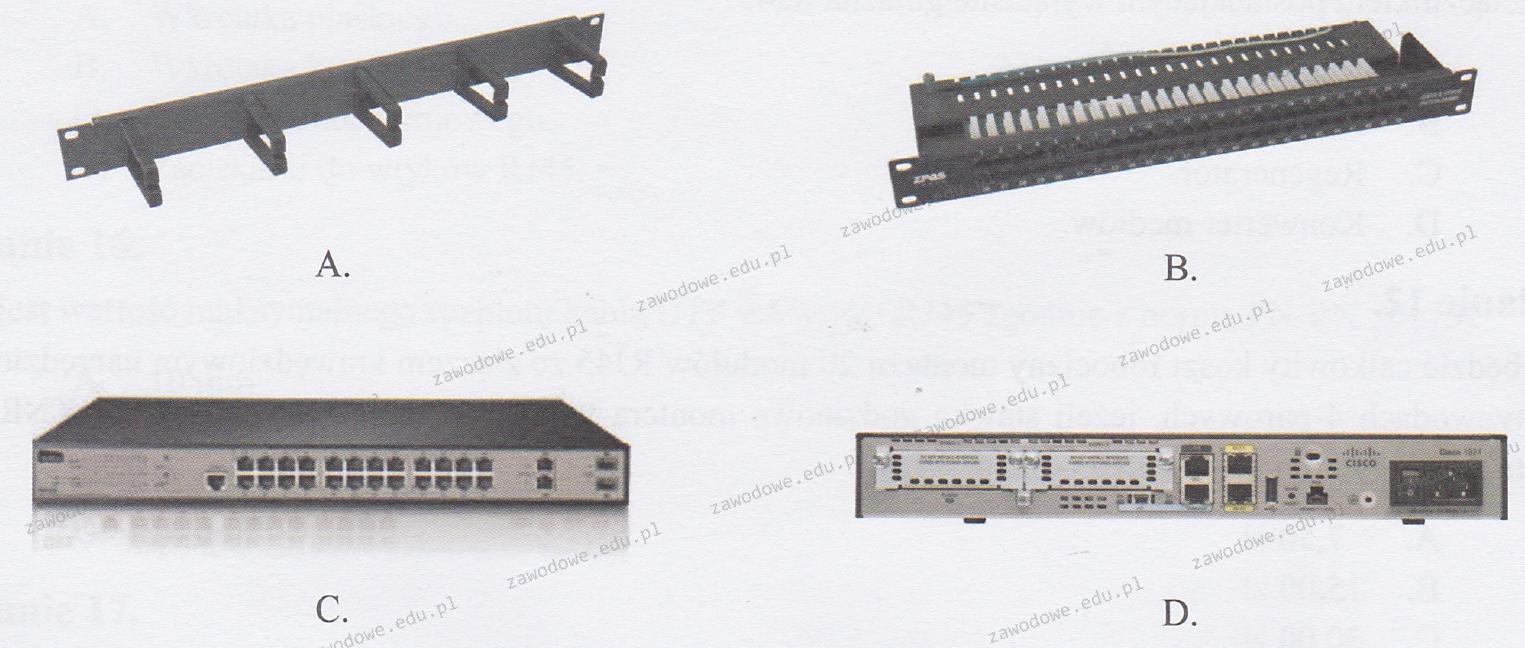

Na którym obrazku przedstawiono panel krosowniczy?

Podczas zamykania systemu operacyjnego na ekranie pojawił się błąd, tak zwany bluescreen, 0x000000F3 Bug Check 0xF3 DISORDERLY_SHUTDOWN – niepowodzenie zamykania systemu, spowodowane brakiem pamięci. Błąd ten może wskazywać na

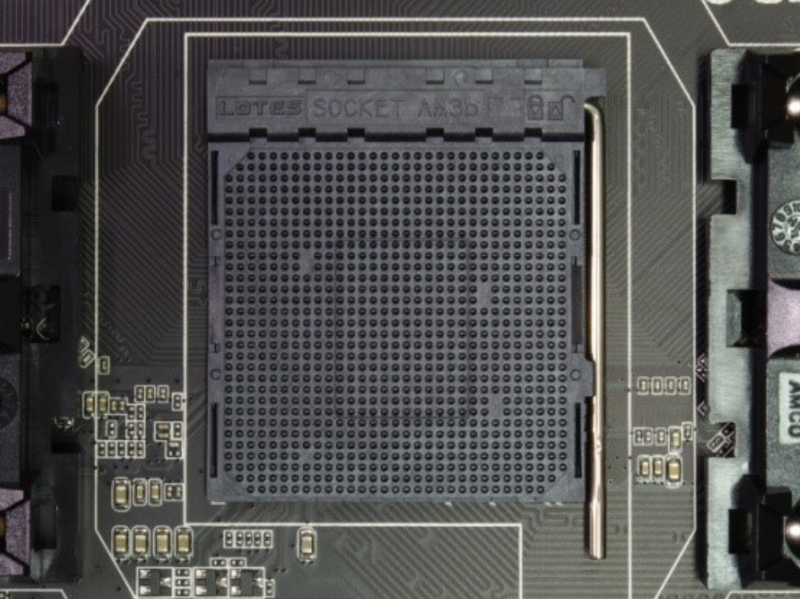

Na płycie głównej wyposażonej w gniazdo przedstawione na zdjęciu można zainstalować procesor

Podczas skanowania czarno-białego rysunku technicznego z maksymalną rozdzielczością optyczną skanera, na pochylonych i zaokrąglonych krawędziach można dostrzec schodkowe ułożenie pikseli. Aby poprawić jakość skanowanego obrazu, konieczne jest zastosowanie funkcji

Mechanizm, który pozwala na podłączenie urządzeń peryferyjnych do systemu komputerowego, w którym każde urządzenie jest identyfikowane przez przypisany mu numer, to

Zapis #102816 oznacza reprezentację w systemie

Jaką jednostką określa się szybkość przesyłania danych w sieciach komputerowych?

Komputer zainstalowany w domenie Active Directory nie jest w stanie nawiązać połączenia z kontrolerem domeny, na którym znajduje się profil użytkownika. Jaki rodzaj profilu użytkownika zostanie stworzony na tym urządzeniu?

Które polecenie w systemie Linux służy do zakończenia procesu?

Który z poniższych adresów należy do klasy B?

Aby zmontować komputer z poszczególnych elementów, korzystając z obudowy SFF, trzeba wybrać płytę główną w formacie

Jakie napięcie jest obniżane z 230 V w zasilaczu komputerowym w standardzie ATX dla różnych podzespołów komputera?

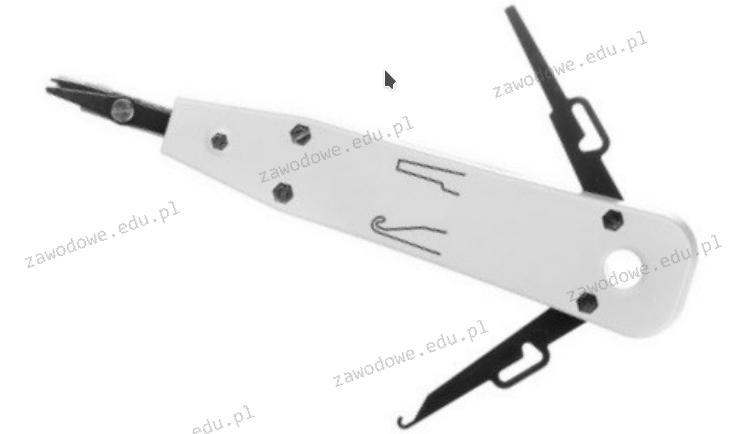

Urządzenie pokazane na ilustracji służy do

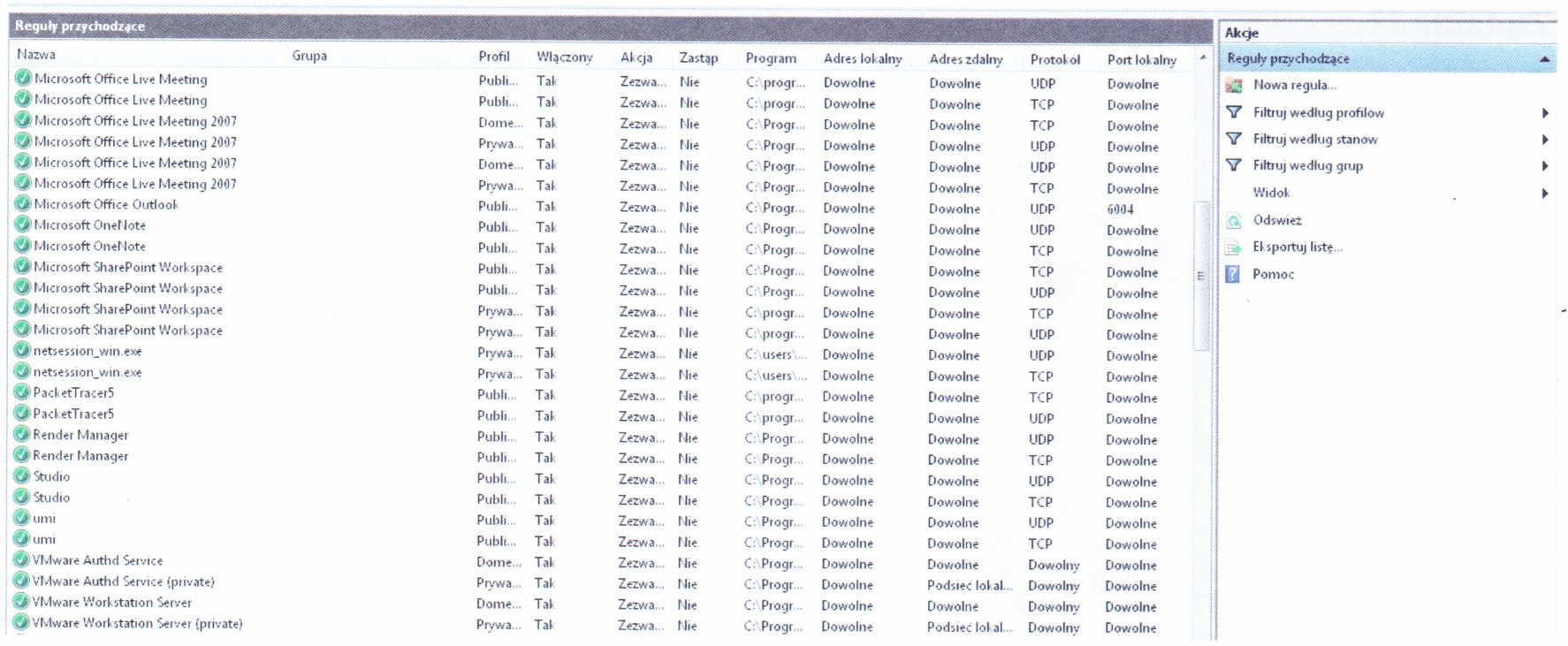

Pokazany zrzut ekranu dotyczy programu

Rodzaj połączenia VPN obsługiwany przez system Windows Server, w którym użytkownicy są uwierzytelniani za pomocą niezabezpieczonych połączeń, a szyfrowanie zaczyna się dopiero po wymianie uwierzytelnień, to

Zidentyfikuj powód pojawienia się komunikatu, który widoczny jest na ilustracji.

W systemie Windows, gdzie można ustalić wymagania dotyczące złożoności hasła?

Jaką cechę posiada przełącznik sieciowy?

Jakie polecenie w systemach Linux służy do przedstawienia konfiguracji interfejsów sieciowych?

Jakie jest tempo transferu danych dla napędu DVD przy prędkości x48?

Jakie czynności należy wykonać, aby przygotować nowego laptopa do użytkowania?

Co oznacza skrót "DNS" w kontekście sieci komputerowych?

Jaką wartość dziesiętną ma liczba FF w systemie szesnastkowym?

Ile maksymalnie urządzeń, wliczając w nie huby oraz urządzenia końcowe, może być podłączonych do interfejsu USB za pomocą magistrali utworzonej przy użyciu hubów USB?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W ramach zalecanych działań konserwacyjnych użytkownicy dysków SSD powinni unikać wykonywania

Jest to najnowsza edycja klienta wieloplatformowego, docenianego przez użytkowników na całym świecie, serwera wirtualnej sieci prywatnej, umożliwiającego nawiązanie połączenia między hostem a komputerem lokalnym, obsługującego uwierzytelnianie z wykorzystaniem kluczy, certyfikatów, nazwy użytkownika oraz hasła, a także, w wersji dla Windows, dodatkowych zakładek. Który z programów został wcześniej opisany?

Czym jest mapowanie dysków?

Jak nazywa się bezklasowa metoda podziału przestrzeni adresowej IPv4?

Który z systemów operacyjnych przeznaczonych do sieci jest dostępny na zasadach licencji GNU?

Jakie parametry można śledzić w przypadku urządzenia przy pomocy S.M.A.R.T.?

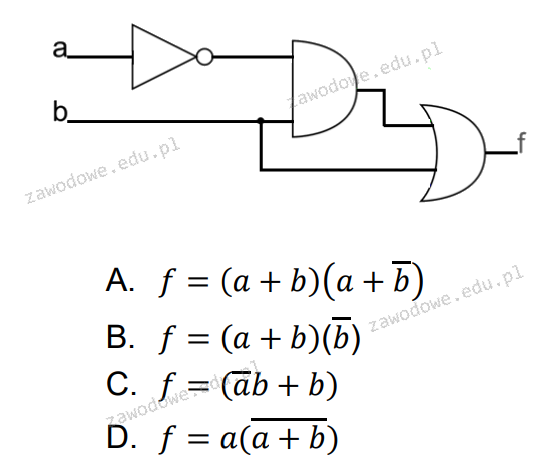

Jaką funkcję wykonuje zaprezentowany układ?

Jakie polecenie w systemie Windows służy do monitorowania bieżących połączeń sieciowych?

W systemach operacyjnych z rodziny Windows, funkcja EFS umożliwia ochronę danych poprzez ich

Aplikacja komputerowa do organizowania struktury folderów oraz plików to

Najskuteczniejszym sposobem na dodanie skrótu do konkretnego programu na pulpitach wszystkich użytkowników w domenie jest

Które z poniższych twierdzeń nie odnosi się do pamięci cache L1?

Wskaż błędne twierdzenie dotyczące Active Directory?