Pytanie 1

Dodatkowe właściwości wyniku operacji przeprowadzanej przez jednostkę arytmetyczno-logiczna ALU zawiera

Wynik: 12/40 punktów (30,0%)

Wymagane minimum: 20 punktów (50%)

Dodatkowe właściwości wyniku operacji przeprowadzanej przez jednostkę arytmetyczno-logiczna ALU zawiera

Jaki rodzaj dysków jest podłączany do złącza IDE na płycie głównej komputera?

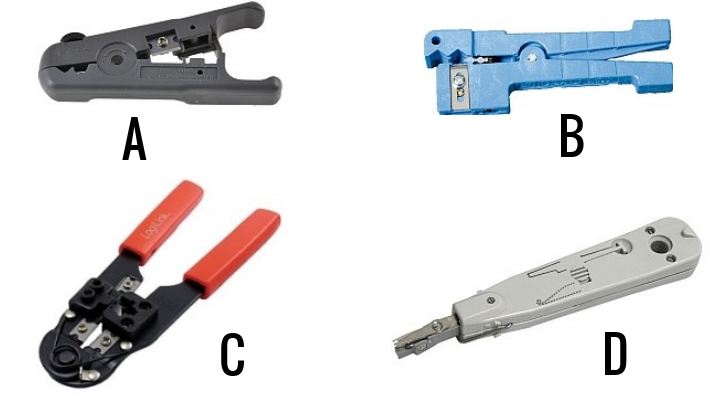

Jakie narzędzie wykorzystuje się do przytwierdzania kabla w module Keystone?

Na podstawie danych przedstawionych w tabeli dotyczącej twardego dysku, ustal, który z wniosków jest poprawny?

W hierarchicznym modelu sieci komputery użytkowników stanowią część warstwy

Pamięć, która działa jako pośrednik pomiędzy pamięcią operacyjną a procesorem o dużej prędkości, to

Każdy następny router IP na ścieżce pakietu

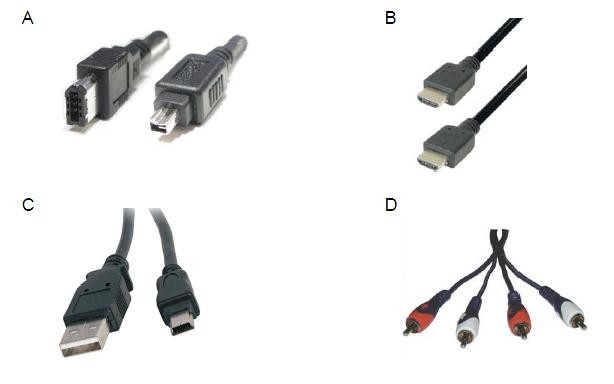

Aby połączyć cyfrową kamerę z interfejsem IEEE 1394 (FireWire) z komputerem, wykorzystuje się kabel z wtykiem zaprezentowanym na fotografii

Który z parametrów twardego dysku NIE ma wpływu na jego wydajność?

Jakie urządzenie powinno być użyte do segmentacji domeny rozgłoszeniowej?

Na ilustracji zaprezentowano układ

Które urządzenie pomiarowe wykorzystuje się do określenia wartości napięcia w zasilaczu?

W celu poprawy efektywności procesora Intel można wykorzystać procesor oznaczony literą

Jakie połączenie bezprzewodowe należy zastosować, aby mysz mogła komunikować się z komputerem?

Zgodnie z normą Fast Ethernet 100Base-TX, maksymalna długość kabla miedzianego UTP kategorii 5e, który łączy bezpośrednio dwa urządzenia sieciowe, wynosi

Sprzętem, który umożliwia wycinanie wzorów oraz grawerowanie w różnych materiałach, takich jak drewno, szkło i metal, jest ploter

Jaką sumę należy zapłacić za wymianę karty graficznej w komputerze, jeżeli cena karty wynosi 250 zł, a czas wymiany przez pracownika serwisu to 80 minut, przy czym każda rozpoczęta godzina pracy kosztuje 50 zł?

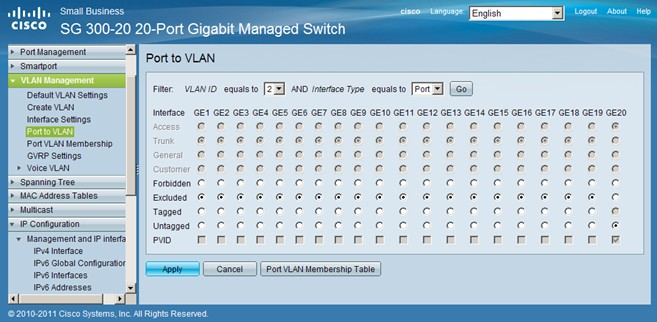

Aby osiągnąć prędkość przesyłania danych 100 Mbps w sieci lokalnej, wykorzystano karty sieciowe działające w standardzie Fast Ethernet, kabel typu UTP o odpowiedniej kategorii oraz przełącznik (switch) zgodny z tym standardem. Taka sieć jest skonstruowana w topologii

Aby zamontować przedstawioną kartę graficzną, potrzebna jest płyta główna posiadająca złącze

Z analizy danych przedstawionych w tabeli wynika, że efektywna częstotliwość pamięci DDR SDRAM wynosi 184 styki 64-bitowa magistrala danych Pojemność 1024 MB Przepustowość 3200 MB/s

Która struktura partycji pozwala na stworzenie do 128 partycji podstawowych na pojedynczym dysku?

Najskuteczniejszym sposobem na wykonanie codziennego archiwizowania pojedynczego pliku o wielkości 4,8 GB, na jednym komputerze bez dostępu do Internetu jest

Który z wymienionych adresów stanowi adres hosta w obrębie sieci 10.128.0.0/10?

Pamięć RAM ukazana na grafice jest instalowana w płycie głównej z gniazdem

PCI\VEN_10EC&DEV_8168&SUBSYS_05FB1028&REV_12

Przedstawiony zapis jest

Jakie oznaczenie powinien mieć komputer, aby mógł zostać sprzedany na terenie Polski, zgodnie z Dyrektywami Rady Europy?

Do serwisu komputerowego przyniesiono laptopa, którego matryca wyświetla obraz w bardzo słabej jakości. Dodatkowo obraz jest znacząco ciemny i widoczny jedynie z niewielkiej odległości. Co może być przyczyną tej usterki?

/dev/sda: Czas odczytu z pamięci podręcznej: 18100 MB w 2.00 sekundy = 9056.95 MB/sek. Przedstawiony wynik wykonania polecenia systemu Linux jest używany do diagnostyki

Z analizy oznaczenia pamięci DDR3 PC3-16000 można wywnioskować, że ta pamięć:

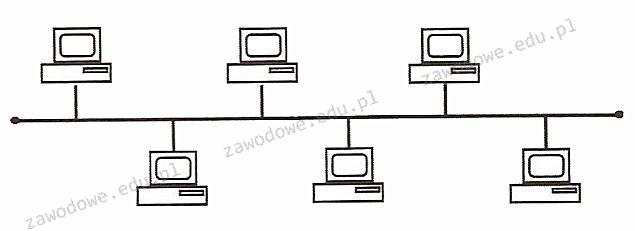

Na ilustracji ukazano sieć o układzie

Przesyłanie danych przez router, które wiąże się ze zmianą adresów IP źródłowych lub docelowych, określa się skrótem

Na jakich nośnikach pamięci masowej jednym z najczęstszych powodów uszkodzeń jest zniszczenie powierzchni?

Jaką minimalną rozdzielczość powinna wspierać karta graficzna, aby możliwe było odtwarzanie materiału wideo w trybie Full HD na 23-calowym monitorze?

Jakie będą całkowite koszty materiałów potrzebnych do stworzenia sieci lokalnej dla 6 komputerów, jeśli do budowy sieci wymagane jest 100 m kabla UTP kat. 5e oraz 20 m kanału instalacyjnego? Ceny komponentów sieci przedstawiono w tabeli.

| Elementy sieci | j.m. | cena brutto |

|---|---|---|

| Kabel UTP kat. 5e | m | 1,00 zł |

| Kanał instalacyjny | m | 8,00 zł |

| Gniazdo komputerowe | szt. | 5,00 zł |

Ile par kabli w standardzie 100Base-TX jest używanych do transmisji danych w obie strony?

Jakie urządzenie powinno być użyte, aby poprawić zasięg sieci bezprzewodowej w obiekcie?

Kluczowe znaczenie przy tworzeniu stacji roboczej, na której ma funkcjonować wiele maszyn wirtualnych, ma:

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Podczas uruchamiania komputera wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

Na wydruku z drukarki laserowej występują jasne i ciemne fragmenty. Jakie działania należy podjąć, by poprawić jakość druku oraz usunąć problemy z nieciągłością?