Pytanie 1

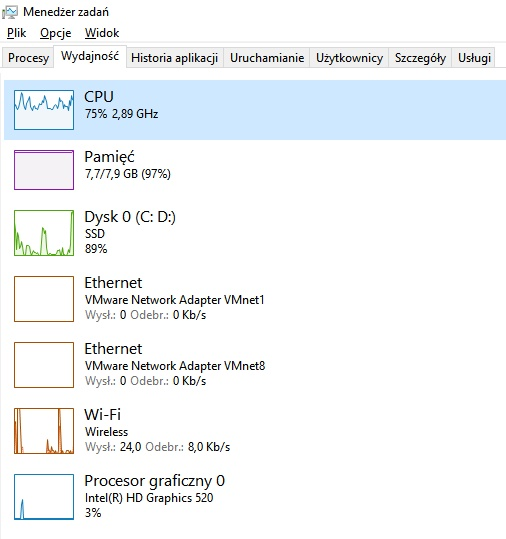

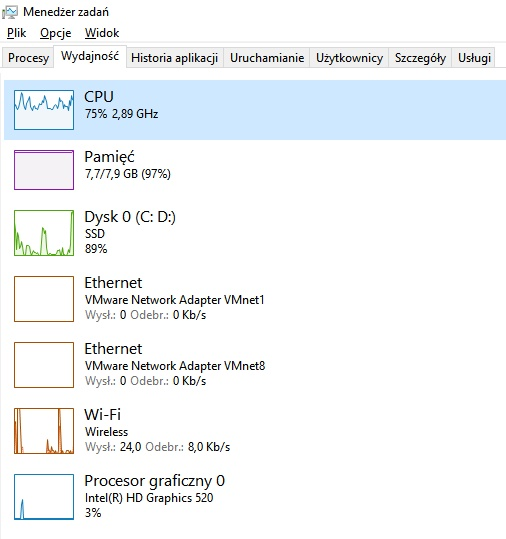

Grafik komputerowy sygnalizuje bardzo wolną pracę komputera. Z ilustracji przedstawiającej okno wydajności komputera wynika, że przyczyną tego może być

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Grafik komputerowy sygnalizuje bardzo wolną pracę komputera. Z ilustracji przedstawiającej okno wydajności komputera wynika, że przyczyną tego może być

Umożliwienie stacjom roboczym Windows, OS X oraz Linux korzystania z usług drukowania Linuxa i serwera plików zapewnia serwer

Podczas instalacji systemu operacyjnego Linux należy wybrać odpowiedni typ systemu plików

Jakie zastosowanie ma narzędzie tracert w systemach operacyjnych rodziny Windows?

W przypadku dłuższych przestojów drukarki atramentowej, pojemniki z tuszem powinny

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

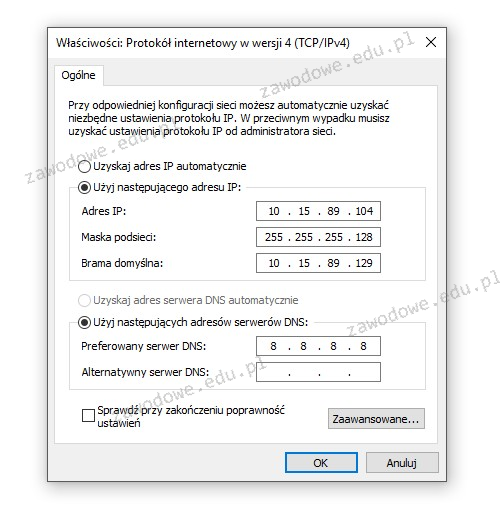

Na rysunku przedstawiono ustawienia karty sieciowej urządzenia z adresem IP 10.15.89.104/25. Co z tego wynika?

Jakie protokoły są właściwe dla warstwy internetowej w modelu TCP/IP?

Usługa odpowiedzialna za konwersję nazw domen na adresy sieciowe to

Pomiar strukturalnego okablowania metodą Permanent Link polega na

Wskaź, które z poniższych stwierdzeń dotyczących zapory sieciowej jest nieprawdziwe?

Aby przesłać projekt wydruku bezpośrednio z komputera do drukarki 3D, której parametry są pokazane w tabeli, można zastosować złącze

| Technologia pracy | FDM (Fused Deposition Modeling) |

| Głowica drukująca | Podwójny ekstruder z unikalnym systemem unoszenia dyszy i wymiennymi modułami drukującymi (PrintCore) |

| Średnica filamentu | 2,85 mm |

| Platforma drukowania | Szklana, podgrzewana |

| Temperatura platformy | 20°C – 100°C |

| Temperatura dyszy | 180°C – 280°C |

| Łączność | WiFi, Ethernet, USB |

| Rozpoznawanie materiału | Skaner NFC |

Najmniejszy czas dostępu charakteryzuje się

Jaką maksymalną liczbę hostów można przypisać w lokalnej sieci, dysponując jedną klasą C adresów IPv4?

Czym jest MFT w systemie plików NTFS?

Płyta główna wyposażona w gniazdo G2 będzie współpracowała z procesorem

Jakiego typu dane są przesyłane przez interfejs komputera osobistego, jak pokazano na ilustracji?

| Bit startu | Bit danych | Bit danych | Bit stopu | Bit startu | Bit danych | Bit startu | Bit danych | Bit danych | Bit stopu | Bit startu | Bit danych | Bit stopu |

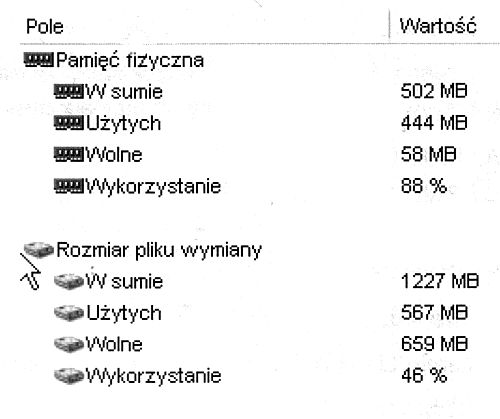

Zgodnie z zamieszczonym fragmentem testu w systemie komputerowym zainstalowane są

Jakim protokołem jest realizowana kontrola poprawności transmisji danych w sieciach Ethernet?

Jakie zdanie charakteryzuje SSH Secure Shell?

Urządzenie peryferyjne, które jest kontrolowane przez komputer i służy do pracy z dużymi, płaskimi powierzchniami, a do produkcji druku odpornego na warunki atmosferyczne wykorzystuje farby na bazie rozpuszczalników, nosi nazwę ploter

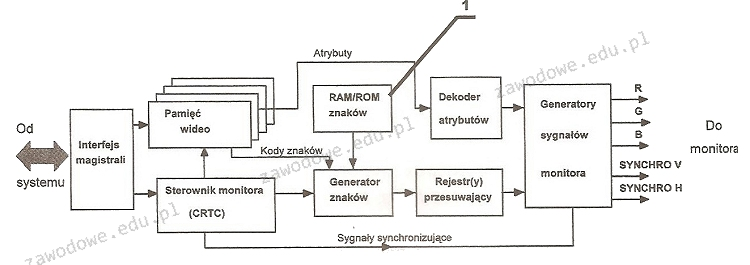

Element oznaczony cyfrą 1 na diagramie blokowym karty graficznej?

Użytkownik uszkodził płytę główną z gniazdem dla procesora AM2. Płytę z uszkodzeniami można wymienić na model z gniazdem, nie zmieniając procesora oraz pamięci

Co umożliwia połączenie trunk dwóch przełączników?

Jaki sterownik drukarki jest uniwersalny dla różnych urządzeń oraz systemów operacyjnych i stanowi standard w branży poligraficznej?

W systemie Linux komenda tty pozwala na

Jaką wartość liczbową ma BACA zapisaną w systemie heksadecymalnym?

Jakim systemem operacyjnym jest system czasu rzeczywistego?

Zgodnie z podanym cennikiem, przeciętny koszt zakupu wyposażenia stanowiska komputerowego wynosi:

| Nazwa sprzętu | Cena minimalna | Cena maksymalna |

|---|---|---|

| Jednostka centralna | 1300,00 zł | 4550,00 zł |

| Monitor | 650,00 zł | 2000,00 zł |

| Klawiatura | 28,00 zł | 100,00 zł |

| Myszka | 22,00 zł | 50,00 zł |

Jak nazywa się licencja oprogramowania, która pozwala na bezpłatne rozpowszechnianie aplikacji?

Protokół ARP (Address Resolution Protocol) pozwala na przypisanie logicznych adresów warstwy sieciowej do rzeczywistych adresów warstwy

Zamiana baterii jest jedną z czynności związanych z użytkowaniem

Urządzenie przedstawione na rysunku

Element na karcie graficznej, który ma za zadanie przekształcenie cyfrowego sygnału wytwarzanego przez kartę na analogowy sygnał, zdolny do wyświetlenia na monitorze to

W dokumentacji technicznej procesora znajdującego się na płycie głównej komputera, jaką jednostkę miary stosuje się do określenia szybkości zegara?

Zestaw narzędzi do instalacji okablowania miedzianego typu "skrętka" w sieci komputerowej powinien obejmować:

Menedżer urządzeń w systemie Windows pozwala na wykrycie

Po stwierdzeniu przypadkowego usunięcia ważnych danych na dysku twardym, aby odzyskać usunięte pliki, najlepiej

Na płycie głównej uszkodzona została zintegrowana karta sieciowa. Komputer nie ma możliwości uruchomienia systemu operacyjnego, ponieważ brakuje dysku twardego oraz napędów optycznych, a system operacyjny uruchamia się z lokalnej sieci. W celu odzyskania utraconej funkcjonalności należy zainstalować w komputerze

Wartość wyrażana w decybelach, będąca różnicą pomiędzy mocą sygnału przekazywanego w parze zakłócającej a mocą sygnału generowanego w parze zakłócanej to