Pytanie 1

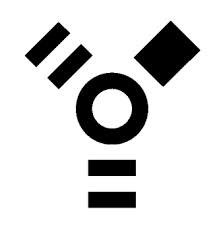

Operacje stałoprzecinkowe w procesorze wykonuje jednostka oznaczona jako

Wynik: 40/40 punktów (100,0%)

Wymagane minimum: 20 punktów (50%)

Operacje stałoprzecinkowe w procesorze wykonuje jednostka oznaczona jako

Technologie SLI i CrossFire pozwalają na podłączenie dwóch kart

Z przedstawionej dokumentacji pamięci wynika że jest ona przeznaczona do

rodzaj pamięci : SO-DIMM standard : DDR3-1333 (PC3-10600) pojemność pojedynczego modułu : 4 GB |

Fale mózgowe alfa, beta, gamma, delta i theta są rejestrowane w

Podczas wymiany podzespołów elektronicznych czułych na wyładowania elektrostatyczne należy zastosować

W opisanym programie zostaną wykonane 4

for (i=0;i<=3;i++) suma=suma+i; |

Narzędzie przedstawione na rysunku służy do

Zapisana w ramce funkcja zawiera

| Funkcja oblicz(n) Jeżeli n=0 oblicz=1 W przeciwnym wypadku oblicz=(n-1)*oblicz(n-1) |

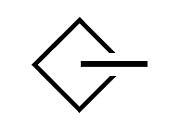

Urządzenie, które w specyfikacji technicznej posiada zapis: „Urządzenie współpracuje z komputerem klasy PC poprzez złącze USB”, należy podłączyć do złącza oznaczonego piktogramem

Jaki wpływ na organizm ludzki ma krioterapia?

W dokumencie urządzenia elektroniki medycznej podano następujące informacje:

Interfejs obrazu DICOM • Maksymalna szybkość przesyłania wg standardu Ethernet: 100 Mb/s. • Szybkość przesyłania obrazów: 2 MB/s. Interfejs RIS/CIS zgodny z DICOM • Maksymalna szybkość przesyłania wg standardu Ethernet: 100 Mb/s. |

Jaki wpływ na organizm ludzki ma promieniowanie podczerwone IR?

W systemie bazodanowym wymagane jest dodatkowe sprzętowe zabezpieczenie danych przed ich utratą. Która macierz dyskowa pozwala uodpornić się na utratę danych w przypadku awarii wszystkich dysków poza jednym?

Który przyrząd należy wybrać celem sprawdzenia poprawnej prędkości transmisji danych na łączu RS232 urządzenia elektroniki medycznej?

Dla której wartości z wymienionych rezystancji, zastosowanie układu poprawnie mierzonego prądu zapewnia najmniejszy błąd pomiaru?

Który system bazodanowy uniemożliwia bezpłatne zastosowanie komercyjne?

Który z przedstawionych przyrządów służy do testowania połączeń w sieci LAN?

Urządzenie do rejestracji bioelektrycznych potencjałów mięśniowych to

Urządzenie przedstawione na rysunku jest przeznaczone do

Znak ~ na początku ciągu znaków w systemach uniksowych oznacza

W celu podłączenia monitora do systemu wizualizacji obrazów wymagany jest interfejs Display Port. Ile takich interfejsów posiada karta graficzna przedstawiona na rysunku?

Który podzespół komputerowy posiada obudowę o zamieszczonej specyfikacji?

| Specyfikacja obudowy | |

|---|---|

| Obsługiwane gniazda | LGA775 |

| TCASE | 71,4°C |

| Wymiary obudowy | 37,5 mm x 37,5 mm |

| Rozmiar płytki półprzewodnikowej | 214 mm² |

| Liczba tranzystorów płytki półprzewodnikowej | 820 milion |

| Dostępne opcje obniżonej zawartości halogenków | Patrz MDDS |

Zabieg diametrii krótkofalowej powoduje

Który rozdzielacz sygnału należy zastosować w celu wykorzystania jednego przewodu U/UTP5e do podłączenia dwóch urządzeń do sieci LAN?

Na rysunku przedstawiono kartę rozszerzeń umożliwiającą

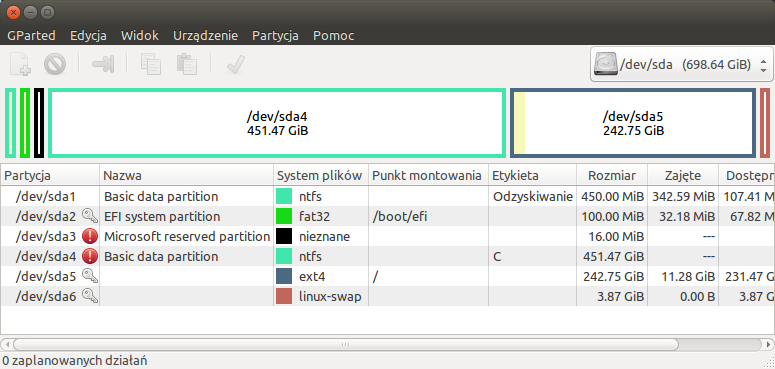

Które systemy operacyjne mogą być zainstalowane na dysku, którego działanie obrazuje GParted?

Programowanie obiektowe wykorzystuje dziedziczenie, które polega na

W tabeli przedstawiono fragment dokumentacji testera

| Zakres | ±500 mm Hg 20 °C |

| Dokładność | ±1% odczytu + 0.5 mm Hg) |

| Zakres | 80, 94 bpm (synch. z EKG) |

| Dokładność sygnału | ±1% |

| Inwazyjne: | |

| Statyczne ciśnienie | -10, -5, 0, 20, 40, 50, 60, 80, 100, 150, 160, 200, 240, 250, 300, 320, 400 mm Hg |

| Dokładność | ±(1% zakresu ±1mm Hg) or ±(2% nastawy + 2mm Hg) |

| Impedancja | 300 Ohm (±10% dokładności) |

| Czułość | 5 do 40 μV/V/mm Hg |

W instrukcji systemu do skanowania dokumentacji medycznej zapisano, że umożliwia wykorzystanie systemu OCR, który służy do

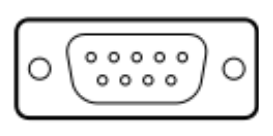

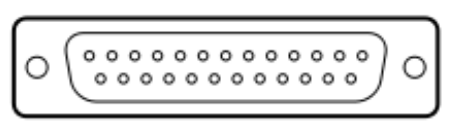

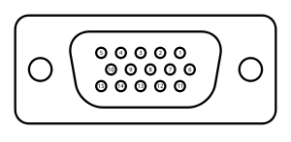

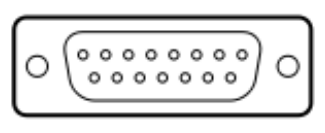

Zgodnie z przedstawionym opisem, gniazdo interfejsu służące do podłączenia audiometru ze stanowiskiem komputerowym przedstawione jest na rysunku

| Opis: |

| − 125 Hz ÷ 8.000 Hz − -10 dB do 120 dB HL na wyjściu − połączenie z komputerem PC – interfejs RS232 − połączenie z drukarką laserową − połączenie z drukarką atramentową |

Elementem sieci komputerowej w topologii gwiazdy, pozwalającym przyłączyć wiele urządzeń sieciowych, jest

Która magistrala służy do szeregowej transmisji danych?

Przepływ przez organizm człowieka prądów o wysokiej częstotliwości, mających zastosowanie w elektrochirurgii, może powodować

Jaki format danych należy zastosować do archiwizacji, kompresji i szyfrowania danych?

Które polecenie w systemie Windows tworzy folder Dane?

Podczas uruchamiania komputera procedura POST testuje poprawność działania

Ile operacji inkrementacji wykonano w przedstawionej liście kroków?

i=0; Dopóki i>3 wykonaj i=i+1; |

W celu zmiany hasła użytkownika w systemie Linux należy użyć polecenia

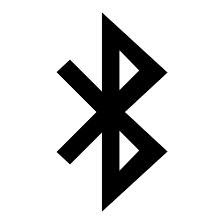

Moduł EKG do badań wysiłkowych został wyposażony w interfejs Bluetooth w celu przesyłania wyników badań. Aby połączyć moduł z stanowiskiem komputerowym, należy wybrać interfejs oznaczony symbolem

Który system informatyki medycznej umożliwia archiwizację obrazów?