Pytanie 1

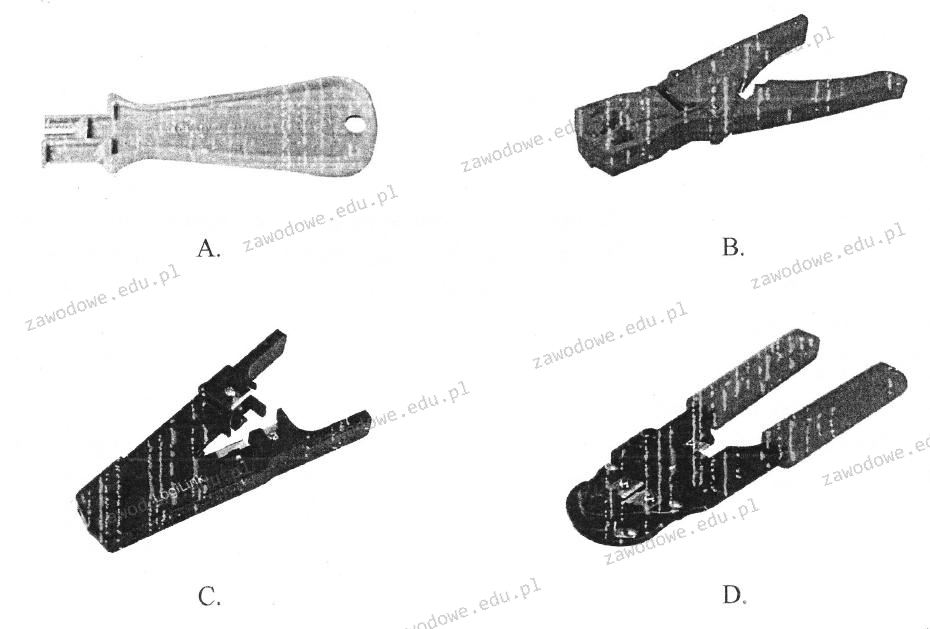

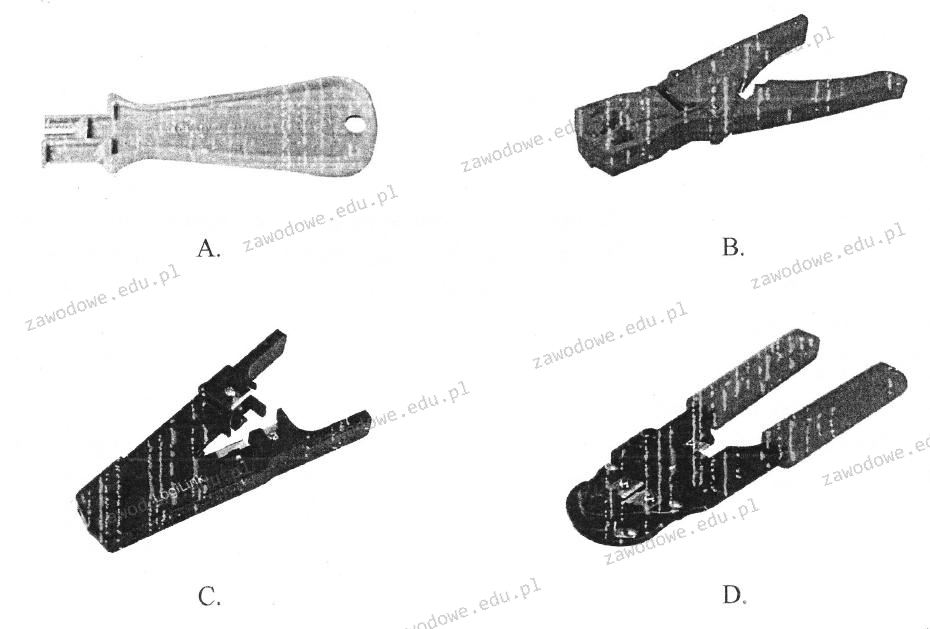

Jaki instrument jest używany do usuwania izolacji?

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Jaki instrument jest używany do usuwania izolacji?

Gniazdo LGA umieszczone na płycie głównej komputera stacjonarnego pozwala na zamontowanie procesora

Jakie porty powinny zostać zablokowane w firewallu, aby nie pozwolić na łączenie się z serwerem FTP?

Podczas normalnego działania systemu operacyjnego w laptopie pojawił się komunikat o konieczności formatowania wewnętrznego dysku twardego. Wskazuje on na

Prawo osobiste twórcy do oprogramowania komputerowego

Jaką operację należy wykonać, aby chronić dane przesyłane w sieci przed działaniem sniffera?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

int a;

Podaną zmienną wyświetl na 2 sposoby.

Zastosowanie symulacji stanów logicznych w obwodach cyfrowych pozwala na

Jakie polecenie w systemie Linux pozwala na dodanie istniejącego użytkownika nowak do grupy technikum?

Czym są programy GRUB, LILO, NTLDR?

Jakie adresy mieszczą się w zakresie klasy C?

Jaką rolę pełni serwer plików w sieciach komputerowych LAN?

Poleceniem systemu Linux służącym do wyświetlenia informacji, zawierających aktualną godzinę, czas działania systemu oraz liczbę zalogowanych użytkowników, jest

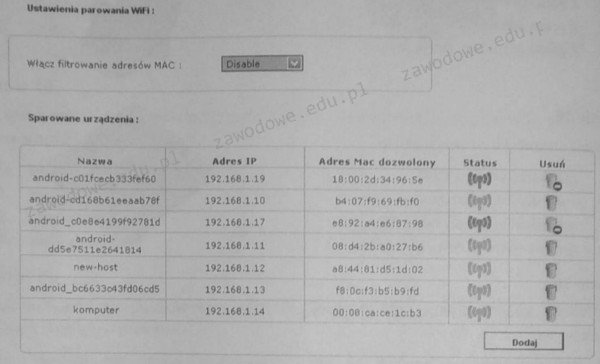

Na zamieszczonym zdjęciu widać

Zgodnie z normą Fast Ethernet 100Base-TX, maksymalna długość kabla miedzianego UTP kategorii 5e, który łączy bezpośrednio dwa urządzenia sieciowe, wynosi

Dysk zewnętrzny 3,5" o pojemności 5 TB, używany do archiwizacji lub wykonywania kopii zapasowych, wyposażony jest w obudowę z czterema interfejsami komunikacyjnymi do wyboru. Który z tych interfejsów powinien być użyty do podłączenia do komputera, aby uzyskać najwyższą prędkość transferu?

Według specyfikacji JEDEC, napięcie zasilania dla modułów pamięci RAM DDR3L wynosi

Aby zmontować komputer z poszczególnych elementów, korzystając z obudowy SFF, trzeba wybrać płytę główną w formacie

Umożliwienie stacjom roboczym Windows, OS X oraz Linux korzystania z usług drukowania Linuxa i serwera plików zapewnia serwer

W hierarchicznym modelu sieci, komputery należące do użytkowników są składnikami warstwy

Schemat ilustruje ustawienia urządzenia WiFi. Wskaż, które z poniższych stwierdzeń na temat tej konfiguracji jest prawdziwe?

Jak nazywa się protokół używany do przesyłania wiadomości e-mail?

Przedstawione narzędzie podczas naprawy zestawu komputerowego przeznaczone jest do

W systemie Windows odpowiednikiem macierzy RAID 1 jest wolumin o nazwie

Jakie urządzenie powinno się zastosować do podłączenia żył kabla skrętki do gniazda Ethernet?

Interfejs SLI (ang. Scalable Link Interface) jest używany do łączenia

Na przedstawionym panelu tylnym płyty głównej znajdują się między innymi następujące interfejsy:

Na komputerze klienckim z systemem Windows XP plik "hosts" to plik tekstowy, który wykorzystywany jest do przypisywania

Główną czynnością serwisową w drukarce igłowej jest zmiana pojemnika

Aby Jan mógł zmienić właściciela drukarki w systemie Windows, musi mu zostać przypisane prawo do w opcjach zabezpieczeń

Jak prezentuje się adres IP 192.168.1.12 w formacie binarnym?

Urządzenie ADSL wykorzystuje się do nawiązania połączenia

Każdy następny router IP na ścieżce pakietu

Odmianą pamięci, która jest tylko do odczytu i można ją usunąć za pomocą promieniowania ultrafioletowego, jest pamięć

Komputer A, który potrzebuje przesłać dane do komputera B działającego w sieci z innym adresem IP, najpierw wysyła pakiety do adresu IP

W komputerze połączonym z Internetem, w oprogramowaniu antywirusowym aktualizację bazy wirusów powinno się przeprowadzać minimum

Zasadniczym sposobem zabezpieczenia danych przechowywanych na serwerze jest

Demon serwera Samba pozwala na udostępnianie plików oraz drukarek w sieci

AES (ang. Advanced Encryption Standard) to standard szyfrowania, który?