Pytanie 1

Na podstawie jakiego adresu przełącznik podejmuje decyzję o przesyłaniu ramek?

Wynik: 14/40 punktów (35,0%)

Wymagane minimum: 20 punktów (50%)

Na podstawie jakiego adresu przełącznik podejmuje decyzję o przesyłaniu ramek?

Aby możliwe było przekierowanie drukowanego dokumentu na dysk twardy, należy w opcjach konfiguracyjnych drukarki wybrać drukowanie do portu

Która edycja systemu operacyjnego Windows Server 2008 charakteryzuje się najmniej rozbudowanym interfejsem graficznym?

Do wykonania końcówek kabla UTP wykorzystuje się wtyczkę

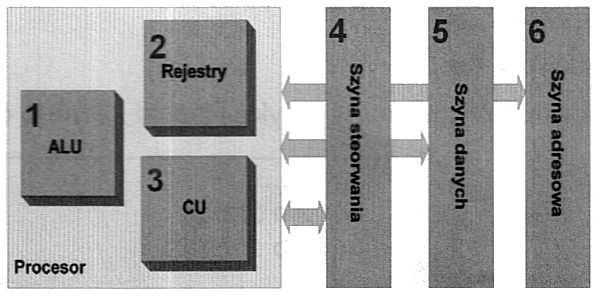

Na diagramie element odpowiedzialny za dekodowanie poleceń jest oznaczony liczbą

Element płyty głównej odpowiedzialny za wymianę danych między mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej jest na rysunku oznaczony numerem

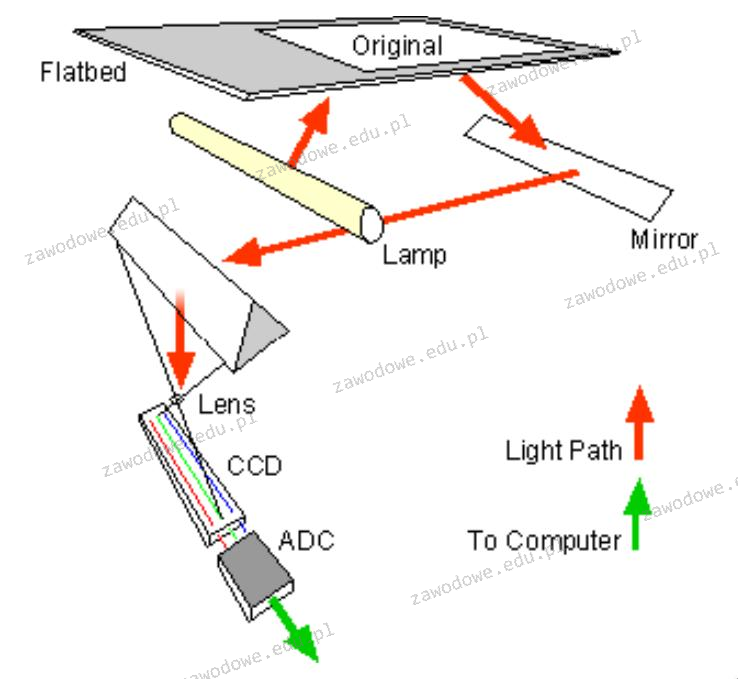

Ilustrowany schemat obrazuje zasadę funkcjonowania

Na fotografii ukazana jest pamięć o 168 stykach

Który z protokołów jest wykorzystywany w telefonii VoIP?

Transmisja danych typu półduplex to transmisja

Jakie zastosowanie ma przedstawione narzędzie?

W oznaczeniu procesora INTEL CORE i7-4790 cyfra 4 oznacza

Który program umożliwia sprawdzanie stanów portów i wykonuje próby połączeń z nimi?

Która norma odnosi się do okablowania strukturalnego?

Jakie urządzenie pozwala na połączenie lokalnej sieci komputerowej z Internetem?

Który typ profilu użytkownika zmienia się i jest zapisywany na serwerze dla klienta działającego w sieci Windows?

Aby bezpiecznie połączyć się z firmowym serwerem przez Internet i mieć dostęp do zasobów firmy, należy wykorzystać odpowiednie oprogramowanie klienckie

Jakie polecenie w systemie Linux jest używane do sprawdzania wielkości katalogu?

Jakim protokołem łączności, który gwarantuje pewne dostarczenie informacji, jest protokół

Aby móc zakładać konta użytkowników, komputerów oraz innych obiektów i centralnie gromadzić o nich informacje, należy zainstalować rolę na serwerze Windows

Przygotowując ranking dostawców łączy internetowych należy zwrócić uwagę, aby jak najmniejsze wartości miały parametry

Brak odpowiedzi na to pytanie.

Aby sprawdzić dostępną przestrzeń na dysku twardym w systemie Linux, można wykorzystać polecenie

Brak odpowiedzi na to pytanie.

Protokół Datagramów Użytkownika (UDP) należy do kategorii

Brak odpowiedzi na to pytanie.

Jakie narzędzie w wierszu poleceń służy do testowania oraz diagnostyki serwerów DNS?

Brak odpowiedzi na to pytanie.

Wskaż urządzenie, które powinno być użyte do połączenia dwóch komputerów z siecią Internet poprzez lokalną sieć Ethernet, gdy dysponujemy jedynie jednym adresem IP

Brak odpowiedzi na to pytanie.

Bezprzewodową komunikację komputerów w sieci lokalnej zapewnia

Brak odpowiedzi na to pytanie.

Aby przeprowadzić instalację systemu operacyjnego z rodziny Windows na stacjach roboczych, konieczne jest dodanie na serwerze usług

Brak odpowiedzi na to pytanie.

Aby zmienić system plików na dysku z FAT32 na NTFS w Windows XP, należy użyć programu

Brak odpowiedzi na to pytanie.

Który z protokołów będzie wykorzystany przez administratora do przesyłania plików na serwer?

Brak odpowiedzi na to pytanie.

Jednym z typowych symptomów mogących świadczyć o nadchodzącej awarii dysku twardego jest wystąpienie

Brak odpowiedzi na to pytanie.

Który z protokołów w systemach operacyjnych Linux jest używany w sieciach lokalnych?

Brak odpowiedzi na to pytanie.

Aby przygotować do pracy skaner, którego opis zawarto w tabeli, należy w pierwszej kolejności

| Skaner przenośny IRIScanBook 3 |

| Bezprzewodowy, zasilany baterią i bardzo lekki. Można go przenosić w dowolne miejsce! |

| Idealny do skanowania książek, czasopism i gazet |

| Rozdzielczość skanowania 300/600/900 dpi |

| Prędkość skanowania: 2 sek. dla tekstów biało-czarnych / 3 sek. dla tekstów kolorowych |

| Bezpośrednie skanowanie do formatu PDF i JPEG |

| Zapis skanu na kartę microSD ™ (w zestawie) |

| Kolorowy ekran (do podglądu zeskanowanych obrazów) |

| 3 baterie alkaliczne AAA (w zestawie) |

Brak odpowiedzi na to pytanie.

Jakiego narzędzia wraz z parametrami, należy użyć w systemie Windows, aby wyświetlić przedstawione informacje o dysku twardym?

| ST950420AS | |||||||||||||||||||||||||||||||||||||||||||||||

| Identyfikator dysku | : A67B7C06 | ||||||||||||||||||||||||||||||||||||||||||||||

| Typ | : ATA | ||||||||||||||||||||||||||||||||||||||||||||||

| Stan | : Online | ||||||||||||||||||||||||||||||||||||||||||||||

| Ścieżka | : 0 | ||||||||||||||||||||||||||||||||||||||||||||||

| Element docelowy | : 0 | ||||||||||||||||||||||||||||||||||||||||||||||

| Identyfikator jednostki LUN | : 0 | ||||||||||||||||||||||||||||||||||||||||||||||

| Ścieżka lokalizacji | : PCIROOT(0)#ATA(C00T00L00) | ||||||||||||||||||||||||||||||||||||||||||||||

| Bieżący stan tylko do odczytu | : Nie | ||||||||||||||||||||||||||||||||||||||||||||||

| Tylko do odczytu | : Nie | ||||||||||||||||||||||||||||||||||||||||||||||

| Rozruchowy | : Tak | ||||||||||||||||||||||||||||||||||||||||||||||

| Dysk plików stronicowania | : Tak | ||||||||||||||||||||||||||||||||||||||||||||||

| Dysk plików hibernacji | : Nie | ||||||||||||||||||||||||||||||||||||||||||||||

| Dysk zrzutów awaryjnych | : Tak | ||||||||||||||||||||||||||||||||||||||||||||||

| Dysk klastrowany | : Nie | ||||||||||||||||||||||||||||||||||||||||||||||

| |||||||||||||||||||||||||||||||||||||||||||||||

Brak odpowiedzi na to pytanie.

Który algorytm służy do weryfikacji, czy ramka Ethernet jest wolna od błędów?

Brak odpowiedzi na to pytanie.

Które urządzenie należy wykorzystać do podłączenia urządzenia peryferyjnego, wyposażonego w bezprzewodowy interfejs wykorzystujący do komunikacji fale świetlne w zakresie podczerwieni, z laptopem, który nie ma takiego interfejsu, a ma natomiast interfejs USB?

Brak odpowiedzi na to pytanie.

O ile zwiększy się liczba dostępnych adresów IP w podsieci po zmianie maski z 255.255.255.240 (/28) na 255.255.255.224 (/27)?

Brak odpowiedzi na to pytanie.

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Brak odpowiedzi na to pytanie.

Jakie porty powinny być odblokowane w ustawieniach firewalla na komputerze, na którym działa usługa serwera WWW?

Brak odpowiedzi na to pytanie.

Powszechnie stosowana forma oprogramowania, która funkcjonuje na zasadzie "najpierw wypróbuj, a potem kup", to

Brak odpowiedzi na to pytanie.

Którego narzędzia można użyć, aby prześledzić trasę, którą pokonują pakiety w sieciach?

Brak odpowiedzi na to pytanie.